Clear Sky Science · pl

Wykrywanie stygmatyzującego języka w notatkach klinicznych za pomocą dużych modeli językowych w opiece nad uzależnieniami

Dlaczego słowa w twojej dokumentacji medycznej mają znaczenie

W miarę jak coraz więcej pacjentów zyskuje dostęp do swoich dokumentów medycznych online, język używany przez klinicystów nie jest już ukryty w szpitalnych komputerach — jest widoczny dla samych osób, których dotyczy. Dla pacjentów żyjących z uzależnieniem jedno wyrażenie, takie jak „narkoman”, może cicho wzmacniać poczucie wstydu, niszczyć zaufanie i nawet wpływać na otrzymywaną opiekę. W tym badaniu zadano aktualne pytanie: czy nowoczesna sztuczna inteligencja może pomóc szpitalom wykrywać i ograniczać stygmatyzujący język w notatkach klinicznych, zanim wyrządzi on szkodę pacjentom?

Szkodliwe etykiety ukryte w codziennych notatkach

Stygmat w opiece zdrowotnej nie przejawia się jedynie w kontakcie wzrokowym czy tonie głosu; jest również wpisany w zapis pisemny. Elektroniczne rekordy zdrowotne zawierają miliony notatek, które towarzyszą pacjentom w różnych klinikach i szpitalach. Określenia takie jak „nadużywanie alkoholu” czy „poszukiwanie narkotyków” mogą wpływać na to, jak przyszli klinicyści postrzegają osobę długo po wizycie w izbie przyjęć czy pobycie w szpitalu. Badacze skupili się na notatkach z oddziałów intensywnej terapii dotyczących pacjentów z problemami związanymi z używaniem substancji, gdzie stawka jest wysoka, a dokumentacja obszerna. Wypracowali podejście bazujące na krajowych wytycznych zachęcających do szacunkowego, koncentrującego się na osobie języka, jak „osoba z zaburzeniem związanym z używaniem substancji” zamiast „narkoman”, i wykorzystali te idee do stworzenia dużego zbioru notatek oznaczonych jako stygmatyzujące lub nie.

Nauczanie AI czytania między wierszami

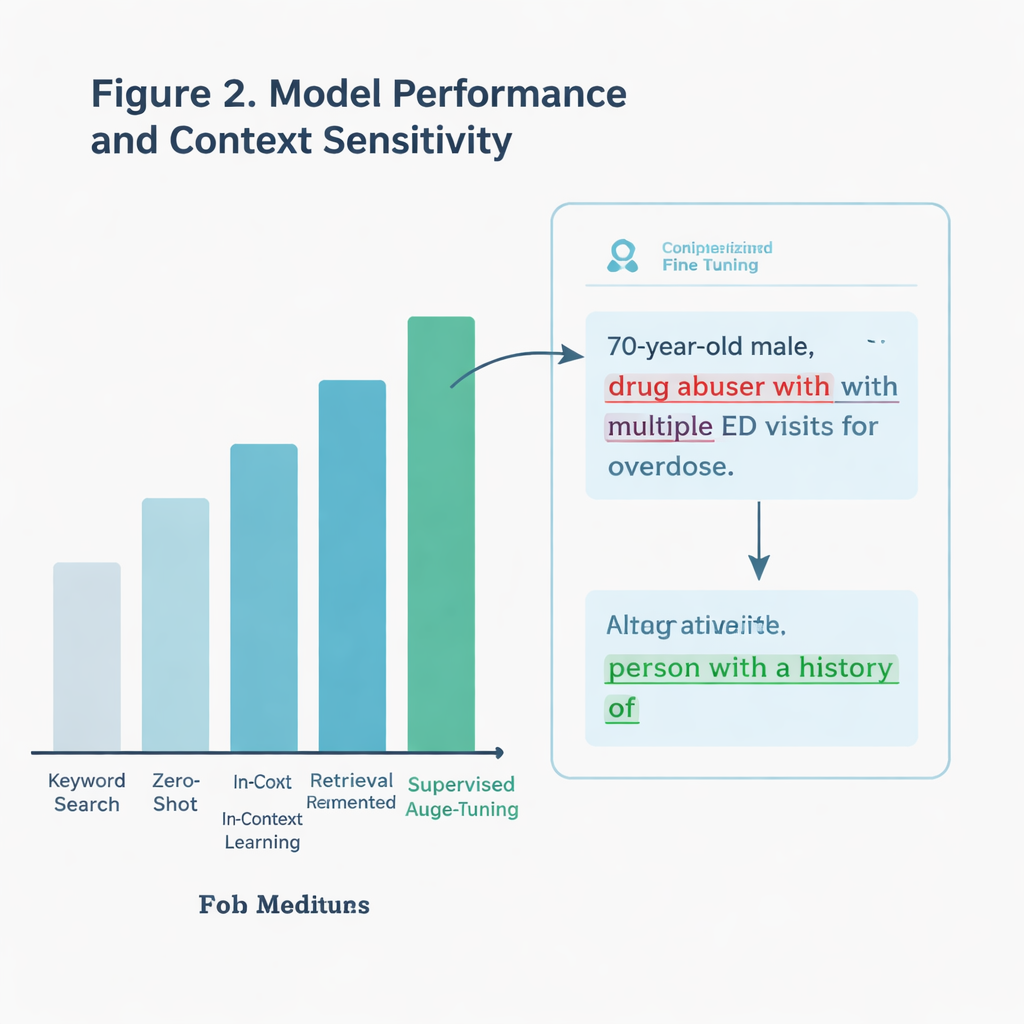

Zespół nie chciał jedynie skanować pod kątem zakazanych słów — zależało im na systemie AI potrafiącym zrozumieć kontekst. Na przykład notatka może cytować pacjenta, który opisuje siebie jako „pijany”, co nie jest tym samym co nadanie takiej etykiety przez clinicię. Autorzy porównali kilka podejść, wszystkie oparte na dużym modelu językowym (rodzaj AI przetwarzającej i generującej tekst). Jedna podstawowa metoda polegała na wyszukiwaniu konkretnych słów kluczowych zaczerpniętych z wytycznych. Bardziej zaawansowane metody prosiły AI o ocenę każdej notatki bez dodatkowych przykładów, z dodatkowymi wskazówkami z wytycznych komunikacyjnych lub po specjalnym przeszkoleniu — „dopasowaniu” (fine-tuningu) na tysiącach oznaczonych notatek z OIT.

Co sprawdziło się najlepiej w praktyce

Model poddany fine-tuningowi okazał się wyraźnym zwycięzcą. Na zestawie testowym zawierającym ponad 11 000 notatek poprawnie identyfikował stygmatyzujący język w około 97 procent przypadków, znacznie przewyższając prostą metodę wyszukiwania słów kluczowych. Lepiej radził sobie także w szczególnie trudnym podzbiorze notatek zawierających potencjalnie nacechowane terminy, które nie zawsze były użyte w sposób szkodliwy. Model potrafił rozróżnić prawdziwie oceniające zwroty od neutralnych lub cytowanych użyć, gdzie prymitywne wyszukiwanie zawodziłoby. Gdy zespół przetestował system na notatkach z innego systemu opieki zdrowotnej — niemal 300 000 notatek z OIT napisanych w innym stanie — wciąż przewyższał on podejście oparte na słowach kluczowych, mimo że stygmatyzujący język był rzadki w tym rzeczywistym zbiorze danych.

Odnajdywanie nowych problematycznych fraz, które klinicyści przeoczyli

Badacze poszli o krok dalej i poprosili AI, by wyjaśniła, dlaczego oznaczyła pewne notatki. Specjalista ds. uzależnień następnie przejrzał te wyjaśnienia. W kilkudziesięciu przypadkach modele wskazały rzeczywiście stygmatyzujące sformułowania, które pierwotni anotatorzy ludzie przeoczyli, w tym zwroty nieujęte w istniejących wytycznych. Przykłady obejmowały opisy takie jak „poszukiwanie narkotyków” czy potoczne wzmianki o „alkoholowej marskości”, które subtelnie obwiniały osobę zamiast choroby. Wskazuje to, że dobrze zaprojektowane narzędzia AI mogą nie tylko egzekwować obecne dobre praktyki, lecz także poszerzać nasze rozumienie tego, jak wygląda szkodliwy język w miarę ewolucji klinicznego stylu pisania.

Od narzędzia badawczego do asystenta przy łóżku pacjenta

W badaniu uwzględniono też kwestie praktyczne. Wyszukiwanie słów kluczowych jest błyskawiczne, ale płytkie. Najdokładniejszy model AI wymagał kilku godzin treningu na wydajnych procesorach graficznych, jednak po wytrenowaniu mógł przesiewać notatki w ciągu kilku sekund każda — wolno w porównaniu do silnika wyszukiwawczego, ale akceptowalnie jako działanie w tle w systemie szpitalnym. Inne, mniej dostosowane podejście opierające się wyłącznie na starannie przygotowanych poleceniach (promptach) działało całkiem dobrze bez dodatkowego szkolenia, co sugeruje lżejsze opcje dla placówek o mniejszych zasobach technicznych. Razem te ustalenia wskazują na systemy, które mogą w czasie rzeczywistym oznaczać ryzykowne sformułowania i proponować bardziej szacunkowe alternatywy w miarę wpisywania notatek przez klinicystów.

Krok w stronę bardziej pełnej szacunku opieki

Dla osoby niebędącej specjalistą kluczowy wniosek jest prosty: słowa w twoim karcie choroby to nie tylko żargon techniczny; wpływają one na to, jak jesteś traktowany. To badanie pokazuje, że duże modele językowe mogą wiarygodnie wykrywać wiele form stygmatyzującego języka związanego z uzależnieniem w notatkach z oddziałów intensywnej terapii, nawet gdy problem jest subtelny. Choć żaden system nie jest doskonały, takie narzędzia mogą służyć jako nieustający redaktor, skłaniając klinicystów do używania języka, który uznaje ludzi za coś więcej niż ich diagnozy. Na dłuższą metę ta zmiana — od obwiniania do szacunku — może być równie istotna dla leczenia jak każdy lek czy urządzenie.

Cytowanie: Sethi, R., Caskey, J., Gao, Y. et al. Detecting stigmatizing language in clinical notes with large language models for addiction care. npj Health Syst. 3, 15 (2026). https://doi.org/10.1038/s44401-026-00069-0

Słowa kluczowe: stygmatyzacja uzależnień, notatki kliniczne, duże modele językowe, elektroniczne rekordy zdrowotne, język koncentrujący się na osobie