Clear Sky Science · pl

Wyjaśnialna ramowa metoda rozumowania z wieloma poziomami atrybucji do wykrywania fałszywych wiadomości

Dlaczego wykrywanie fałszywych wiadomości staje się trudniejsze

Codziennie miliony postów łączących słowa i obrazy przelatują przez media społecznościowe. Część jest nieszkodliwa, część prawdziwa, a część to starannie przygotowane falsyfikaty mające przyciągnąć uwagę, wzbudzić emocje lub wpłynąć na opinię. W miarę jak narzędzia do edycji obrazu i generatory AI stają się tańsze i łatwiejsze w użyciu, fałszywe wiadomości stają się bardziej dopracowane i niebezpieczne. Artykuł przedstawia nowy sposób zaglądania do systemów wykrywania fałszywych wiadomości, dzięki któremu możemy zobaczyć nie tylko, czy post jest prawdopodobnie fałszywy, ale też dlaczego.

Jak fałszywe wiadomości oszukują nasze oczy i umysły

Twórcy fałszywych wiadomości wykorzystują to, że ludzie szybko przeglądają nagłówki i obrazy. Mogą podrabiać lub modyfikować zdjęcia, wplatać częściowo prawdziwe szczegóły w niemożliwą historię, sklejać elementy z różnych wydarzeń albo mieszać lokalizacje i osie czasowe, które do siebie nie pasują. Pojedynczy post o wydarzeniu na żywo może pokazywać dramatyczne zdjęcie z innego incydentu sprzed lat, a przekonujące zdjęcie może zostać wytworzone całkowicie przez AI. Tradycyjne systemy detekcji zwykle traktują wszystkie fałszywe posty jednakowo i wrzucają tekst i obraz do jednej zmiksowanej „zupy cech”. To podejście może działać w miarę dobrze, ale zachowuje się jak czarna skrzynka: trudno dziennikarzom, platformom czy zwykłym użytkownikom zrozumieć konkretne wskazówki, które wywołały alarm.

Nowy sposób pytania: „Dlaczego to jest fałszywe?”

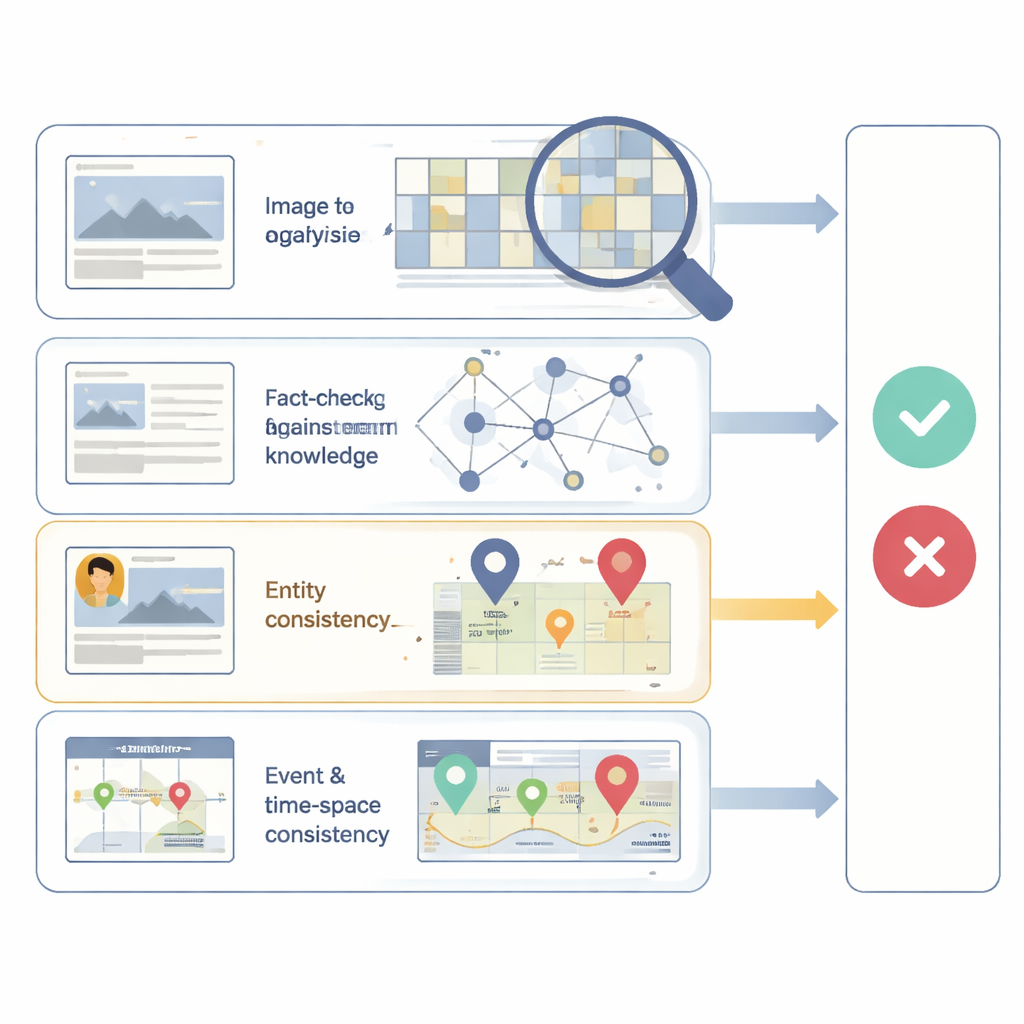

Autorzy proponują wyjaśnialną ramę nazwaną EMAR‑FND, która bada posty informacyjne z czterech odrębnych perspektyw, z których każda wiąże się z powszechną metodą fałszerstwa. Po pierwsze, analizuje, czy sam obraz wykazuje ślady manipulacji lub generacji syntetycznej, koncentrując się na subtelnych wzorcach szumów związanych z aparatem, które zmieniają się po przeróbce zdjęcia. Po drugie, sprawdza, czy fakty w historii zgadzają się z zaufaną wiedzą zewnętrzną, taką jak znane relacje między ludźmi, miejscami i wydarzeniami. Po trzecie, bada, czy kluczowe podmioty wymienione w tekście — na przykład postać publiczna lub miasto — rzeczywiście odpowiadają temu, co pojawia się na załączonym obrazie. Po czwarte, ocenia, czy opisywane wydarzenie spaja się w czasie i przestrzeni, na przykład wykrywając niezgodność między deklarowaną lokalizacją a wizualnymi wskazówkami na zdjęciu, albo między podaną oś czasu a innymi dowodami.

Skladanie wskazówek z wielu perspektyw

Każde z tych czterech sprawdzeń obsługiwane jest przez odrębny moduł rozumujący, który wydaje częściowy werdykt na temat tego, czy dany aspekt wygląda wiarygodnie. Jeden moduł skupia się na manipulacjach wizualnych; inny rozumuje w oparciu o zewnętrzne grafy wiedzy; trzeci buduje rozbudowaną sieć łączącą słowa, obiekty na obrazie i wyodrębnione wydarzenia; a czwarty porównuje post z powiązanymi dowodami w czasie i przestrzeni. Zamiast ukrywać te sygnały w pojedynczej zintegrowanej reprezentacji, EMAR‑FND zachowuje ich wkłady oddzielnie, a potem łączy je w końcowym kroku decyzyjnym, który może ważyć, jak ważny jest każdy punkt widzenia w konkretnej sprawie. Efektem jest nie tylko końcowy wynik prawdziwe‑czy‑fałszywe, ale także atrybucja pokazująca na przykład, że post został oznaczony głównie dlatego, że obraz wydaje się sfałszowany, albo dlatego, że opisywane wydarzenie nie pasuje do znanych faktów.

Testowanie systemu w warunkach rzeczywistych

Aby sprawdzić, jak dobrze to podejście działa, badacze zastosowali EMAR‑FND do dwóch publicznych zbiorów prawdziwych i fałszywych postów zawierających tekst i obrazy. W tych zbiorach ich metoda przewyższyła kilka silnych istniejących systemów, osiągając wyższą dokładność i lepszą równowagę między wykrywaniem fałszywych postów a unikaniem fałszywych alarmów. Gdy analizowali, jak posty grupowały się wewnątrz modelu, prawdziwe wiadomości miały tendencję do tworzenia zwartych, spójnych grup, podczas gdy fałszywe były bardziej rozproszone — co odzwierciedla różnorodność trików stosowanych przez fałszerzy. Wyniki atrybucji okazały się także użyteczne w trudnych, rzeczywistych przykładach: posty, w których tekst i obraz na pierwszy rzut oka wydawały się zgodne, zostały obnażone jako fałszywe albo dlatego, że obraz ujawnił ukryte ślady manipulacji, albo dlatego, że wiedza zewnętrzna zaprzeczyła podanym faktom.

Co to oznacza dla codziennych czytelników

Mówiąc prosto, badanie pokazuje, że można zbudować detektory fałszywych wiadomości, które zachowują się mniej jak wyrocznie, a bardziej jak skrupulatni śledczy. Zamiast udzielać lakonicznej odpowiedzi tak‑lub‑nie, EMAR‑FND podkreśla, która część posta budzi podejrzenia: zdjęcie, fakty, wspomniane osoby czy samo wydarzenie. Tego rodzaju wyjaśnienie może pomóc fact‑checkerom, platformom i czytelnikom ufać decyzjom systemu i nauczyć się rozpoznawać powszechne wzorce oszustw. W miarę jak fałszywe wiadomości będą się rozwijać, narzędzia, które potrafią zarówno wykrywać, jak i wyjaśniać manipulacje, będą kluczowe dla utrzymania bardziej zdrowych i przejrzystych ekosystemów informacji online.

Cytowanie: Ji, W., Lv, H., Zhao, H. et al. Explainable multi-granularity attribution reasoning framework for fake news detection. npj Artif. Intell. 2, 38 (2026). https://doi.org/10.1038/s44387-026-00093-3

Słowa kluczowe: wykrywanie fałszywych wiadomości, multimodalna dezinformacja, wyjaśnialna sztuczna inteligencja, integralność mediów społecznościowych, analiza fałszerstw obrazów