Clear Sky Science · pl

Rozplątywanie powstawania zachowań zbiorowych w sieciach agentów poznawczych

Dlaczego myślące roje mają znaczenie

Od kolektywów robotów po społeczności internetowe — grupy prostych jednostek potrafią wykazywać zaskakująco złożone zachowania. Co jednak się dzieje, gdy każda jednostka wcale nie jest prosta, lecz dysponuje potężnym rozumowaniem opartym na języku, jak w dzisiejszych dużych modelach AI? Niniejsze badanie analizuje, jak roje takich „agentów poznawczych” zachowują się w porównaniu z klasycznymi cząstkami wykonującymi reguły, oraz co to oznacza dla zadań takich jak rozwiązywanie problemów czy symulacja społeczeństw.

Od prostych cząstek do rozmawiających agentów

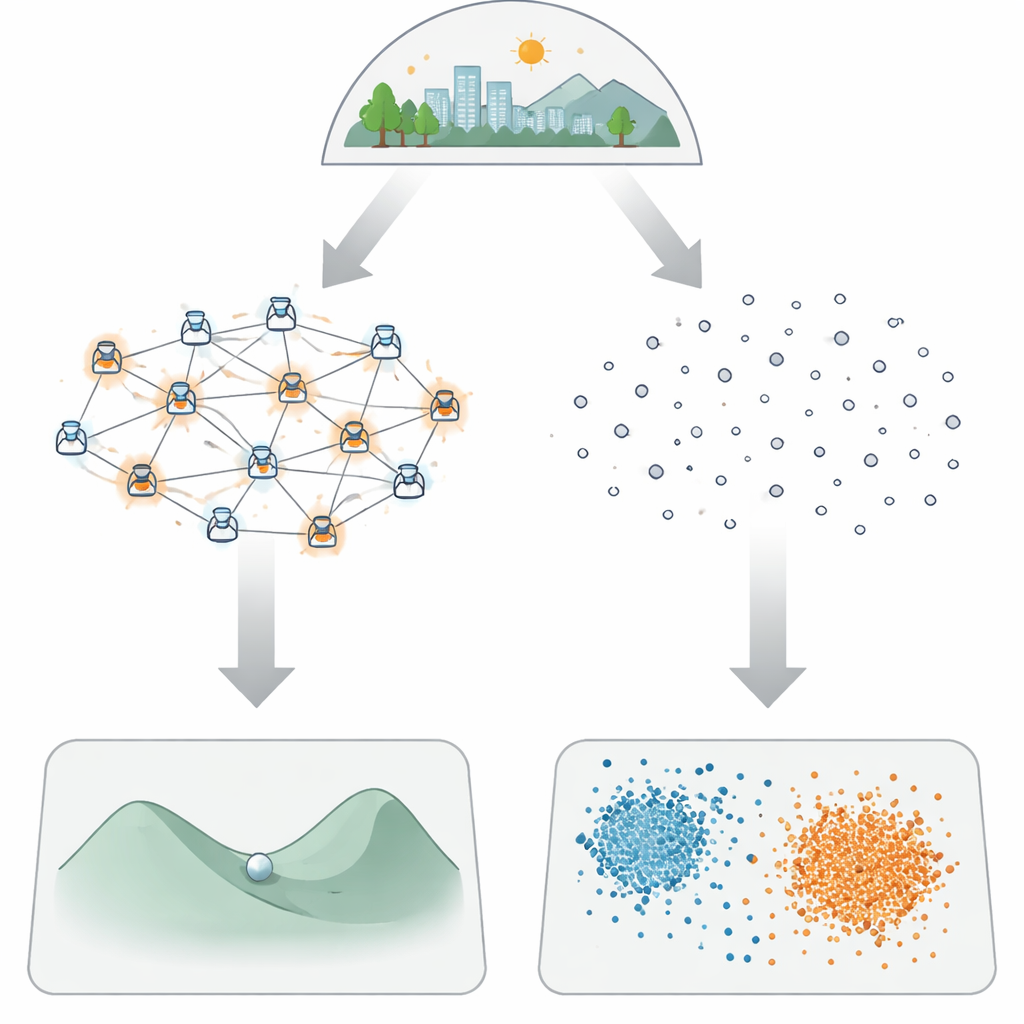

Tradycyjne modele tłumów, stad czy rojów traktują jednostki jako podstawowe cząstki podążające za stałymi regułami: poruszaj się ku sąsiadowi, unikaj kolizji, preferuj podobnych sąsiadów itd. W przeciwieństwie do tego agenci badani tutaj są napędzani przez duże modele językowe (LLM). Postrzegają otoczenie słowami, rozumują, co zrobić dalej, pamiętają przeszłe doświadczenia i nawet rozmawiają między sobą. Autorzy stawiają zasadnicze pytanie: gdy każda jednostka ma tak wbudowaną „inteligencję”, czy wzorce pojawiające się na poziomie grupy się zmieniają, a jeśli tak — w jaki sposób?

Testowanie rojów na trudnych problemach

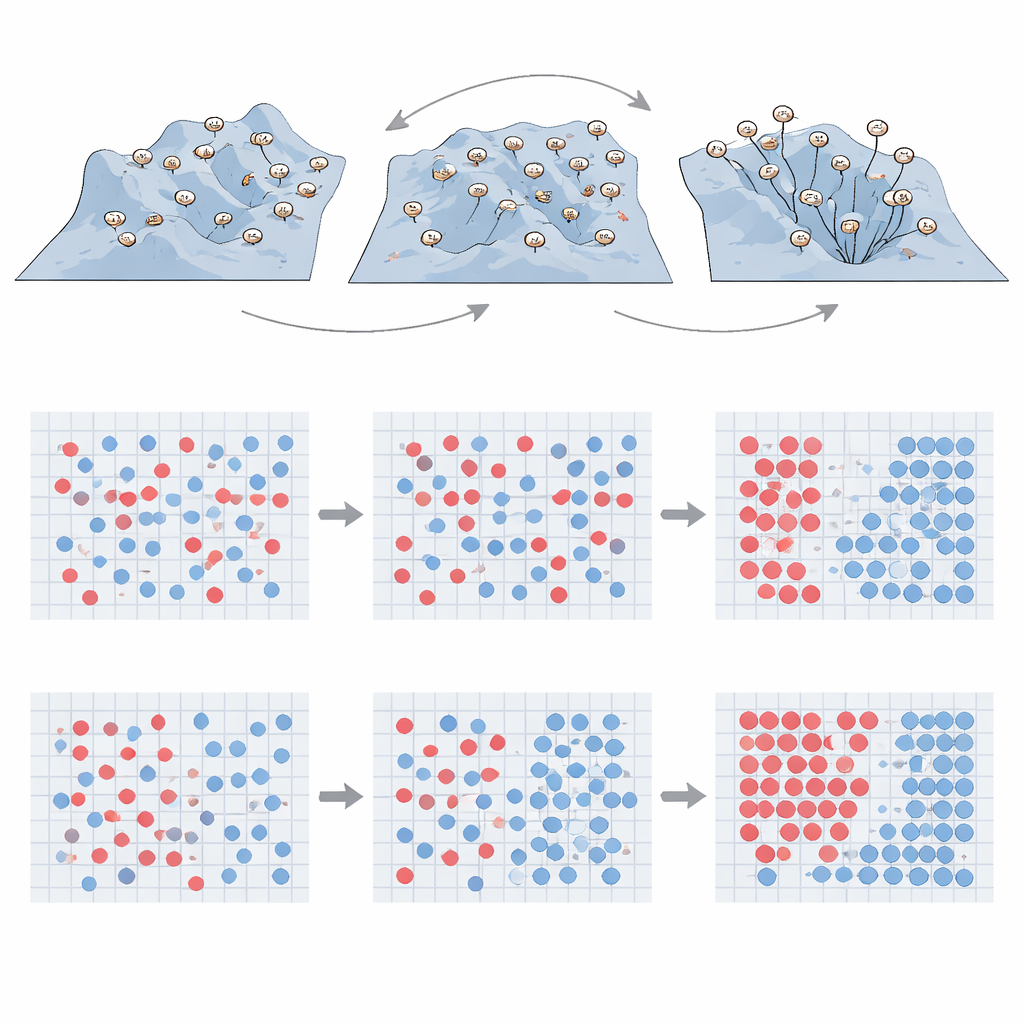

Aby zbadać tę kwestię, badacze porównują agentów poznawczych z klasycznymi cząstkami na dwóch bardzo różnych wyzwaniach. Pierwszym jest optymalizacja funkcji — reprezentacja trudnych problemów przeszukiwania, gdzie celem jest znalezienie najlepszego rozwiązania w pofałdowanym krajobrazie pełnym lokalnych pułapek. Wprowadzają LLM Agent Swarm Optimization (llmASO), w którym sieć agentów LLM proponuje i dzieli się kandydatami rozwiązań w języku naturalnym. Porównują to z dobrze znaną metodą opartą na cząstkach, Particle Swarm Optimization, oraz z pojedynczym LLM działającym samodzielnie. W prostszych krajobrazach pojedyncze agenty LLM szybko znajdują dobre odpowiedzi, dostrzegając wzorce w poprzednich próbach. Jednak w bardziej chropowatych terenach z wieloma lokalnymi dołkami samotni agenci mają tendencję do zbyt wczesnego osiadania na pobliskich „wystarczająco dobrych” rozwiązaniach. Rojom rozmawiających agentów udaje się natomiast niezawodnie odkryć prawdziwie najlepszy region — choć robią to wolniej i są wrażliwe na to, jak informacja przepływa przez ich sieć komunikacyjną.

Jak rozmowa zmienia wzorce społeczne

Drugie badanie nawiązuje do klasycznego modelu segregacji Schellinga, który pokazuje, jak łagodne preferencje wobec podobnych sąsiadów mogą prowadzić do ostrego rozdzielenia grup. Tu agenci poruszają się po siatce i należą do jednego z dwóch typów; są „zadowoleni”, jeśli zbyt niewielu sąsiadów różni się od nich. Dla standardowych cząstek stosujących proste reguły przemieszczania pojawiają się trzy znane fazy w miarę zmiany tolerancji: stan wymieszany z ciągłym przemieszczaniem się, stan segregacji z wyraźnymi klastrami oraz stan zamrożony, w którym ruch w dużej mierze ustaje. Agenci poznawczy przestrzegają tej samej podstawowej reguły satysfakcji, ale decydują, gdzie się przesunąć, po wymianie wiadomości z innymi agentami. Gdy każdy agent może rozmawiać z każdym innym, obraz końcowy wygląda zaskakująco podobnie do przypadku cząstek, co sugeruje, że samo dodanie języka i rozumowania nie obala automatycznie dobrze znanych wzorców segregacji.

Sieci i efekty „ptaki tego samego pióra”

Obraz zmienia się, gdy struktura rozmów zostaje uczyniona bardziej realistyczną. Autorzy przekształcają sieć komunikacyjną tak, by agenci głównie rozmawiali z pobliskimi rówieśnikami, albo tak, by połączenia odzwierciedlały wzorce obserwowane w wielu rzeczywistych systemach społecznych z kilkoma wysoko połączonymi węzłami. Eksperymentują też z homofilią (agenci preferują rozmowy z tymi samego typu) oraz heterofilią (preferują przeciwny typ). Te modyfikacje mają silne konsekwencje: gdy agenci głównie rozmawiają z podobnymi, szybko się koordynują, efektywnie tworzą klastry i mogą nawet uniknąć wiecznie wymieszanej fazy. Gdy rozmowy przebiegają głównie między typami, droga do zadowolenia jest wolniejsza i bardziej złożona, jednak silna segregacja nadal może się pojawić — mimo że każda rozmowa przecina linie grupowe. Ogólnie rzecz biorąc, lokalne rozmowy i tendencje „ptaki tego samego pióra” przekształcają sposób, w jaki segregacja się wyłania, w sposób niedostępny dla nie-myślących cząstek.

Co to oznacza dla przyszłych rojów AI i symulacji społecznych

Autorzy wnioskują, że wyposażenie każdego agenta w zaawansowane zdolności oparte na języku nie czyni grup po prostu uniwersalnie lepszymi. Zamiast tego te zdolności wprowadzają nowe siły — takie jak szybki konsensus i wykorzystywanie wzorców — które mogą być pomocne lub szkodliwe w zależności od sposobu połączenia agentów. W zadaniach optymalizacyjnych źle zaprojektowane sieci mogą skłaniać inteligentne agenty do zbyt szybkiego porozumienia się co do przeciętnych rozwiązań; świadome ograniczanie przepływu informacji pomaga im eksplorować szerzej, kosztem prędkości. W symulacjach społecznych realistyczne wzorce komunikacji i homofilia mogą generować zachowania różniące się od klasycznych modeli i lepiej odzwierciedlać społeczeństwa ludzkie. W miarę jak roje robotów napędzane AI i sieci wirtualnych agentów staną się powszechniejsze, zrozumienie i dostrojenie tych efektów zbiorowych będzie kluczowe dla projektowania bezpiecznych i skutecznych systemów.

Cytowanie: Zomer, N., De Domenico, M. Unraveling the emergence of collective behavior in networks of cognitive agents. npj Artif. Intell. 2, 36 (2026). https://doi.org/10.1038/s44387-026-00091-5

Słowa kluczowe: agenci poznawczy, duże modele językowe, optymalizacja rojem, dynamika segregacji, topologia sieci