Clear Sky Science · pl

DeepKoopFormer: architektura oparta na transformerze z wzmocnieniem Koopmana do prognozowania szeregów czasowych

Dlaczego inteligentniejsze prognozy mają znaczenie

Od prognoz pogody i planowania energetycznego po rynki finansowe — wiele naszych kluczowych decyzji zależy od przewidywania, jak będą się zmieniać zjawiska w czasie. Te „ szeregi czasowe” — ciągi pomiarów, takich jak prędkość wiatru, produkcja energii elektrycznej czy ceny kryptowalut — stają się coraz dłuższe, bardziej zaszumione i bardziej złożone. Nowoczesne narzędzia AI zwane transformerami potrafią przetwarzać takie dane, lecz często działają jak czarne skrzynki i mogą stać się niestabilne, gdy są wykorzystywane do prognozowania na bardzo odległe horyzonty. W artykule przedstawiono DeepKoopFormer — metodę prognostyczną, która zachowuje moc predykcyjną transformerów, dodając równocześnie strukturę matematyczną, by ich zachowanie było bardziej stabilne, interpretowalne i niezawodne w długiej perspektywie.

Nowy sposób na ustabilizowanie potężnych modeli

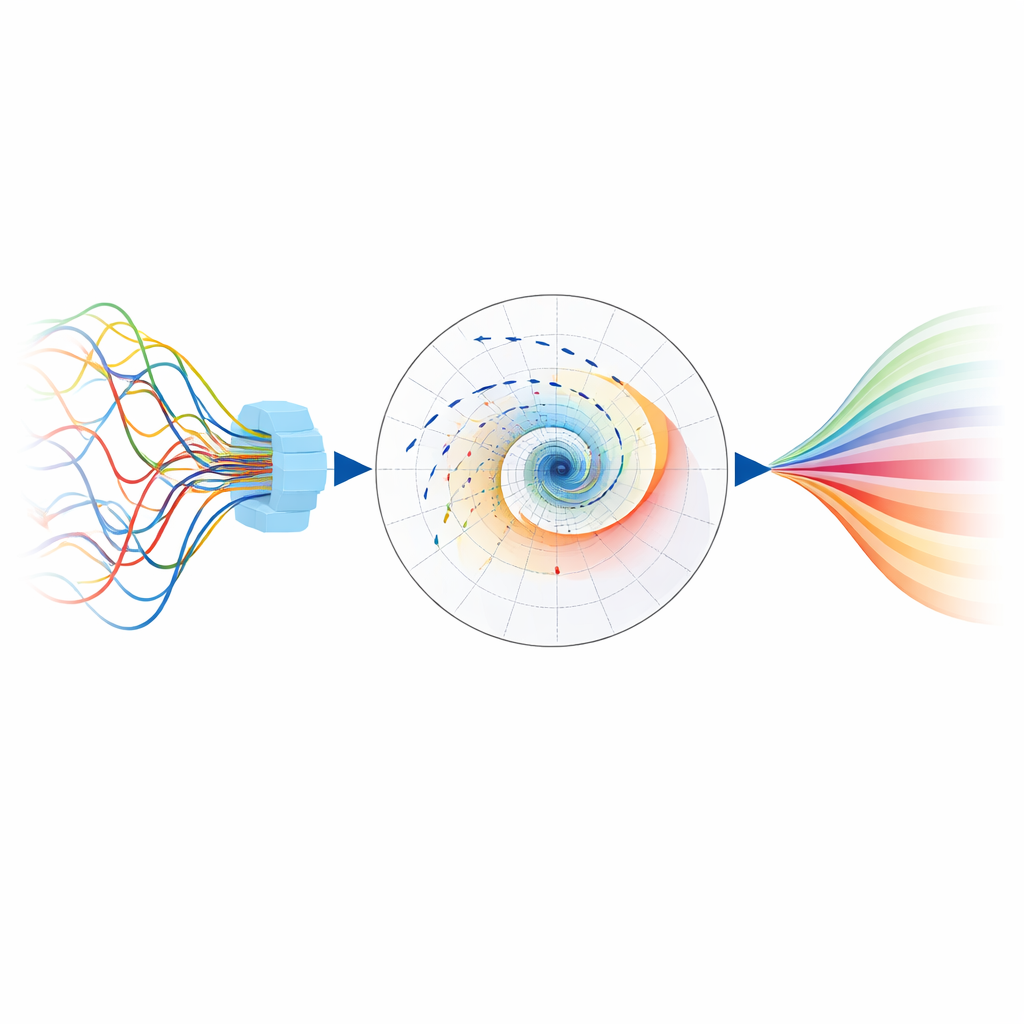

Autorzy wychodzą od powszechnej idei we współczesnym AI: użyć transformera do przetworzenia surowych szeregów czasowych na bogatą reprezentację wewnętrzną. DeepKoopFormer wstawia wówczas starannie zaprojektowaną warstwę pośrednią inspirowaną pojęciem z teorii układów dynamicznych znanym jako operator Koopmana. Zamiast pozwalać modelowi ewoluować w skomplikowany, w pełni nieliniowy sposób, ta warstwa pośrednia aktualizuje stan wewnętrzny przy użyciu prostej transformacji liniowej w ukrytej przestrzeni. Co kluczowe, transformacja ta jest skonstruowana tak, że jej wpływ z czasem stopniowo słabnie zamiast narastać gwałtownie, co matematycznie gwarantuje, że prognozy na długich horyzontach nie eksplodują ani nie zaczynają oscylować w niekontrolowany sposób.

Jak model utrzymuje równowagę

Aby wymusić tę stabilność, DeepKoopFormer ogranicza krok liniowy na kilka sposobów. Transformacja jest rozkładana na trzy elementy: dwie macierze ortogonalne (które zachowują długości i kąty), otaczające macierz diagonalną z czynnikami skali, z których wszystkie są wymuszone, by być mniejsze od jedności. Oznacza to, że stan ukryty jest łagodnie ściskany zamiast wzmacniany przy każdej aktualizacji. Drugim składnikiem jest regularyzacja typu Lyapunova, która dodaje karę podczas trenowania zawsze, gdy energia stanu ukrytego rośnie z jednego kroku na następny. Razem te mechanizmy zapewniają spokojną i dobrze ułożoną dynamikę wewnętrzną, podczas gdy transformer przed i liniowy dekoder po tym kroku pozostają swobodne i ekspresywne. Zdolność modelu do uczenia się złożonych wzorców oraz jego stabilność są kontrolowane przez oddzielne ustawienia, więc użytkownicy mogą dostrajać jedno bez zaburzania drugiego.

Testowanie metody

Naukowcy ocenili DeepKoopFormer zarówno na problemach kontrolowanych, jak i rzeczywistych. Najpierw przetestowali go na klasycznych układach chaotycznych, takich jak atraktor Lorentza, gdzie drobne zmiany prowadzą do bardzo różnych przyszłości, i dodali losowy szum, aby naśladować rzeczywiste pomiary. W różnych wariantach transformera wersje wzbogacone o Koopmana śledziły w dużym przybliżeniu prawdziwe trajektorie, zachowując stabilne zachowanie wewnętrzne w wielu krótkoterminowych prognozach. Autorzy następnie przeszli do wymagających, rzeczywistych zbiorów danych: projekcji klimatycznych i reanaliz dla Niemiec (prędkość wiatru i ciśnienie powierzchniowe), cen kryptowalut oraz produkcji energii elektrycznej z różnych źródeł w Hiszpanii. W tych przypadkach warianty DeepKoopFormer porównywano ze standardową siecią długiej pamięci krótkoterminowej (LSTM) oraz prostszymi liniowymi metodami, przy wielu wyborach długości okna wejściowego, horyzontu prognozy i rozmiaru modelu.

Co ujawniają eksperymenty

W zadaniach klimatycznych, finansowych i energetycznych modele transformerów wzbogacone o elementy Koopmana generalnie osiągają niższe błędy predykcji i bardziej stabilne zachowanie niż baza LSTM, zwłaszcza przy prognozowaniu wielu kroków do przodu lub pracy z danymi o wysokiej wymiarowości. Dla prędkości wiatru i ciśnienia nad Niemcami oraz dla produkcji energii elektrycznej wersje DeepKoopFormer oparte na PatchTST i Informer zazwyczaj wypadają najlepiej, niezawodnie uchwytując zarówno gładkie trendy, jak i szybkie fluktuacje. W niektórych szczególnych przypadkach, gdzie wzorce leżą niemal całkowicie w przestrzeni liniowej, bardzo prosta metoda liniowa nadal osiąga najlepszą dokładność testową, co podkreśla, że żaden pojedynczy model nie jest uniwersalnie optymalny. Niemniej projekty oparte na Koopmanie konsekwentnie pokazują gładsze wzorce błędów wraz ze wzrostem horyzontu prognozy, co wskazuje na lepszą kontrolę niepewności długoterminowej i mniejszą skłonność do przeuczenia się na nietypowe szczegóły w danych treningowych.

Dlaczego to podejście jest obiecujące

Ostatecznie DeepKoopFormer pokazuje, że możliwe jest połączenie elastyczności uczenia głębokiego z gwarancjami klasycznej teorii układów dynamicznych. Wstawiając ustrukturyzowany, stabilny krok liniowy do w przeciwnym razie standardowego pipeline’u transformera, autorzy uzyskują prognozy, które są dokładne, odporne na szum i matematycznie łatwiejsze do analizowania. Dla praktyków polegających na prognozach długoterminowych w naukach klimatycznych, systemach energetycznych czy finansach — gdzie stabilność i interpretowalność są równie ważne jak surowa dokładność — to ramy oferują sposób, by bardziej ufać potężnym modelom neuronowym i rozumieć, jak i dlaczego ich przewidywania zmieniają się w czasie.

Cytowanie: Forootani, A., Khosravi, M. & Barati, M. DeepKoopFormer: a Koopman enhanced transformer based architecture for time series forecasting. npj Artif. Intell. 2, 35 (2026). https://doi.org/10.1038/s44387-026-00085-3

Słowa kluczowe: prognozowanie szeregów czasowych, modele transformer, operator Koopmana, stabilna dynamika, dane klimatyczne i energetyczne