Clear Sky Science · pl

Ramy wariacyjne dla adaptacyjności opartej na residuum w sieciowych solverach równań PDE i w uczeniu operatorów

Sprytniejsza sztuczna inteligencja dla trudnych równań

Wiele współczesnych przełomów naukowych — od modelowania klimatu po projektowanie nowych materiałów — zależy od rozwiązywania złożonych równań opisujących przepływ płynów, rozchodzenie się fal czy ruch frontów chemicznych. Sieci neuronowe stały się ostatnio potężnym narzędziem do pracy z takimi równaniami, lecz często zawodzą, gdy fizyka robi się wymagająca: ostre shocki, drobne struktury i długoterminowe przewidywania mogą powodować błędy. Artykuł wprowadza systematyczny sposób, by sprawić, że te AI‑solvery skupią wysiłek dokładnie tam, gdzie mają najwięcej problemów, dzięki czemu stają się szybsze i dokładniejsze.

Dlaczego sieci neuronowe potrzebują wskazówek

W nauce maszynowej stosowanej do zadań naukowych sieci neuronowe uczone są albo do odtworzenia rozwiązania pojedynczego równania (jak w physics‑informed neural networks, PINN), albo do nauczenia całego odwzorowania od danych wejściowych do rozwiązań (tzw. uczenie operatorów). W obu przypadkach ocenę sieci daje „residuum” — miara, jak bardzo sieć narusza podstawowe równanie w każdym punkcie przestrzeni i czasu. Standardowe uczenie traktuje wszystkie punkty jednakowo, minimalizując średni błąd. To działa dla prostych problemów, ale w przypadku równań ze stromymi gradientami, przemieszczającymi się frontami lub lokalnymi strukturami niska średnia może maskować poważne błędy w kluczowych obszarach. Badacze reagowali ad hoc zasadami umieszczania większej liczby punktów treningowych tam, gdzie residuum jest duże, lecz jak dotąd reguły te pozostawały heurystyczne i słabo uzasadnione.

Ujednolicony przepis na adaptatywną uwagę

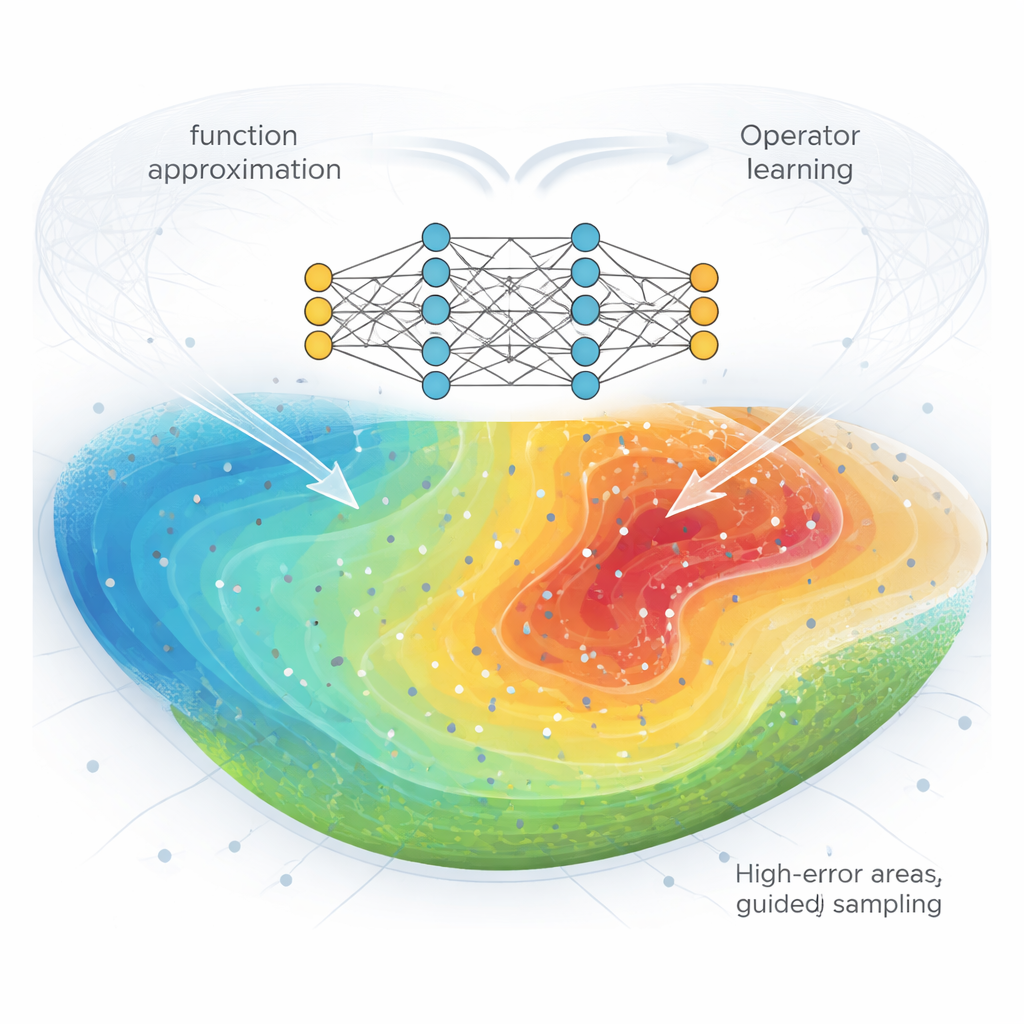

Autorzy opracowują ramy wariacyjne, które zamieniają te heurystyki w zasadniczy przepis. Kluczowa idea polega na traktowaniu próbkowania i ważenia jako wyborów rozkładu prawdopodobieństwa po przestrzeni (i po przykładach treningowych), któremu sieć powinna poświęcać największą uwagę. Wprowadzają rodzinę funkcji „potencjału”, które przekształcają residuum w nowe cele optymalizacji. Różne wybory potencjału odpowiadają różnym priorytetom: potencjał wykładniczy skłania sieć do redukcji największego pojedynczego błędu, podczas gdy potencjał kwadratowy kładzie nacisk na zmniejszenie rozrzutu, czyli wariancji błędu w całym obszarze. Matematycznie, optymalizacja tych przekształconych celów prowadzi naturalnie do częstszego próbkowania w regionach o dużym bieżącym residuum. Otrzymana metoda, nazwana wariacyjną uwagą opartą na residuum (vRBA), obejmuje wiele istniejących schematów adaptacyjnych i daje jasny sposób tworzenia nowych.

Rozszerzenie na uczenie całych map fizycznych

Nowoczesne AI‑solvery coraz częściej dążą do nauczenia nie jednego rozwiązania, lecz całego operatora: odwzorowania od wejść, takich jak warunki początkowe czy wymuszenia, do pełnych pól przestrzenno‑czasowych. To cel architektur sieci operatorowych, jak DeepONet, Fourier Neural Operators (FNO) czy warunkowane czasowo U‑Nety. Tutaj wyzwanie się podwaja: istnieje zmienność między różnymi funkcjami wejściowymi oraz zmienność w przestrzeni i czasie w ramach każdego przykładu. Autorzy adaptują swoje ramy do tego iloczynowego ustawienia, łącząc dwa poziomy adaptacyjności. Po pierwsze, przeważają punkty przestrzenne w ramach każdego przykładu tak, by obszary o wysokim residuum miały większe znaczenie. Po drugie, wykorzystują skumulowane residua do preferencyjnego ponownego próbkowania całych przykładów treningowych, które są najtrudniejsze do nauczenia. Ten hybrydowy schemat można wpiąć bezpośrednio w popularne modele uczenia operatorów bez przebudowy ich architektury.

Ostrość szczegółów, wolniejszy wzrost błędu

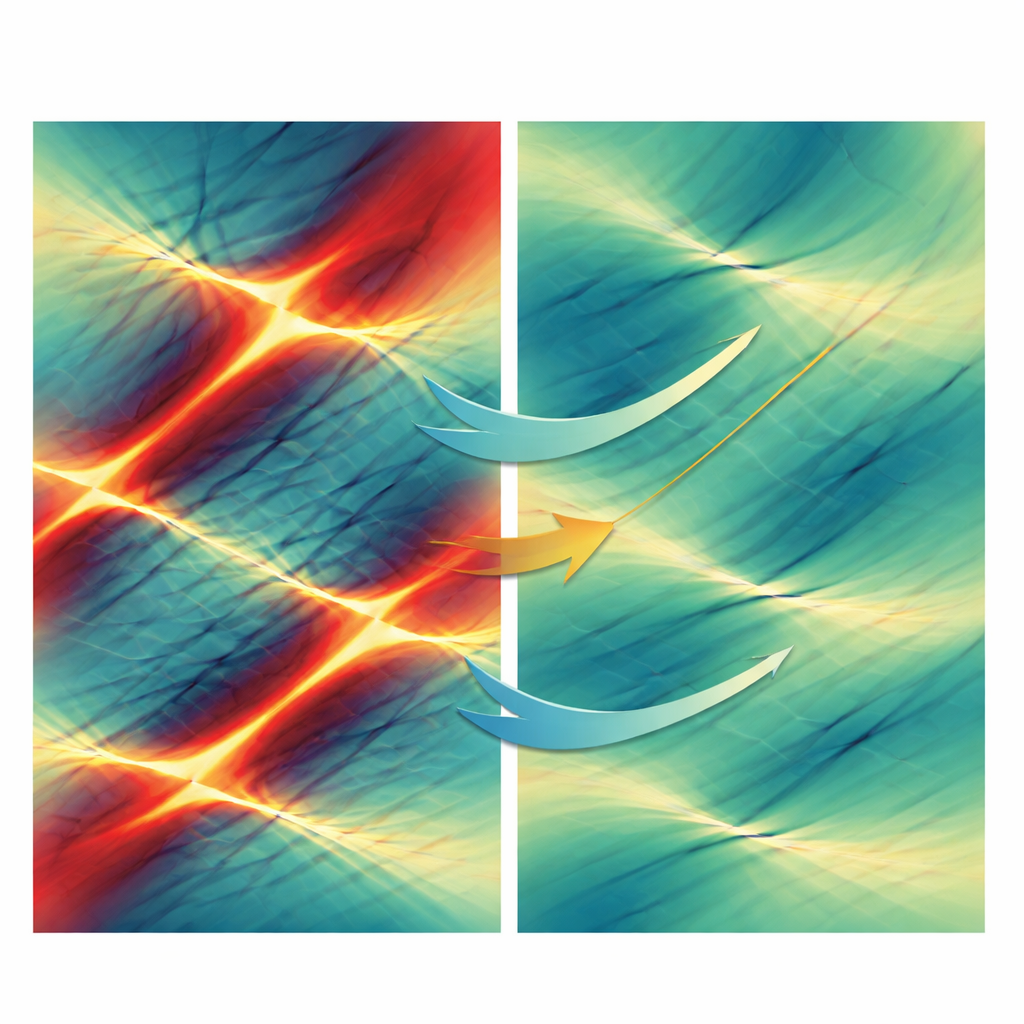

W szerokim zestawie testów podejście vRBA konsekwentnie przewyższa tradycyjne uczenie. Dla PINN zespół testuje klasyczne nieliniowe równania, takie jak Allen–Cahn, Burgers’a i Korteweg–De Vries. Niektóre z tych problemów są znane z tego, że standardowe PINN sobie z nimi nie radzą, z powodu ostrych warstw wewnętrznych czy oddziałujących impulsów falowych. Z vRBA te same sieci zbieżają szybciej i osiągają istotnie niższy błąd, a w trudnych przypadkach, gdzie baza praktycznie zawodzi, metody adaptacyjne odzyskują dokładne rozwiązania. W uczeniu operatorów stosują vRBA do wzrostu pęcherzyków w cieczach, przepływów w rurze z falą uderzeniową o wysokim ciśnieniu, dwuwymiarowej turbulencji i rozchodzenia się fal. Główna korzyść tutaj to nie tylko lepszy końcowy błąd, lecz znacznie wolniejsze narastanie błędów w czasie, co ma kluczowe znaczenie, gdy wyjście modelu jest wielokrotnie podawane z powrotem jako jego własne wejście.

Oczyszczanie szumu w sygnale uczenia

Autorzy przypisują te zyski dwóm głównym efektom. Po pierwsze, zmieniając sposób próbkowania lub ważenia punktów treningowych, vRBA redukuje szum statystyczny w estymowanym koszcie: losowe partie punktów dają bardziej wiarygodny obraz tego, jak dobrze sieć radzi sobie globalnie. To bezpośrednio zmniejsza błąd dyskretyzacji, czyli różnicę między ciągłym idealnym celem a skończonym zbiorem punktów używanych w praktyce. Po drugie, metoda poprawia stosunek sygnału do szumu w gradientach, które napędzają uczenie, tak że różne regiony dziedziny „zgadzają się” bardziej co do kierunku, w którym powinny przesunąć się parametry. W rezultacie sieci wcześniej wychodzą z powolnych, niezdecydowanych faz treningu i wchodzą w reżim, gdzie błąd spada szybko. Ramy te również wyjaśniają, kiedy agresywne strategie — silnie karzące największe residua — mogą pomagać, a kiedy mogą destabilizować proces uczenia.

Co to oznacza dla przyszłej naukowej AI

Dla osób niebędących ekspertami przekaz jest taki, że mądrzejsze zwracanie uwagi na miejsca, gdzie solver AI się myli, może uczynić go znacznie bardziej godnym zaufania narzędziem dla nauki i inżynierii. Zamiast polegać na metodzie prób i błędów, praca ta oferuje matematyczny plan kierowania sieci neuronowych ku najbardziej informatywnym częściom zadania, czy to frontom szokowym, drobnym oscylacjom, czy zachowaniom długookresowym. W miarę jak modele naukowe rosną i są używane w kontekstach krytycznych dla bezpieczeństwa, takie zasady redukcji błędu i stabilizacji uczenia będą niezbędne, by przekształcić potężne sieci neuronowe w niezawodne narzędzia naukowe.

Cytowanie: Toscano, J.D., Chen, D.T., Ooomen, V. et al. A variational framework for residual-based adaptivity in neural PDE solvers and operator learning. npj Artif. Intell. 2, 32 (2026). https://doi.org/10.1038/s44387-026-00084-4

Słowa kluczowe: sieci neuronowe uwzględniające fizykę, uczenie operatorów, adaptacyjne próbkowanie, nauka maszynowa w naukach ścisłych, równania różniczkowe cząstkowe