Clear Sky Science · pl

Ludzkie i algorytmiczne skupienie wzroku w zadaniach związanych z prowadzeniem

Dlaczego ma to znaczenie w codziennej jeździe

W miarę jak samochody stają się coraz bardziej zautomatyzowane, pozostaje kluczowe pytanie: czy systemy autonomiczne rzeczywiście „widzą” drogę tak jak ludzie? Badanie to porównuje, jak kierowcy i sztuczna inteligencja koncentrują uwagę wzrokową w ruchu drogowym, i pokazuje, że wprowadzenie fragmentu uwagi przypominającej ludzką może uczynić algorytmy jazdy zarówno mądrzejszymi, jak i bezpieczniejszymi — bez potrzeby korzystania z gigantycznych, prądożernych modeli AI.

Jak poruszają się ludzkie oczy na drodze

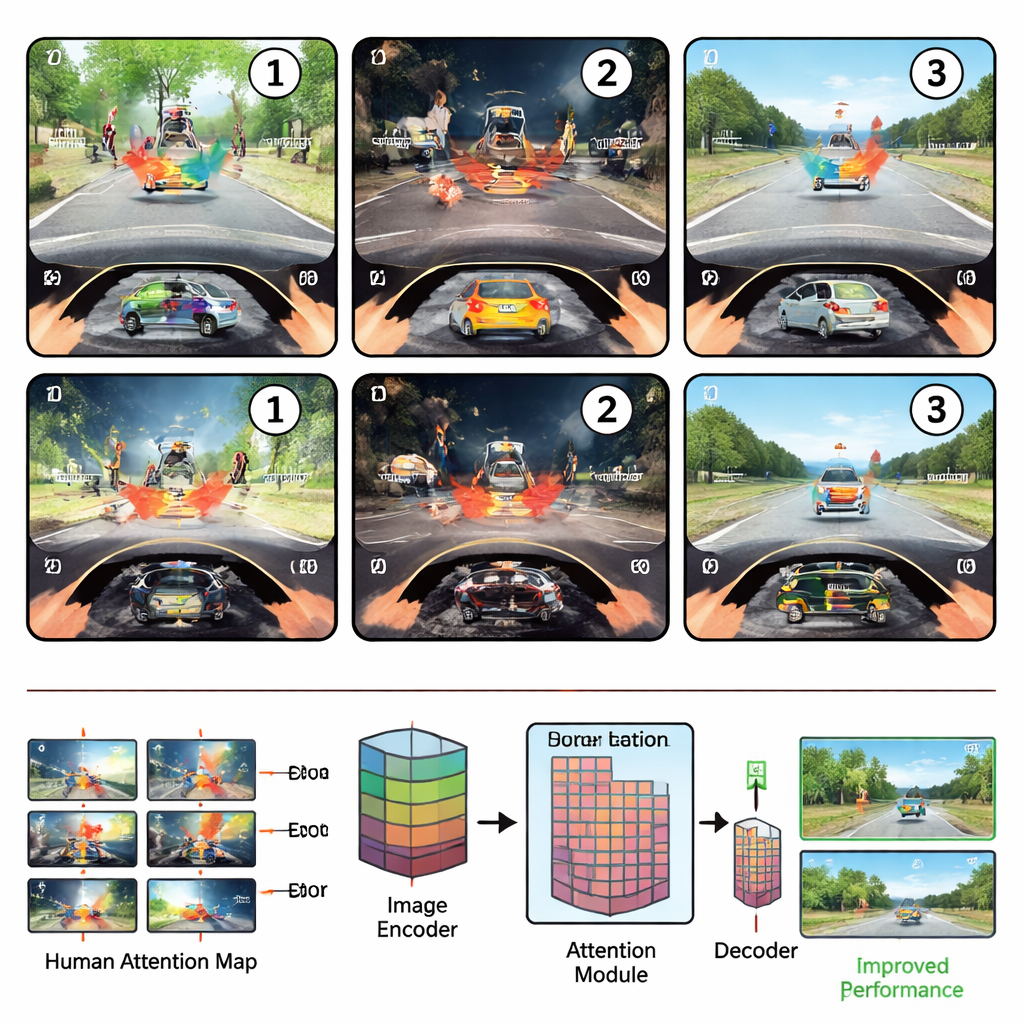

Naukowcy najpierw umieścili początkujących i doświadczonych kierowców w symulowanym środowisku jazdy i śledzili ich ruchy oczu podczas wykonywania trzech powszechnych zadań bezpieczeństwa: wykrywania zagrożeń, oceniania, czy bezpiecznie jest skręcić lub zmienić pas, oraz wykrywania nietypowych, niepasujących obiektów. Stwierdzili, że uwaga kierowców podąża za wiarygodnym, trzyetapowym rytmem. W fazie skanowania, zaraz po pojawieniu się sceny, oczy szeroko przemierzają pole widzenia, kierowane głównie przez położenie obiektów. W fazie badania uwaga skupia się na jednym, najbardziej informacyjnym obszarze — na przykład przechodniu na przejściu lub stojącym na drodze samochodzie — i analizuje jego szczegóły oraz znaczenie. Wreszcie w fazie ponownej oceny kierowcy porównują ten kluczowy obiekt z innymi, przesuwając wzrok tam i z powrotem, by potwierdzić swoją decyzję.

Gdzie patrzą maszyny a gdzie ludzie

Zespół następnie zbudował oparte na uwadze głębokie modele uczenia dla scen drogowych i porównał ich wewnętrzne „mapy uwagi” z mapami wynikającymi z ruchów oczu ludzi. Trenowanie modelu na ogólnym wykrywaniu obiektów uczyniło jego uwagę nieco bardziej ludzką, ale dostrajanie go do konkretnych zadań jazdy często odsuwało go od ludzkich wzorców, zwłaszcza w bogatej, znaczeniowej fazie badania. Ogólnie rzecz biorąc, korelacje między ludzką a algorytmiczną uwagą pozostały umiarkowane, co sugeruje, że współczesne AI do jazdy ma trudności z odkryciem zasad organizujących to, gdzie ludzie patrzą i dlaczego.

Nauczanie samochodów, by pożyczały ludzką uwagę

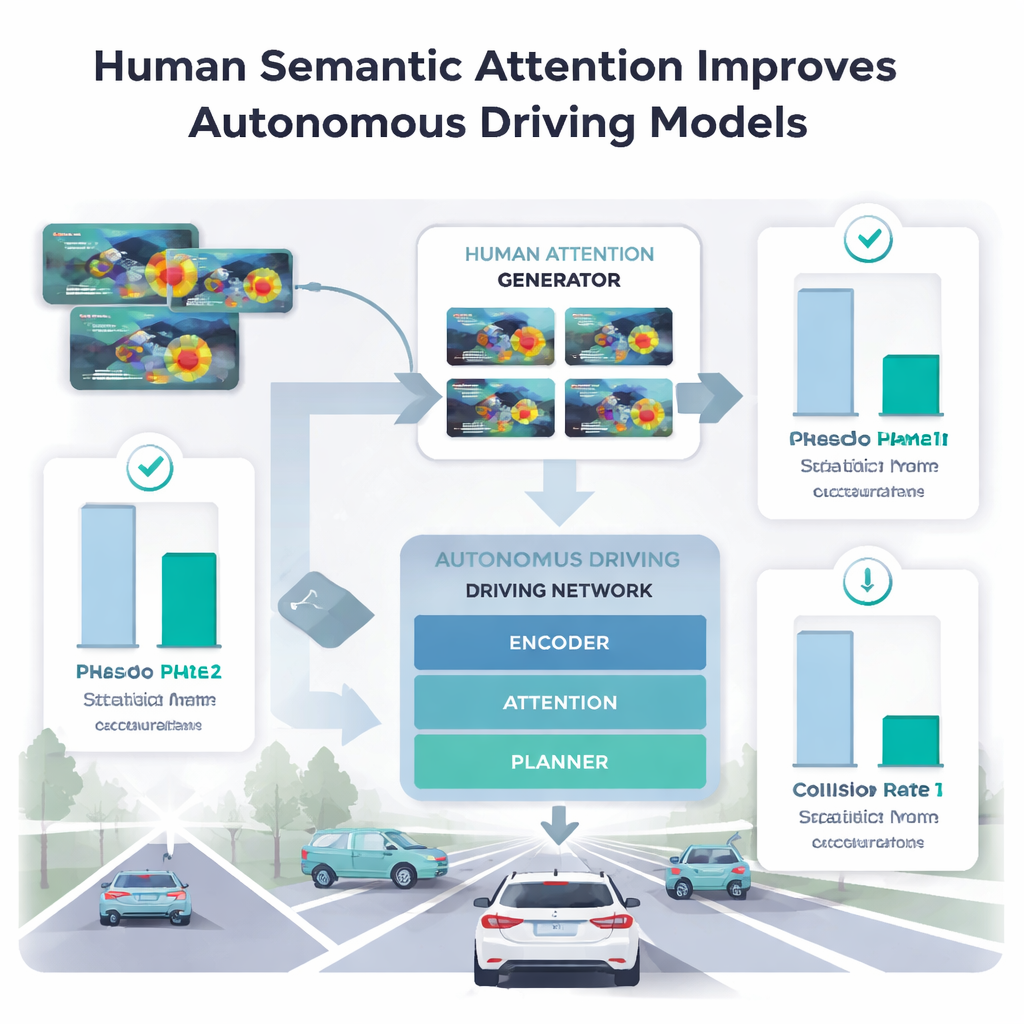

Aby sprawdzić, które elementy ludzkiej uwagi rzeczywiście pomagają maszynom, autorzy wprowadzili różne fazy ludzkiego spojrzenia do swojego modelu jazdy. Bezpośrednie zbieranie danych śledzenia wzroku dla milionów obrazów jest niepraktyczne, więc wytrenowali oddzielny „generator uwagi ludzkiej” na małej próbce zaledwie pięciu kierowców. Ten generator nauczył się przewidywać ludzkopodobne mapy cieplne uwagi dla nowych scen. Gdy główny model jazdy używał jedynie przestrzennej, wczesnej fazy skanowania, jego wyniki w wykrywaniu anomalii i planowaniu trajektorii często pogarszały się lub prowadziły do pozornie bezpieczniejszych trajektorii bardziej narażonych na kolizję. Natomiast gdy korzystał z fazy badania — w której ludzie koncentrują się na jednym, najbardziej znaczącym obszarze — dokładność poprawiała się bardziej niż przy wcześniejszych metodach wykorzystujących pełnej długości spojrzenie, a wskaźniki kolizji w zadaniach planowania spadały.

Czego wciąż brakuje dużym modelom wizja‑język

Naukowcy przetestowali także duże modele wizja–język, które odpowiadają na pytania dotyczące jazdy lub generują gęste opisy scen 3D ulic. W zadaniu pytanie‑odpowiedź, które kładzie nacisk na wysokopoziomowe rozumowanie, dodanie ludzkiej uwagi ledwie pomagało, a czasem szkodziło, co sugeruje, że takie modele już uchwyciły dużą część potrzebnej abstrakcyjnej wiedzy. Jednak w wymagającym zadaniu opisania (captioning), które wymaga przypisania precyzyjnych słów do konkretnych obiektów, ludzka uwaga z fazy badania nadal dawała znaczące korzyści. To sugeruje, że duże modele mogą dobrze rozumować ogólnie, a mimo to potykać się, gdy trzeba ściśle powiązać słowa z dokładnymi miejscami w zatłoczonej scenie wizualnej — lukę, którą może pomóc wypełnić ludzki wzrok.

Co to oznacza dla bezpieczniejszych autonomicznych samochodów

Mówiąc wprost, badanie twierdzi, że to, co naprawdę odróżnia ludzi od dzisiejszych systemów do jazdy, to nie tylko gdzie patrzymy, lecz jak natychmiast oceniamy co ma znaczenie w scenie. Ten zwarty impuls semantycznej uwagi — kiedy skrupulatnie analizujemy jeden obszar decydujący o tym, czy sytuacja jest bezpieczna czy niebezpieczna — okazuje się być dokładnie sygnałem, którego wielu algorytmom brakuje. Ucząc się naśladować tę fazę na podstawie niewielkiej ilości danych ze śledzenia wzroku, systemy jazdy mogą zdobyć ludzkopodobne rozumienie scen drogowych bez polegania wyłącznie na coraz większych, droższych modelach AI. Ten „skrót semantyczny” może być efektywnym sposobem uczynienia przyszłych samochodów zautomatyzowanych bardziej niezawodnymi w chaotycznych, nieprzewidywalnych warunkach ruchu drogowego.

Cytowanie: Zheng, C., Li, P., Jin, B. et al. Human and algorithmic visual attention in driving tasks. npj Artif. Intell. 2, 23 (2026). https://doi.org/10.1038/s44387-026-00079-1

Słowa kluczowe: autonomiczna jazda, uwaga wzrokowa, śledzenie wzroku u człowieka, modele wizja-język, bezpieczeństwo drogowe