Clear Sky Science · pl

Agent AI w opiece zdrowotnej: zastosowania, oceny i przyszłe kierunki

Dlaczego inteligentne cyfrowe pomocniki w medycynie mają znaczenie

Szpitale toną w danych, lekarze są przeciążeni, a pacjenci oczekują jaśniejszych odpowiedzi dotyczących swojego zdrowia. Nowy rodzaj sztucznej inteligencji, oparty na dużych modelach językowych potrafiących czytać i pisać jak ludzie, przekształca się teraz w „agentów AI”, którzy potrafią rozumować w wieloetapowych zadaniach. Ten artykuł przeglądowy wyjaśnia, jak ci cyfrowi pomocnicy zaczynają wspierać diagnozę, decyzje terapeutyczne, dokumentację, rozmowy z pacjentami, a nawet kształcenie medyczne — jednocześnie wskazując, co należy zrobić, aby zachować ich dokładność, uczciwość i bezpieczeństwo.

Od eksperymentów myślowych do praktycznych cyfrowych współpracowników

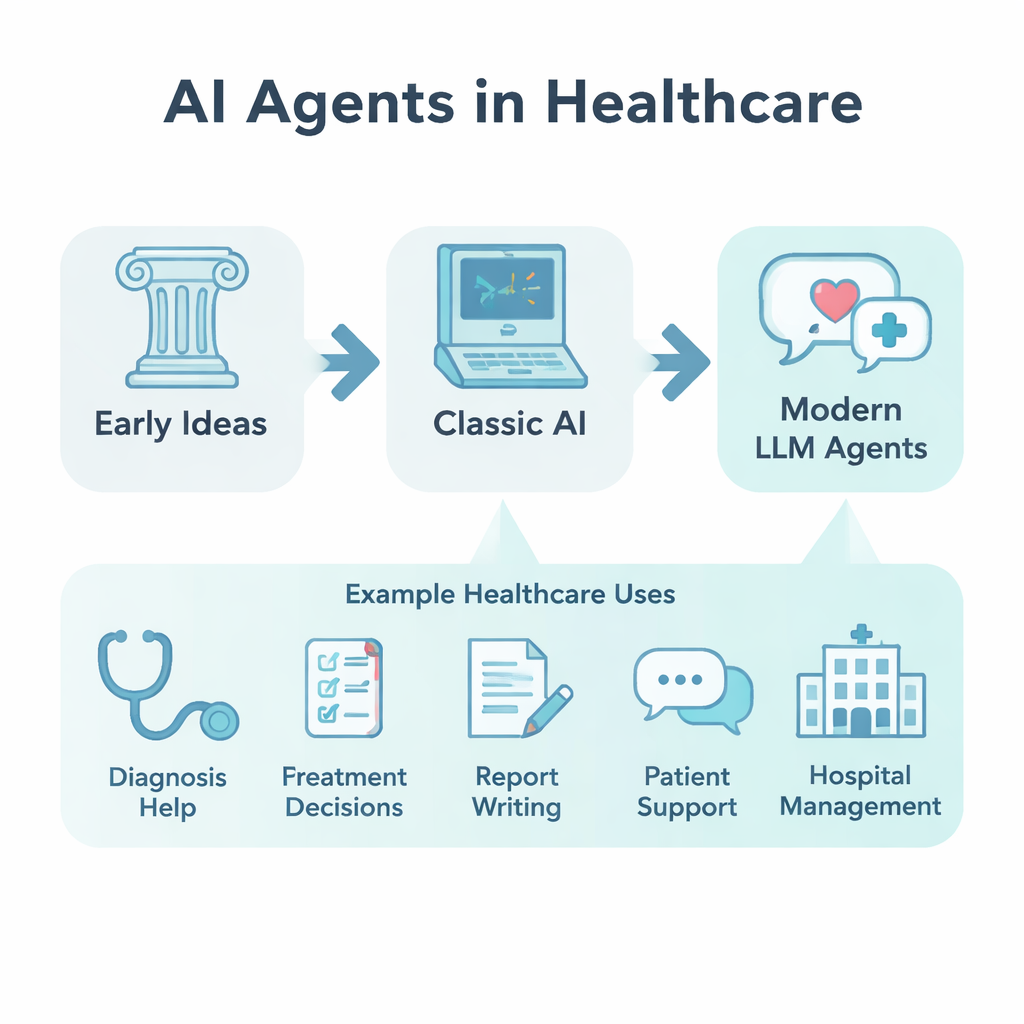

Pojęcie „agenta”, który może działać z celami i intencjami, sięga starożytnej filozofii. Współczesne wersje pojawiły się wraz z wczesną sztuczną inteligencją, systemami eksperckimi, a później uczeniem maszynowym i głębokim uczeniem, które pozwoliły komputerom wykrywać wzorce w danych. Przełom dużych modeli językowych (LLM) po 2022 roku posunął to dalej: zamiast jedynie odpowiadać na pytania, modele te potrafią teraz planować, pamiętać wcześniejsze kroki i wywoływać inne narzędzia programowe. W opiece zdrowotnej oznacza to, że agent AI może czytać dokumentację medyczną, sprawdzać wytyczne, szkicować notatki i sugerować kolejne działania, zachowując się mniej jak wyszukiwarka, a bardziej jak młodszy cyfrowy współpracownik.

Czym ci agenci różnią się od zwykłej sztucznej inteligencji

Zgodnie z definicją przyjętą w artykule, agent AI w opiece zdrowotnej to coś więcej niż pojedynczy model. Na jego rdzeniu znajduje się LLM, otoczony czterema kluczowymi zdolnościami: planowaniem, pamięcią, użyciem narzędzi i autorefleksją. Planowanie pozwala rozbić złożone zadanie medyczne na mniejsze kroki. Pamięć umożliwia śledzenie historii pacjenta lub długiego procesu decyzyjnego. Użycie narzędzi oznacza, że może na przykład pobierać wyniki badań z elektronicznej dokumentacji lub przeszukiwać medyczne bazy danych. Moduły autorefleksji sprawdzają i korygują własne odpowiedzi. W połączeniu z silnymi umiejętnościami językowymi i rosnącą zdolnością do wnioskowania logicznego te funkcje czynią agentów wystarczająco elastycznymi, by przełączać się między zadaniami i specjalizacjami medycznymi.

Jak agenci AI są testowani w rzeczywistej pracy medycznej

Naukowcy budują i symulują teraz wiele rodzajów agentów, aby zobaczyć, gdzie przynoszą najwięcej korzyści. Niektóre zaprojektowano, by wspierać diagnozę, odgrywając rozmowy między wirtualnymi lekarzami i pacjentami lub zestawiając debatę kilku specjalistycznych agentów nad trudnym przypadkiem. Inne koncentrują się na decyzjach terapeutycznych, łącząc wkład wirtualnych lekarzy ogólnych, specjalistów i farmaceutów w celu wypracowania wspólnego planu. Istnieją agenci, którzy sporządzają raporty radiologiczne na podstawie zdjęć RTG klatki piersiowej lub tłumaczą techniczne ustalenia na prosty, przyjazny pacjentowi język. Systemy w stylu czatbotów są pilotażowo stosowane w wsparciu zdrowia psychicznego, coachingu utraty wagi i przypomnieniach o lekach. Dodatkowe agenty pomagają zarządzać receptami, wykrywać działania niepożądane leków, usprawniać dokumentację elektroniczną lub szkolić studentów medycyny za pomocą realistycznych symulowanych pacjentów.

Ocena, czy te systemy są gotowe dla pacjentów

Ponieważ błędy w medycynie mogą zagrażać życiu, artykuł podkreśla, że agentów AI należy oceniać nie tylko pod kątem sprytu. Autorzy dzielą testy na dwie warstwy. Podstawowe sprawdzenia pytają: czy odpowiedzi są faktograficznie poprawne? Czy sformułowania odpowiadają raportom ekspertów? Czy agent niezawodnie kończy zadanie, w tym wywołuje właściwe narzędzia? Kontrole skupione na rozwoju oceniają szybkość, jasność i to, jak dobrze system komunikuje się z ludźmi, włączając szacunek, empatię i uczciwość wobec różnych grup pacjentów. Badania porównują agentów zarówno z innymi czołowymi modelami językowymi, jak i z lekarzami, a organy regulacyjne w Europie, Wielkiej Brytanii, Chinach i innych miejscach zaczynają projektować oficjalne programy „piaskownicy” do testowania bezpieczeństwa, równości i korzyści klinicznych przed wdrożeniem.

Następne kroki: roboty, zasady i zaufanie ludzi

Spoglądając w przyszłość, artykuł wskazuje siedem priorytetów: łączenie agentów z fizycznymi robotami mogącymi działać w świecie rzeczywistym; łączenie modeli ogólnego przeznaczenia z mniejszymi modelami eksperckimi; rozszerzenie oceny o koszty, zdarzenia związane z bezpieczeństwem i satysfakcję pacjentów; budowanie silniejszych zabezpieczeń i nadzoru; osadzanie ochrony etycznej i prywatności; projektowanie z myślą o zaufaniu użytkowników i ciągłej informacji zwrotnej; oraz pomaganie personelowi medycznemu w adaptacji kariery do pracy obok AI zamiast zastępowania jej przez nią. Autorzy konkludują, że agenci AI mogą stać się potężnymi partnerami w opiece zdrowotnej, ale tylko wtedy, gdy będą rozwijani, testowani i regulowani z tą samą starannością, jaką społeczeństwo wymaga od każdej nowej technologii medycznej.

Cytowanie: Zhao, L., Liu, S., Xin, T. et al. AI agent in healthcare: applications, evaluations, and future directions. npj Artif. Intell. 2, 31 (2026). https://doi.org/10.1038/s44387-026-00076-4

Słowa kluczowe: agenci AI w opiece zdrowotnej, duże modele językowe, wspomaganie decyzji klinicznych, czatboty medyczne, zdrowie cyfrowe