Clear Sky Science · pl

W ich własnych słowach: studia przypadków języka na smartfonach nastolatków poprzedzającego hospitalizacje związane z samobójstwem

Dlaczego SMS‑y Twojego nastolatka mogą mieć większe znaczenie, niż myślisz

W miarę jak smartfony stają się nieodłącznymi towarzyszami, dyskretnie rejestrują codzienne słowa, nastroje i zmartwienia młodych ludzi. W tym badaniu postawiono pilne pytanie: czy język, który nastolatkowie wpisują na swoich telefonach w tygodniach i dniach przed kryzysem zdrowia psychicznego, może ujawnić, kiedy znajdują się w poważnym niebezpieczeństwie podjęcia próby samobójczej? Analizując rzeczywiste wzorce pisania wiadomości u osób o wysokim ryzyku, badacze sprawdzają, czy narzędzia sztucznej inteligencji mogą pomóc klinicystom wykrywać krótkoterminowe sygnały ostrzegawcze — i gdzie te narzędzia wciąż zawodzą.

Śledząc pięcioro nastolatków przez niebezpieczny miesiąc

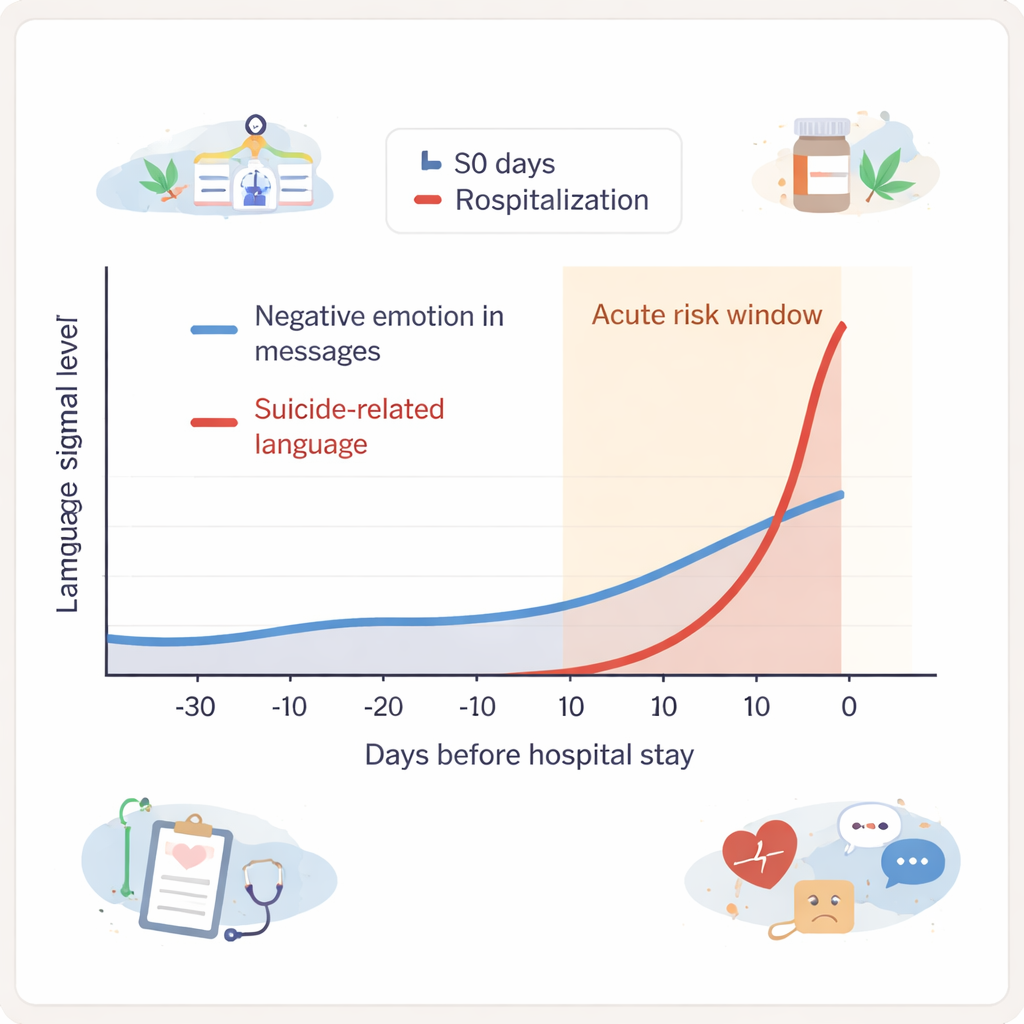

Badanie skupiło się na pięciorgu nastolatków, którzy już byli uznani za osoby o wysokim ryzyku samobójstwa i u których później doszło do hospitalizacji związanej z samobójstwem. Przez około sześć miesięcy aplikacja działająca w tle na ich własnych telefonach rejestrowała wszystko, co wpisywali na klawiaturze — wiadomości, wyszukiwania, notatki — pomijając jednocześnie treści wysyłane do nich przez innych. Zebrano średnio ponad 21 000 wychodzących wpisów tekstowych na osobę, które zostały mocno zanonimizowane w celu ochrony prywatności. Badacze następnie przyjrzeli się 30 dniom przed każdą hospitalizacją, dzieląc ten okres na 20‑dniową fazę „bazową” i 10‑dniową fazę „ostrego ryzyka” tuż przed pobytem w szpitalu.

Co słowa ujawniły przed kryzysem

Wykorzystując przetwarzanie języka naturalnego (NLP), zespół poszukiwał kilku typów sygnałów w wpisywanym tekście. Jeden zestaw narzędzi wyszukiwał języka związanego z samobójstwem, stosując słownik skoncentrowany na młodzieży, który rozpoznawał nie tylko standardowe wyrażenia, ale też slang i emotikony. Inne narzędzie, oparte na nowoczesnych modelach AI, szacowało, czy wiadomości wyrażają negatywne emocje. Trzecia metoda grupowała wpisy w szerokie tematy, takie jak szkoła, leczenie, sen, używki czy śmierć. U czterech z pięciorga nastolatków zarówno język związany z samobójstwem, jak i negatywne emocje zwiększyły się w ciągu 10 dni przed hospitalizacją, w porównaniu ze średnim wzorcem każdego nastolatka w trakcie badania. Język związany z samobójstwem często gwałtownie wzrastał w ostatnich pięciu dniach, podczas gdy negatywne emocje rosły bardziej stopniowo w ciągu ostatnich 10 dni.

Sygnały ryzyka — i sygnały cierpienia

Wzorce były obiecujące, ale skomplikowane. Te same oznaki ostrzegawcze — język związany z samobójstwem i ponury ton — pojawiały się także w innych okresach poza bezpośrednim oknem kryzysu. To sugeruje, że sygnały te mogą wskazywać na okresy poważnego cierpienia, ale niekoniecznie zawsze na moment, w którym próba samobójcza jest bezpośrednio nieuchronna. Gdy klinicyści bezpośrednio przeglądali historię wiadomości, zauważyli, że skoki w używaniu języka związanego z samobójstwem często pokrywały się z myślami samobójczymi, rzeczywistymi próbami lub pilnym poszukiwaniem pomocy. Modele tematyczne wychwytywały użyteczne wątki, takie jak używanie substancji czy rozmowy o leczeniu, które czasami zbiegały się z momentami ryzyka.

Czego komputery nie widzą, co dostrzegają ludzie

Jednak narzędzia AI często przeoczały kwestie, które klinicyści uznawali za kluczowe wyzwalacze, takie jak kłótnie z przyjaciółmi lub rodziną, nękanie, konflikty romantyczne czy uczucia odrzucenia. Te sytuacje rozwijały się przez wiele krótkich wiadomości, a modele w przeważającej mierze traktowały każdy wpis osobno, bez zrozumienia szerszej historii. W rezultacie konflikty interpersonalne, zmiany w odczuwaniu kluczowych wydarzeń czy subtelne przejścia od żartów o samobójstwie do wyrażania autentycznej rozpaczy często umykały algorytmom. Badacze argumentują, że przyszłe systemy muszą robić więcej niż odczytywać pojedyncze wiadomości: powinny łączyć rozmowy w czasie i w idealnym przypadku łączyć tekst z innymi pasywnymi danymi, takimi jak wzorce snu czy ruchu, aby poprawić dokładność.

Patrząc w przyszłość: obietnica z ważnymi ograniczeniami

To badanie pokazuje, że język z telefonu może dostarczać bogatego, niskoobciążającego okna w to, co nastolatkowie przeżywają między wizytami w klinice. Metody automatyczne już radzą sobie całkiem dobrze z wykrywaniem oczywistych czerwonych flag — bezpośrednich wypowiedzi o samobójstwie i silnie negatywnych emocji — szczególnie w dniach bezpośrednio poprzedzających kryzys. Jednak znacznie gorzej potrafią uchwycić osobisty, społeczny i sytuacyjny kontekst, którym posługują się ludzcy klinicyści przy ocenie ryzyka. Dla rodzin i profesjonalistów zdrowotnych przekaz jest dwojaki: dane językowe z cyfrowych źródeł mogłyby pewnego dnia pomóc w dostarczaniu wcześniejszego, odpowiedniego w czasie wsparcia dla młodych osób znajdujących się w niebezpieczeństwie, ale muszą być rozwijane z wielką ostrożnością, z silną ochroną prywatności i we współpracy z klinicystami, a nie jako ich zastępstwo.

Cytowanie: Treves, I.N., Bloom, P.A., Salem, S. et al. In their own words: case studies of adolescent smartphone language preceding suicide-related hospitalizations. NPP—Digit Psychiatry Neurosci 4, 5 (2026). https://doi.org/10.1038/s44277-026-00057-0

Słowa kluczowe: ryzyko samobójstwa u nastolatków, język na smartfonie, fenotypowanie cyfrowe, przetwarzanie języka naturalnego, monitorowanie zdrowia psychicznego