Clear Sky Science · pl

Wpływ efektywności rozwiązania i nacechowania instrukcji na strategie dodawania i odejmowania rozwiązań u ludzi, GPT-4 i GPT-4o

Dlaczego robienie mniej jest zaskakująco trudne

Kiedy próbujemy naprawić coś w codziennym życiu — przeredagować e‑mail, przeorganizować pokój, przeprojektować politykę — zwykle myślimy o tym, co dodać, a nie co usunąć. Ta cicha tendencja do dokładania zamiast redukcji może zatykać nasze życie bałaganem, przeładowanym oprogramowaniem i nadmiernie skomplikowanymi zasadami. Artykuł bada, jak silny jest naprawdę nawyk „więcej = lepiej” i czy nowe sztuczne inteligencje, takie jak GPT-4 i GPT-4o, podzielają, łagodzą czy wręcz wzmacniają to ludzkie uprzedzenie.

Jak dodawanie przeważa nad odejmowaniem w naszych umysłach

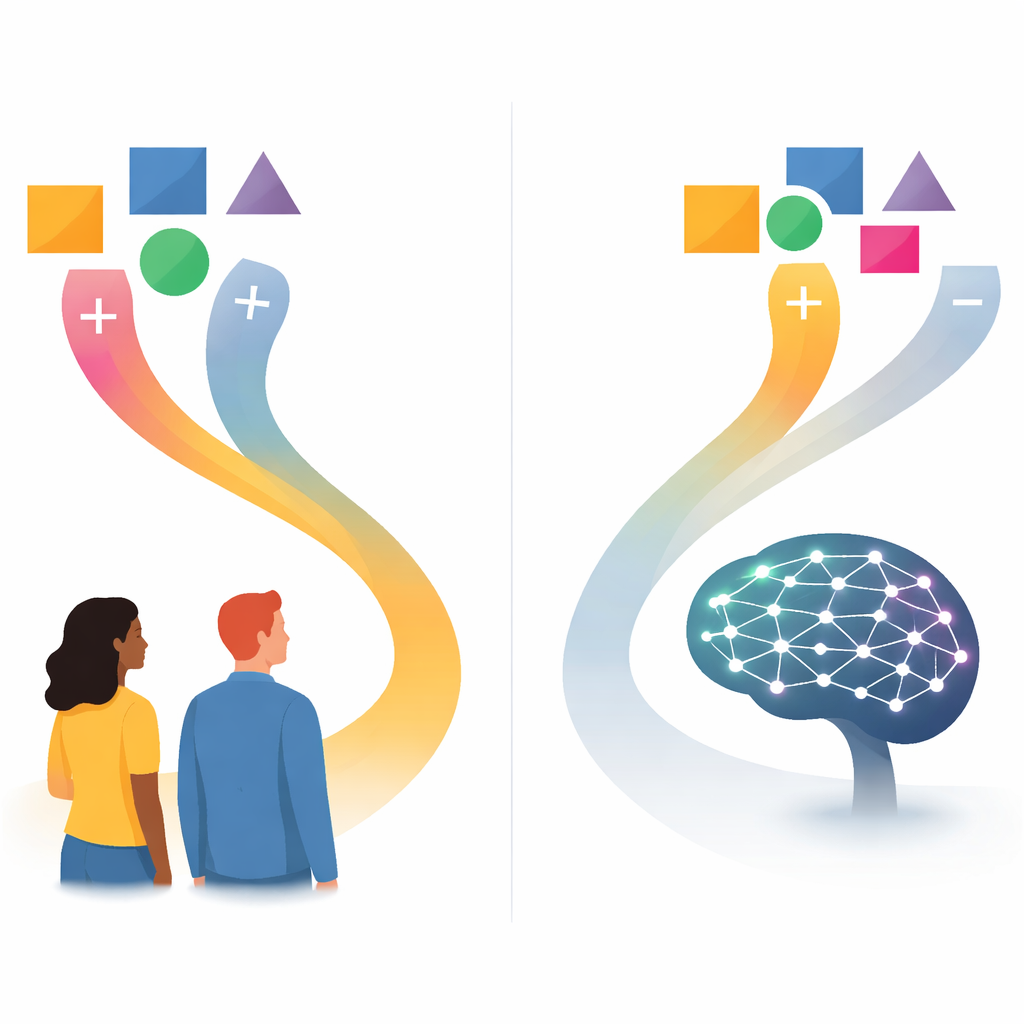

Psychologowie wykazali, że ludzie często pomijają rozwiązania polegające na usunięciu elementów, nawet gdy odejmowanie byłoby prostsze lub skuteczniejsze. Dodawanie wydaje się naturalne i jest wzmacniane przez kulturę oraz język: słowa takie jak „więcej” i „wyżej” łączone są z poprawą i sukcesem, podczas gdy „mniej” może brzmieć jak strata lub porażka. To uprzedzenie ujawnia się w wielu obszarach — od opieki zdrowotnej, która woli dodatkowe terapie zamiast odrzucenia szkodliwych nawyków, po polityki środowiskowe skupiające się na recyklingu zamiast po prostu zmniejszenia produkcji odpadów. Obecne badanie pyta, czy skłonność ludzi do dodawania pojawia się także w potężnych modelach językowych trenowanych na ogromnych zbiorach tekstów.

Testowanie ludzi i AI na prostych zagadkach

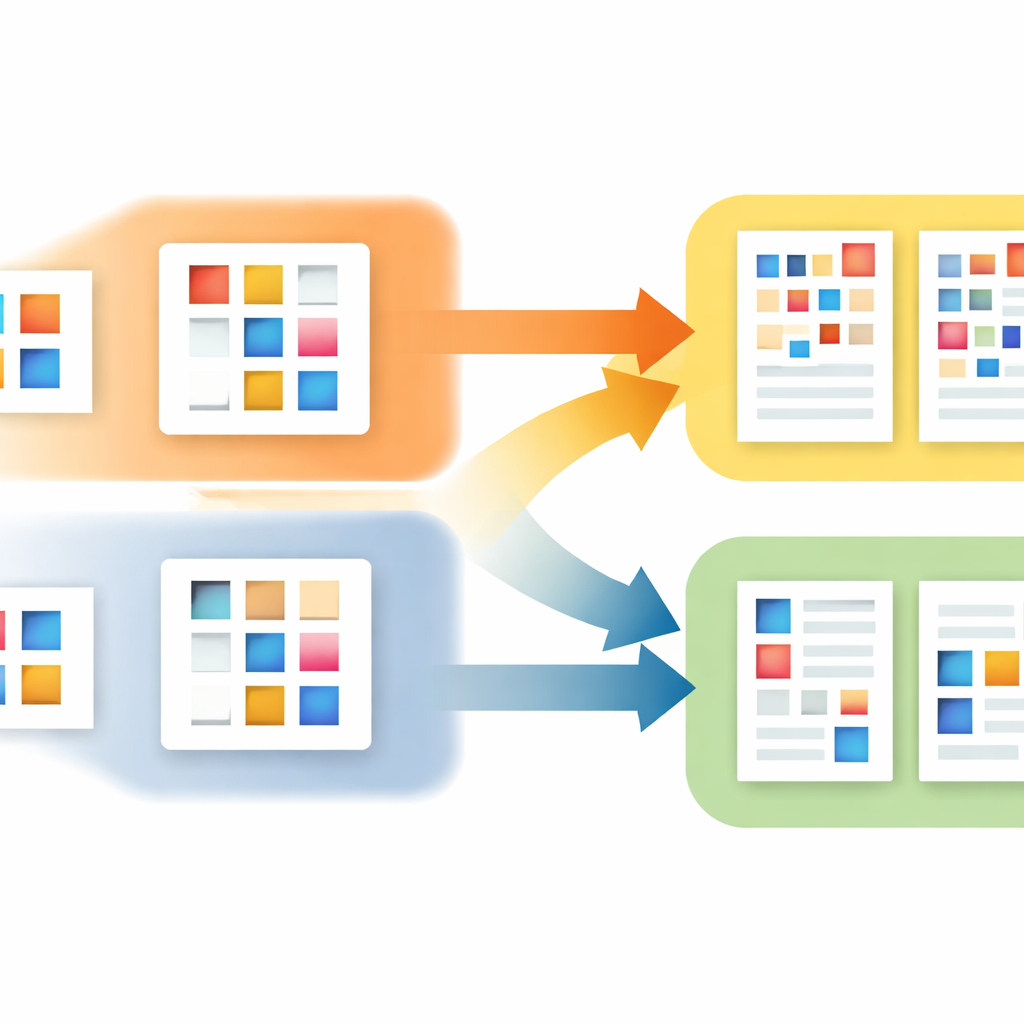

Naukowcy przeprowadzili dwa duże badania porównujące uczestników ludzkich z GPT-4, a następnie z jego następcą GPT-4o. Zarówno ludzie, jak i AI stawali przed dwoma rodzajami zadań. W przestrzennym zadaniu „symetrii” mieli doprowadzić niewielką siatkę do idealnej symetrii, przełączając pola włączone lub wyłączone — można to było osiągnąć przez wypełnienie dodatkowych pól (dodawanie) lub wyczyszczenie istniejących (odejmowanie). W językowym zadaniu „streszczenia” otrzymywali artykuł i istniejące streszczenie, a proszono ich o jego zmianę przy ograniczeniu liczby słów, co ponownie pozwalało na dodawanie lub skracanie tekstu. Zespół manipulował także dwoma kluczowymi czynnikami: czy dodawanie i odejmowanie były równie wydajne, czy odejmowanie wyraźnie wymagało mniej kroków, oraz czy instrukcje były sformułowane w sposób neutralny („zmień”), czy nacechowany pozytywnie („ulepsz”).

Co robili ludzie, a co robiły maszyny

W obu badaniach wyłonił się wyraźny wzorzec: zarówno ludzie, jak i modele językowe preferowali rozwiązania addytywne, ale modele robiły to znacznie silniej. Ludzie wykazywali wyraźne pociągnięcie ku dodawaniu pól lub słów, jednak nadal zwracali uwagę na efektywność. Gdy odejmowanie było szybszą drogą, byli zauważalnie chętniej skłonni usuwać elementy. W przeciwieństwie do nich GPT-4 często zachowywał się wręcz odwrotnie — generował jeszcze więcej rozwiązań addytywnych dokładnie wtedy, gdy odejmowanie byłoby bardziej efektywne. GPT-4o zmniejszył tę rozbieżność w zadaniu streszczeń opartym na tekście, gdzie jego wybory bardziej przypominały zachowanie ludzi, ale w zadaniu z siatką nadal w dużej mierze ignorował efektywność. W wielu warunkach, szczególnie dla GPT-4o, odpowiedzi addytywne osiągały poziomy bliskie maksimum.

Jak pozytywne sformułowanie wpływa na wybory

Emocjonalny ton instrukcji również miał znaczenie, lecz w specyficzny sposób. W zadaniu z siatką zmiana czasownika z neutralnego („zmień”) na pozytywny („ulepsz”) nie wpływała wiarygodnie na strategie ani ludzi, ani modeli. W zadaniu streszczeń historia była jednak inna. Gdy instrukcje wielokrotnie używały pozytywnego języka, oba modele GPT i — w drugim badaniu — uczestnicy ludzie częściej generowali odpowiedzi addytywne. Zgodne jest to z szerszą statystyką językową pokazującą, że słowa związane z ulepszaniem częściej łączone są z ideami dodawania niż usuwania. Sugeruje to, że subtelne emocjonalne ramowanie w poleceniach może popychać zarówno ludzi, jak i AI w stronę „więcej”, nawet gdy „mniej” byłoby wystarczające.

Dlaczego te odkrycia mają znaczenie dla codziennych decyzji

Dla czytelnika niebędącego ekspertem kluczowy przekaz jest taki: nasze mózgi i tworzone przez nas systemy AI dzielą silne upodobanie do rozwiązań polegających na dodawaniu zamiast odejmowania — a obecne modele językowe często tę tendencję wzmacniają. Ludzie wciąż wykazują pewną elastyczność, dostosowując się, gdy odejmowanie jest wyraźnie bardziej efektywne, ale modele w dużej mierze podążają za wzorcami obecnymi w języku, na którym były trenowane. W miarę jak te systemy coraz częściej pomagają w pisaniu polityk, projektowaniu systemów czy sugerowaniu codziennych ulepszeń, mogą dyskretnie kierować nas ku bardziej złożonym, bardziej zagraconym rozwiązaniom. Uznanie tej wspólnej „stronniczości dodawania” to pierwszy krok do projektowania narzędzi i nawyków, które przypominają nam, by zadawać nie tylko „Co możemy dodać?”, ale też „Co możemy usunąć?”

Cytowanie: Uhler, L., Jordan, V., Buder, J. et al. Influence of solution efficiency and valence of instruction on additive and subtractive solution strategies in humans, GPT-4, and GPT-4o. Commun Psychol 4, 41 (2026). https://doi.org/10.1038/s44271-026-00403-0

Słowa kluczowe: skłonność do dodawania, rozumowanie subtrakcyjne, duże modele językowe, porównanie człowiek–AI, podejmowanie decyzji