Clear Sky Science · pl

Analiza uczciwości predykcji agresji przez uczenie maszynowe w ostrej opiece psychiatrycznej

Dlaczego to ma znaczenie dla zwykłych ludzi

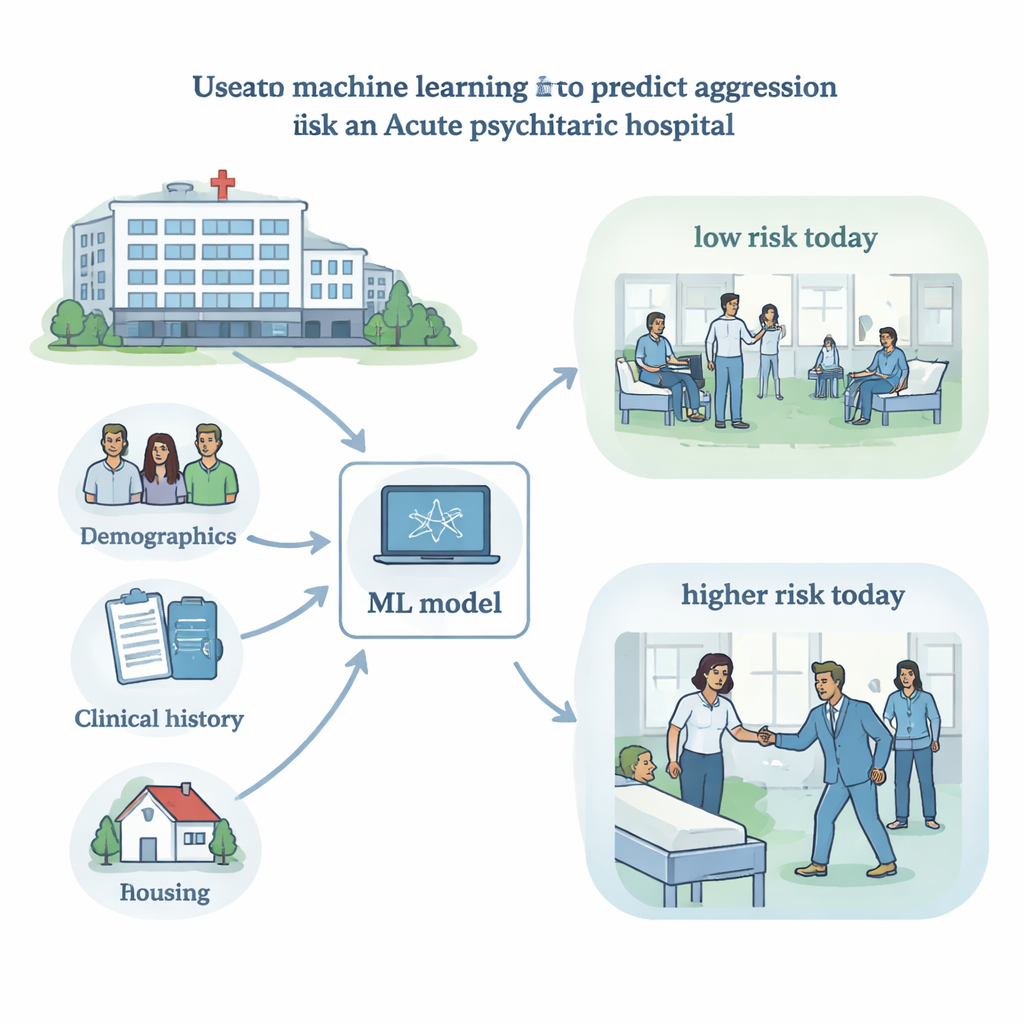

Szpitale sięgają po sztuczną inteligencję, by wykrywać pacjentów, którzy mogą stać się agresywni, w nadziei na zapobieganie szkodom bez stosowania traumatycznych środków przymusu. Jeśli jednak narzędzia predykcyjne są niesprawiedliwe, mogą pogłębiać istniejące nierówności wpływające na to, kto jest postrzegany jako „niebezpieczny”. W tym badaniu postawiono palące pytanie: gdy maszyna pomaga zdecydować, kto w oddziale psychiatrycznym jest wysokiego ryzyka, czy traktuje wszystkich pacjentów jednakowo?

Wykorzystanie danych szpitalnych do sygnalizowania krótkoterminowego ryzyka

Badacze przeanalizowali dokumentację ponad 17 000 pacjentów leczonych na oddziałach ostrych w dużym kanadyjskim szpitalu psychiatrycznym w latach 2016–2022. Dla każdego z maksymalnie trzech dni pobytu personel zapisywał standardowy przyłóżkowy arkusz oceny zwany Dynamic Appraisal of Situational Aggression (DASA), który ocenia zachowania takie jak drażliwość czy werbalne groźby mogące zwiastować nieuchronną agresję. Zespół połączył te oceny z informacjami zebranymi przy przyjęciu, takimi jak diagnoza, wiek, płeć, rasa lub pochodzenie etniczne, sytuacja mieszkaniowa oraz sposób przyjęcia do szpitala, aby wytrenować model uczenia maszynowego przewidujący, czy pacjent będzie zaangażowany w incydent agresji (w tym użycie środków przymusu lub izolacji) w ciągu następnych 24 godzin.

Jak narzędzie predykcyjne sprawdziło się ogólnie

Najlepszy system używał popularnej metody uczenia maszynowego zwanej lasem losowym (random forest). Na danych testowych nieużywanych podczas nauki model w większości przypadków poprawnie wyżej oceniał dni o większym ryzyku, osiągając pole pod krzywą (AUC) około 0,81, co jest porównywalne z podobnymi narzędziami w psychiatrii. Agresja była jednak rzadka — przypadało około 33 dni bez incydentów na każdy dzień z incydentem — więc model i tak przeoczył wiele rzeczywistych zdarzeń i generował pewne fałszywe alarmy. Miary ważności wykazały, że najbardziej do prognoz przyczyniały się bieżące czynniki kliniczne, zwłaszcza pozycje DASA takie jak drażliwość i wcześniejsze niedawne incydenty, a nie same demografia. Oznacza to, że model wychwytywał klinicznie istotne sygnały ostrzegawcze, ale same metryki wydajności nie ujawniały, czy był równie wiarygodny dla wszystkich.

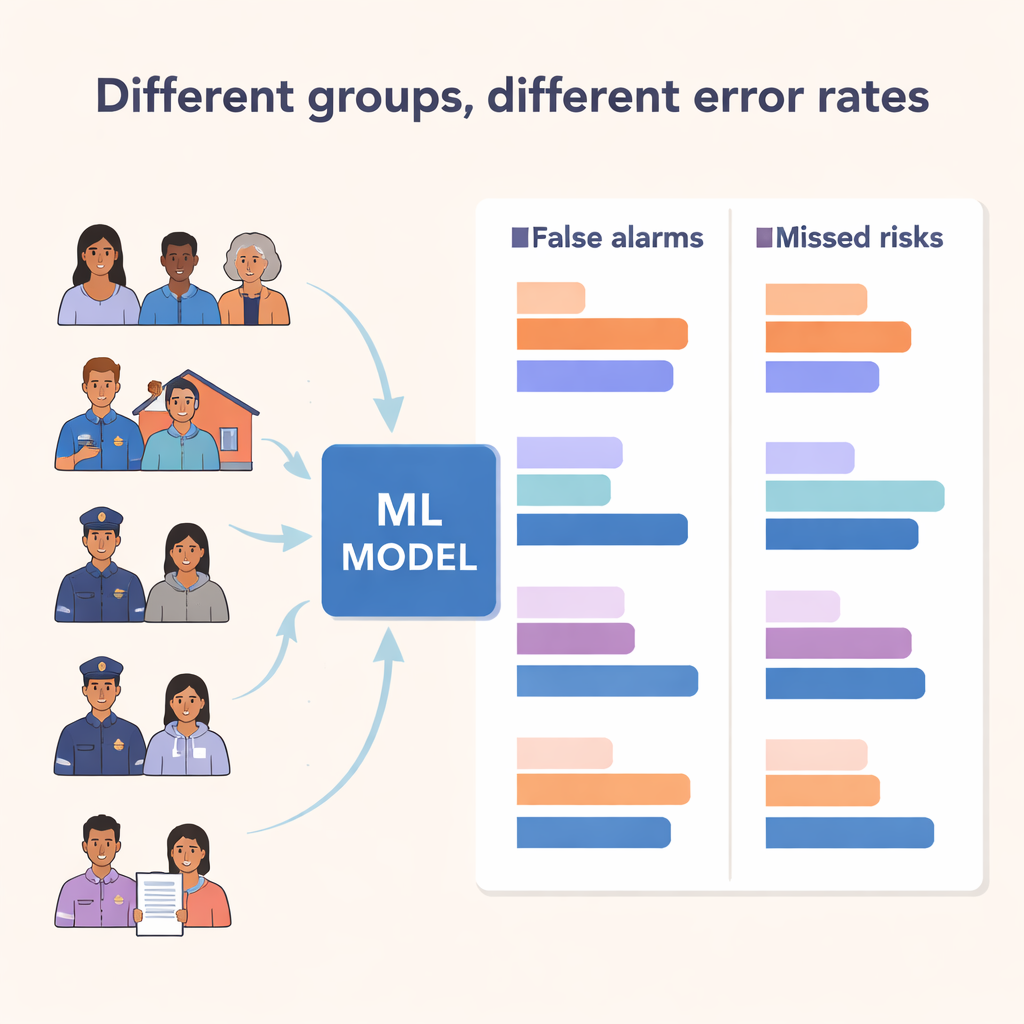

Nierówne błędy wśród różnych grup

Trzon badania stanowiła kontrola sprawiedliwości. Zespół skupił się na dwóch typach błędów: fałszywych pozytywach, gdy model sygnalizuje ryzyko, a nic się nie dzieje, oraz prawdziwych pozytywach, gdy poprawnie przewiduje incydent. Model sprawiedliwy według jednego powszechnie stosowanego kryterium zwanego „równymi szansami” (equalized odds) powinien mieć podobne wskaźniki fałszywych i prawdziwych pozytywów we wszystkich grupach. Zamiast tego badacze stwierdzili duże różnice. Fałszywe pozytywy były częstsze u pacjentów pochodzenia Bliskowschodniego i Czarnych, mężczyzn, osób przywiezionych do szpitala przez policję oraz u osób bez dachu nad głową lub w mieszkaniach wspieranych. Niektóre grupy — na przykład osoby przyjmowane przez policję czy z niestabilnym miejscem zamieszkania — miały jednocześnie wyższe wskaźniki wykrywania i więcej fałszywych alarmów, co sugeruje, że model był dla nich ustawiony na większą czułość. Inne, jak pacjenci czarnoskórzy, doświadczyli niepokojącego połączenia: więcej fałszywych alarmów przy gorszej zdolności do poprawnego wykrywania rzeczywistego ryzyka.

Gdy tożsamości się nakładają, różnice się pogłębiają

Ponieważ doświadczenia ludzi kształtowane są przez więcej niż jedną cechę naraz, badacze przeanalizowali także nakładające się tożsamości, w szczególności kombinację rasy lub pochodzenia etnicznego z płcią. Największy czerwony alarm pojawił się dla mężczyzn pochodzenia Bliskowschodniego, którzy mieli najwyższy odsetek fałszywych pozytywów spośród wszystkich grup, podczas gdy kobiety Bliskowschodnie nie miały takiego wzorca. Mężczyźni czarnoskórzy i rdzenny też mieli podwyższone fałszywe pozytywy w porównaniu z kobietami z tych samych środowisk. Te wzorce odzwierciedlają dobrze udokumentowane nierówności w opiece psychiatrycznej, takie jak większe zaangażowanie policji, przymusowe przyjęcia i błędne diagnozy w niektórych grupach rasowych i u mężczyzn. System uczenia maszynowego nie stworzył tych nierówności, lecz uczył się na danych przesiąkniętych tymi zjawiskami — i mógł je wzmacniać przy podejmowaniu decyzji klinicznych.

Co to oznacza dla przyszłości AI w psychiatrii

Autorzy argumentują, że analiza sprawiedliwości powinna być traktowana jako podstawowy kontrolny element bezpieczeństwa, a nie opcjonalny dodatek, zanim jakiekolwiek narzędzie predykcyjne zostanie wdrożone w praktyce. Zauważają, że techniczne metody „odstraszania uprzedzeń” — takie jak dostosowanie danych treningowych czy ustawianie różnych progów alarmowych dla różnych grup — mogą pomóc, ale mają ograniczenia, jeśli dokumentacja źródłowa już odzwierciedla nierówne traktowanie i praktyki przymusu. Ostatecznie decyzja, co uznajemy za „sprawiedliwy” model, to nie tylko problem matematyczny; to kwestia społeczna i etyczna, która wymaga wkładu pacjentów, klinicystów i społeczności. Badanie pokazuje, że choć uczenie maszynowe może pomóc w identyfikowaniu krótkoterminowego ryzyka agresji, może też cicho reprodukować strukturalny rasizm, seksizm i nierówności mieszkaniowe, jeśli sprawiedliwość nie będzie rygorystycznie mierzona, dyskutowana i adresowana.

Cytowanie: Wang, Y., Sikstrom, L., Xiao, R. et al. Fairness analysis of machine learning predictions of aggression in acute psychiatric care. npj Mental Health Res 5, 16 (2026). https://doi.org/10.1038/s44184-026-00194-6

Słowa kluczowe: sprawiedliwość algorytmiczna, agresja psychiatryczna, uczenie maszynowe w opiece zdrowotnej, nierówności zdrowotne, modele przewidywania ryzyka