Clear Sky Science · pl

Wszystkie oczy, brak IMU: nauka postawy lotu wyłącznie z obrazu

Widzieć jak owad

Małe roboty latające zazwyczaj polegają na drobnych czujnikach ruchu, które utrzymują je w pionie, niczym ucho wewnętrzne dla maszyn. Tymczasem owady wykonują zwinny lot przy znacznie prostszym sprzęcie, silnie polegając na tym, co widzą. Badanie pokazuje, że dron może robić coś podobnego: latać stabilnie używając wyłącznie specjalnego rodzaju kamery i kompaktowego sztucznego „mózgu”, bez standardowych czujników ruchu. Taka zmiana może uczynić przyszłe drony wielkości dłoni i w skali owadów lżejszymi, tańszymi i bardziej niezawodnymi.

Dlaczego pozbyć się zwykłych czujników?

Sterowanie postawą — utrzymanie prawidłowego pochylenia drona względem grawitacji — zwykle realizuje jednostka mierząca przyspieszenia i obroty. Te czujniki inercyjne działają dobrze, ale dodają wagę, zużywają energię i mogą stanowić pojedynczy punkt awarii. Dla porównania, wiele latających owadów nie ma dedykowanego czujnika grawitacji i zamiast tego wyciąga wskazówki o nachyleniu z ruchu świata przemieszczającego się po ich oczach. Gdyby roboty potrafiły naśladować ten trik, bardzo małe urządzenia mogłyby potrzebować jedynie wzroku do jednoczesnego obserwowania i balansowania, upraszczając konstrukcję i ułatwiając skalowanie w kierunku rozmiarów owadów.

Kamera, która widzi tylko zmiany

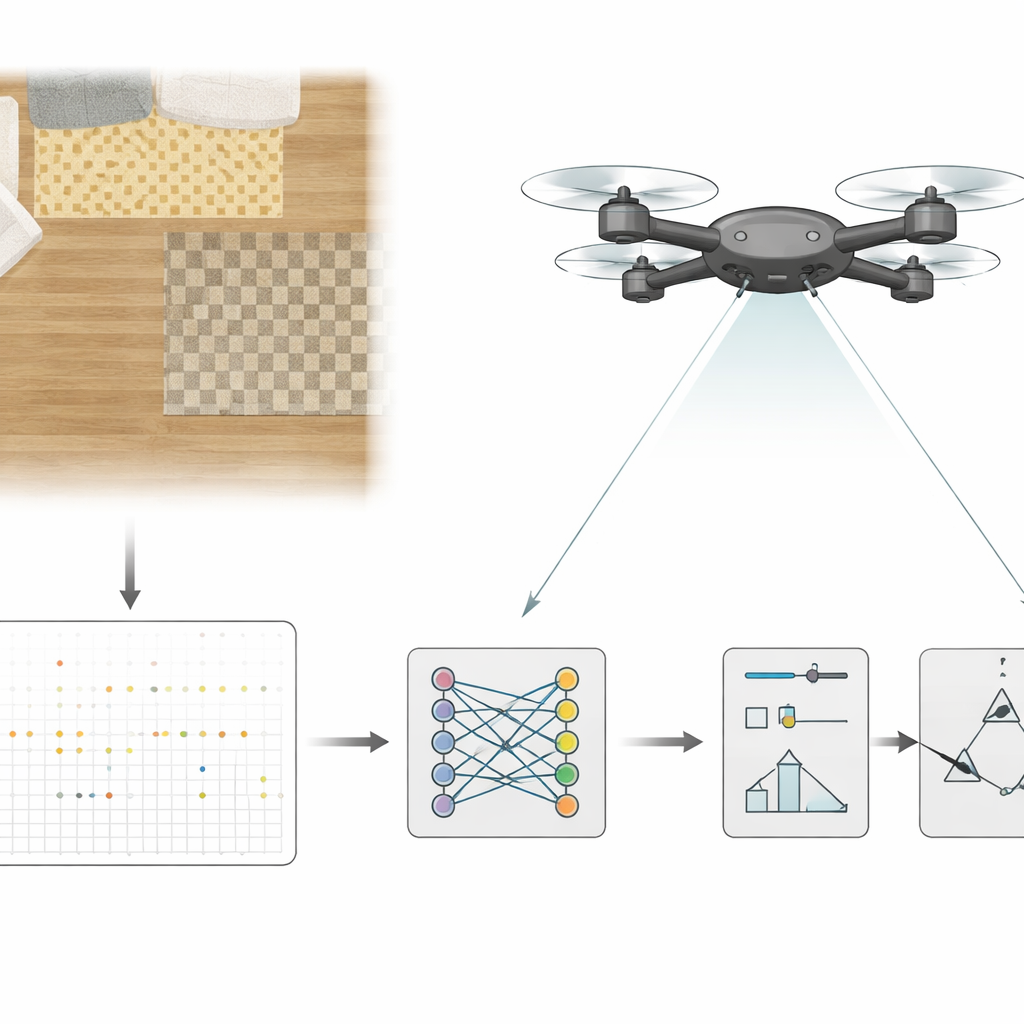

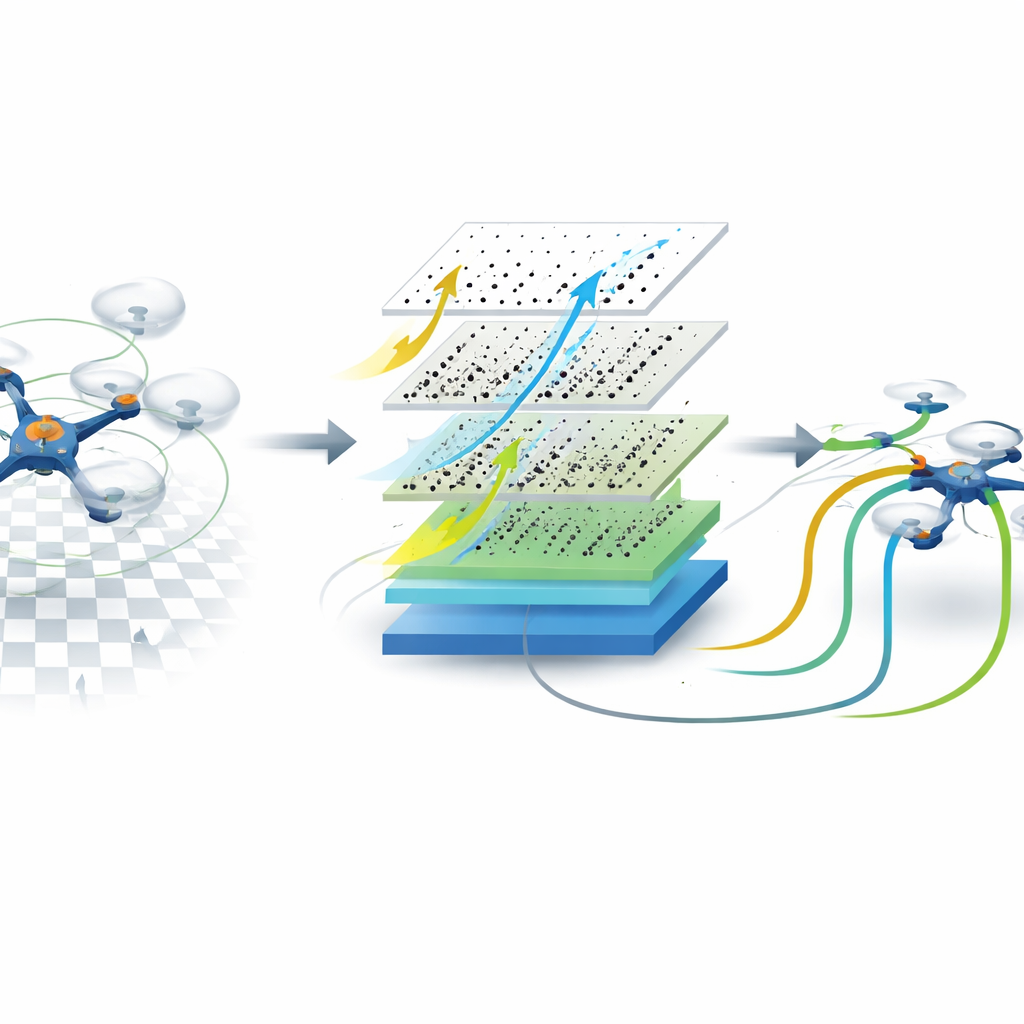

Zamiast standardowej kamery wideo badacze użyli kamery zdarzeniowej skierowanej w dół z pokładu drona. Zamiast przesyłać pełne obrazy w stałych odstępach czasu, ten czujnik raportuje jedynie drobne zmiany jasności w każdym pikselu, i to bardzo szybko. Strumień zdarzeń jest grupowany w krótkie plastry, każdy obejmujący zaledwie pięć tysięcznych sekundy, a te plastry trafiają do niewielkiej rekurencyjnej sieci konwolucyjnej działającej na pokładowym układzie graficznym. Z czasem sieć uczy się przekształcać wzory zmian wizualnych w estymaty pochylenia drona i prędkości jego obrotu, efektywnie zastępując tradycyjną jednostkę inercyjną w pętli sterowania.

Nauka balansowania drona wyłącznie wzrokiem

Aby wyszkolić ten sztuczny mózg, zespół najpierw latał swoim quadrotorem w arenie wewnętrznej, korzystając nadal z konwencjonalnego zestawu czujników. Podczas tych lotów rejestrowali strumień zdarzeń z kamery wraz z wartościami pochylenia i obrotów estymowanymi przez standardowy kontroler. Następnie trenowali sieć nadzorowaną, by odtworzyć te wartości wyłącznie na podstawie danych wizualnych. W późniejszych testach role się odwróciły: dron latał z estymatami sieci zamykającymi pętlę, podczas gdy niezależny system śledzenia ruchu lub pomiary pokładowe służyły tylko do oceny skuteczności. System utrzymywał drona w locie wiszącym i podążającego za poleceniami pilota przez minuty, z większością błędów pochylenia mieszczących się w kilku stopniach i błędów obrotu w umiarkowanych granicach, wystarczających do stabilnego lotu.

Wgląd w nauczoną zdolność wzrokową

Badacze sprawdzili, co sprawia, że to sterowanie oparte wyłącznie na wzroku działa najlepiej. Porównywali różne architektury sieci, dodawali lub usuwali dodatkowe wejścia, takie jak prędkości silników czy sygnały żyroskopu, oraz zmieniali, ile pola widzenia kamery jest używane. Sieci z pamięcią — potrafiące integrować informacje wzrokowe w czasie — okazały się kluczowe do dokładnego śledzenia szybkich obrotów, podczas gdy wersje bez pamięci miały z tym trudności. Szerokie pole widzenia, które odsłania odległe, horyzontopodobne wskazówki na krawędziach obrazu, dawało najniższe surowe błędy w znanych scenach. Zaskakująco jednak, zmuszenie sieci do patrzenia tylko na centralną część obrazu, gdzie takie statyczne wskazówki są nieobecne, sprawiało, że bardziej polegała na wzorcach ruchu zamiast na wyglądzie sceny. Choć zmniejszało to dokładność absolutną, poprawiało sposób, w jaki system adaptował się przy przeniesieniu do bardzo różnych środowisk, co sugeruje, że sieć uczyła się wewnętrznego poczucia ruchu.

W kierunku tiny, wizjo‑pierwszych robotów latających

Podsumowując, praca pokazuje, że dron może utrzymać się w pozycji oraz być sterowalny używając tylko tego, co widzi, bez udziału czujnika inercyjnego. Połączenie kamery zdarzeniowej z kompaktową siecią neuronową zapewnia prędkość i responsywność potrzebne do sterowania w czasie rzeczywistym, jednocześnie zmniejszając wagę i złożoność sprzętu. Dla czytelników spoza branży główny wniosek jest taki, że przyszłe stada małych, przypominających owady robotów latających mogą balansować i nawigować korzystając z jednego sprytnego oka, podobnie jak owady, otwierając drogę do lżejszych, bardziej energooszczędnych maszyn zdolnych bezpiecznie eksplorować zagracone, nieprzewidywalne przestrzenie.

Cytowanie: Hagenaars, J.J., Stroobants, S., Bohté, S.M. et al. All eyes, no IMU: learning flight attitude from vision alone. npj Robot 4, 21 (2026). https://doi.org/10.1038/s44182-026-00081-4

Słowa kluczowe: sterowanie lotem oparte na wizji, drony z kamerami zdarzeniowymi, robotyka inspirowana biologią, sterowniki oparte na sieciach neuronowych, Bezzałogowe statki powietrzne w skali owadów