Clear Sky Science · pl

Łączenie modalności za pomocą AI: przegląd postępów sztucznej inteligencji w multimodalnym obrazowaniu biomedycznym

Widzieć więcej niż widać na pierwszy rzut oka

Współczesna medycyna w dużej mierze opiera się na obrazach — od rentgenów i skanów MRI po preparaty mikroskopowe tkanek — aby zrozumieć, co dzieje się w ciele. Ten przegląd wyjaśnia, jak sztuczna inteligencja (AI) może łączyć różne rodzaje obrazów medycznych w jedną, bogatszą całość dotyczącą choroby. Dla czytelnika niebędącego specjalistą zaleta jest oczywista: postępy te mogą oznaczać wcześniejsze wykrywanie nowotworów, precyzyjniejsze diagnozy i terapie dostosowane do konkretnej osoby, a nie do przeciętnego pacjenta.

Dlaczego jedno zdjęcie już nie wystarcza

Każna technika obrazowania pokazuje tylko część historii. Narzędzia radiologiczne, takie jak tomografia komputerowa (CT), rezonans magnetyczny (MRI) i ultrasonografia, ujawniają kształt i strukturę narządów, podczas gdy badania nuklearne, takie jak PET, wskazują, jak aktywny jest guz. Pod mikroskopem patolodzy obserwują ułożenie komórek, a metody spektroskopowe odczytują chemiczne odciski tkanki. Metody optyczne, jak tomografia optyczna spójności (OCT), pozwalają przyjrzeć się cienkim warstwom w oku czy skórze. Same w sobie te „jednookienne” migawki mogą przeoczyć ważne wskazówki. Po połączeniu natomiast łączą wygląd guza, jego zachowanie i molekularne czynniki napędzające, dając lekarzom pełniejszy obraz choroby.

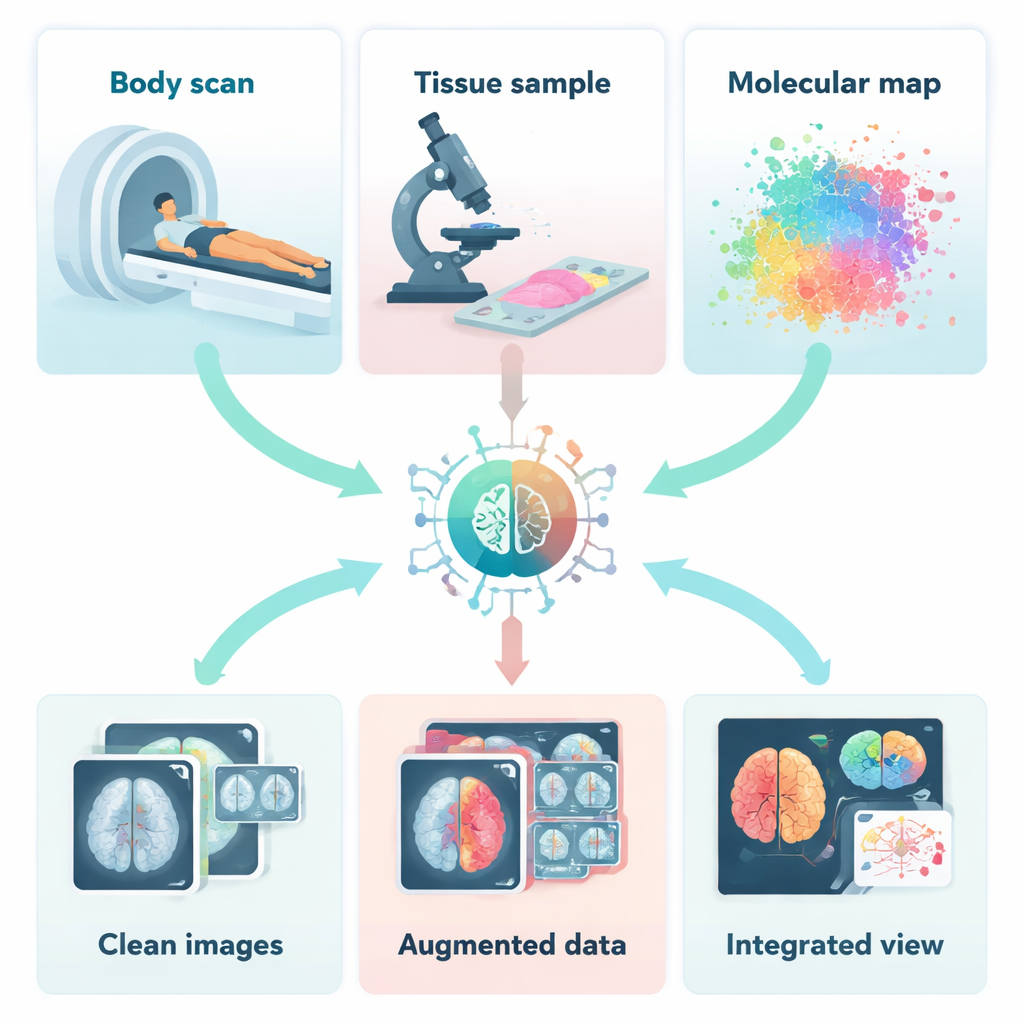

Jak AI oczyszcza i uzupełnia obrazy medyczne

Zanim różne obrazy będzie można połączyć, trzeba je oczyścić, wyrównać, a czasem nawet wygenerować od podstaw. Autorzy opisują, jak AI pomaga usuwać szum i rozmycie spowodowane ruchem, przywraca szczegóły z niskodawkowych obrazów CT lub PET oraz koryguje artefakty, które w przeciwnym razie mogłyby zmylić lekarzy i systemy komputerowe. Systemy głębokiego uczenia uczą się na przykładach, jak powinien wyglądać czysty obraz i następnie przywracają nowe skany zgodnie z tym wzorcem. Inne modele AI generują realistyczne obrazy syntetyczne, by „wzbogacić” małe zbiory danych lub uzupełnić brakujące typy badań. To szczególnie cenne w przypadku rzadkich chorób, gdzie jest niewiele prawdziwych przykładów do trenowania narzędzi diagnostycznych.

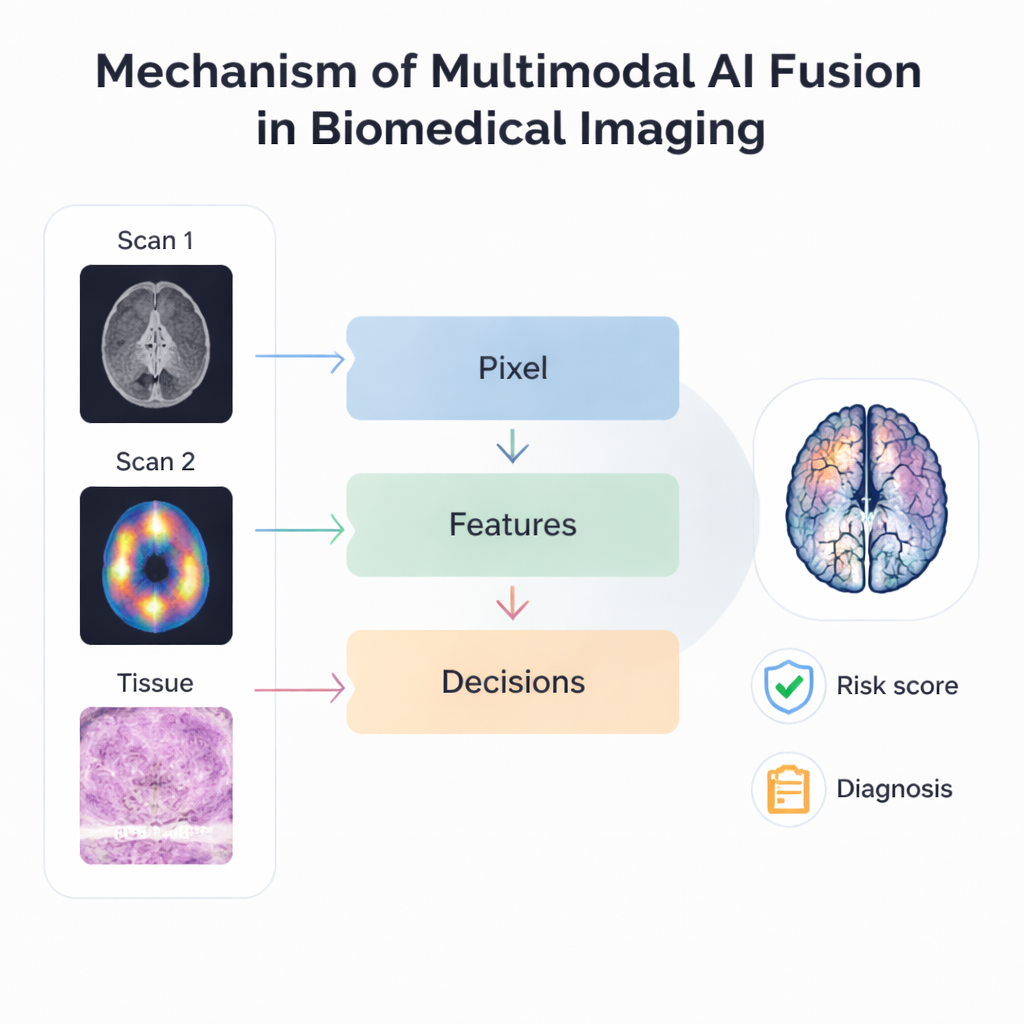

Mieszanie różnych perspektyw w jedną opowieść

Sednem przeglądu jest to, jak AI faktycznie scala wiele źródeł obrazowania. Na najprostszym poziomie metody oparte na pikselach nakładają skany, takie jak MRI i PET, tak by struktura i aktywność pojawiły się na jednym, ostrzejszym obrazie. Bardziej zaawansowane podejścia wydobywają kluczowe wzorce lub „cechy” z każdej modalności i łączą te wzorce zamiast surowych obrazów, co sprawia, że proces jest bardziej odporny na różnice w rozdzielczości i wyrównaniu. Fuzja na etapie decyzji („decision‑level”) idzie dalej — pozwala odrębnym modelom AI analizować różne obrazy, a następnie głosować lub uśredniać swoje przewidywania. Systemy hierarchiczne mieszają kilka z tych pomysłów, układając różne etapy fuzji, aby móc obsłużyć wszystko, od drobnych detali komórkowych po zmiany obejmujące cały narząd w ramach jednego systemu.

Od lepszych obrazów do lepszej opieki

Techniki fuzji są już testowane w wielu scenariuszach klinicznych. Łączenie różnych sekwencji MRI poprawia segmentację guzów mózgu, podczas gdy zestawienie mammografii, ultrasonografii i MRI zwiększa wykrywanie raka piersi i trafność oceny ryzyka. Powiązanie cyfrowych preparatów patologicznych z obrazami radiologicznymi pomaga przewidywać genetykę guza i przeżywalność pacjenta bez potrzeby dodatkowych badań. AI wspiera także „obrazowanie oparte na danych”, gdzie subtelne wzorce w skanach koreluje się z aktywnością genów lub wynikami leczenia, obiecując dokładniejsze prognozy i lepszy dobór terapii. Nowe modele bazowe i multimodalne duże modele językowe dążą do uogólniania na różne zadania i typy obrazów, a nawet łączenia obrazów z pisemnymi notatkami klinicznymi, zmierzając ku uniwersalnym narzędziom, które mogą dostosować się do wielu chorób i placówek.

Zaufanie, uczciwość i dalsza droga

Pomimo entuzjazmu autorzy podkreślają, że pozostaje wiele istotnych wyzwań. Obrazy medyczne różnią się znacznie między szpitalami, aparatami i grupami pacjentów, co może uczynić AI kruche lub stronnicze, jeśli nie zostanie to starannie uwzględnione. Wiele potężnych modeli zachowuje się jak czarne skrzynki, utrudniając klinicystom zrozumienie, dlaczego zapadła konkretna decyzja. Przegląd omawia wysiłki mające na celu wskazanie, które obszary każdego obrazu najsilniej wpływają na przewidywania, oraz projektowanie sprawiedliwszych i bardziej przejrzystych systemów. Zwraca też uwagę na kwestie etyczne związane z prywatnością, udostępnianiem danych i dużymi wymaganiami obliczeniowymi modeli. Patrząc w przyszłość, autorzy wyobrażają sobie wyspecjalizowane „agentury” AI, które ciągle monitorują obrazowanie, sensory noszone i dokumentację medyczną, wspierają klinicystów w czasie rzeczywistym i pomagają koordynować opiekę długoterminową. Dla pacjentów istotne jest to, że łączenie wielu rodzajów obrazów medycznych z AI może oznaczać szybsze odpowiedzi, bardziej spersonalizowane terapie i w efekcie lepsze wyniki — pod warunkiem że technologie te będą rozwijane i wdrażane w sposób odpowiedzialny.

Cytowanie: Doan, L.M.T., Shahhosseini, K., Verma, S. et al. Bridging modalities with AI: a review of AI advances in multimodal biomedical imaging. Commun Eng 5, 30 (2026). https://doi.org/10.1038/s44172-026-00602-x

Słowa kluczowe: multimodalne obrazowanie biomedyczne, medyczna AI, fuzja obrazów, radiologia i patologia, medycyna precyzyjna