Clear Sky Science · pl

Wnioskowanie oparte na symulacjach dla precyzyjnej fizyki neutrin poprzez neuronowe dostrajanie Monte Carlo

Precyzyjne dostrajanie „oczu” teleskopów neutrinowych

Przyszłe eksperymenty neutrinowe mają odpowiedzieć na wielkie pytania o wszechświecie, takie jak uporządkowanie mas neutrin czy mechanizmy wybuchów gwiazd. Aby to osiągnąć, ich olbrzymie detektory muszą mierzyć energię z niezwykłą precyzją — znacznie lepszą niż pozwalają proste wzory z podręczników. Artykuł pokazuje, jak nowoczesne narzędzia uczenia maszynowego mogą pomóc w dostrajaniu i walidacji złożonych symulacji, które łączą procesy zachodzące w detektorze z błyskami światła, które faktycznie rejestrujemy.

Dlaczego zrozumienie odpowiedzi detektora jest tak trudne

W eksperymentach takich jak Jiangmen Underground Neutrino Observatory (JUNO) w Chinach neutrina oddziałują w ogromnym zbiorniku cieczy, która wytwarza światło, gdy przechodzą przez nią cząstki. To światło zbierane jest przez tysiące fotopowielaczy jako maleńkie impulsy elektryczne, zliczane jako „fotoelektrony”. Wyzwanie polega na odtworzeniu z tych zliczeń pierwotnej energii cząstki. W praktyce związek ten nie jest prostą linią: zależy od geometrii detektora, właściwości cieczy i kilku współzależnych efektów fizycznych. Tradycyjne podejścia opierały się na ręcznym dostrajaniu parametrów symulacji, aż symulowane widma przypominały dane kalibracyjne — metoda, która staje się nie do opanowania dla nowoczesnych eksperymentów o wysokiej precyzji.

Nauczanie sieci neuronowych emulowania symulatora

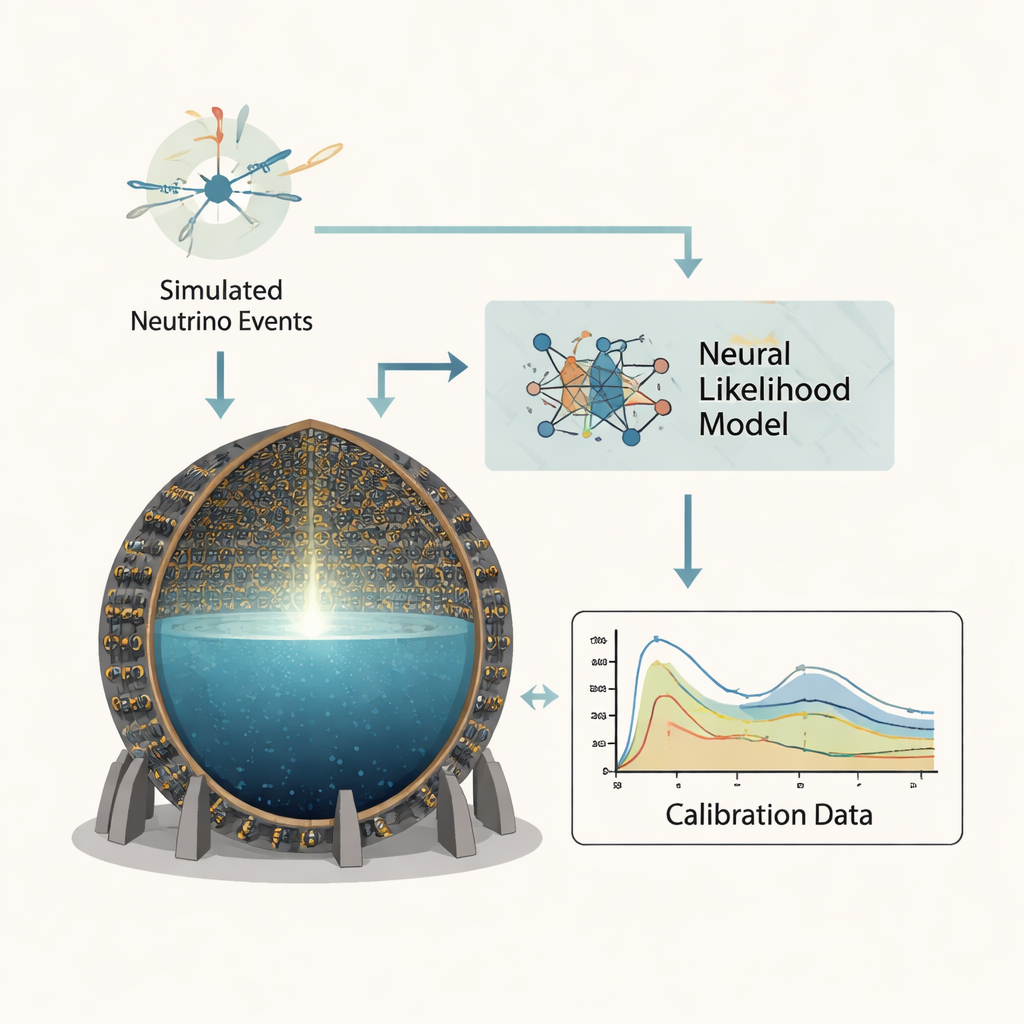

Autorzy przyjmują strategię znaną jako wnioskowanie oparte na symulacjach — zamiast próbować zapisać dokładny wzór matematyczny na odpowiedź detektora, pozwalają symulacjom i sieciom neuronowym wykonać ciężką pracę. Koncentrują się na trzech kluczowych parametrach, które rządzą tym, jak JUNO przekształca rzeczywistą energię w wykryte światło: współczynniku opisującym, jak produkcja światła jest „tłumiona” przy dużej gęstości jonizacji, ogólnym plonie świetlnym określającym średnią jasność oraz czynniku kontrolującym ilość światła Czerenkowa. Korzystając z oficjalnego oprogramowania Monte Carlo JUNO, generują około miliarda symulowanych zdarzeń kalibracyjnych z pięciu radioaktywnych źródeł umieszczonych w centrum detektora, każde zdarzenie podsumowane jednym liczbowym parametrem: całkowitym zebranym światłem. To stanowi pole treningowe dla sieci neuronowych, które uczą się, jak prawdopodobne jest otrzymanie dowolnego sygnału świetlnego dla dowolnego wyboru trzech parametrów.

Dwa komplementarne obiektywy uczenia maszynowego

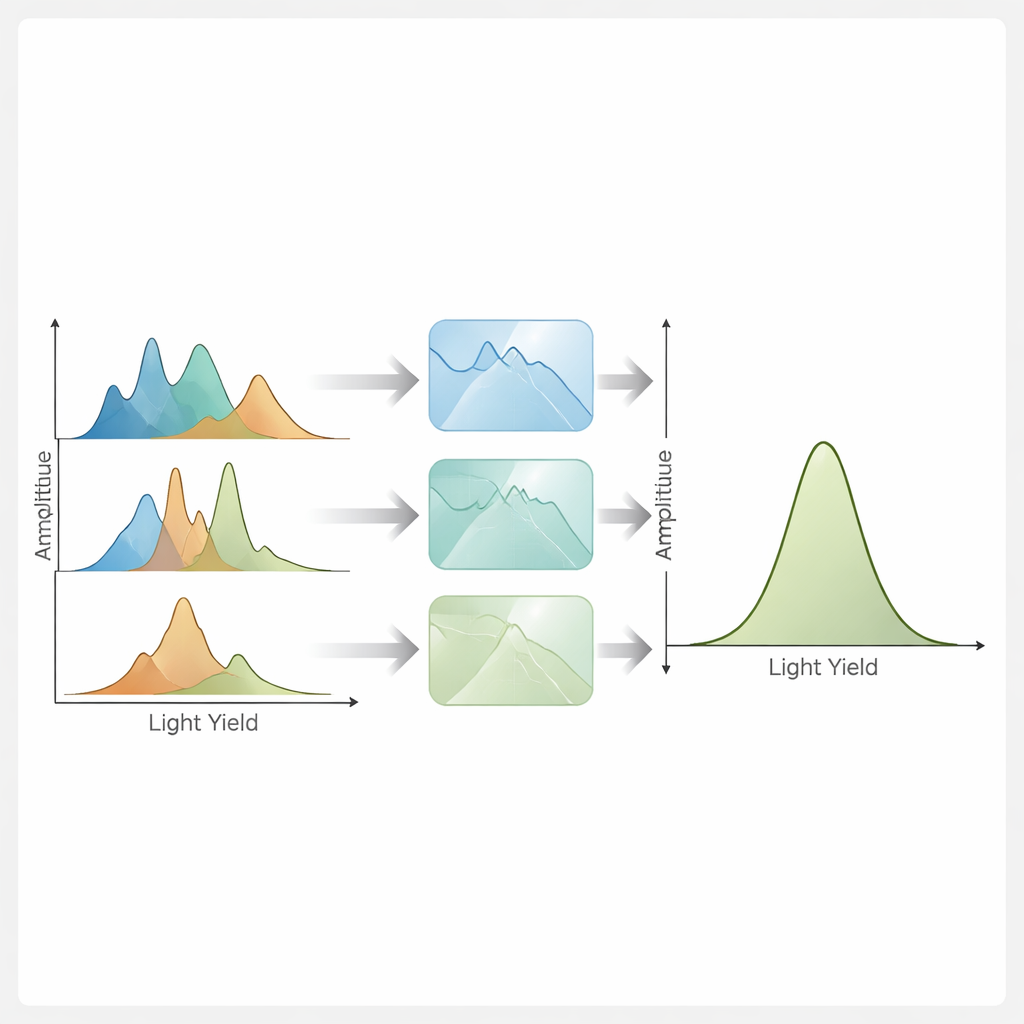

Zespół opracowuje dwa komplementarne „estymatory gęstości” oparte na sieciach neuronowych, które przybliżają prawdopodobieństwo zaobserwowania danego sygnału świetlnego dla określonych ustawień detektora. Pierwszy, zwany Transformer Encoder Density Estimator, wykorzystuje architekturę transformera — tę samą rodzinę modeli, która stoi za wieloma narzędziami językowymi — aby bezpośrednio przewidzieć drobno podzielony histogram widma świetlnego dla każdej kombinacji parametrów i źródła. Naturalnie wspiera to tradycyjne analizy statystyczne bazujące na koszach. Drugi, zwany Normalizing Flows Density Estimator, używa łańcucha odwracalnych transformacji do przekształcenia skomplikowanych, wielomodalnych widm w prosty rozkład dzwonowy. Dzięki matematycznej kontroli tych transformacji metoda może ocenić dokładne prawdopodobieństwo dla każdego niegrupowanego zdarzenia, umożliwiając analizy wykorzystujące pełną informację zawartą w danych.

Sprawdzanie dokładności, precyzji i odporności

Aby udowodnić, że te narzędzia neuronowe są wiarygodne, autorzy poddają je rygorystycznym testom. Najpierw sprawdzają, czy modele potrafią odtworzyć symulowane widma dla tysięcy kombinacji trzech parametrów, używając kilku odległości statystycznych porównujących przewidywane i „prawdziwe” rozkłady. Obie metody bardzo dobrze śledzą ostre piki i subtelne cechy spektralne, z rozbieżnościami na poziomie kilku części na tysiąc. Następnie wprowadzają wyuczone funkcje wiarygodności do ustalonych silników statystycznych — zagnieżdżonego próbkowania bayesowskiego, łańcuchów Markowa (MCMC) oraz klasycznej minimalizacji — aby odzyskać oryginalne parametry symulacji z zestawów sztucznych danych. W szerokim zakresie wartości parametrów i statystyk zdarzeń odzyskane parametry są nieobciążone, a podane niepewności odpowiadają rzeczywistemu rozrzutowi wyników. Niepewności maleją wraz z większą ilością danych dokładnie tak, jak oczekuje się z podstawowej statystyki zliczeń, a metody wiernie odwzorowują silne korelacje między parametrami.

Od miesięcy obliczeń do sekund

Jednym z uderzających rezultatów jest przyspieszenie obliczeń. Uruchomienie pełnych symulacji detektora z wystarczającą liczbą zdarzeń, by scharakteryzować każdy punkt w przestrzeni parametrów, może zająć wiele godzin na konwencjonalnym procesorze. Jednak po treningu model transformera może wygenerować przewidywane widmo w ciągu kilku milisekund, a model normalizing-flow może ocenić prawdopodobieństwa dla dziesiątek tysięcy zdarzeń w znacznie poniżej jednej dziesiątej sekundy. To sprawia, że realistyczne staje się przeszukiwanie dużych przestrzeni parametrów i kwantyfikacja niepewności systematycznych, które w przeciwnym razie byłyby zabójczo kosztowne, otwierając drogę do bardziej szczegółowych i wiarygodnych kalibracji detektorów.

Co to oznacza dla przyszłych eksperymentów neutrinowych

Dla laików główne przesłanie jest takie, że praca ta zamienia skomplikowane, powolne symulacje detektorów w szybkie, dokładne zastępniki bez poświęcania sensu fizycznego. Trzy dostrojone parametry wciąż odpowiadają bezpośrednio rzeczywistym właściwościom detektora i cieczy, więc wyniki pozostają interpretowalne dla fizyków. Badanie pokazuje, że oba podejścia neuronowe potrafią wyznaczyć te parametry z niezwykle małymi błędami, ograniczonymi głównie przez ilość dostępnych danych. W miarę jak nadchodzące eksperymenty, takie jak JUNO, DUNE i Hyper-Kamiokande, dążą do precyzji pomiarów neutrin poniżej progu jednego procenta, metody tego typu będą niezbędne, aby upewnić się, że nasze wnioski o wszechświecie nie będą ograniczone przez to, jak dobrze rozumiemy nasze detektory.

Cytowanie: Gavrikov, A., Serafini, A., Dolzhikov, D. et al. Simulation-based inference for precision neutrino physics through neural Monte Carlo tuning. Commun Phys 9, 63 (2026). https://doi.org/10.1038/s42005-026-02499-6

Słowa kluczowe: detektory neutrin, uczenie maszynowe, dostrajanie Monte Carlo, normalizujące przepływy, wnioskowanie oparte na symulacjach