Clear Sky Science · pl

Definiowanie bezpieczeństwa operacyjnego w klinicznych systemach sztucznej inteligencji

Dlaczego bezpieczna SI w medycynie ma znaczenie

Szpitale szybko wdrażają sztuczną inteligencję do odczytywania skanów i wykrywania chorób, ale pojawia się pytanie, na które zwykłe miary dokładności nie potrafią odpowiedzieć: kiedy naprawdę bezpiecznie jest pozwolić maszynie podjąć decyzję? Niniejszy artykuł przedstawia praktyczny sposób ustalenia, kiedy lekarze mogą ufać systemowi SI, kiedy powinni go zignorować, a kiedy muszą sami dokładniej przyjrzeć się sprawie. Celem nie jest jedynie tworzenie mądrzejszych algorytmów, lecz ich włączenie w opiekę codzienną w sposób, który chroni pacjentów, zmniejsza liczbę niepotrzebnych badań i odciąża klinicystów zamiast ich dodatkowo obciążać.

Z jednej miary do trzech jasnych stref działania

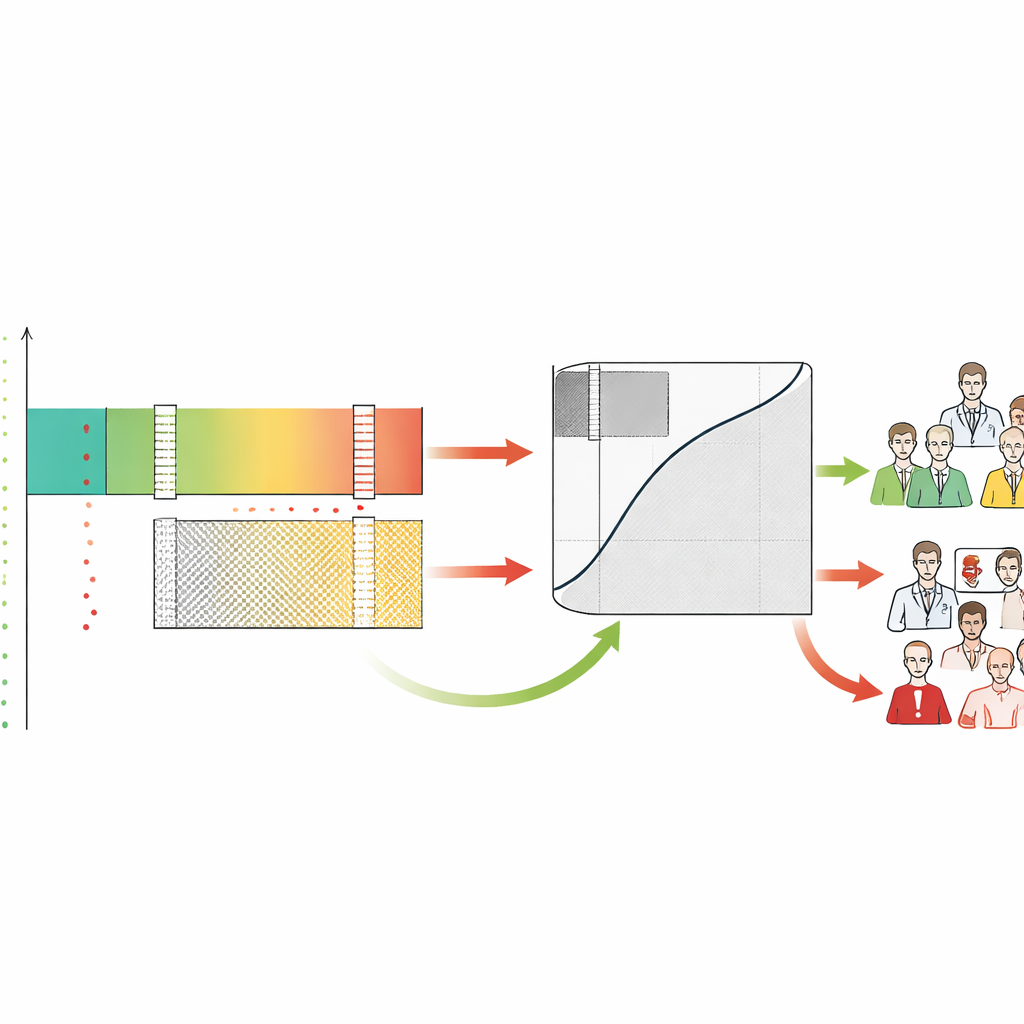

Większość medycznych narzędzi SI generuje pojedynczy wynik ryzyka, na przykład prawdopodobieństwo, że mammografia wskazuje na raka. Tradycyjnie twórcy oceniają te narzędzia za pomocą krzywej podsumowującej, jak dobrze rozdzielają pacjentów chorych od zdrowych w ujęciu ogólnym. Autorzy argumentują, że to nie wystarcza. Proponują ramy Safety-Aware ROC (SA-ROC), które zaczynają od tych samych wyników ryzyka, ale przekształcają je w trzy praktyczne regiony. Strefa „rule-in” o wysokim wyniku obejmuje pacjentów, których wyniki są wystarczająco wiarygodne, by wywołać działanie, np. pilną kontrolę. Strefa „rule-out” o niskim wyniku obejmuje pacjentów, których wyniki są na tyle pewne, by bezpiecznie obniżyć priorytet. Pomiędzy nimi znajduje się „szara strefa” niepewności, gdzie SI nie jest wystarczająco wiarygodna i sprawę musi przejrzeć ekspert ludzki.

Pozwolenie klinicystom na ustalenie progu bezpieczeństwa

Co istotne, SA-ROC pozwala klinicystom i instytucjom określić własne cele bezpieczeństwa z wyprzedzeniem. Wybierają, jak bardzo chcą być pewni przed podjęciem działania na podstawie pozytywnego wyniku (minimalne akceptowalne prawdopodobieństwo, że oznaczona zmiana jest rzeczywiście nieprawidłowa) oraz jak bardzo chcą być pewni przed rozluźnieniem w przypadku wyniku negatywnego (minimalne akceptowalne prawdopodobieństwo, że przypadek uznany za czysty jest rzeczywiście prawidłowy). Mając te cele, ramy przeszukują wyniki modelu, aby znaleźć dokładne granice, które je spełniają. Wyniki powyżej górnej granicy tworzą bezpieczną strefę rule-in, wyniki poniżej dolnej granicy tworzą bezpieczną strefę rule-out, a wszystko pomiędzy staje się strefą szarą. Następnie ramy kwantyfikują, ile pacjentów trafia do każdej strefy i jak duże obciążenie niepewnością — przypadki odesłane z powrotem do ludzi — pozostawia SI nierozwiązane.

Ujawnianie ukrytych różnic między podobnymi systemami SI

Autorzy pokazują, że dwa systemy SI o niemal identycznej tradycyjnej dokładności mogą zachowywać się bardzo różnie, gdy spojrzy się na nie przez pryzmat bezpieczeństwa. W symulacjach modele o tej samej ogólnej wydajności dały bardzo różne rozmiary stref rule-in, rule-out i szarej w zależności od rozkładu ich wyników. Jeden może excelować w pewnym potwierdzaniu choroby, podczas gdy inny może świetnie oczyszczać duże liczby pacjentów o niskim ryzyku. W studium przypadku z rzeczywistego świata, dotyczącym dwóch narzędzi zatwierdzonych przez FDA do przesiewu piersi, system z wyższym standardowym wynikiem dokładności okazał się gorszy w przesiewaniu o wysokim poziomie pewności. Przy najsurowszym ustawieniu bezpieczeństwa — niepozwalającym na żadne nie wykryte nowotwory w grupie niskiego ryzyka — rzekomo słabszy system bezpiecznie usunął z kolejki radiologa niemal dwukrotnie więcej kobiet. SA-ROC ujawnia więc rodzaj „odwrócenia wydajności”, które tradycyjne metryki ukrywają.

Rozumienie napięcia między człowiekiem a SI oraz obciążenia pracą

Oznaczając każdy przypadek jako rule-in, rule-out lub szary, ramy ujawniają również, jak zachowują się lekarze w tych strefach. Autorzy stwierdzili, że radiolodzy często nadmiernie zgłaszali przypadki, które SI oceniła jako bezpiecznie niskiego ryzyka, generując wiele fałszywych alarmów właśnie w obszarze, gdzie maszyna była najbardziej niezawodna. Natomiast zarówno ludzie, jak i SI mieli trudności w strefie szarej, potwierdzając, że to obszar wymagający uwagi eksperta. SA-ROC mierzy rozmiar tej szarej strefy jedną liczbą, która reprezentuje koszt niezdecydowania. Mała szara strefa oznacza więcej bezpiecznej automatyzacji i mniejsze obciążenie ludzkie; duża szara strefa oznacza, że wiele przypadków nadal wymaga starannego ręcznego przeglądu i że system może zwiększać wypalenie zamiast je łagodzić.

Przekucie zasad bezpieczeństwa w codzienną praktykę

Ponad pomiar, ramy zaprojektowano jako narzędzie zarządcze, które przekłada polityki na konkretne zachowanie SI. Szpitale mogą używać go na dwa sposoby. Po pierwsze, mogą bezpośrednio określić wymagania bezpieczeństwa lub limity dotyczące liczby przypadków, które są skłonne skierować do strefy szarej, i pozwolić ramom obliczyć odpowiadające progi. Po drugie, mogą przypisać wartości i kary różnym wynikom — wykryciu raka, jego przeoczeniu, zleceniu niepotrzebnego badania lub odroczeniu do przeglądu przez człowieka — i pozwolić ramom poszukać polityki maksymalizującej ogólną korzyść. Strategie te mogą być dostosowane do bardzo różnych celów, takich jak programy masowego przesiewu, skierowania do specjalistów czy kohorty badawcze, wszystkie z użyciem tego samego modelu bazowego.

Co to oznacza dla pacjentów i klinicystów

Mówiąc prosto, ta praca oferuje sposób, by powiedzieć nie tylko „ta SI jest dokładna”, ale „oto dokładnie, kiedy i jak można jej ufać w klinice”. Dzieląc wyniki SI na strefy bezpieczne, niebezpieczne i niepewne powiązane z wyraźnymi obietnicami bezpieczeństwa, SA-ROC pomaga systemom opieki zdrowotnej zdecydować, kiedy maszyny mogą działać samodzielnie, a kiedy ludzie muszą pozostać przy sterach. Podkreśla, że tradycyjne miary dokładności mogą wprowadzać w błąd i że prawdziwe bezpieczeństwo zależy od tego, jak model zachowuje się na krańcach, gdzie błędy są najkosztowniejsze. Jeśli zostanie szeroko przyjęty i zwalidowany w większych, rzeczywistych warunkach, ten framework może wspierać bardziej niezawodną automatyzację, redukować niepotrzebne alarmy i badania oraz przekształcać najtrudniejsze przypadki SI — szarą strefę — w ukierunkowane źródło nauki i poprawy zarówno dla algorytmów, jak i medycyny jako takiej.

Cytowanie: Kim, YT., Kim, H., Bahl, M. et al. Defining operational safety in clinical artificial intelligence systems. npj Digit. Med. 9, 281 (2026). https://doi.org/10.1038/s41746-026-02450-7

Słowa kluczowe: kliniczna sztuczna inteligencja, bezpieczeństwo operacyjne, obrazowanie medyczne, wsparcie decyzji, stratyfikacja ryzyka