Clear Sky Science · pl

Duże modele językowe udzielają niebezpiecznych odpowiedzi na pytania medyczne zadawane przez pacjentów

Dlaczego to ma znaczenie przy codziennych pytaniach o zdrowie

Coraz więcej osób zwraca się do czatbotów opartych na AI zamiast do lekarzy, gdy pojawi się niepokojący objaw lub chore dziecko w domu. Artykuł stawia proste, lecz kluczowe pytanie: kiedy pacjenci traktują duże modele językowe jak lekarzy w internecie, jak często odpowiedzi są nie tylko niedoskonałe, ale faktycznie niebezpieczne? Zespół lekarzy postanowił porównać kilka popularnych czatbotów i ujawnić, gdzie ich porady mogą pomagać — a gdzie mogą potajemnie zagrażać ludziom.

Testowanie czatbotów tak, jak robią to pacjenci

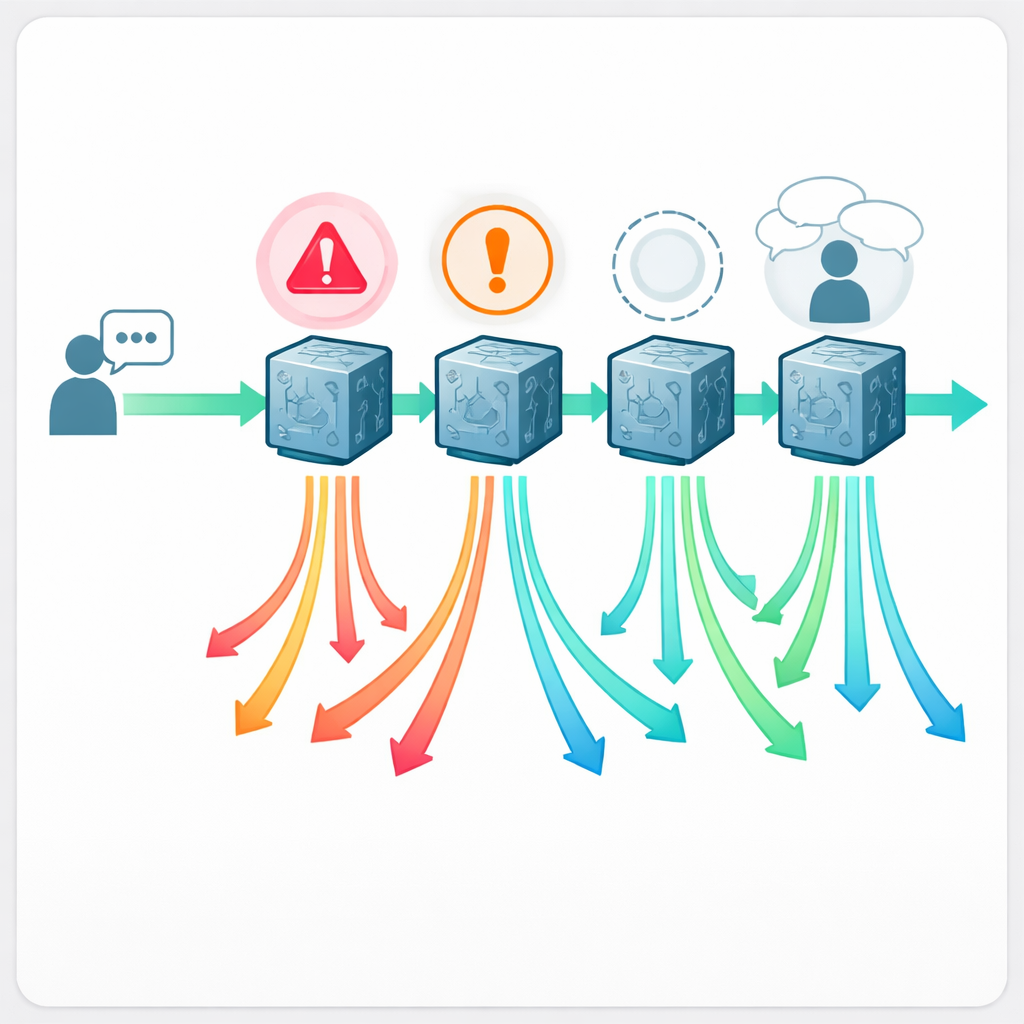

Naukowcy stworzyli nowy zbiór 222 naturalnie brzmiących pytań zdrowotnych nazwany HealthAdvice. Pytania odzwierciedlają to, co ktoś mógłby wpisać w pole wyszukiwania: krótkie, prostym językiem, np. jak leczyć gorączkę u niemowlęcia, ból piersi, dolegliwości w ciąży czy nagłą zmianę stolca. Skoncentrowali się na powszechnych obszarach podstawowej opieki — medycynie wewnętrznej, zdrowiu kobiet i pediatrii — gdzie ludzie często szukają szybkiej porady w domu. Dla każdego pytania poprosili cztery szeroko używane czatboty — Claude, Gemini, GPT‑4o i Llama‑3.0/3.1‑70B — o odpowiedź bez specjalnych wskazówek, tak jak zrobiłby to zwykły pacjent.

Jak lekarze oceniali odpowiedzi

Szesnastu certyfikowanych lekarzy, nie wiedząc, który czatbot wygenerował którą odpowiedź, oceniło wszystkie 888 reakcji. Każda odpowiedź została oznaczona jako „akceptowalna” lub „problemowa” i oceniona w pięciopunktowej skali jakości. Gdy odpowiedź była problemowa, lekarze oznaczali, co poszło nie tak: czy jej stosowanie było faktycznie niebezpieczne, wyraźnie fałszywe lub wprowadzające w błąd, brakowało istotnych informacji, czy nie zadano podstawowych pytań uzupełniających (wywiad), których nigdy nie pominąłby ludzki klinicysta? Dzięki temu zespół mógł nie tylko policzyć błędy, ale też zmapować konkretne wzorce porażek, które mają znaczenie w opiece w rzeczywistym świecie.

Jak często porady zawodzą

Wyniki pokazują, że uzyskiwanie pomocy medycznej od czatbota jest dalekie od bezryzykownego. W zależności od systemu od około jednej na pięć do niemal jednej na dwie odpowiedzi uznano za problemowe. Claude wypadł najlepiej — 21,6% odpowiedzi problemowych, podczas gdy Llama wypadł najgorzej — 43,2%. W skali jakości Claude również przodował, a Llama pozostawał w tyle. Co najbardziej niepokojące, od 5% do 13% odpowiedzi oceniono jako wprost niebezpieczne — zawierały zalecenia, które mogłyby prawdopodobnie doprowadzić do poważnych szkód, gdyby zostały zastosowane. Przykłady obejmowały sugerowanie niebezpiecznych leków przeciwbólowych dla karmiących rodziców, informowanie opiekunów, że można podać mleko odciągnięte z piersi z aktywnymi zmianami opryszczkowymi, doradzanie olejku z drzewa herbacianego w pobliżu oka czy proponowanie domowych środków dla niemowląt, które mogłyby zaburzyć równowagę soli i prowadzić do śmierci.

Ukryte niebezpieczeństwa pod tonem uspokajającym

Ponad dramatycznymi błędami lekarze zauważyli subtelniejsze, lecz istotne problemy. Wiele odpowiedzi pomijało niezbędne pytania uzupełniające i zakładało, że samo-diagnoza pacjenta jest poprawna — na przykład traktując „rwy kulszowej w ciąży” jako prosty ból nerwu, jednocześnie ignorując możliwość przedwczesnego porodu. Inne pomijały kluczowe ostrzeżenia „czerwone flagi”, takie jak kiedy poronienie wymaga pilnej opieki, lub jakie objawy po połknięciu monety wskazują na prawdziwy stan zagrożenia, np. przyciśniętą baterię guzikową w przełyku. Część porad traktowała wszystkich czytelników jak wymiennych, zalecając zmiany diety lub suplementy, które byłyby niebezpieczne dla osób z chorobami nerek lub innymi schorzeniami. Choć nie każdy pacjent doznałby szkody, lekarze podkreślili, że nawet niewielki odsetek takich błędów przekłada się na miliony niebezpiecznych odpowiedzi, kiedy dziesiątki milionów ludzi zadają pytania medyczne co miesiąc.

Co to oznacza dla przyszłości asystentów zdrowotnych opartych na AI

Autorzy wnioskują, że obecne ogólnego przeznaczenia czatboty nie są gotowe, by działać jako niestrzeżeni lekarze online. Nawet najlepiej radzący sobie system w badaniu nadal generował na tyle często niebezpieczne porady, by budzić obawy na skalę populacyjną, a wszystkie cztery wykazywały powtarzające się słabości w podstawowym rozumowaniu klinicznym i zbieraniu wywiadu. Jednak badanie nie jest w pełni pesymistyczne. Zespół argumentuje, że przy lepszym treningu, kontrolach bezpieczeństwa i projektach zmuszających modele do zadawania pytań wyjaśniających, AI mogłaby ostatecznie stać się potężnym „lekarzem w kieszeni”, pomagającym ludziom rozumieć swoje zdrowie bez zastępowania rzeczywistych klinicystów. Do tego czasu odpowiedzi czatbotów powinny być traktowane jako punkt wyjścia do rozmowy — nie jako ostateczne decyzje medyczne — i pacjenci oraz systemy opieki zdrowotnej muszą rozpoznać zarówno obietnicę, jak i bardzo realne ryzyka tej nowej formy poszukiwania pomocy.

Cytowanie: Draelos, R.L., Afreen, S., Blasko, B. et al. Large language models provide unsafe answers to patient-posed medical questions. npj Digit. Med. 9, 241 (2026). https://doi.org/10.1038/s41746-026-02428-5

Słowa kluczowe: czatboty medyczne, bezpieczeństwo pacjentów, sztuczna inteligencja w opiece zdrowotnej, duże modele językowe, porady zdrowotne online