Clear Sky Science · pl

Stymulacja wizualna sterowana anatomią dla międzymodalnego rozumienia raka piersi

Inteligentniejsze badania przesiewowe dla powszechnego nowotworu

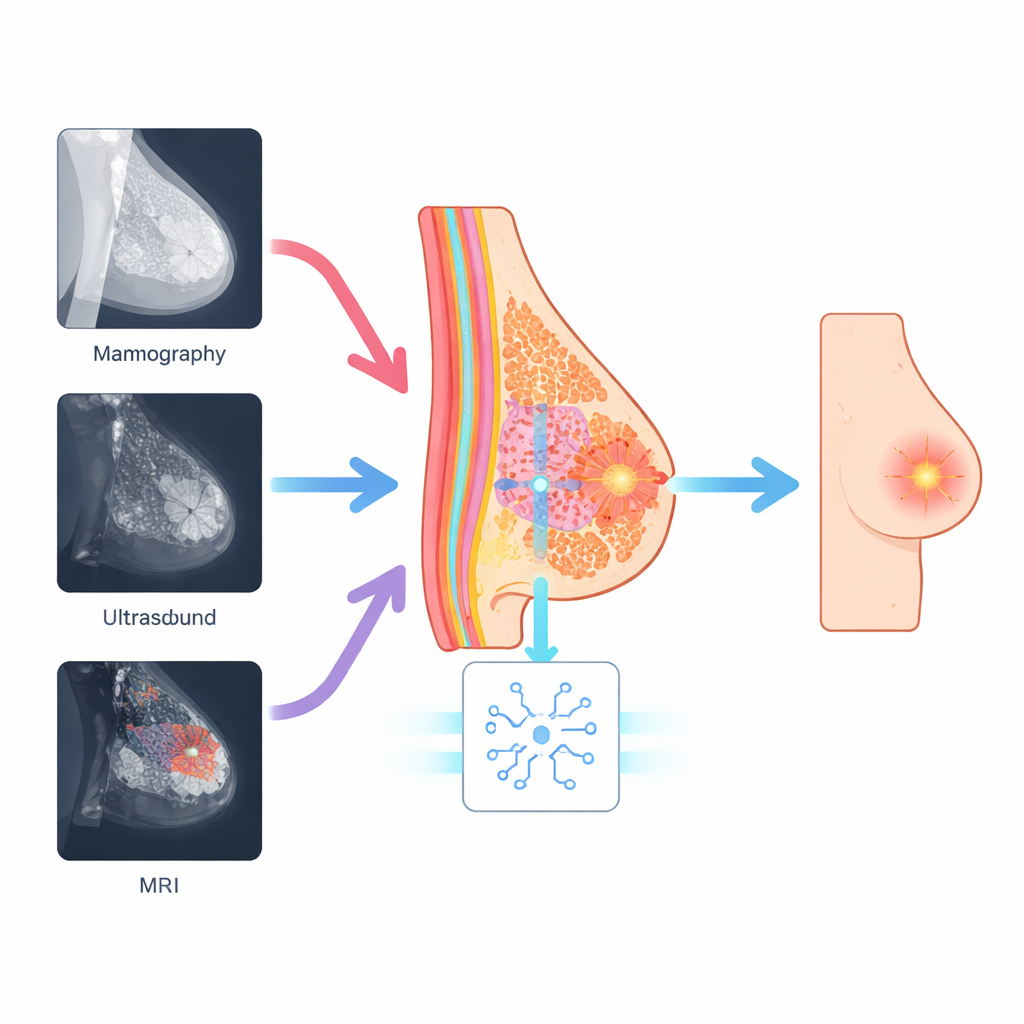

Rak piersi jest jedną z głównych przyczyn zgonów z powodu nowotworów u kobiet, a lekarze coraz częściej polegają na programach komputerowych pomagających interpretować złożone obrazy medyczne. Jednak mammogramy, badania ultrasonograficzne i rezonans magnetyczny przedstawiają pierś w bardzo odmienny sposób, co utrudnia obecnym systemom sztucznej inteligencji zachowanie niezawodności między różnymi urządzeniami i szpitalami. To badanie przedstawia nowe podejście AI, które „myśli” w kategoriach leżącej u podstaw anatomii piersi, zamiast polegać wyłącznie na wzorach jasności w obrazach, co prowadzi do dokładniejszego i bardziej spójnego wykrywania podejrzanych obszarów.

Dlaczego różne badania wprowadzają komputery w błąd

Mammografia, ultradźwięki i MRI wykorzystują różne zasady fizyczne do oglądania wnętrza piersi. Nowotwór, który na obrazie USG pojawia się jako jasny punkt, może na mammogramie ujawniać się jako subtelny cień, a w MRI jako świecąca przestrzeń. Wiele współczesnych systemów AI, w tym potężne transformatory wizji i modele wizja–język, uczy się głównie na podstawie ogólnego wyglądu obrazu. Często przegapiają drobne, lecz istotne szczegóły, takie jak mikrokalkifikacje czy nieregularne granice, a ich wydajność może gwałtownie spadać po przeniesieniu między typami aparatów czy placówkami. Ta rozbieżność między warunkami treningu a rzeczywistymi klinikami ogranicza zaufanie lekarzy do takich narzędzi.

Wykorzystanie samej piersi jako przewodnika

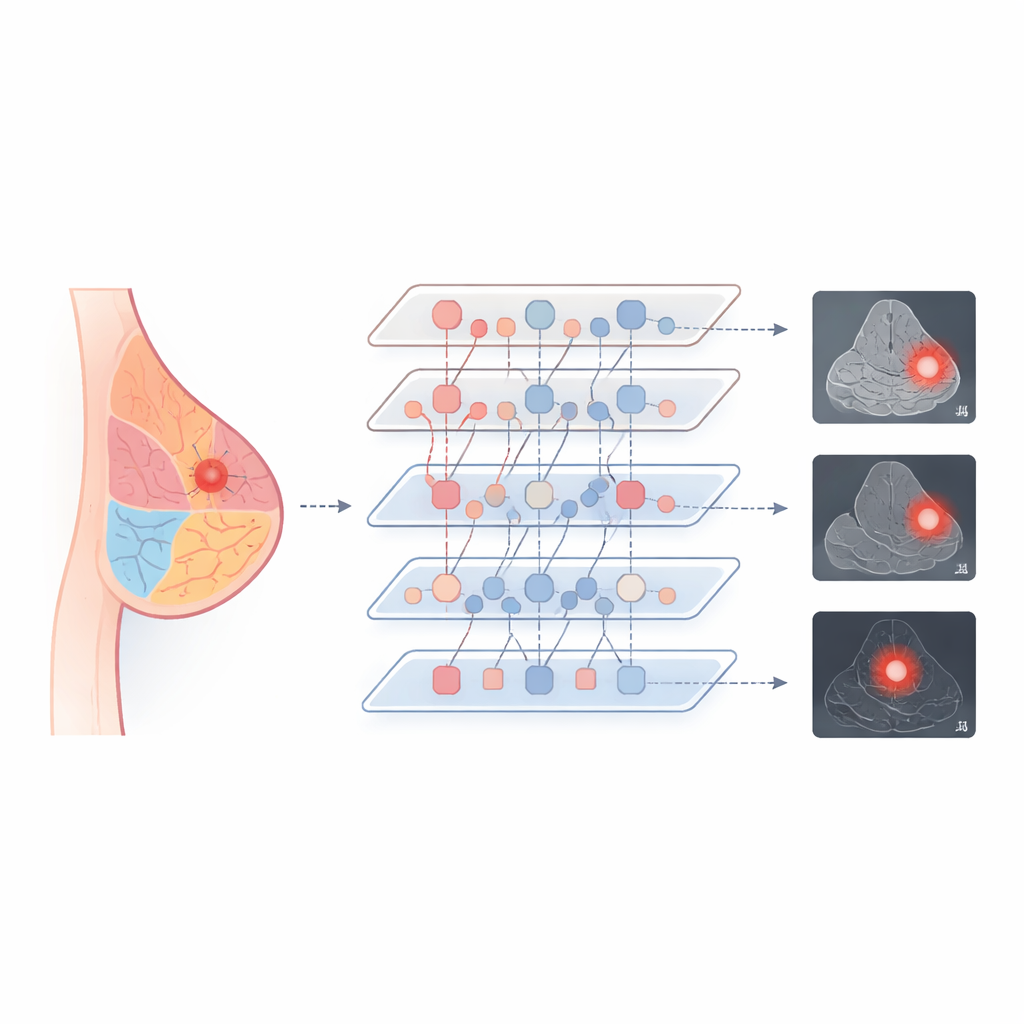

Badacze argumentują, że chociaż obrazy wyglądają inaczej, rzeczywista biologia piersi nie zmienia się między badaniami. Każde zdjęcie nadal zawiera tkankę gruczołową, tłuszcz i struktury przewodowe ułożone w rozpoznawalny sposób. Ich metoda, nazwana Anatomy-Guided Visual Prompt Tuning (A-VPT), wbudowuje tę podstawową mapę piersi bezpośrednio w model AI. Zamiast dostosowywać miliony wewnętrznych wag, system dodaje niewielki zestaw dodatkowych sygnałów „podpowiedzi”, które mówią sieci, które obszary tkanki ogląda. Te podpowiedzi są generowane z grubszych map anatomicznych lub wyuczonych cech tkankowych i następnie wstrzykiwane warstwa po warstwie do zamrożonego, wstępnie wytrenowanego transformera. W praktyce model jest nieustannie przypominany, gdzie znajdują się przewody, gruczoły i tłuszcz, dzięki czemu może oceniać podejrzane obszary w odpowiednim kontekście.

Nauczanie jednego systemu wielu „języków” obrazowania

Aby model działał w różnych rodzajach obrazowania, zespół zaprojektował schemat treningowy, który zmusza AI do traktowania podobnych tkanek w podobny sposób, niezależnie od sposobu ich zobrazowania. Wyrównują wewnętrzne odciski palców regionów tłuszczowych, gruczołowych i przewodowych pochodzących z mammografii, USG i MRI, zbliżając je do siebie w wspólnej przestrzeni. Gdy dostępne są raporty tekstowe, system łączy te wzorce tkankowe z krótkimi opisowymi frazami, wiążąc cechy wizualne z językiem medycznym. Podczas przetwarzania specjalizowane moduły interakcji pozwalają podpowiedziom anatomicznym i cechom obrazu wymieniać się informacjami w obu kierunkach, z krokiem bramkowania kontrolującym, jak silnie anatomia wpływa na każdą warstwę. To połączenie pomaga modelowi koncentrować się na właściwych strukturach, pozostając jednocześnie stabilnym i wydajnym.

Lepsza dokładność przy mniejszej ingerencji

Autorzy przetestowali A-VPT na trzech dobrze znanych zbiorach obrazów piersi obejmujących wszystkie trzy modalności. W porównaniu z tradycyjnymi sieciami głębokimi i kilkoma popularnymi sposobami dopasowywania dużych modeli, ich metoda osiągnęła najwyższe wyniki zarówno w klasyfikacji zmian jako łagodnych lub złośliwych, jak i w wytyczaniu ich granic. Radziła sobie szczególnie dobrze, gdy proszono ją o wykorzystanie wiedzy z jednego typu badania do interpretacji innego — na przykład trenowanie na mammografiach, a potem ocenianie na USG — gdzie starsze metody często zawodziły. Co zaskakujące, A-VPT osiągnęła te wyniki, aktualizując mniej niż 2% parametrów modelu, co zmniejsza zapotrzebowanie na obliczenia i ułatwia wdrożenie w rzeczywistych szpitalach. Wizualizacje miejsc, na które model „patrzył”, pokazały, że koncentrował się on na realistycznych obszarach gruczołowych i okołoguzkowych, sugerując, że jego decyzje są zbieżne z rozumowaniem radiologów.

Co to oznacza dla pacjentów i klinik

Mówiąc prosto, ta praca pokazuje, że uczenie systemów AI o podstawowej anatomii może uczynić je jednocześnie mądrzejszymi i bardziej zrozumiałymi. Kotwicząc rozumowanie w rzeczywistej strukturze piersi, A-VPT lepiej wykrywa i obrysowuje guzy w różnych metodach obrazowania, przy mniejszej liczbie dostosowań i bardziej przejrzystym zachowaniu. Jeśli zostanie to dalej zweryfikowane, ta strategia mogłaby wspierać bardziej spójne badania przesiewowe i diagnostykę w zróżnicowanych warunkach — od dużych ośrodków medycznych po mniejsze kliniki — i mogłaby zostać rozszerzona na inne narządy, takie jak płuca czy wątroba. Ostatecznie AI świadoma anatomii może stać się kluczowym partnerem we wcześniejszym i bardziej niezawodnym wykrywaniu raka.

Cytowanie: Zhao, S., Meng, Q., He, Y. et al. Anatomy-guided visual prompt tuning for cross-modal breast cancer understanding. npj Digit. Med. 9, 240 (2026). https://doi.org/10.1038/s41746-026-02417-8

Słowa kluczowe: obrazowanie raka piersi, medyczna sztuczna inteligencja, transformery wizji, uczenie międzymodalne, podpowiedzi sterowane anatomią