Clear Sky Science · pl

Niezależna i wspólna wydajność dużych modeli językowych i pracowników służby zdrowia w diagnostyce i triage

Dlaczego ma to znaczenie przy Twojej następnej wizycie u lekarza

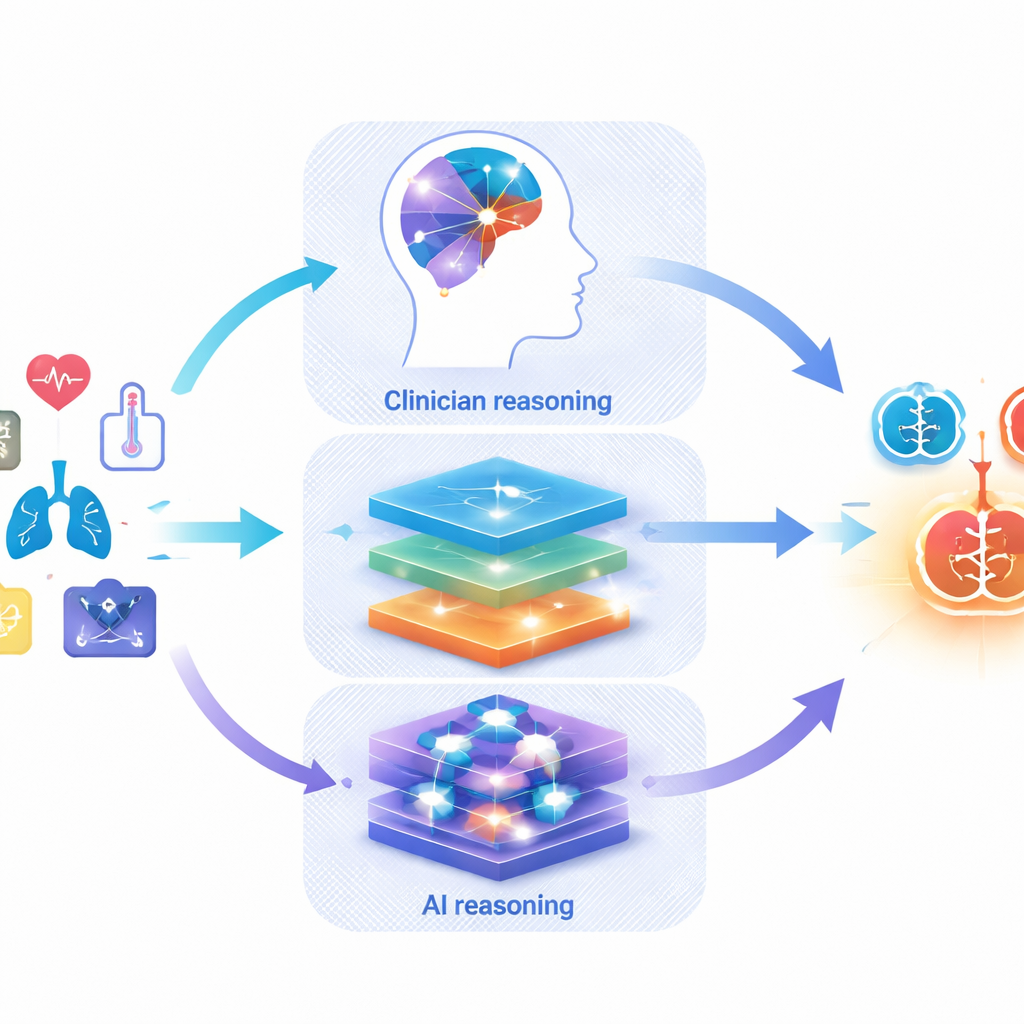

Kiedy wpisujesz objawy do internetowego chatu lub pytasz aplikację AI, co może być nie tak, korzystasz z tej samej technologii, którą lekarze testują teraz w szpitalach: dużych modeli językowych (LLM). Badanie stawia proste, lecz kluczowe pytanie: jak dobrze te narzędzia faktycznie rozpoznają choroby i oceniają pilność przypadków w porównaniu z prawdziwymi pracownikami służby zdrowia — i co się dzieje, gdy obie strony współpracują?

Jak naukowcy spojrzeli na problem z szerokiej perspektywy

Autorzy nie testowali jednego chatbota w jednej klinice. Zamiast tego połączyli dowody z 50 oddzielnych badań przeprowadzonych na całym świecie w latach 2020–2025. Badania obejmowały wiele specjalności, od chorób oczu i obrazowania mózgu po opiekę ratunkową. W każdym z nich lekarzom i jednemu lub kilku LLM przedstawiono te same opisy rzeczywistych lub starannie przygotowanych przypadków pacjentów. Modele musiały zasugerować możliwe rozpoznania lub zdecydować, jak pilna jest potrzeba opieki, a lekarze wykonywali te same zadania. W niektórych badaniach lekarzom pokazano także sugestie AI, aby sprawdzić, czy to poprawia ich wyniki.

Jak dobre są systemy AI samodzielnie?

W całym zbiorze badań narzędzia AI często umieszczały właściwe rozpoznanie gdzieś na swojej liście, ale zwykle przegrywały z lekarzami, gdy wymagano wskazania jednej, najlepszej odpowiedzi. Licząc tylko najlepsze trafienie, LLM były średnio o około 11% mniej dokładne niż specjaliści medyczni. W miarę jak dopuszczano dłuższe listy kandydatów, ta różnica malała i ostatecznie znikała — przy liście dziesięciu możliwych rozpoznań systemy AI były przynajmniej tak samo prawdopodobne jak lekarze, by uwzględnić właściwe rozpoznanie. W decyzjach triage — ocenianiu pilności przypadku i potrzebnego poziomu opieki — AI i ludzie radzili sobie łącznie podobnie. Jednak wyniki znacznie różniły się między poszczególnymi modelami i ustawieniami testowymi, co sugeruje, że niektóre narzędzia są znacznie bardziej niezawodne niż inne.

Co się dzieje, gdy lekarze używają AI jako partnera?

Dziewięć badań badało bezpośrednio współpracę: lekarze najpierw pracowali samodzielnie, a potem powtarzali zadanie z pomocą LLM. Tutaj wiadomości były zachęcające. Wsparci przez AI lekarze osiągali ogólnie wyższą dokładność, szczególnie gdy mogli podać kilka możliwych rozpoznań. Na przykład z pomocą LLM ich trafność dla krótszych list kandydatów poprawiała się o około 10–40%, w zależności od liczby rozważanych opcji. To sugeruje, że AI jest szczególnie użyteczna jako partner do „burzy mózgów”, rozszerzający zakres możliwości i skłaniający klinicystów do rozważenia mniej oczywistych stanów, podczas gdy ostateczną decyzję nadal podejmuje ekspert ludzki.

Dlaczego dzisiejsze wyniki mogą wyglądać lepiej niż życie w rzeczywistości

Mimo obiecujących danych autorzy ostrzegają, że większość istniejących badań jest daleka od ideału. Wiele opierało się na uporządkowanych, podręcznikowych streszczeniach przypadków lub rzadkich przypadkach wybranych do celów dydaktycznych, a nie na chaotycznych, niepełnych historiach, z jakimi pacjenci trafiają do prawdziwych przychodni. Niewiele badań obejmowało pacjentów w czasie rzeczywistym. Często brakowało szczegółów dotyczących sposobu wyboru przypadków, konfiguracji narzędzi AI i kryteriów oceny odpowiedzi. Informacje wizualne, takie jak skany czy zdjęcia skóry, rzadziej były wykorzystywane, a gdy testowano tylko obrazy, doświadczeni klinicyści wyraźnie przewyższali AI. Badacze podkreślają też, że młodsi i doświadczeni lekarze mogą inaczej reagować na rady AI oraz że kwestie prywatności danych, ukrytych uprzedzeń i nadmiernego zaufania do sugestii maszyn pozostają w codziennej praktyce w dużej mierze nieprzetestowane.

Co to oznacza dla pacjentów i przyszłości opieki

Ogólnie rzecz biorąc, badanie sugeruje, że obecne chatboty i LLM nie są gotowe, by zastąpić Twojego lekarza, lecz wkrótce mogą stać się wartościowymi asystentami. Rozsądnie używane, mogą pomóc wygenerować szersze listy możliwych rozpoznań i wspierać dokładniejsze podejmowanie decyzji, zwłaszcza gdy lekarze pozostają przy sterach i traktują AI jako drugą opinię, a nie ostateczny wyrok. Zanim jednak narzędzia te zostaną włączone do rutynowej opieki, autorzy argumentują, że potrzebne są lepiej zaprojektowane badania w warunkach rzeczywistych, jaśniejsze standardy raportowania oraz silne zabezpieczenia dotyczące bezpieczeństwa, uczciwości i prywatności. Dla pacjentów oznacza to, że AI może ostatecznie pomóc zespołowi opieki myśleć szerzej i działać szybciej, ale każdy wiarygodny system musi być testowany równie rzetelnie jak nowy lek czy urządzenie medyczne.

Cytowanie: Chen, M., Wu, Y., Ma, J. et al. Independent and collaborative performance of large language models and healthcare professionals in diagnosis and triage. npj Digit. Med. 9, 222 (2026). https://doi.org/10.1038/s41746-026-02409-8

Słowa kluczowe: sztuczna inteligencja w diagnozie medycznej, triage kliniczny, duże modele językowe, współpraca lekarz–AI, bezpieczeństwo zdrowia cyfrowego