Clear Sky Science · pl

Współpraca człowiek–duży model językowy w medycynie klinicznej: przegląd systematyczny i metaanaliza

Dlaczego to ma znaczenie dla codziennej opieki zdrowotnej

Lekarze coraz częściej sięgają po zaawansowane chatboty oparte na dużych modelach językowych, aby pomóc sobie w analizie skomplikowanych przypadków, pisaniu notatek i interpretacji badań. To badanie stawia proste, ale kluczowe pytanie: czy pacjenci rzeczywiście odnoszą korzyść, gdy lekarze współpracują z tymi narzędziami? Łącząc wyniki najlepszych dostępnych badań, autorzy pokazują, że odpowiedź jest bardziej złożona niż podpowiada szum medialny — czasem taka współpraca pomaga, czasem daje niewielki efekt, a w niektórych sytuacjach może nawet przeszkadzać.

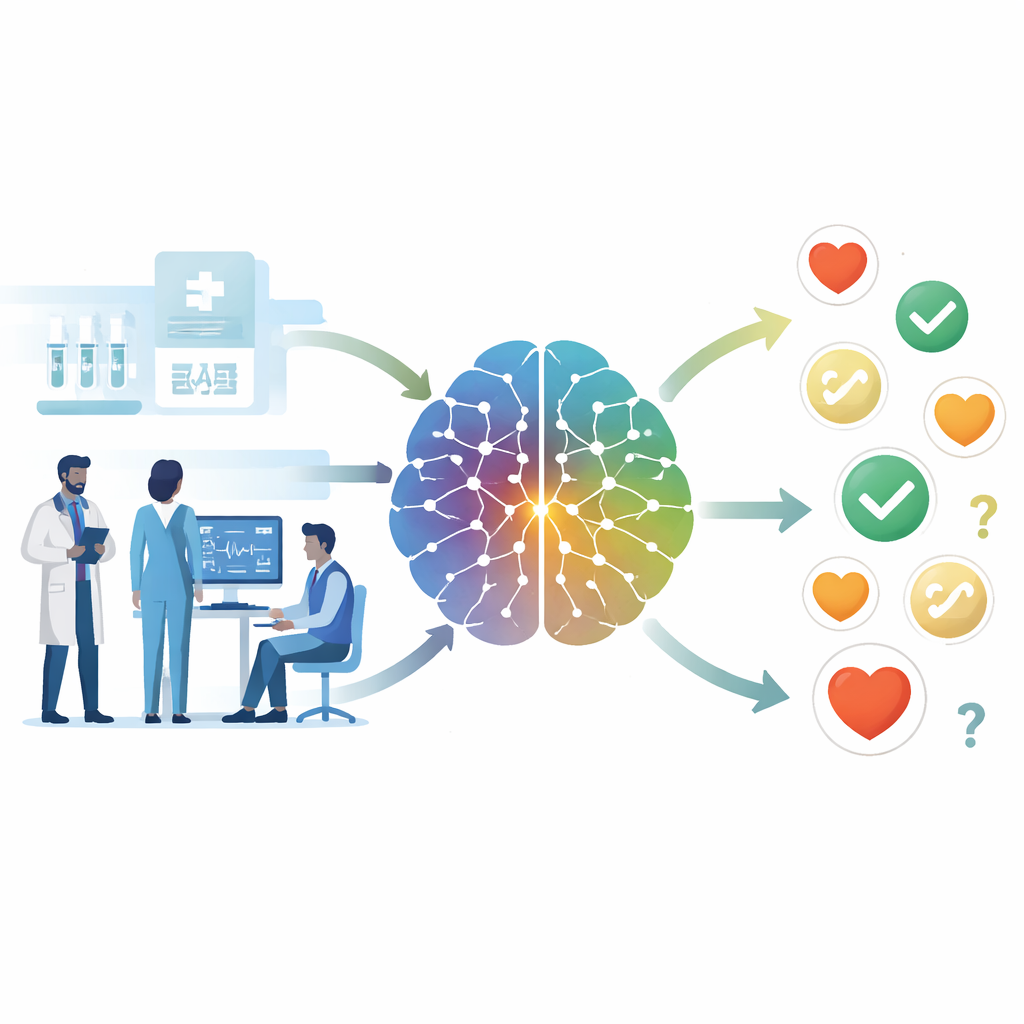

Co badali naukowcy

Zespół systematycznie przeszukał główne bazy medyczne w poszukiwaniu badań, w których klinicyści pracowali z pomocą albo bez pomocy systemu AI opartego na dużych modelach językowych, takich jak GPT‑4. Aby badanie mogło być uwzględnione, musiało bezpośrednio porównywać „lekarz plus AI” z rutynową opieką sprawowaną wyłącznie przez lekarzy, a czasem także z samodzielną pracą AI. Zadania kliniczne obejmowały różnorodne, rzeczywiste problemy: ustalanie przyczyn u pacjenta w stanie krytycznym, interpretację badań obrazowych mózgu, pisanie i odczytywanie notatek z gabinetu oraz decyzje dotyczące postępowania przy bólach w klatce piersiowej i innych częstych dolegliwościach. W sumie 10 recenzowanych badań stanowiło trzon analizy, a kilka dodatkowych preprintów wykorzystano jedynie do sprawdzenia odporności wniosków.

Jak radziły sobie zespoły lekarz–AI

W tych badaniach łączenie lekarzy z AI przynosiło niewielkie, ale zauważalne poprawy w niektórych miarach jakości diagnostyki i zarządzania przypadkiem. W dwóch randomizowanych badaniach, które stosowały szczegółowe systemy punktacji decyzji, zespoły lekarz–AI osiągały wyniki o około pięć punktów procentowych wyższe niż sami lekarze. Mówiąc prościej: jeśli lekarze pracujący samodzielnie podejmowali około 100 kluczowych decyzji, dodanie AI mogło zapobiec mniej więcej pięciu błędom. Autorzy jednak podkreślają, że dane leżące u podstaw tych oszacowań są skąpe: tylko kilka badań przyczyniło się do tych wyników, a zakres możliwych efektów w rzeczywistych warunkach jest wystarczająco szeroki, by obejmować brak korzyści — a nawet szkody — w innych sytuacjach.

Szybkość, dokumentacja i ukryte błędy

Wielu liczy na to, że AI uwolni czas lekarzy. Tutaj dowody były rozczarowujące. Gdy badacze połączyli trzy badania mierzące czas wykonywania zadań, stwierdzili praktycznie brak ogólnych oszczędności czasu. W niektórych symulowanych ćwiczeniach lekarze byli nieco szybsi z AI; w jednym badaniu w realnej przychodni wpływ na długość wizyty był niemal zerowy, choć niektóre podgrupy odnotowały skromne korzyści. Podobnie było z dokumentacją. Wsparcie AI często sprawiało, że notatki wyglądały czyściej i były lepiej uporządkowane, a także pomagało lekarzom niemającym specjalistycznego wykształcenia lepiej rozumieć techniczne raporty okulistyczne. Jednak przy faktograficznej weryfikacji okazało się, że około jedna na trzy notatki wspierane przez AI wciąż zawierała błędy. Ten rozdźwięk — lepiej wyglądające zapisy, które nadal mogą być nieprawidłowe — rodzi oczywiste obawy dotyczące bezpieczeństwa.

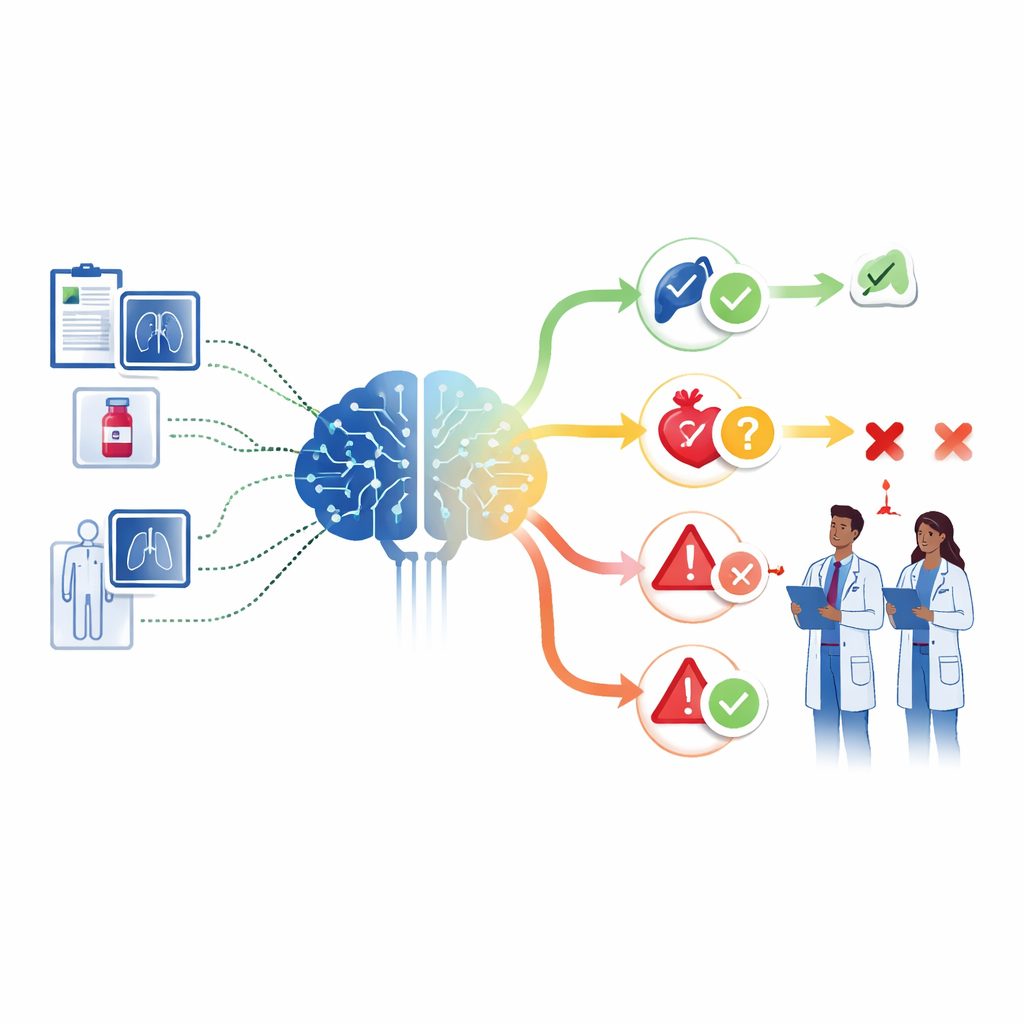

Kiedy współpraca nie przewyższa maszyny

Uderzające wyniki pochodziły z badań, które testowały także samą AI. W jednym badaniu dotyczącym pacjentów w stanie krytycznym AI działająca samodzielnie radziła sobie mniej więcej tak samo jak zespół lekarz–AI, a lepiej niż wielu lekarzy pracujących solo. W innym badaniu raporty generowane przez AI były wyraźnie gorsze niż te przygotowane przez ekspertów ludzkich, niezależnie od tego, czy AI pełniła rolę asystenta. Razem te wyniki uwidaczniają to, co autorzy nazywają „paradoksem współpracy”: samo włączenie człowieka do procesu nie gwarantuje poprawy względem mocnego AI, a w niektórych sytuacjach partnerstwo może rozmywać mocne strony obu stron. Czynnikami wpływającymi na to, czy współpraca pomaga czy przeszkadza, są m.in. sposób prezentacji porad, stopień zaufania (lub braku zaufania) lekarzy do nich oraz sposób integracji narzędzia w codzienny przebieg pracy.

Co to oznacza dla przyszłości zespołów lekarz–AI

Podsumowując, przegląd maluje obraz ostrożnej obietnicy, a nie już osiągniętej rewolucji. Zespoły lekarz–AI mogą w umiarkowany sposób poprawiać niektóre wskaźniki decyzyjne i ułatwiać czytanie tekstów medycznych, ale nie oszczędzają niezawodnie czasu i wciąż generują niepokojącą liczbę błędów faktograficznych. Autorzy argumentują, że systemy opieki zdrowotnej powinny wprowadzać te narzędzia stopniowo, z silnymi zabezpieczeniami koncentrującymi się na wykrywaniu błędów, a nie tylko na zwiększaniu wydajności. Wzywają także do większych, prowadzonych w rzeczywistych warunkach badań klinicznych, które sprawdzą wsparcie AI w zatłoczonych szpitalach i przychodniach, a nie tylko w kontrolowanych symulacjach przypadków. Do czasu pojawienia się takich dowodów najbezpieczniejszą strategią jest traktowanie dużych modeli językowych jako potężnych, lecz omylnych asystentów — oraz projektowanie procesów roboczych tak, by klinicyści pełnili rolę krytycznych recenzentów i strażników, a nie biernych akceptantów porad AI.

Cytowanie: Wang, G., Zhang, K., Jiang, J. et al. Human–large language model collaboration in clinical medicine: a systematic review and meta-analysis. npj Digit. Med. 9, 195 (2026). https://doi.org/10.1038/s41746-026-02382-2

Słowa kluczowe: współpraca człowiek–AI, wsparcie decyzji klinicznych, duże modele językowe, dokładność diagnostyczna, dokumentacja medyczna