Clear Sky Science · pl

Skalowanie nauki regulacyjnej dotyczącej urządzeń medycznych za pomocą dużych modeli językowych

Dlaczego to ma znaczenie dla pacjentów i lekarzy

Współczesna medycyna szybko wypełnia się „inteligentnymi” urządzeniami, które wykorzystują sztuczną inteligencję do odczytywania obrazów, monitorowania parametrów życiowych i wspomagania decyzji lekarzy. Tylko w Stanach Zjednoczonych ponad tysiąc takich narzędzi zostało już zatwierdzonych lub dopuszczonych przez Food and Drug Administration (FDA). Każde urządzenie zostawia ślad w postaci złożonych raportów i rejestrów bezpieczeństwa. Obecnie większość tych informacji wciąż jest przeszukiwana ręcznie, co jest wolne, kosztowne i szybko pozostaje w tyle za rzeczywistością. Artykuł bada, czy duże modele językowe — ten sam typ SI, który stoi za zaawansowanymi chatbotami — potrafią w sposób wiarygodny odczytywać te dokumenty na dużą skalę i przekształcać je w użyteczne dane, które pomogą regulatorom, badaczom i społeczeństwu zrozumieć, jak dobrze te urządzenia są zbudowane i jak bezpiecznie działają.

Problem zbyt wielu złożonych dokumentów

Każde urządzenie medyczne wykorzystujące SI jest opatrzone obszernymi podsumowaniami decyzji, raportami bezpieczeństwa i powiadomieniami o wycofaniu. Dokumenty te są długie, napisane gęstym żargonem i często zawierają tabele, obrazy oraz niespójną strukturę. Poprzednie badania wykazały, że odpowiedzi na podstawowe pytania — na przykład jak urządzenie było testowane przed zatwierdzeniem lub co dokładnie poszło nie tak w przypadku awarii — wymagały zespołów ekspertów czytających setki plików PDF linia po linii. Proste narzędzia wyszukujące i dopasowywanie wzorców potrafią znaleźć oczywiste dane, takie jak numery identyfikacyjne, ale mają problemy z głębszymi pytaniami wymagającymi oceny, takimi jak to, czy badanie prowadzone było wieloośrodkowo, czy urządzenie rzeczywiście przyczyniło się do urazu lub śmierci pacjenta. W miarę jak liczba urządzeń z SI eksplodowała, podejście ręczne stało się niemożliwe do utrzymania.

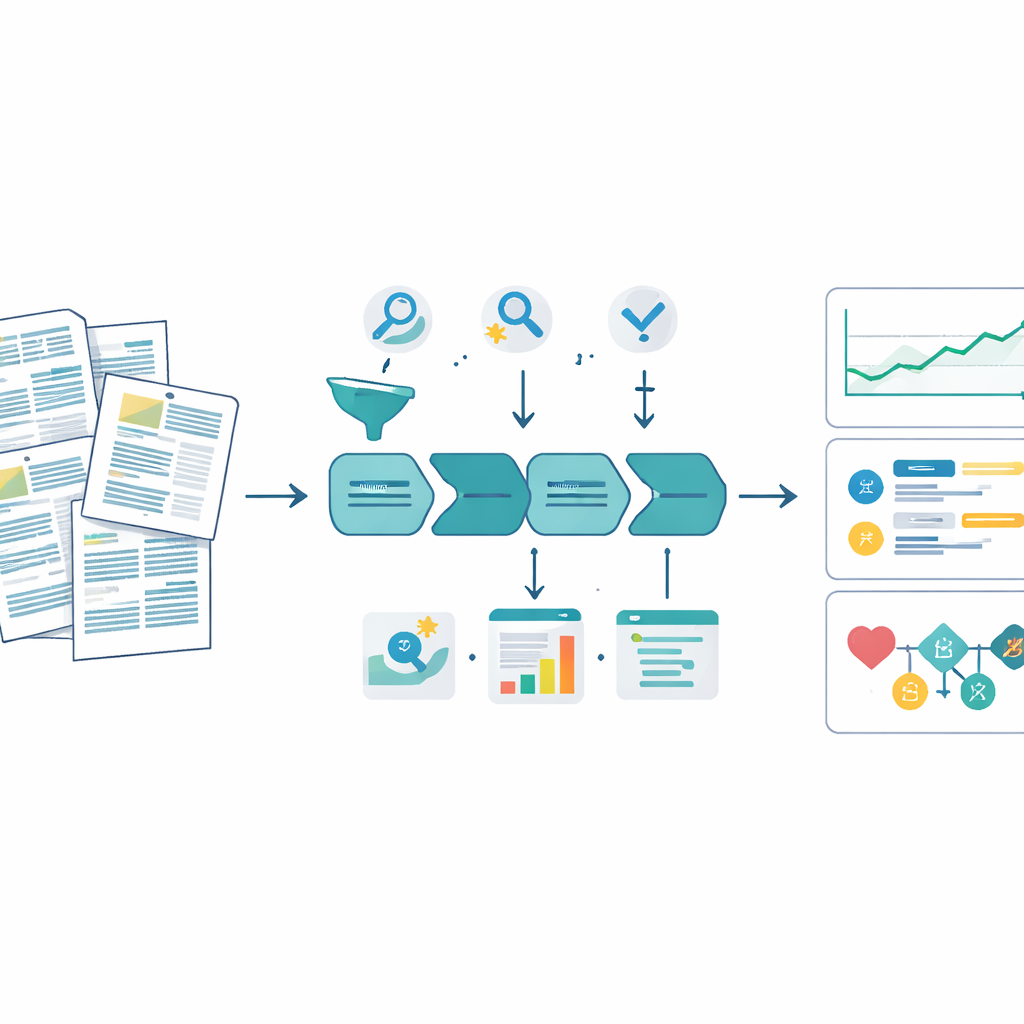

Potok SI, który czyta jak ekspert

Autorzy zbudowali ogólny potok oparty na nowoczesnym dużym modelu językowym, aby sprostać temu wyzwaniu. Najpierw zgromadzili wszystkie publicznie dostępne podsumowania decyzji FDA i raporty bezpieczeństwa dotyczące 1 247 urządzeń AI lub wykorzystujących uczenie maszynowe oraz 1 852 powiązanych zgłoszeń o zdarzeniach niepożądanych do połowy 2025 roku, czyszcząc pliki PDF i używając rozpoznawania optycznego znaków, gdy było to potrzebne. Następnie, zamiast prosić model o jednoczesne odpowiadanie na szerokie pytania, rozbili pracę na mniejsze, dobrze zdefiniowane podzadania. Dla każdego typu dokumentu model otrzymywał szczegółowe instrukcje osadzone w oficjalnych wytycznych FDA oraz przykłady tego, jak ludzie oznaczaliby informacje. Poproszono model o rozumowanie krok po kroku i zwracanie odpowiedzi w ścisłym, ustrukturyzowanym formacie, przekształcając tekst swobodny w jasne pola, takie jak „liczba ośrodków badawczych”, „rodzaj zdarzenia związane z bezpieczeństwem” czy „rodzaj zmiany w urządzeniu”.

Sprawdzanie dokładności na rzeczywistych pytaniach regulacyjnych

Aby ocenić, czy system można zaufać, zespół przeprowadził trzy studia przypadków, w których wcześniejsi badacze spędzili już miesiące na ręcznym przeglądzie. Najpierw ponownie zbadali, jak urządzenia są testowane przed zatwierdzeniem, pytając, czy badania były prowadzone prospektywnie (zbieranie danych w czasie rzeczywistym) i czy obejmowały wiele szpitali. Porównując wyniki modelu z oznaczeniami ekspertów, zaobserwowali często wskaźniki zgodności powyżej 80–90 procent, porównywalne z zgodnością między samymi annotatorami ludzkimi. Po drugie, użyli modelu do ponownego oznakowania raportów bezpieczeństwa opisujących awarie, urazy lub zgony oraz do klasyfikacji, co poszło nie tak z urządzeniem. Gdy recenzenci ludzie porównywali oryginalne kody producenta z tymi sugerowanymi przez model — nie wiedząc, które pochodzą od kogo — w dużej większości przypadków woleli wybory modelu, szczególnie w wrażliwych kategoriach, takich jak rozróżnienie między zgonem a awarią. Po trzecie, badacze powiązali szczegóły z dokumentów przedzatwierdzeniowych z późniejszymi raportami bezpieczeństwa, aby zbadać, które wczesne decyzje — na przykład wybór poprzednika urządzenia z historią wycofań lub wprowadzenie dużych zmian sprzętowych — były statystycznie związane z większym ryzykiem przyszłych problemów.

Co wyniki ujawniają o bezpieczeństwie i nadzorze

Po walidacji potok pozwolił zespołowi rozszerzyć analizy z kilkudziesięciu urządzeń na całą znaną populację narzędzi medycznych z obsługą AI. Na przykład stwierdzili, że prospektywne oceny kliniczne pozostawały stosunkowo rzadkie przez trzy dekady, oscylując wokół jednej na dziesięć urządzeń, podczas gdy wzmianki o testach wieloośrodkowych znacznie wzrosły. W raportach bezpieczeństwa model odkrył wzorce, w których opis problemu w tekście nie zgadzał się z kodem przesłanym do FDA — na przykład sytuacje, w których usterki sprzętowe były oznaczane jako problemy z jakością obrazu. Gdy powiązali cechy przedzatwierdzeniowe z późniejszymi zdarzeniami bezpieczeństwa, urządzenia, których poprzednicy mieli już wycofania lub historię zdarzeń niepożądanych, wykazywały znacznie wyższe ryzyko nowych zgłoszeń, podczas gdy urządzenia poparte badaniami klinicznymi miały tendencję do niższego ryzyka. Wyniki te mają charakter eksploracyjny, ale ilustrują pytania, które teraz można zadawać rutynowo, a nie jako jednorazowe projekty.

Ograniczenia, zabezpieczenia i dalsza droga

Autorzy podkreślają, że ich podejście nie jest bezbłędne i nie powinno zastępować oceny ekspertów. Dokładność rzędu 80 procent może być wystarczająca do analizy trendów na dużą skalę, ale nie do podejmowania decyzji dotyczących pojedynczego urządzenia czy pacjenta. Wydajność może się różnić w zależności od typu urządzenia i roku, a jakość bazowych dokumentów FDA i baz danych bezpieczeństwa pozostaje istotnym wąskim gardłem. Mimo to badanie pokazuje, że starannie zaprojektowane systemy oparte na modelach językowych potrafią zamienić góry nieustrukturyzowanego tekstu regulacyjnego w strukturalne, audytowalne dane w ciągu dni zamiast lat. Dla czytelników niebędących ekspertami najważniejszy wniosek jest taki, że te same technologie SI, które napędzają konsumenckie chatboty, mogą również pomóc strażnikom i badaczom śledzić, jak urządzenia medyczne z AI są budowane, testowane i monitorowane — co potencjalnie prowadzi do szybszego wykrywania problemów i lepszych dowodów do kształtowania bezpieczniejszych zasad i produktów.

Cytowanie: Li, H., He, X., Subbaswamy, A. et al. Scaling medical device regulatory science using large language models. npj Digit. Med. 9, 221 (2026). https://doi.org/10.1038/s41746-026-02353-7

Słowa kluczowe: urządzenia medyczne AI, nauka regulacyjna, duże modele językowe, raporty bezpieczeństwa FDA, nadzór nad technologiami zdrowotnymi