Clear Sky Science · pl

Fuzja multimodalna modeli podstawowych patologii i radiologii dla podtypowania glejaków według WHO 2021

Łączenie dwóch perspektyw na nowotwory mózgu

Gdy u osoby rozpoznaje się nowotwór mózgu, lekarze muszą wiedzieć nie tylko, że guz istnieje, lecz jaki to dokładnie typ. Różne typy guzów reagują bardzo odmiennie na zabieg chirurgiczny, radioterapię czy leki. Obecnie szczegółowe „podtypowanie” zwykle wymaga badań genetycznych, które mogą być czasochłonne, kosztowne i nie wszędzie dostępne. W tej pracy badano, czy inteligentny system komputerowy analizujący zarówno badania obrazowe mózgu, jak i mikroskopowe zdjęcia tkanki nowotworowej, może wiarygodnie odczytać te podtypy, potencjalnie przyspieszając i poszerzając dostęp do terapii precyzyjnej.

Dlaczego typ guza ma znaczenie

Rozlane glejaki dorosłych należą do najbardziej śmiercionośnych nowotworów mózgu, a mimo to często wyglądają podobnie w standardowych skanach i pod mikroskopem. Współczesne wytyczne dzielą je na trzy podtypy genetyczne, które znacznie różnią się złośliwością i przewidywanym czasem przeżycia. Obecny złoty standard rozróżniania tych podtypów opiera się na badaniach molekularnych DNA guza. Wymagają one dodatkowej tkanki, specjalistycznych laboratoriów i oczekiwania od kilku dni do tygodni na wyniki. Autorzy stawiają pytanie, czy rutynowo zbierane obrazy rezonansu magnetycznego (MRI) i cyfrowe skany patologiczne da się połączyć, aby wydobyć wystarczająco dużo informacji, by zastąpić część tego genetycznego dochodzenia.

Nauczanie maszyn czytania skanów i preparatów

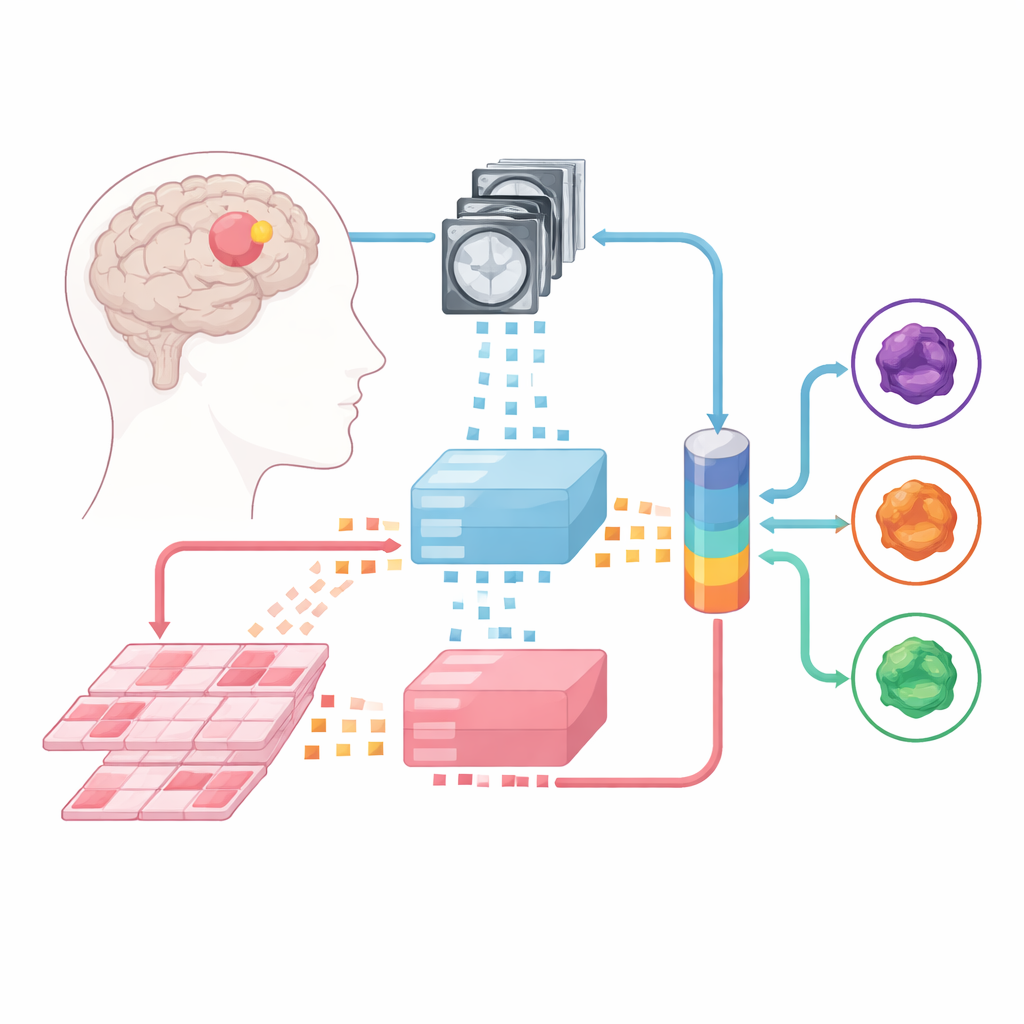

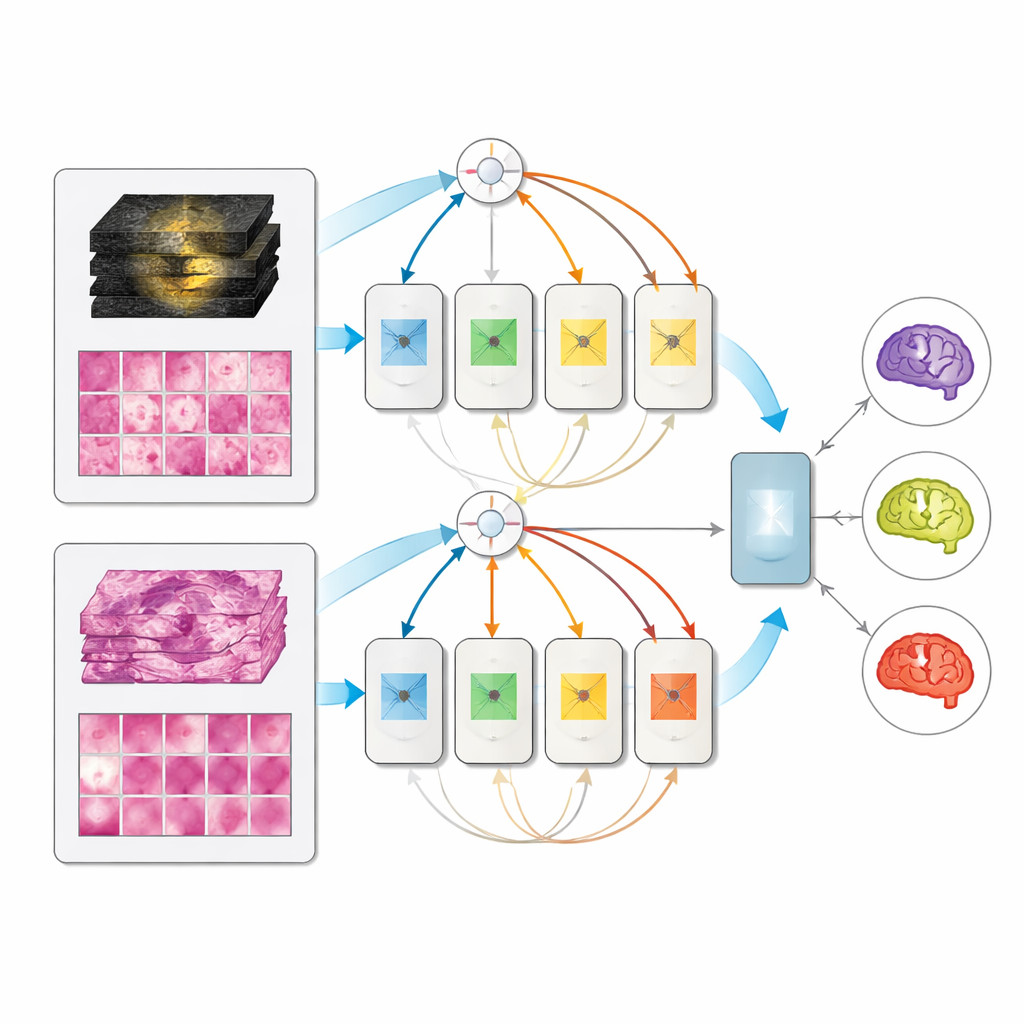

Zespół rozwinął prace o duże „modele podstawowe” – zaawansowane analizatory obrazów uprzednio wytrenowane na ogromnych zbiorach obrazów medycznych. Jeden taki model przetwarza wieloparametryczne MRI, a inny obsługuje wysokorozdzielcze skany patologiczne z tkanki nowotworowej. Każdy przypadek dzielony jest na małe fragmenty obrazu, które modele podstawowe konwertują na numeryczne „odciski palców”. Na bazie tych stałych „ekspertów” badacze wytrenowali trzy typy modeli fuzji, uczących się łączyć informacje z MRI i patologii: architekturę late-fusion, early-fusion oraz bardziej elastyczny model mixture-of-experts, który dynamicznie decyduje, na które źródło zaufać bardziej.

Mieszanie modalności bez parowania pacjentów

Praktyczną przeszkodą dla metod multimodalnych jest to, że szpitale rzadko dysponują dużymi zestawami danych, w których każdy pacjent ma jednocześnie sparowane obrazy MRI i patologiczne. Zamiast polegać na idealnie dopasowanych danych, autorzy zebrali oddzielne kolekcje: setki przypadków MRI z kilku ośrodków i setki przypadków patologicznych z innego źródła, a także mniejszy zbiór 171 pacjentów z publicznego projektu onkologicznego, którzy mieli oba rodzaje badań. Podczas treningu często łączyli MRI jednej osoby ze skanem patologii innej, pod warunkiem że guzy należały do tego samego podtypu. Co zaskakujące, modele trenowane na takich „nieparowanych” danych działały równie dobrze jak te trenowane na prawdziwych parach pacjentów i wyraźnie lepiej niż proste uśrednienie dwóch oddzielnych modeli jednomodalnych.

Pojedynczy model dostosowujący się do dostępnych danych

Na wydzielonym zbiorze 171 w pełni scharakteryzowanych pacjentów wszystkie modele multimodalne przewyższały odpowiedniki jednowchodowe, a konstrukcja mixture-of-experts osiągnęła najlepsze wyniki, uzyskując bardzo wysokie wskaźniki w rozróżnianiu trzech podtypów. Co ważne, gdy podczas testów dostępne było tylko MRI lub tylko badanie patologiczne, model multimodalny nie zawodził; działał mniej więcej tak samo dobrze jak wyspecjalizowane modele jednomodalne. Oznacza to, że klinika mogłaby wdrożyć jeden zunifikowany system wykorzystujący dowolnie dostępne informacje — same skany przedoperacyjne, sama tkankę po zabiegu lub obie te formy — zamiast utrzymywać oddzielne narzędzia dla każdego scenariusza.

Widzimy, co model widzi

Aby zbudować zaufanie do decyzji systemu, badacze zbadali, gdzie model „patrzy” i które cechy obrazu mają największe znaczenie. Mapy uwagi pokazały, że model wspólny rozkłada fokus szerzej w obrębie guza i jego otoczenia, zarówno w MRI, jak i na preparatach, a bardziej rozproszone skupienie często pokrywało się z poprawnymi przewidywaniami. Głębsza analiza wyuczonych cech ujawniła wzorce zgodne z znanymi wskazówkami medycznymi: np. cechy MRI podkreślające kontrastujące jądra guzów i zniekształcone przestrzenie płynowe pomagały oddzielić bardziej agresywne guzy, podczas gdy cechy tkankowe uchwytujące charakterystyczne kształty komórek i tekstury pomagały rozpoznawać konkretne podtypy glejaków. Pojawiły się też interesujące luki: model nie kodował silnie niektórych podręcznikowych oznak najbardziej agresywnych nowotworów, co wspiera tezę, że często traktuje tę grupę jako „domyślną”, chyba że istnieją mocne dowody na korzystniejszy podtyp.

Co to może znaczyć dla pacjentów

Mówiąc prosto, praca ta pokazuje, że system AI łączący skany mózgu i obrazy mikroskopowe może klasyfikować nowotwory mózgu dokładniej niż systemy analizujące tylko jeden typ obrazu, i że można go wytrenować nawet wtedy, gdy dwa typy obrazów nie pochodzą od tych samych pacjentów. Jeśli zostanie dalej zweryfikowany na większych i bardziej zróżnicowanych populacjach, takie narzędzie mogłoby pomóc lekarzom wcześniej i szerzej oszacować podtyp guza, zwłaszcza w miejscach, gdzie badania genetyczne są ograniczone. Nie zastąpiją one testów molekularnych, ale mogą służyć jako szybkie, niskokosztowe wskazówki kierujące chirurgów i onkologów ku najbardziej prawdopodobnemu rozpoznaniu i odpowiedniej ścieżce leczenia.

Cytowanie: Saueressig, C., Scholz, D., Raffler, P. et al. Multimodal fusion of pathology and radiology foundation models for WHO 2021 glioma subtyping. npj Precis. Onc. 10, 118 (2026). https://doi.org/10.1038/s41698-026-01366-5

Słowa kluczowe: podtypowanie glejaków, obrazowanie multimodalne, sztuczna inteligencja, MRI i patologia, diagnoza raka mózgu