Clear Sky Science · pl

Przemyśl inżynierię kontekstu z użyciem architektury opartej na uwadze

Dlaczego inteligentniejsze programy-asystenci mają znaczenie

Każde kliknięcie w aplikacji biznesowej — logowanie, przesłanie pliku, uruchomienie raportu — zostawia ślad. Gdyby oprogramowanie potrafiło niezawodnie przewidzieć twój następny ruch, mogłoby wczytywać dane z wyprzedzeniem, podsuwać skróty i reagować niemal natychmiast. W artykule badanym tutaj zaproponowano nowy sposób uczenia komputerów rozumienia takich śladów działań, tak aby asystenci cyfrowi mogli przewidywać, co zrobisz dalej, co próbujesz osiągnąć i kiedy zamierzasz zakończyć pracę.

Od prostych łańcuchów do złożonych wzorców

Wiele istniejących systemów zgadujących kolejny krok użytkownika opiera się na łańcuchach Markowa, klasycznym narzędziu matematycznym, które bierze pod uwagę tylko ostatnie działanie, by przewidzieć następne. Choć szybkie i wygodne, podejście to z pamięcią jednego kroku zawodzi w rzeczywistych środowiskach pracy, gdzie zadania takie jak budowa potoku uczenia maszynowego czy przygotowanie pulpitu analiz rozciągają się na wiele kroków i obejmują różne narzędzia. Autorzy argumentują, że takie proste modele pomijają długodystansową strukturę, radzą sobie tylko z jednym celem predykcyjnym naraz i trudno je porównywać między badaniami, ponieważ zwykle zależą od prywatnych logów i nieprzejrzystych decyzji dotyczących czyszczenia danych.

Nowy schemat uczenia wielozadaniowego

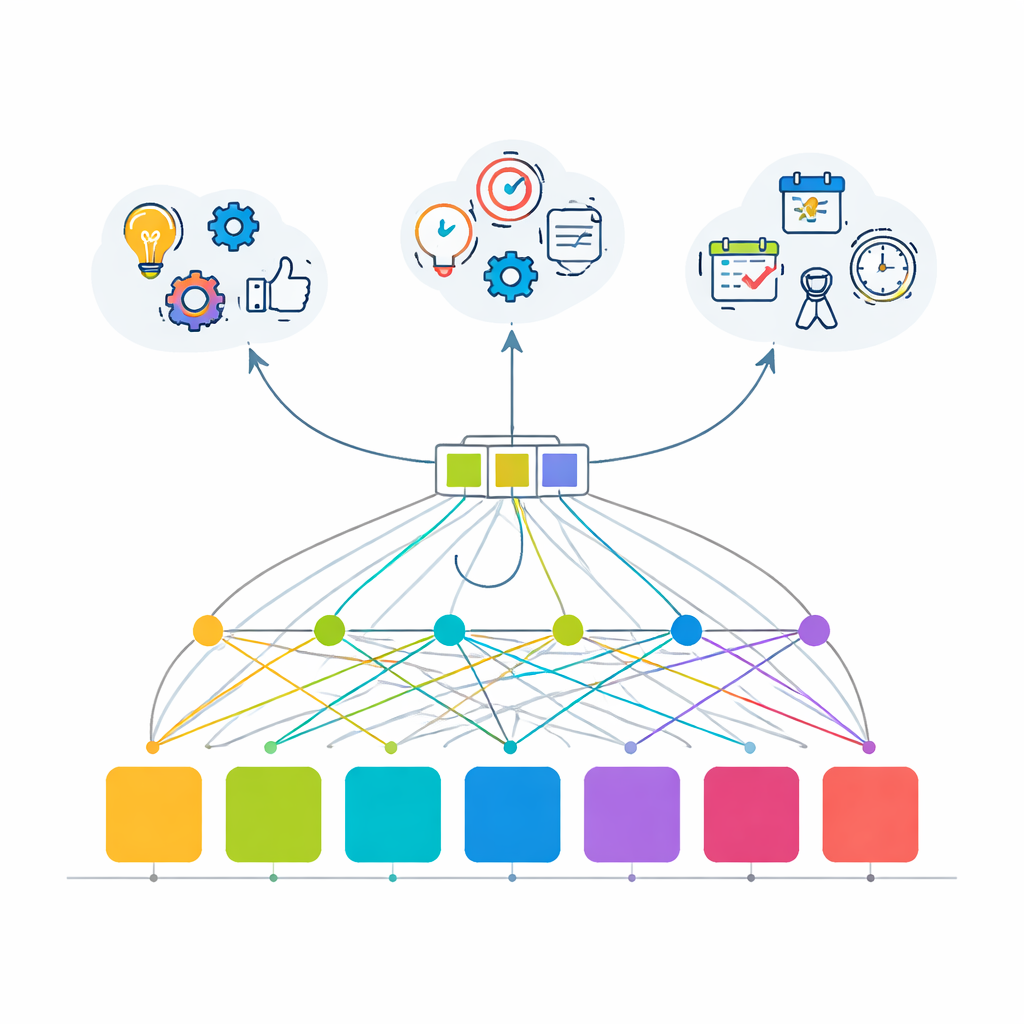

Aby przezwyciężyć te ograniczenia, artykuł przedstawia model typu transformer oparty na mechanizmie uwagi — tę samą rodzinę technik, która stoi za współczesnymi narzędziami językowymi — zaadaptowany do zachowań użytkowników. Zamiast uczyć się tylko jednej rzeczy, model jest trenowany do jednoczesnego rozwiązywania trzech powiązanych zadań: przewidywania następnej akcji (które API wywoła użytkownik), wnioskowania ogólnego celu sesji (np. uruchomienie potoku uczenia maszynowego, analiza danych, zarządzanie użytkownikami czy szybka wizualizacja) oraz decyzji, czy bieżący krok prawdopodobnie kończy sesję. Wszystkie trzy zadania dzielą wspólny „szkielet”, który zamienia krótką historię ostatnich działań w jedną, bogatą reprezentację sytuacji, a następnie przekazuje ją do trzech niewielkich modułów predykcyjnych.

Budowa realistycznego testbedu in silico

Ponieważ prawdziwe dzienniki aktywności w przedsiębiorstwach często są wrażliwe i trudne do udostępnienia, autorzy stworzyli zaawansowane środowisko symulacyjne, które naśladuje sposób, w jaki specjaliści od danych korzystają z dużej wewnętrznej platformy. Zdefiniowali 100 różnych API pogrupowanych w 10 obszarów funkcjonalnych, w tym uwierzytelnianie, wprowadzanie danych, przetwarzanie, trenowanie modeli, wizualizację, eksport i administrację. Cztery persony użytkowników — data scientist, analityk biznesowy, programista i użytkownik zaawansowany — podążają charakterystycznymi, choć niedoskonałymi przepływami pracy, z prawdopodobieństwami odzwierciedlającymi zarówno rutynowe zachowania, jak i okazjonalne objazdy. Powstały zbiór danych zawiera 2000 sesji użytkowników i 20 000 wywołań API, z celami sesji takimi jak „potok uczenia maszynowego” czy „szybka wizualizacja”, które tworzą rozpoznawalne ścieżki, na przykład logowanie, ładowanie danych, ich przetwarzanie, tworzenie wykresu i eksport wyniku.

Jak dobrze model uczy się przewidywać

Trenowany w tym uporządkowanym, lecz zróżnicowanym środowisku, model transformer pokazuje, że uczenie oparte na uwadze potrafi uchwycić ukryte regularności w zachowaniach użytkowników znacznie lepiej niż starsze metody. W głównym zadaniu — odgadywaniu następnego wywołania API spośród 100 opcji — trafia prawie 80% czasu dokładnie w cel, a prawidłowy wybór znajduje się wśród pięciu najlepszych sugestii ponad 99,9% czasu, co stanowi ponad czterokrotny wzrost w porównaniu z podstawowym łańcuchem Markowa. Jednocześnie model poprawnie identyfikuje ogólny cel sesji w około 82% przypadków i niemal idealnie wykrywa, kiedy sesja ma się zakończyć. Autorzy podkreślają także, że model jest stosunkowo kompaktowy i wydajny, co czyni zastosowania w czasie rzeczywistym realnymi dla asystentów, którzy muszą odpowiadać bez odczuwalnego opóźnienia.

Narzędzia do ponownego użycia i rozbudowy

Aby ich podejście było czymś więcej niż jednorazowym eksperymentem, autorzy udostępnili otwartoźródłowy pakiet oprogramowania o nazwie context-engineer wraz z pełnym zbiorem symulowanych danych. Dzięki tym zasobom inni badacze i praktycy mogą odtworzyć zgłoszone wyniki, przetestować alternatywne modele na wspólnym benchmarku lub podłączyć własne wewnętrzne logi, mapując działania i etykiety sesji na prosty format numeryczny. Ta otwartość rozwiązuje poważny problem w dziedzinie, gdzie wiele wcześniejszych systemów nie mogło być rzetelnie porównanych ani ponownie użytych, ponieważ ich dane i kod były niedostępne.

Co to oznacza dla przeciętnych użytkowników

Dla niespecjalisty kluczowy wniosek jest taki, że artykuł proponuje praktyczny przepis na sprawienie, by narzędzia cyfrowe wydawały się „o krok do przodu”. Dzięki wspólnemu uczeniu, co ludzie próbują zrobić, co najprawdopodobniej klikną dalej i kiedy kończą pracę, proponowany system oparty na transformerze przekształca historię użytkownika w formę świadomości kontekstu. W rzeczywistych zastosowaniach może to oznaczać chatboty przygotowujące następny raport, zanim o to poprosisz, platformy analityczne sugerujące rozsądne kolejne kroki i pulpity korporacyjne, które dyskretnie skracają czas oczekiwania. Choć obecne badanie opiera się na danych symulowanych i wymaga testów na prawdziwych logach, stanowi jasną, powtarzalną podstawę do budowy mądrzejszych, bardziej anticipacyjnych asystentów programowych na różnych platformach cyfrowych.

Cytowanie: Yin, Y. Rethink context engineering using an attention-based architecture. Sci Rep 16, 8851 (2026). https://doi.org/10.1038/s41598-026-43111-9

Słowa kluczowe: predykcja zachowań użytkownika, rekomendacja sekwencyjna, transformer oparty na uwadze, proaktywne asystenty cyfrowe, inżynieria kontekstu