Clear Sky Science · pl

Segmentacja narzędzi chirurgicznych niezależna od domeny z słabo nadzorowanym uczeniem

Dlaczego lepsze widoki narzędzi chirurgicznych mają znaczenie

Współcześni chirurdzy coraz częściej pracują z pomocą kamer, mikroskopów i zaawansowanych skanerów. Aby kierować robotami, wyrównywać widoki 3D czy maskować narzędzia na określonych obrazach, systemy komputerowe muszą niezawodnie odnaleźć każde narzędzie chirurgiczne w każdej klatce — zadanie zwane segmentacją. Dziś zwykle wymaga to tysięcy mozolnych, piksel-po-piksel adnotacji od ekspertów medycznych — a i tak systemy często zawodzą, gdy zmienia się konfiguracja obrazowania lub procedura. W tym badaniu przedstawiono sposób, który pozwala mocnym modelom wizji odnajdywać narzędzia w bardzo różnych rodzajach obrazów medycznych, bez potrzeby wstępnego rysowania szczegółowych masek dla każdego instrumentu.

Wyzwaniem jest znajdowanie narzędzi w wielu typach obrazów

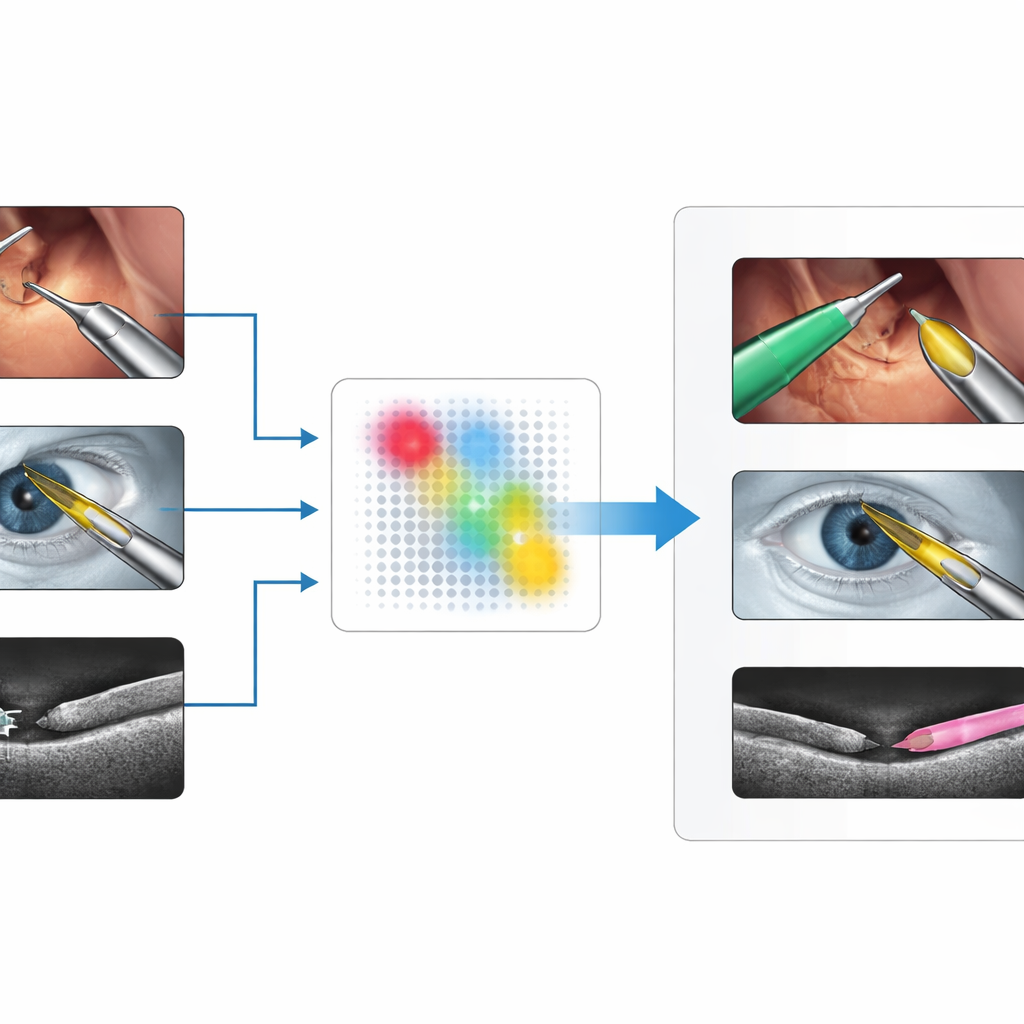

Chirurdzy korzystają z szerokiego spektrum systemów obrazowania: kolorowych nagrań z kamer laparoskopowych w jamie brzusznej, widoków mikroskopowych oka podczas operacji zaćmy oraz przekrojowych skanów, takich jak optyczna koherentna tomografia (OCT) czy ultradźwięki. W każdym z tych przypadków narzędzia chirurgiczne wyglądają inaczej — błyszczące metalowe pręty na obrazach kolorowych, cienkie jasne linie lub półksiężyce w OCT, albo plamiste struktury w ultradźwiękach. Istniejące metody głębokiego uczenia mogą działać bardzo dobrze, ale tylko po wytrenowaniu na dużych, starannie opisanych zbiorach danych z konkretnego środowiska. Gdy zmienia się urządzenie obrazujące, anatomia czy typ narzędzia, wydajność często gwałtownie spada, a zebranie nowych adnotacji jest powolne, kosztowne i ograniczone wymogami prywatności oraz dostępnością ekspertów.

Nowy pomysł: traktować narzędzia jak obiekty niepasujące do tła

Autorzy proponują metodę nazwaną SAM4SIS, która przewraca problem do góry nogami. Zamiast uczyć system, jak dokładnie wygląda każde narzędzie, najpierw pokazują mu obrazy bez żadnych narzędzi, pozwalając mu poznać, jak wygląda „normalna” tkanka. Do zbudowania pamięci tych normalnych wzorców używają detektora anomalii o nazwie PatchCore. Gdy pojawia się nowe zdjęcie, PatchCore wskazuje obszary, których wygląd nie pasuje do tej pamięci — miejsca, które prawdopodobnie zawierają narzędzia chirurgiczne. Ten etap wymaga jedynie prostej informacji na poziomie obrazu o tym, czy narzędzie jest obecne, a nie rysunków piksel-po-piksel, co znacznie ułatwia przygotowanie.

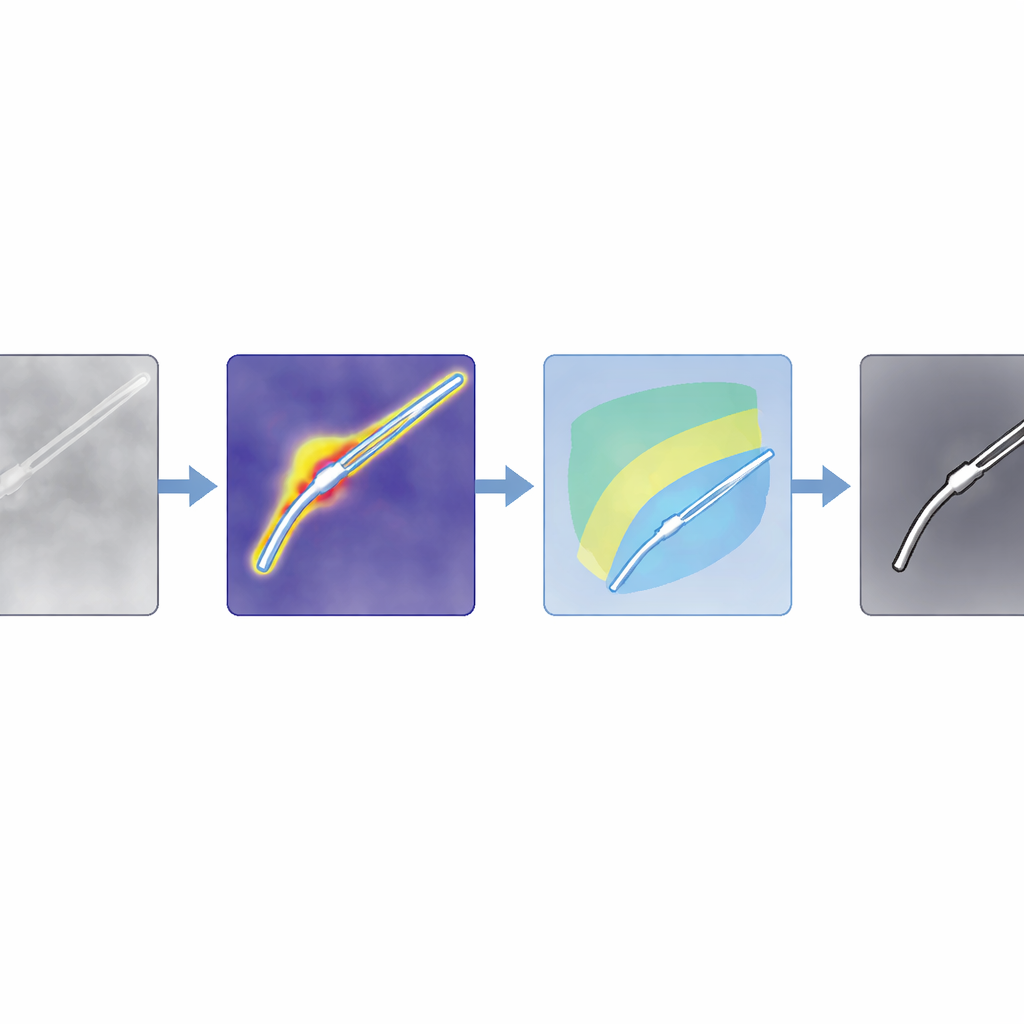

Z grubych wskazówek do precyzyjnych konturów

Mapy anomalii są zgrubne, dlatego zespół łączy je z potężnym modelem fundamentowym Segment Anything Model 2 (SAM2), który potrafi narysować ostre kontury, jeśli dostanie punkt wewnątrz obiektu zainteresowania. Kluczowy trik polega na automatycznym wyborze tych punktów z mapy anomalii, zamiast proszenia człowieka o kliknięcie. Autorzy projektują filtry dostosowane do zwykłych obrazów kolorowych oraz do skanów opartych na intensywności, takich jak OCT, wzmacniając obszary, które prawdopodobnie zawierają narzędzia, przy jednoczesnym tłumieniu cieni i jasnych artefaktów. Następnie oceniają potencjalne regiony z narzędziami i wybierają najsilniejsze punkty jako wskazówki dla SAM2. Ponieważ SAM2 zwraca kilka kandydujących masek, autorzy wprowadzają nowe kryterium oceny, SAM4SIS, które mierzy, jak dobrze każda propozycja pasuje do mapy anomalii, i wybiera najlepiej dopasowaną maskę.

Działa w wielu rodzajach operacji i na różnych skanerach

Naukowcy testują swoje podejście na trzech wymagających zbiorach danych: nagraniach z robotycznych operacji brzucha (EndoVis2017), obrazach mikroskopowych operacji zaćmy (CaDIS) oraz przekrojowych skanach OCT świńskich oczu z malutkimi narzędziami (PASO-SIS). Obejmują one bardzo różne widoki, kolory i wzorce szumów. Nie trenując ponownie dużego modelu segmentacyjnego ani nie rysując nowych masek, SAM4SIS osiąga miary dokładności brzegów w granicach około 53%–73%, rywalizując z metodami opartymi na podpowiedziach tekstowych lub je przewyższając, a także zbliżając się do niektórych systemów nadzorowanych. Sprawdza się szczególnie dobrze tam, gdzie tradycyjne metody mają problemy, na przykład w danych OCT i ultradźwiękowych, i wymaga mniej niż minuty konfiguracji. Zespół pokazuje też, że ta sama koncepcja potrafi wyróżnić inne obce obiekty, jak kulki waty w ultrasonografii mózgu, sugerując, że pomysł nie ogranicza się wyłącznie do instrumentów.

Co to oznacza dla przyszłości inteligentnej chirurgii

Dla czytelników główny wniosek jest taki, że komputery mogą teraz uczyć się „segmentować wszystko nowe” w scenach chirurgicznych, najpierw poznając, jak wygląda normalna tkanka, a potem oznaczając nieznane kształty jako prawdopodobne narzędzia, które są następnie dopracowywane przez uniwersalny model wizji. Podejście to unika kosztownych adnotacji, dostosowuje się do różnych technologii obrazowania i można je włączyć do procesów chirurgicznych przy minimalnym przygotowaniu. Chociaż specjalistyczne modele starannie trenowane wciąż wygrywają, gdy dostępne są obszerne zbiory etykietowanych danych, SAM4SIS stanowi praktyczną alternatywę dla nowych procedur, rzadkich konfiguracji obrazowania czy badań w początkowej fazie, przybliżając solidne, zautomatyzowane wykrywanie narzędzi do codziennej praktyki klinicznej.

Cytowanie: Peter, R., Pham, D.X.V., Matten, P. et al. Domain-agnostic weakly supervised surgical instrument segmentation. Sci Rep 16, 9337 (2026). https://doi.org/10.1038/s41598-026-43054-1

Słowa kluczowe: segmentacja narzędzi chirurgicznych, AI w obrazowaniu medycznym, wykrywanie anomalii, fundacyjne modele wizji, chirurgia robotyczna