Clear Sky Science · pl

Opracowanie i ocena wieloetapowego ramienia transferu uczenia dla odpornej analizy obrazów medycznych

Dlaczego mądrzejsze czytanie obrazów ma znaczenie

Współczesna medycyna w dużym stopniu opiera się na obrazach — od mammogramów po prześwietlenia klatki piersiowej — by wcześnie wykrywać choroby i kierować leczeniem. Nauczenie komputerów odczytywania tych obrazów z dokładnością porównywalną do ekspertów zwykle wymaga ogromnych, starannie oznakowanych zbiorów danych, których wiele szpitali po prostu nie posiada. W tym badaniu przedstawiono nowy sposób trenowania systemów sztucznej inteligencji, który lepiej wykorzystuje istniejące obrazy, w tym tanie zdjęcia laboratoryjne komórek nowotworowych, by poprawić działanie na rzeczywistych skanach, jednocześnie zmniejszając wymagania dotyczące prywatności i danych.

Od codziennych fotografii do skanów szpitalnych

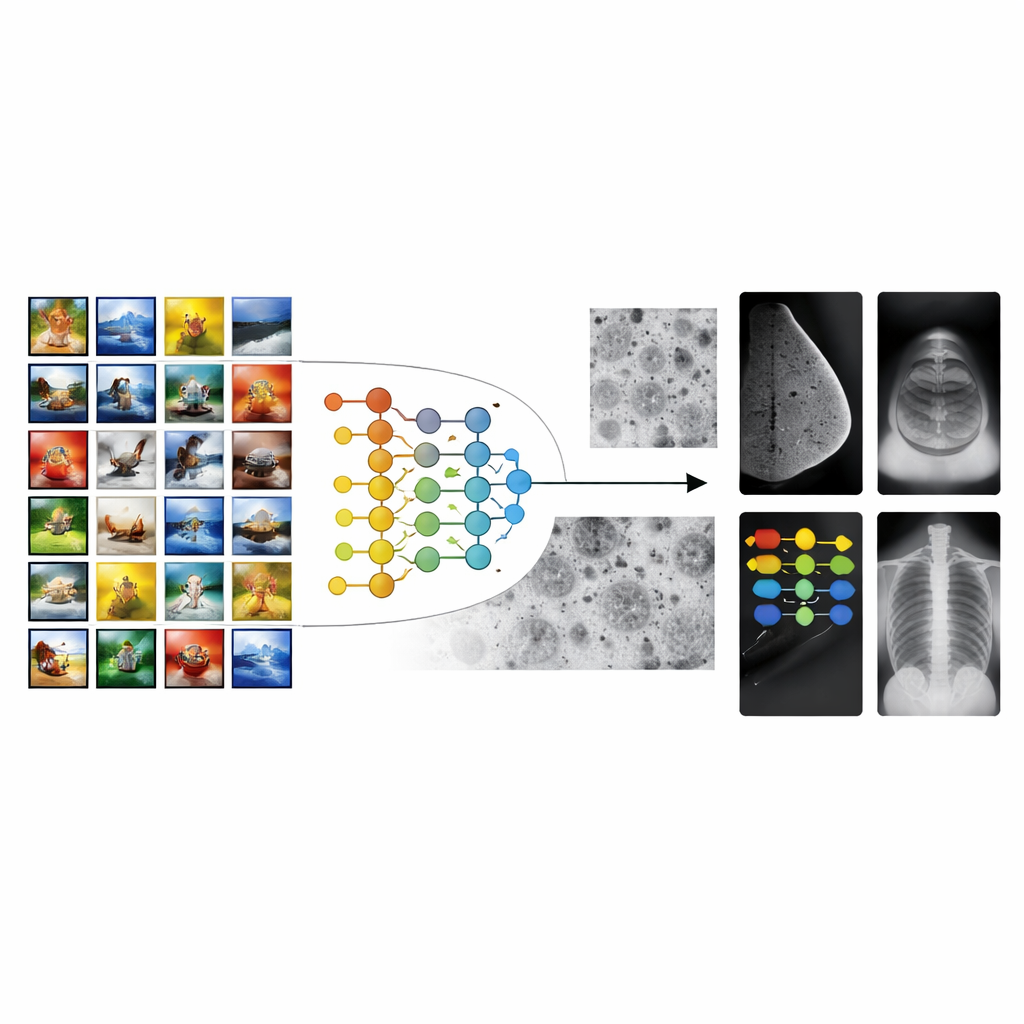

Większość systemów AI w obrazowaniu medycznym zaczyna od modeli wytrenowanych na milionach zwykłych zdjęć, takich jak zwierzęta, przedmioty czy krajobrazy. Strategia ta, znana jako transfer learning, daje algorytmom „przewagę” w rozpoznawaniu kształtów i tekstur. Istnieje jednak duża przepaść między zdjęciami z wakacji a skanami medycznymi. Wzory istotne w mammogramie czy prześwietleniu — drobne plamki, słabe cienie czy subtelne tekstury tkanki — nie przypominają obiektów ze zwykłych zdjęć. W efekcie konwencjonalny transfer learning może utknąć, prowadząc do narzędzi, które dobrze działają w warunkach laboratoryjnych, ale mają trudności w różnych szpitalach, na różnych aparatach czy wśród różnych grup pacjentów.

Budowanie mostu za pomocą obrazów komórek

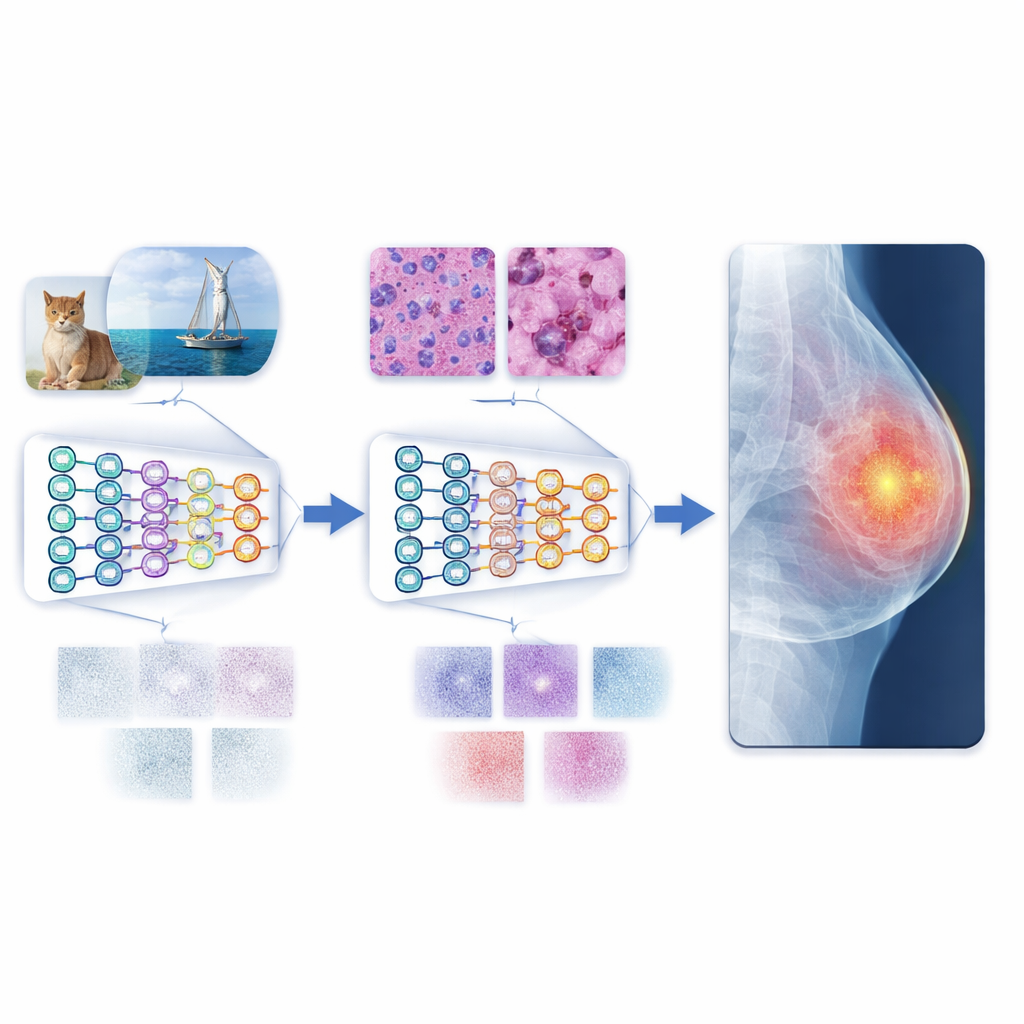

Autorzy proponują wieloetapowe ramy transferu uczenia (MSTL), które dodają kluczowy etap pośredni między obrazami ogólnymi a skanami klinicznymi. Po początkowym treningu na dużym zbiorze zdjęć naturalnych, model jest dopracowywany na mikroskopowych fotografiach linii komórek nowotworowych hodowanych w laboratorium. Obrazy komórkowe mają wiele cech wizualnych wspólnych ze skanami medycznymi: gęste, zagęszczone struktury; drobnoziarniste tekstury; oraz subtelne różnice w jasności. Są też stosunkowo tanie w produkcji, można je generować w dużych ilościach i nie niosą ze sobą problemów prywatności związanych z danymi pacjentów. Poprzez najpierw dostosowanie się do świata obrazów komórkowych, model uczy się cech bardziej relewantnych dla wzorców chorobowych, zanim zobaczy mammogram, USG czy prześwietlenie.

Testowanie na różnych typach skanów

Aby ocenić tę strategię, badacze trenowali zarówno tradycyjne konwolucyjne sieci neuronowe, jak i nowsze vision transformery na trzech typowych zadaniach obrazowania: wykrywaniu raka piersi na mammogramach, analizie zmian piersi na ultrasonografie oraz wykrywaniu zapalenia płuc na zdjęciach klatki piersiowej. Porównali trzy style treningu: od zera, z konwencjonalnym transfer learningiem z obrazów naturalnych oraz z nową metodą wieloetapową wykorzystującą obrazy komórek nowotworowych jako most. Podejście wieloetapowe konsekwentnie dawało najlepsze wyniki, często zbliżając dokładność do perfekcji na testowanych zbiorach. Vision transformery, które potrafią wychwycić wzorce rozciągające się na całe obrazy, przewyższały standardowe sieci konwolucyjne w niemal każdym ustawieniu, szczególnie w połączeniu z treningiem wieloetapowym.

Pomiary, jak dobrze wiedza się transferuje

Powyżej prostych wyników dokładności zespół zbadał, jak łatwo cechy wyuczone na jednym etapie przenoszą się na kolejny. Użyto trzech miar transferowalności, które odzwierciedlają, jak kompatybilne są wyuczone wzorce obrazowe z nowymi zadaniami. Dla mammogramów i zdjęć klatki piersiowej miary te ściśle korelowały z rzeczywistą wydajnością, zwłaszcza dla najsilniejszego modelu — bazowego vision transformera (ViTB-16). Taka ścisła zależność sugeruje, że etap pośredni z obrazami komórkowymi robi więcej niż poprawia liczby; generuje reprezentacje, które rzeczywiście lepiej „pasują” do obrazów medycznych. Dodatkowe eksperymenty wykazały, że zmniejszenie liczby obrazów komórkowych o połowę pogarszało wyniki, a zastąpienie ich innymi modalnościami medycznymi (takimi jak endoskopia czy obrazy oka) było mniej skuteczne, co podkreśla szczególną wartość linii komórek nowotworowych jako mostu.

W kierunku bardziej niezawodnej zautomatyzowanej diagnozy

Mówiąc wprost, badanie pokazuje, że nauczenie systemu AI najpierw odczytywania zdjęć komórek hodowanych w laboratorium, a dopiero potem skanów szpitalnych, czyni go bardziej biegłym i niezawodnym „czytelnikiem” obrazów medycznych. Ta wieloetapowa ścieżka zmniejsza rozbieżność między kolorowymi zwykłymi zdjęciami a stonowanymi, złożonymi wzorcami w obrazach klinicznych, pozwalając modelowi lepiej uogólniać nawet przy skromnych ilościach oznakowanych danych medycznych. W połączeniu z nowoczesnymi vision transformerami podejście dostarcza osiągnięć na światowym poziomie na kilku benchmarkowych zbiorach. Choć potrzeba jeszcze bardziej zróżnicowanych danych i szerszych testów, ramy te wskazują kierunek dla skalowalnych, przyjaznych prywatności narzędzi, które mogłyby wspierać lekarzy w dokładniejszej i bardziej spójnej diagnostyce chorób na całym świecie.

Cytowanie: Ayana, G., Park, Sy., Jeong, K.C. et al. Development and evaluation of a multistage transfer learning framework for robust medical image analysis. Sci Rep 16, 8873 (2026). https://doi.org/10.1038/s41598-026-42157-z

Słowa kluczowe: analiza obrazów medycznych, transfer learning, głębokie uczenie, vision transformers, obrazowanie komórek nowotworowych