Clear Sky Science · pl

Projekt i wdrożenie ram głębokiego uczenia do automatycznej klasyfikacji upraw i diagnozy ich zdrowia w rolnictwie precyzyjnym

Mądrzejsze pola dla głodniejącego świata

Karmienie rosnącej populacji świata oznacza uzyskiwanie więcej żywności z każdego pola przy jednoczesnym mniejszym marnowaniu wody, nawozów i pracy. Mimo to rolnicy wciąż spędzają niezliczone godziny, chodząc po swoich gruntach i wizualnie sprawdzając liście oraz glebę. W tym artykule przedstawiono zautomatyzowany sposób nadzorowania upraw z wykorzystaniem latających dronów, orbitujących satelitów i zakopanych czujników, połączonych z systemem głębokiego uczenia, który potrafi wcześnie wykrywać problemy i sugerować szybkie działania.

Połączenie nieba i gleby

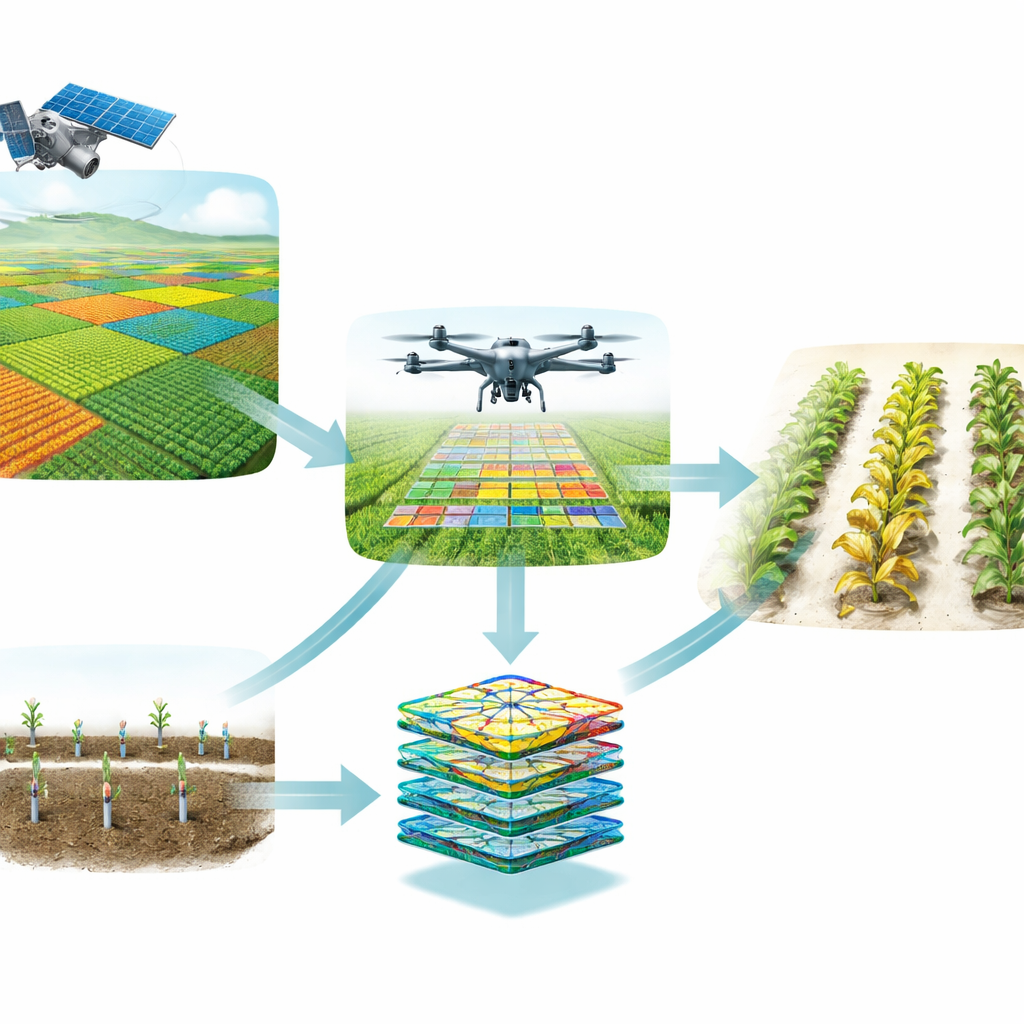

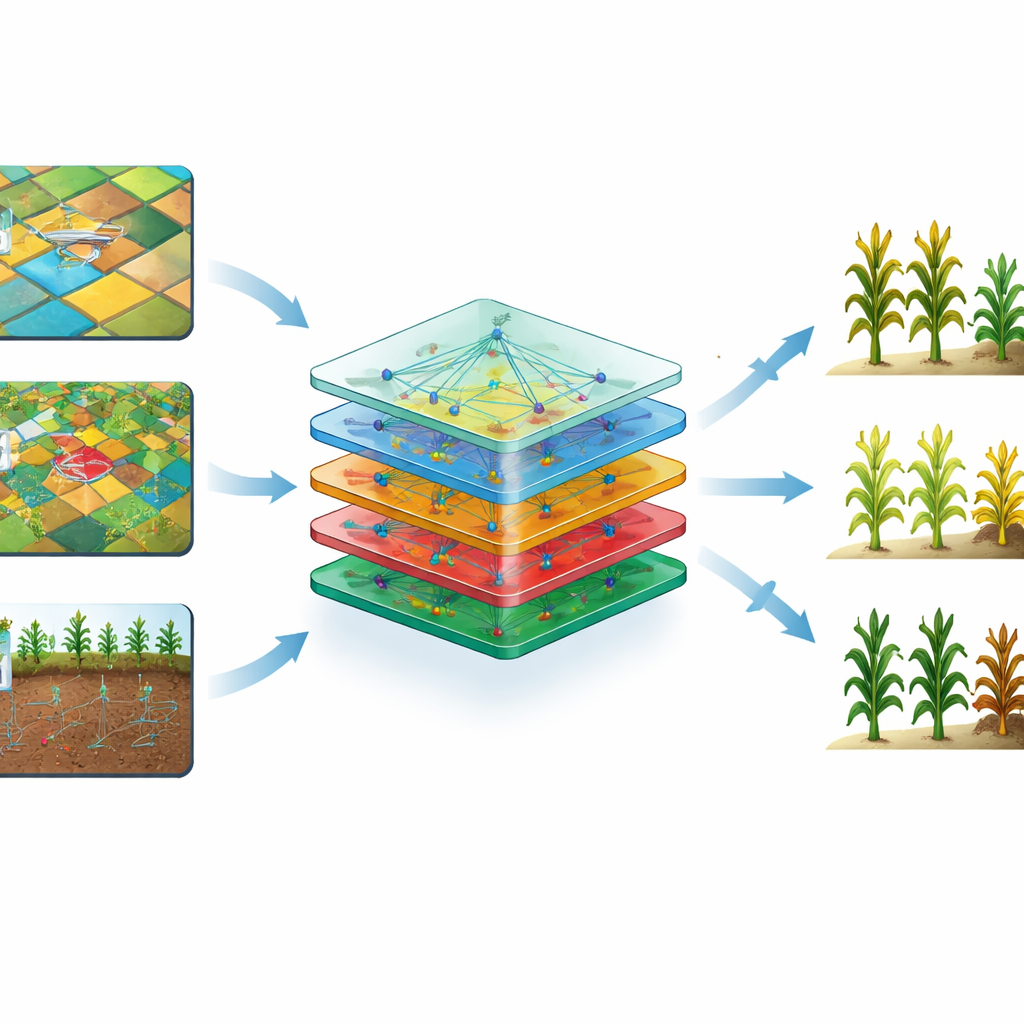

Większość zaawansowanych narzędzi rolniczych koncentruje się tylko na jednym fragmencie układanki: zdjęciach z bliska liści lub surowych odczytach z sond glebowych. Autorzy argumentują, że takie "silosowe" podejście pomija istotne wskazówki. Ich ramy łączą zatem trzy punkty widzenia. Z kosmosu obrazy satelitarne ujawniają wzorce obejmujące duże obszary, na przykład które części pola są w stanie stresu. Z powietrza drony rejestrują szczegółowe widoki kolorystyczne i bliskiej podczerwieni pojedynczych roślin. W gruncie czujniki podłączone do internetu śledzą wilgotność, zasoby pokarmowe, temperaturę i inne warunki. Poprzez wyrównanie tych źródeł danych w czasie i przestrzeni system może powiązać to, co widzi na liściach, z tym, co dzieje się w glebie i otoczeniu.

Jak cyfrowy lekarz roślin się uczy

Rdzeniem ram jest model głębokiego uczenia trenowany do rozpoznawania rodzajów upraw i stanu zdrowia. Najpierw wszystkie napływające dane są czyszczone i standaryzowane: zachmurzone sceny satelitarne są normalizowane, obrazy z dronów zmieniane rozmiarem i korygowane pod kątem zmiennego oświetlenia, a luki w zapisach pogodowych wypełniane. System powiększa też zestawy obrazów przez obracanie i odbijanie zdjęć, tak aby model nauczył się ignorować kąt kamery i skupić na rzeczywistych cechach roślin. Następnie specjalizowana sieć do analizy obrazów, znana jako splotowa sieć neuronowa, wykrywa wzorce takie jak struktura liści, zmiany koloru i kształty zmian chorobowych, podczas gdy dodatkowe warstwy przetwarzają numeryczne odczyty z czujników. Mechanizm „uwagi” pomaga modelowi koncentrować się na najbardziej informatywnych regionach — na przykład plamach na liściach — jednocześnie tłumiąc tło, takie jak gleba czy niebo.

Od surowych danych do decyzji w czasie rzeczywistym

Po wytrenowaniu model działa jak stale czuwający lekarz roślin. Dane wieloźródłowe są przesyłane strumieniowo do systemu i łączone w jednolitą reprezentację wewnętrzną. Warstwy kierowane mechanizmem uwagi porównują obserwacje z tysiącami wcześniejszych przykładów, a końcowy blok klasyfikacyjny decyduje, czy roślina jest zdrowa, czy wykazuje oznaki choroby, uszkodzeń spowodowanych przez szkodniki lub stresu. Zamiast jedynie oznaczać pole jako dobre lub złe, system łączy diagnozę wizualną z bieżącą wilgotnością gleby i poziomami składników odżywczych. Takie połączenie pozwala priorytetyzować alerty: na przykład wzór chorobowy występujący przy wysokiej wilgotności może wywołać ostrzeżenie o dużym priorytecie, co sugeruje natychmiastowe, ukierunkowane opryski zamiast oprysków na całym obszarze gospodarstwa.

Testy systemu

Aby sprawdzić, czy podejście działa także poza teorią, autorzy wytrenowali i ocenili swoje ramy na publicznym zbiorze danych z zakresu rolnictwa precyzyjnego, który obejmuje obrazy satelitarne, zdjęcia z dronów oraz odczyty z czujników gruntowych dla kluczowych upraw: kukurydzy, ziemniaka i pszenicy. Podzielili dane na zbiory treningowe, walidacyjne i testowe, by uniknąć przetrenowania, i porównali swój model z standardowymi metodami głębokiego uczenia oraz tradycyjnymi technikami uczenia maszynowego. Ich system multimodalny konsekwentnie osiągał ponad 90 procent dokładności w identyfikacji typu uprawy i stanu zdrowia, a także dokonywał szybszych predykcji niż modele bazowe. Co ważne, gdy jedno źródło danych było pogorszone — na przykład zdjęcia z dronów zasłonięte przez cienie — system nadal utrzymywał wysoką dokładność, opierając się silniej na informacjach z gleby i satelitów.

Co to oznacza dla rolników

Wynik badania jest taki, że łączenie widoków od nieba po glebę pozwala komputerom oceniać zdrowie upraw bardziej niezawodnie niż zarówno ludzie-skanerzy, jak i narzędzia wykorzystujące pojedyncze czujniki. Dla rolników może to oznaczać wcześniejsze ostrzeżenia o epidemiach chorób, precyzyjniejsze wykorzystanie wody i środków chemicznych, niższe koszty pracy i w efekcie wyższe plony przy mniejszym wpływie na środowisko. Choć obecny system nadal zależy od dobrej łączności do przesyłania danych do chmury, przyszłe wersje mogłyby działać bezpośrednio na dronach lub urządzeniach brzegowych w terenie. Jeśli zostanie wdrożony na dużą skalę, taki inteligentny, wielooki strażnik pól mógłby stać się filarem naprawdę zrównoważonego, opartego na danych rolnictwa.

Cytowanie: Pal, A.K., Patro, B.D.K. & Chaube, S. Design and implementation of a deep learning framework for automated crop classification and health diagnosis in precision agriculture. Sci Rep 16, 11436 (2026). https://doi.org/10.1038/s41598-026-42151-5

Słowa kluczowe: rolnictwo precyzyjne, wykrywanie chorób upraw, głębokie uczenie, fotografie z dronów i satelitów, inteligentne rolnictwo