Clear Sky Science · pl

Optymalizowany, jakościowy system sterowania wizualnego w czasie rzeczywistym oparty na HOG dla autonomicznego wózka inwalidzkiego

Sprytniejsze przejazdy dla tych, którzy najbardziej ich potrzebują

Dla wielu osób polegających na wózkach elektrycznych kierowanie w zatłoczonych korytarzach czy po nierównych chodnikach może być męczące, stresujące, a czasem wręcz niemożliwe bez pomocy. W artykule przedstawiono nowy sposób, w jaki wózek może „widzieć” otoczenie za pomocą małej kamery i sterować samodzielnie płynnie i bezpiecznie w czasie rzeczywistym, nawet korzystając z niedrogiego sprzętu. Poprzez staranne przeprojektowanie sposobu przetwarzania informacji wizualnej i przekładania jej na ruch autor pokazuje, że inteligentna nawigacja wózka może działać na maleńkim, energooszczędnym komputerze, jednocześnie zapewniając komfort i poczucie kontroli użytkownikom.

Dlaczego zwykłe wózki zawodzą w realnym świecie

Tradycyjne wózki napędzane są zazwyczaj sterowane bezpośrednio joystickiem lub polegają na prostych czujnikach zderzeniowych do wykrywania przeszkód. Takie podejścia często zawodzą w zatłoczonych, zmiennych przestrzeniach, takich jak korytarze szpitalne, centra handlowe czy miejskie chodniki. Użytkownicy mówią, że najbardziej zależy im na płynnym, przewidywalnym ruchu i niezawodności przy różnych warunkach oświetleniowych, a nie na samej prędkości. Jednocześnie wiele zaawansowanych metod robotycznych wykorzystujących kamery i skomplikowane obliczenia wymaga wydajnych komputerów, które są zbyt kosztowne i nieporęczne dla codziennych wózków. To właśnie tę przepaść — między potrzebami użytkowników a możliwościami taniego sprzętu — badanie stara się zmniejszyć.

Uczenie wózka rozpoznawania wzorów zamiast punktów

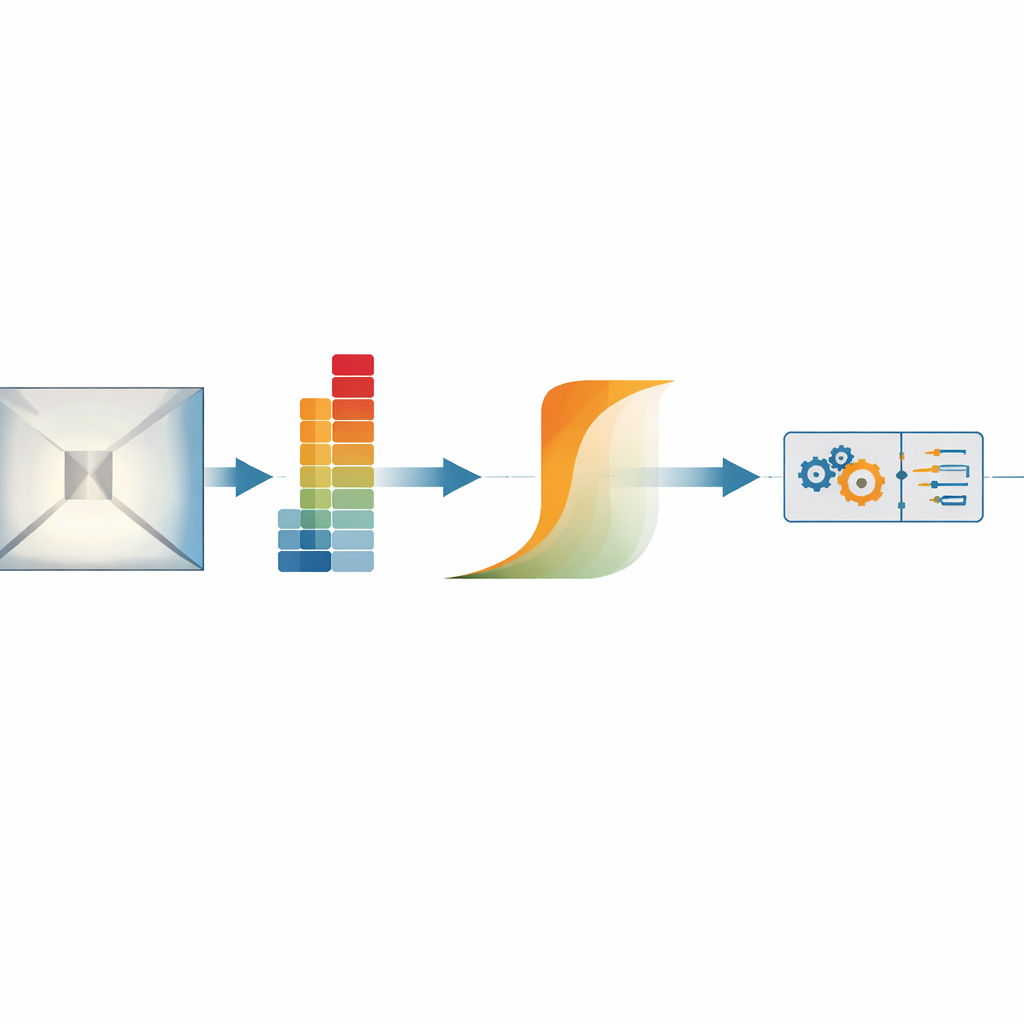

System wykorzystuje kamerę zamontowaną na wózku do obserwacji sceny przed nim i reprezentuje ją nie jako pojedyncze punkty czy znaki orientacyjne, lecz jako wzory krawędzi i linii znane jako histogramy gradientów. W prostych słowach: analizuje, jak zmienia się jasność w obrazie i kondensuje to do zwartego odcisku palca sceny. Taki opis wzorca jest naturalnie odporny na zmiany oświetlenia i częściowe zasłonięcia, na przykład gdy ktoś przechodzi chwilowo przez pole widzenia kamery. Wózek porównuje aktualny wzór z „wzorcem celu”, odpowiadającym pożądanemu widokowi — na przykład wyglądowi prostego korytarza lub charakterystycznemu obiektowi na końcu drogi — a następnie koryguje ruch, aby oba wzory były do siebie bliższe.

Dopuszczanie marginesu bezpieczeństwa dla łagodniejszego sterowania

Zamiast wymagać idealnego dopasowania między aktualnym a docelowym widokiem, metoda wprowadza elastyczną „strefę zaufania”. Jeśli widok kamery wózka jest wystarczająco bliski celowi, system sterowania celowo się rozluźnia, unikając nerwowych poprawek w przód i w tył. Osiąga się to za pomocą funkcji aktywacji matematycznie stopniowo zwiększającej lub zmniejszającej reakcję kierowania w zależności od wielkości błędu wizualnego, zamiast po prostu wzmacniać działanie przy każdym, nawet drobnym błędzie. W rezultacie wózek potrafi radzić sobie z częściowymi przesłonięciami i niepewnością wizualną bez gwałtownych szarpnięć, utrzymując płynne trajektorie w zadaniach takich jak podążanie korytarzem czy przemieszczanie się w stronę kolejnych celów wizualnych.

Sprawienie, by zaawansowane widzenie działało na maleńkim komputerze

Głównym wyzwaniem jest to, że te bogate wizualne odciski palca są zwykle kosztowne obliczeniowo. Autor rozwiązuje to, przepisując obliczenia tak, aby wykorzystywały wydajne operacje „wszystko naraz” zamiast wolnych zagnieżdżonych pętli, redukując niepotrzebną precyzję oraz starannie organizując użycie pamięci. Uruchomione na Raspberry Pi — komputerze wielkości karty kredytowej często używanym w projektach hobbystycznych — ulepszone oprogramowanie zwiększa szybkość przetwarzania z poziomu bezużytecznego (około jednego obrazu na 12 sekund) do około pięciu i pół obrazu na sekundę. Silniki wózka otrzymują polecenia w znacznie szybszym, stałym tempie, dzięki czemu koła poruszają się płynnie, podczas gdy kamera i system widzenia aktualizują się w tle. Dodatkowe warstwy bezpieczeństwa, w tym mechaniczne hamulce i nadzorca, który zatrzymuje wózek, jeśli polecenia przestaną nadchodzić, są zaimplementowane z myślą o praktycznym zastosowaniu wspomagającym.

Od teorii laboratoryjnej do codziennej pomocy

Na podstawie eksperymentów w korytarzach, na chodnikach i w kontrolowanych testach wideo system konsekwentnie kieruje wózek od jednego celu wizualnego do następnego, stopniowo redukując korekty kierowania w miarę zbliżania się do każdego punktu. Błąd dopasowania wzorca kamery nieustannie maleje, co potwierdza, że wózek ustawia się wizualnie bez utraty istotnych cech po drodze. Mówiąc prosto, badanie pokazuje, że mały, przystępny cenowo komputer i prostą kamera wystarczą, by wyposażyć wózek elektryczny w stabilny, prowadzony kamerą „autopilot”, który szanuje komfort i bezpieczeństwo. To otwiera drogę do bardziej dostępnych, opartych na kamerze pomocy nawigacyjnych dla osób z ograniczoną mobilnością i tworzy podstawy do przyszłych ulepszeń, takich jak bogatsze postrzeganie 3D i jeszcze płynniejsze unikanie przeszkód.

Cytowanie: Hafez, A.H.A. An optimized real-time qualitative HOG-based visual servoing system for autonomous wheelchair. Sci Rep 16, 8688 (2026). https://doi.org/10.1038/s41598-026-41566-4

Słowa kluczowe: autonomiczny wózek inwalidzki, robotyka wspomagająca, widzenie komputerowe, nawigacja wzrokowa, sterowanie w czasie rzeczywistym