Clear Sky Science · pl

Człowiek kontra sztuczna inteligencja w diagnostyce patologii jamy ustnej: porównawcze badanie ChatGPT, Grok i MANUS

Dlaczego to ma znaczenie przy twojej następnej wizycie stomatologicznej

Kiedy dentysta znajduje podejrzane miejsce w jamie ustnej, ostateczne rozstrzygnięcie, czy jest ono niegroźne, czy niebezpieczne, zwykle pochodzi od specjalisty badającego tkankę pod mikroskopem. Ta praca jest dokładna, czasochłonna, a w wielu regionach świata brak wystarczającej liczby ekspertów. Badanie stawia aktualne pytanie: czy współczesne systemy sztucznej inteligencji mogą pomagać w odczytywaniu mikroskopowych obrazów tkanek jamy ustnej z dokładnością zbliżoną do ludzkich specjalistów, przyspieszając diagnozę, zwiększając jej spójność i dostępność?

Co badacze postanowili sprawdzić

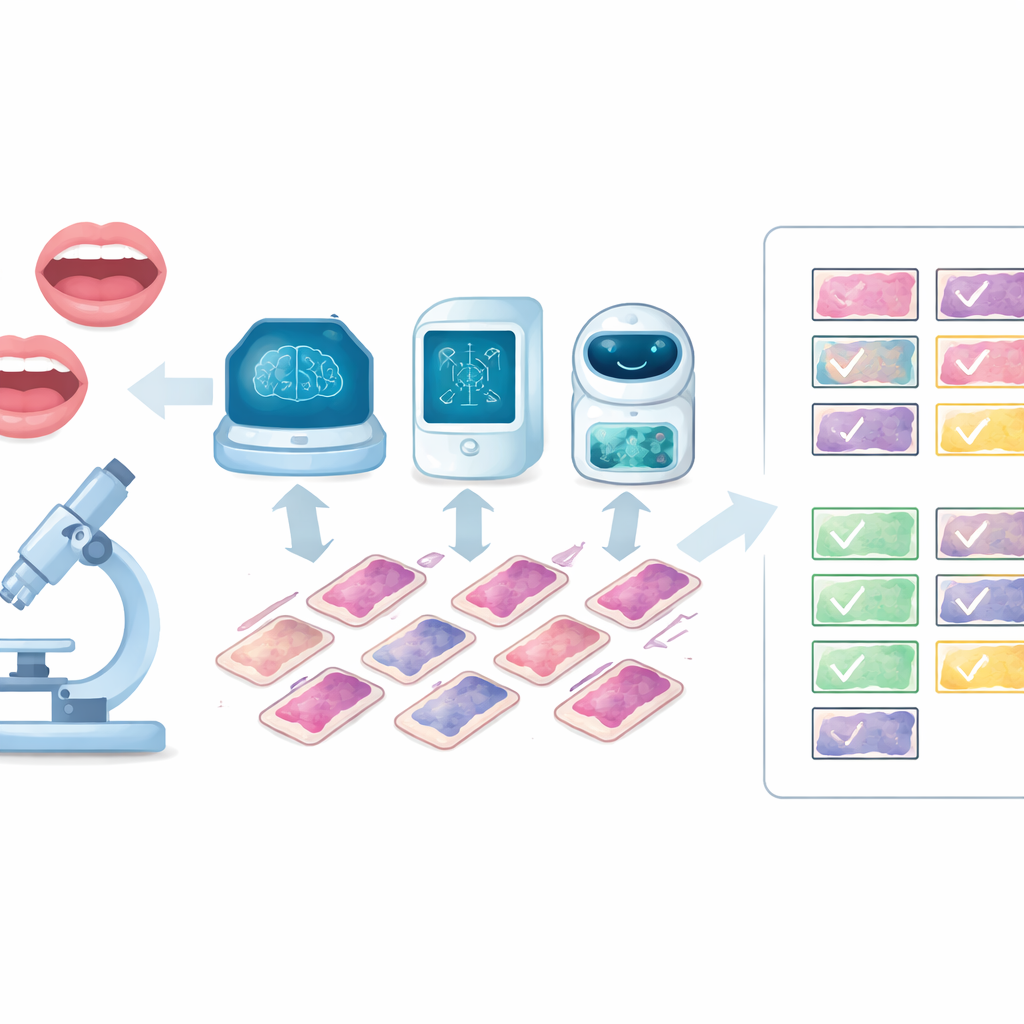

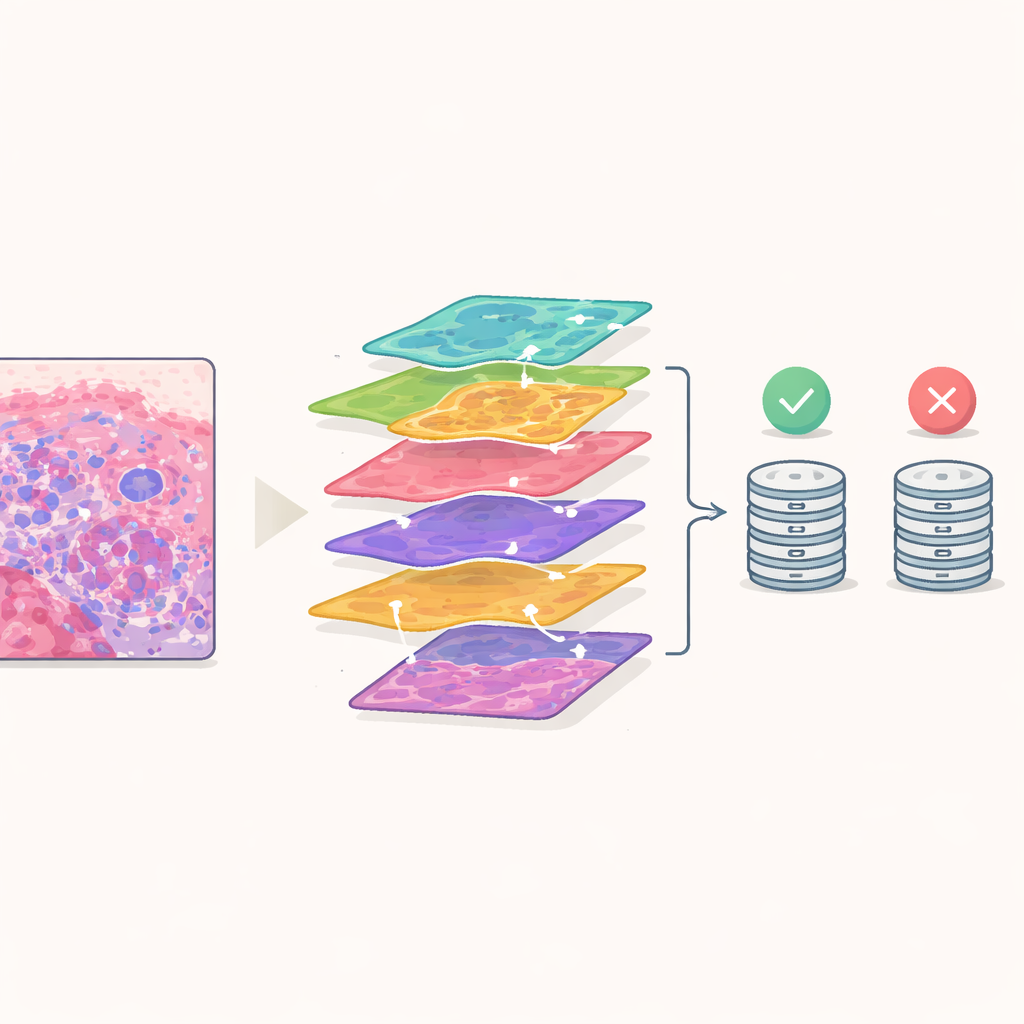

Zespół skupił się na trzech zaawansowanych programach komputerowych znanych ze zdolności do rozumienia zarówno obrazów, jak i tekstu: ChatGPT, Grok oraz systemie medycznym o nazwie MANUS. Zamiast korzystać z danych prawdziwych pacjentów, wykorzystano 100 wyraźnych, wysokiej jakości zdjęć mikroskopowych ze standardowego podręcznika chorób jamy ustnej. Każde zdjęcie przedstawiało inny rodzaj zmiany, od wczesnych zmian przednowotworowych po guzy, torbiele i zmiany reaktywne. Dwóch doświadczonych patologów jamy ustnej najpierw uzgodniło prawidłową diagnozę dla każdego preparatu, tworząc solidny ludzki wzorzec do porównania z maszynami.

Jak przebiegało porównanie „jeden na jednego”

Każdy z 100 preparatów został pokazany wszystkim trzem systemom AI przy użyciu tej samej krótkiej wiadomości opisującej przypadek i tego samego obrazu cyfrowego. Modele poproszono o wskazanie jednej, najbardziej prawdopodobnej diagnozy, tak jak zrobiłby to specjalista wydający raport. Aby sprawdzić stabilność odpowiedzi w czasie, badacze powtórzyli cały proces po dwóch tygodniach z tymi samymi obrazami i instrukcjami. Tymczasem dwaj ludzie‑patolodzy niezależnie odczytali preparaty bez wglądu w wyniki AI, a następnie omówili różnice, aż doszli do wspólnej decyzji. Decyzje ekspertów traktowano jako najlepszą dostępną odpowiedź.

Jak radziły sobie maszyny i ludzie

Wszystkie trzy narzędzia AI wypadły imponująco dobrze. W drugiej rundzie testów Grok poprawnie zidentyfikował 97 z 100 przypadków, MANUS 96, a ChatGPT 94. Para ludzkich specjalistów osiągnęła nieco wyższy wynik, poprawnie klasyfikując 98 preparatów. ChatGPT wyróżniał się niemal identycznymi odpowiedziami w obu rundach, co świadczy o bardzo silnej wewnętrznej spójności, podczas gdy MANUS i Grok również pokazały solidną i stabilną wydajność. Gdy porównano systemy między sobą, zgadzały się one w przeważającej większości przypadków, co sugeruje, że różne konstrukcje AI mogą dochodzić do bardzo podobnych ocen przy tych samych wysokiej jakości obrazach.

Na ile AI odpowiada myśleniu ekspertów

Dopasowanie poprawnej odpowiedzi to tylko część historii; ważne jest także, czy komputery mają tendencję do zgadzania się z wzorcami rozumowania ludzi. W tym zakresie MANUS wykazał najbliższe zestrojenie z decyzjami patologów, nawet jeśli nie przewyższył Groka pod względem surowej dokładności. Grok, choć ogólnie nieco bardziej dokładny, czasami wybierał inne opcje niż eksperci w kilku trudnych przypadkach. Większość błędów wszystkich trzech systemów występowała na preparatach wizualnie mylących nawet dla wyszkolonego oka, gdzie zmiany tkankowe nakładały się lub wyglądały na graniczne między dwoma stanami. Mimo to nie zaobserwowano dużych rozbieżności w wydajności modeli, a wszystkie trzy wykazały poziomy zgodności z ludźmi określane przez autorów jako umiarkowane do znacznych.

Co to może oznaczać dla przyszłej opieki

Badanie sugeruje, że dzisiejsze systemy AI wielomodalnej natury są już zdolne pełnić rolę wiarygodnych pomocników w mikroskopowej diagnostyce chorób jamy ustnej. Nie zastąpią patologów, którzy nadal osiągali najlepszą ogólną dokładność i dostarczają niezbędnego osądu klinicznego, ale mogą działać jako szybcy „drudzy czytelnicy”, wspierać szkolenie nowicjuszy lub oferować pomoc na poziomie eksperckim w regionach o ograniczonym dostępie do usług patologii stomatologicznej. Ponieważ badanie wykorzystało starannie dobrane obrazy z podręcznika, a nie zanieczyszczone, rzeczywiste próbki kliniczne, autorzy podkreślają potrzebę dalszych testów na większych, bardziej zróżnicowanych zbiorach klinicznych oraz z dodatkowymi informacjami o pacjentach. Jeśli dalsze badania potwierdzą wstępne obiecujące wyniki, AI może uczynić diagnozowanie chorób jamy ustnej dokładniejszym, bardziej spójnym i bardziej dostępnym dla pacjentów na całym świecie.

Cytowanie: Alshammari, A.F., Madfa, A.A. & Anazi, B.A. Human versus artificial intelligence in oral pathology diagnosis: a comparative study of ChatGPT, Grok, and MANUS. Sci Rep 16, 11057 (2026). https://doi.org/10.1038/s41598-026-40792-0

Słowa kluczowe: patologia jamy ustnej, patologia cyfrowa, sztuczna inteligencja, duże modele językowe, diagnostyka histopatologiczna