Clear Sky Science · pl

Ocena modeli językowych AI w odpowiadaniu na pytania związane z ciążą oceniana przez specjalistów położnictwa

Dlaczego to ważne dla przyszłych rodziców

Ciąża to okres pełen pytań, a wiele osób sięga dziś po narzędzia online i czatboty, by szybko uzyskać odpowiedzi. W badaniu postawiono proste, lecz istotne pytanie: jak dobrze dziś popularne czatboty oparte na sztucznej inteligencji udzielają jasnych, dokładnych i uspokajających informacji na typowe wątpliwości związane z ciążą — takich, którym lekarze mogliby zaufać?

Porównanie trzech cyfrowych „silników odpowiedzi”

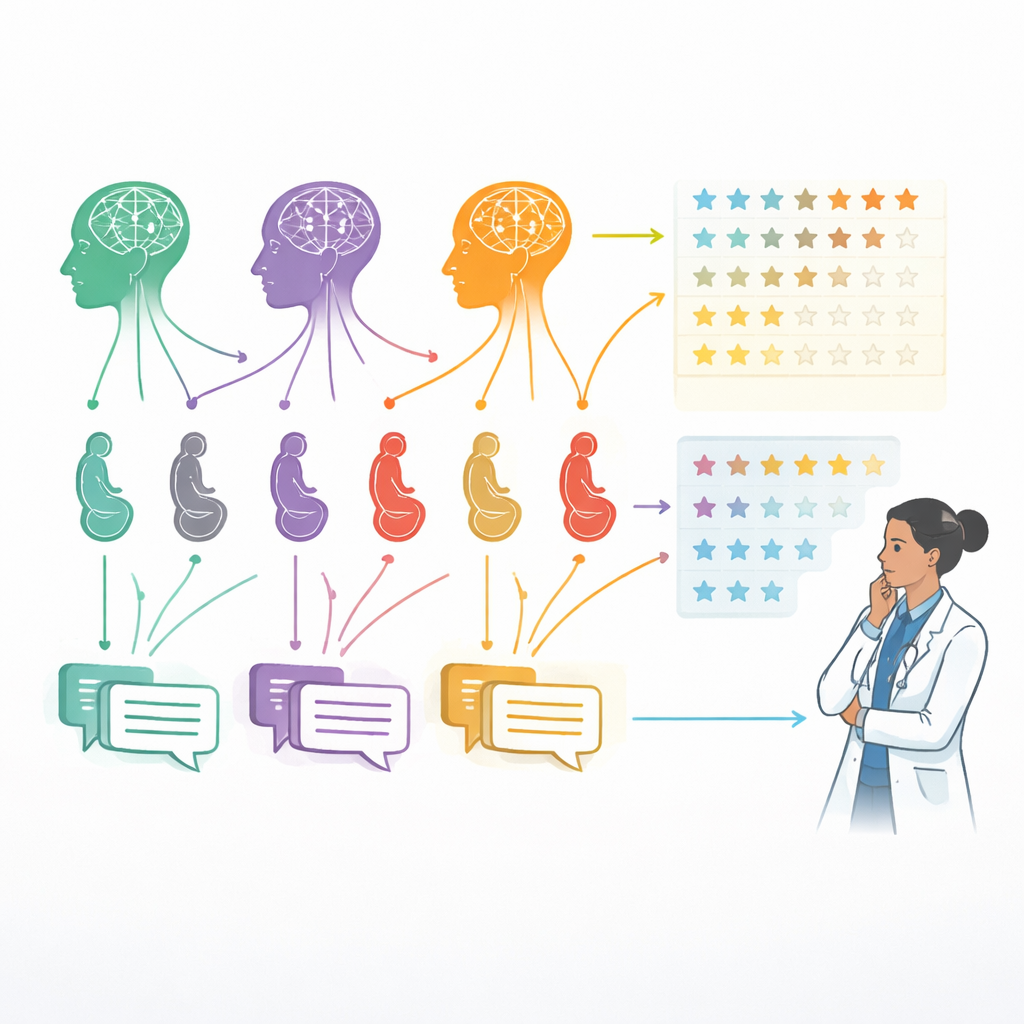

Naukowcy z Turcji postanowili porównać trzy znane modele językowe AI — wcześniejszą wersję ChatGPT (3.5), nowszą (4.0) oraz Geminiego od Google. Skoncentrowali się na dziesięciu codziennych pytaniach, które często zadają osoby w ciąży, takich jak: których pokarmów unikać, czy ćwiczenia i seks są bezpieczne, co może oznaczać wczesne krwawienie, jak interpretować ruchy płodu i które objawy wymagają pilnej opieki. Każde pytanie wprowadzono do wszystkich trzech systemów używając tych samych prostych instrukcji, z ustawieniami zmniejszającymi losowość, aby odpowiedzi były spójne, a nie rozmowne czy kreatywne.

Każdy model wygenerował jedną odpowiedź na pytanie, po turecku, bez dodatkowych podpowiedzi czy edycji. Odpowiedzi pozbawiono następnie wszelkich wskazówek mogłych ujawnić, który system je przygotował, i zamieszano w losowej kolejności. Dzięki temu recenzenci — specjaliści położnictwa i ginekologii — oceniali wyłącznie treść widoczną na stronie, a nie markę czy styl pisania, który mogliby rozpoznać.

Jak lekarze oceniali odpowiedzi

Siedemdziesięciu pięciu specjalistów położników, od lekarzy na wczesnym etapie kariery po bardzo doświadczonych klinicystów, oceniło wszystkie 30 zanonimizowanych odpowiedzi. Dla każdej odpowiedzi używali skali pięciopunktowej do oceny czterech cech: dokładności (czy odpowiada aktualnej wiedzy medycznej i wytycznym?), wiarygodności (czy przekaz jest wewnętrznie spójny i wolny od niebezpiecznych porad?), przyjazności dla pacjenta (czy ton jest odpowiedni i uspokajający dla osób bez specjalistycznej wiedzy?) oraz zrozumiałości (czy język jest jasny, dobrze zorganizowany i łatwy do śledzenia?). Łącznie eksperci dostarczyli 9 000 pojedynczych ocen — duży zbiór danych pozwalający wykryć istotne różnice między trzema narzędziami AI.

Zespół zastosował następnie metody statystyczne przeznaczone do analiz skal ocenianych. Sprawdzono także, jak spójnie różni lekarze oceniali te same odpowiedzi i czy bardziej doświadczeni klinicyści oceniali inaczej niż ich młodsi koledzy. Celem nie było stworzenie działającego czatbota, lecz dokładne zbadanie, jak systemy te zachowują się w kontrolowanych warunkach przy odpowiadaniu na realistyczne pytania ciążowe.

Który czatbot wypadł najlepiej?

W całym badaniu najlepiej wypadł nowszy ChatGPT-4.0. Lekarze ocenili jego odpowiedzi jako najbardziej dokładne i najbardziej przyjazne dla pacjenta; osiągnął też najlepsze wyniki pod względem wiarygodności. Gemini zwykle plasował się pośrodku: jego odpowiedzi były często klarowne i łatwe do czytania, a pod względem samej zrozumiałości był podobny do ChatGPT-4.0, lecz skłaniał się ku nieco mniejszej szczegółowości i precyzji. ChatGPT-3.5, starszy model, konsekwentnie otrzymywał najniższe oceny, często prezentując krótsze lub mniej kompletne wyjaśnienia. Co ciekawe, jeśli chodzi o podstawową klarowność i strukturę tekstu, wszystkie trzy modele były do siebie bliższe, co sugeruje, że uczynienie tekstu czytelnym może być łatwiejsze niż zapewnienie, aby każdy medyczny szczegół był poprawny i dobrze wyważony.

Oceny lekarzy były wysoce spójne między sobą, co wskazuje, że wyniki nie były napędzane przez kilka skrajnych opinii. Zanotowano umiarkowaną tendencję, że bardziej doświadczeni klinicyści wystawiali nieco wyższe oceny wiarygodności, lecz ich opinie nie różniły się znacząco w kwestii przyjazności czy łatwości zrozumienia odpowiedzi.

Co to oznacza w praktyce

Dla laika wniosek jest taki, że nowoczesne narzędzia AI — zwłaszcza ChatGPT-4.0 — potrafią już dostarczać informacji o ciąży, które wielu specjalistów położników ocenia jako względnie dokładne, bezpieczne i czytelne. Należy jednak podkreślić ważne ograniczenie: nawet najlepiej oceniany system nie zastępuje lekarza. Badanie nie porównywało odpowiedzi czatbotów ze „złotymi standardami” oficjalnych wytycznych ani nie sprawdzało, jak pacjenci faktycznie interpretują lub działają zgodnie z poradami. Ponieważ praca została wykonana w całości po turecku, wyniki w innych językach i kulturach mogą się różnić.

Mówiąc wprost, te czatboty AI mogą być przydatnym wsparciem przy zdobywaniu wiedzy o ciąży, zwłaszcza gdy wizyta w klinice jest daleko lub czas u specjalisty jest ograniczony. Mogą wspierać, ale nie powinny zastępować rozmów z pracownikami ochrony zdrowia. Autorzy podkreślają, że nadzór ekspertów pozostaje niezbędny, aby wychwycić błędy, unikać fałszywego uspokojenia i zapewnić, że sytuacje złożone lub wysokiego ryzyka otrzymają osobistą, stacjonarną opiekę, której wymagają.

Cytowanie: Keyif, B., Yurtçu, E., Başbuğ, A. et al. Evaluation of AI language models in answering pregnancy-related questions assessed by obstetrics specialists. Sci Rep 16, 9322 (2026). https://doi.org/10.1038/s41598-026-40609-0

Słowa kluczowe: edukacja ciążowa, czatboty AI, porady zdrowotne online, położnictwo, jakość informacji dla pacjenta