Clear Sky Science · pl

Równoważenie sprawiedliwości i skuteczności w predykcji stopnia glejaka przy użyciu technik łagodzenia uprzedzeń

Dlaczego równe traktowanie pacjentów ma znaczenie

Gdy lekarze wykorzystują sztuczną inteligencję do wspomagania diagnozy guzów mózgu, można założyć, że komputer jest neutralny. Jeśli jednak dane użyte do trenowania tych narzędzi odzwierciedlają istniejące nierówności zdrowotne, oprogramowanie może po cichu traktować niektórych pacjentów mniej sprawiedliwie. W tym badaniu przeanalizowano, jak systemy uczenia maszynowego przewidujące złośliwość glejaków — częstego typu nowotworu mózgu u dorosłych — mogą niezamierzenie faworyzować określone grupy rasowe lub płciowe, oraz przetestowano praktyczne sposoby uczynienia tych predykcji bardziej sprawiedliwymi bez nadmiernej utraty dokładności.

Guzy mózgu i narzędzia komputerowe

Glejaki to guzy mózgu o zróżnicowanym przebiegu — od wolniej rosnących, bardziej podatnych na leczenie postaci, po bardzo agresywne nowotwory ze złym rokowaniem. Prawidłowe określenie stopnia zaawansowania jest kluczowe, ponieważ kieruje decyzjami dotyczącymi operacji, radioterapii i leków. Badacze pracowali na publicznym zbiorze danych obejmującym 839 dorosłych z rozpoznaniem glejaka niskiego stopnia lub agresywnego glejaka wielopostaciowego. Dla każdego pacjenta mieli wiek, płeć, rasę oraz 20 powszechnych markerów genetycznych w guzie. Wytrenowali trzy standardowe modele predykcyjne — regresję logistyczną, lasy losowe i gradient boosting — aby odróżnić dwa stopnie guza na podstawie tych cech, a następnie ocenili zarówno ogólną dokładność modeli, jak i to, jak traktowały różne grupy pacjentów.

Poszukiwanie ukrytych nierówności

Aby zbadać sprawiedliwość, zespół skupił się na dwóch „chronionych” cechach: rasie (biali vs. nie-biali) oraz płci (mężczyźni vs. kobiety). Sam zbiór danych był zniekształcony — ponad 90 procent pacjentów stanowili biali, a mężczyzn było zauważalnie więcej niż kobiet. Autorzy zastosowali miary sprawiedliwości na poziomie grup, które porównują, jak często różne grupy otrzymują poprawną predykcję „wysokiego stopnia” oraz jak często model popełnia błędy dla każdej grupy. Wszystkie trzy modele były dość dokładne ogólnie, przy czym regresja logistyczna wypadała najlepiej. Jednak pod tą skutecznością kryły się problemy: pacjenci nie-biali zwykle osiągali gorsze wyniki niż pacjenci biali, zwłaszcza w prawidłowym rozpoznawaniu mniej agresywnych nowotworów. W przeciwieństwie do tego wydajność wobec mężczyzn i kobiet była znacznie bardziej zrównoważona, z jedynie niewielkimi różnicami między płciami.

Próby naprawy uprzedzeń

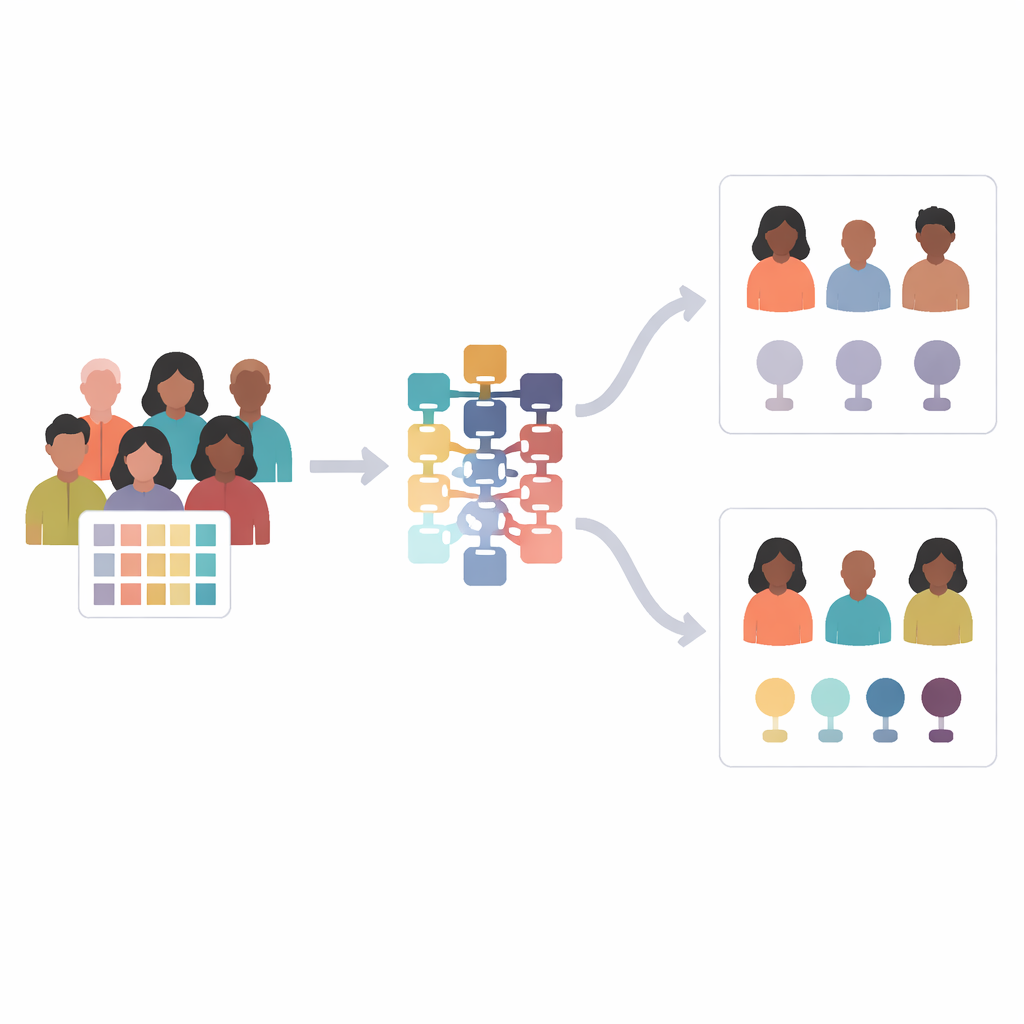

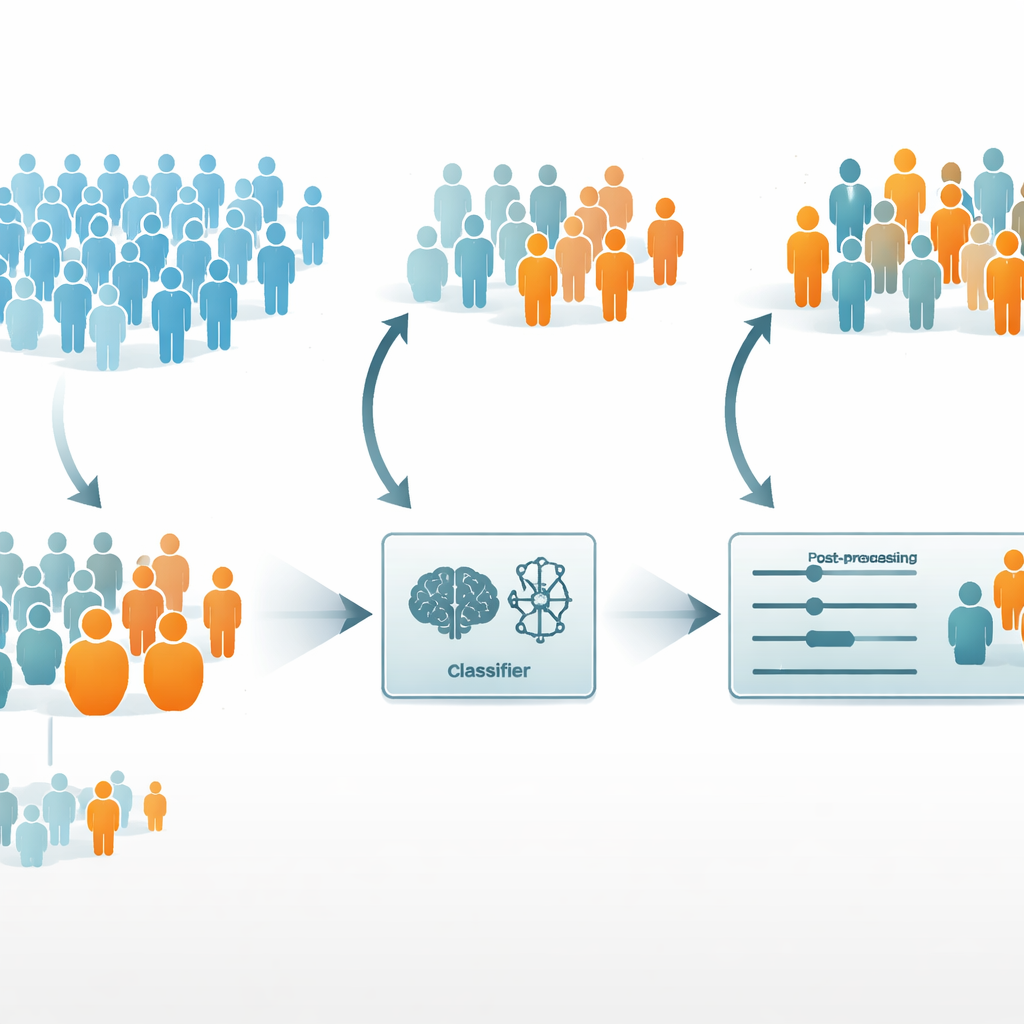

Następnie badacze zapytali, czy można poprawić sprawiedliwość bez poważnego osłabienia użyteczności medycznej modelu. Jako model bazowy wybrali regresję logistyczną, gdyż była zarówno najdokładniejsza, jak i najsprawiedliwsza z trzech. Wypróbowali dwie powszechne strategie ograniczania błędów. Podejście „przedprzetwarzania” zwane reweightingiem przypisywało większą wagę niedostatecznie reprezentowanym pacjentom podczas treningu, aby model zwracał na nich większą uwagę. Podejście „po-przetwarzania” zwane equalized odds zachowało wytrenowany model, ale dostosowało jego wyjścia tak, by wskaźniki błędów stały się bardziej podobne między grupami.

Co się zmieniło po korekcie modelu

W przypadku płci obie strategie generalnie pomagały: jakość predykcji dla kobiet poprawiła się, a różnice między mężczyznami i kobietami w dużej mierze się zmniejszyły. W przypadku rasy, gdzie nierównowaga w danych była znacznie silniejsza, obraz był bardziej złożony. Reweighting czasami działał odwrotnie, nieco pogarszając wydajność dla pacjentów nie-białych i nawet zwiększając niesprawiedliwość według niektórych miar. Natomiast metoda po-przetwarzania istotnie zmniejszyła rasowe różnice w wskaźnikach błędów przy zachowaniu wysokiej ogólnej dokładności modelu, choć nieznacznie obniżyła wydajność dla grupy większościowej. Autorzy pokazali też, że miary sprawiedliwości dla znacznie mniejszej grupy nie-białej są statystycznie niestabilne — zmiana predykcji nawet jednej osoby może zauważalnie przesunąć wyniki sprawiedliwości — więc te wyniki należy interpretować ostrożnie.

Co to oznacza dla pacjentów i lekarzy

Badanie konkluduje, że nie ma darmowego rozwiązania: poprawa sprawiedliwości w medycznym AI często wiąże się z kompromisami w wydajności, a najlepsza metoda zależy od stopnia zniekształcenia danych i priorytetów dotyczących celu sprawiedliwości. W tym przykładzie z guzami mózgu korekta wyjść modelu po treningu okazała się najpraktyczniejszym sposobem na uczynienie rekomendacji terapeutycznych bardziej wyrównanych względem rasy i płci, przy jednoczesnym zachowaniu silnej mocy predykcyjnej. Praca podkreśla, że kontrole sprawiedliwości powinny być rutynowym elementem wdrażania AI w opiece zdrowotnej, zwłaszcza w przypadku poważnych schorzeń jak glejak, oraz że istnieją metody na zwiększenie sprawiedliwości tych narzędzi — lecz muszą być dobrane i interpretowane z rozwagą.

Cytowanie: Sánchez-Marqués, R., García, V. & Sánchez, J.S. Addressing the balance between fairness and performance in glioma grade prediction using bias mitigation techniques. Sci Rep 16, 9785 (2026). https://doi.org/10.1038/s41598-026-40555-x

Słowa kluczowe: ocena stopnia glejaka, uczciwość AI w medycynie, uprzedzenia algorytmiczne, guzy mózgu, łagodzenie uprzedzeń