Clear Sky Science · pl

Przypisywanie źródła aparatu przy użyciu regułowej, wyjaśnialnej konwolucyjnej sieci neuronowej

Dlaczego twoje zdjęcia mogą powiedzieć więcej, niż myślisz

Każde zdjęcie, które robisz, zawiera ukryte wskazówki dotyczące aparatu, który je wykonał. Dla śledczych cyfrowych te ślady mogą pomóc potwierdzić autentyczność obrazu, ustalić, z jakiego urządzenia pochodzi, lub powiązać fotografie z różnych miejsc zdarzeń. Dziś potężne narzędzia sztucznej inteligencji (SI) mogą wychwytywać te wzorce lepiej niż ludzie — jednak często działają jak tajemnicze „czarne skrzynki”. Niniejszy artykuł przedstawia sposób otwarcia tej skrzynki: metodę opartą na regułach, która wyjaśnia, w formie zrozumiałej dla człowieka, jak model głębokiego uczenia dochodzi do wniosku, który aparat wykonał zdjęcie.

Problem zaufania do zaawansowanych narzędzi śledczych

Współczesna informatyka śledcza musi przesiać ogromne ilości danych — ze smartfonów, kopii zapasowych w chmurze i mediów społecznościowych — znacznie więcej, niż analitycy mogą przejrzeć ręcznie. Systemy głębokiego uczenia potrafią szybko wskazać istotne obrazy, ale ich działanie jest z natury nieprzejrzyste. W wrażliwych kontekstach, takich jak sale sądowe, samo stwierdzenie „sieć neuronowa tak oceniła” nie wystarcza. Istniejące narzędzia wyjaśniające zwykle podświetlają obszary obrazu, które model uznał za ważne, co jest przydatne przy rozpoznawaniu twarzy czy obiektów. Jednak w przypadku identyfikacji źródła aparatu kluczowy sygnał nie ma postaci widocznej cechy, lecz słabych odcisków sensora — subtelnych wzorców szumów, których człowiek nie widzi. W rezultacie dzisiejsze wizualne narzędzia wyjaśniające nie ukazują w jasny sposób, dlaczego model uważa, że zdjęcie pochodzi z konkretnego aparatu, ani nie pomagają biegłym wykryć, kiedy model się myli.

Nowy sposób obserwowania myślenia sieci neuronowej

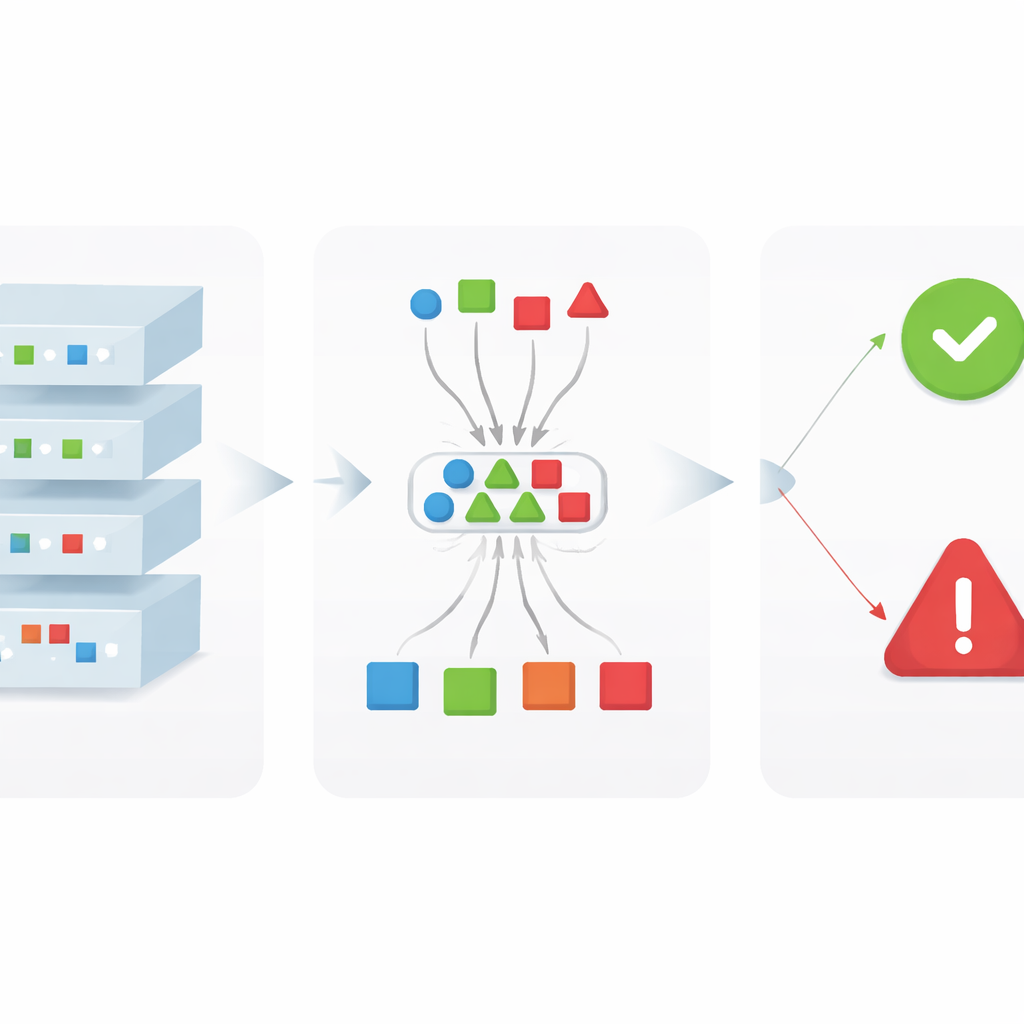

Autorzy przedstawiają xDFAI, ramy zaprojektowane specjalnie dla informatyki śledczej, które wyjaśniają, jak konwolucyjna sieć neuronowa (CNN) dochodzi do swoich decyzji, bez zmieniania oryginalnego modelu. Zamiast traktować sieć jako jedną nieprzejrzystą skrzynkę, xDFAI zagląda do środka warstwa po warstwie. Dla każdej warstwy i każdej klasy aparatu identyfikuje zestaw powtarzalnych wzorców wewnętrznych, zwanych „śladem”, które konsekwentnie się aktywują, gdy model uważa, że zdjęcie należy do danego aparatu. Te ślady są wydobywane z wytrenowanego modelu za pomocą istniejących metod atrybucji, a następnie filtrowane tak, by zachować tylko te wzorce, które pojawiają się niezawodnie w wielu obrazach treningowych. Razem tworzą uporządkowaną mapę tego, jak wskazówki dotyczące tożsamości aparatu ewoluują w miarę przepływu obrazu przez sieć.

Puszczenie warstw, by głosowały i przekształcanie głosów w reguły

Gdy ślady są znane, xDFAI używa ich do badania nowych, niewidzianych obrazów. Dla danego zdjęcia testowego ramy mierzą, jak podobne są jego wewnętrzne aktywacje do przechowywanych śladów dla każdego aparatu na każdej warstwie. Każda warstwa w praktyce oddaje głosy na modele aparatów, których ślady najlepiej do niej pasują. Pomiędzy warstwami przeprowadzane jest „głosowanie większościowe”, które podsumowuje, jak silne jest wsparcie całej sieci dla poszczególnych kandydatów. Co istotne, autorzy nie używają tego głosowania do zastąpienia predykcji modelu; wykorzystują je jako kontrolę. Proste reguły logiczne porównują głos większościowy z oryginalną prognozą: jeśli przewidywany aparat otrzymuje również silne wsparcie z wielu warstw, decyzja zostaje potwierdzona; jeśli głosy są rozproszone lub faworyzują inny aparat, zachowanie jest oznaczane jako nietypowe i prezentowane biegłemu jako potencjalny błąd modelu.

Testy ram

Aby zademonstrować xDFAI, autorzy zastosowali go do siedmiowarstwowej CNN wytrenowanej do rozpoznawania, który z 27 modeli aparatów wykonał obraz, korzystając ze znanego zbioru danych śledczych. Sama bazowa CNN osiąga już bardzo dobre wyniki, poprawnie klasyfikując około 97% obrazów testowych. Gdy na to nałożono reguły xDFAI, system automatycznie oznaczył jako podejrzane 27 z 37 błędnych predykcji. Oznaczone przypadki nie są już traktowane jako pewne identyfikacje, co podniosło precyzję — odsetek zaakceptowanych decyzji, które są faktycznie poprawne — z 97,33% do 99,2%, przy jedynie nieznacznym spadku ogólnej dokładności. W pracy śledczej, gdzie pojedyncze błędne przypisanie może mieć poważne konsekwencje, taki kompromis jest wysoce pożądany: mniej fałszywych wniosków wśród konkluzji, którym analitycy decydują się ufać.

Co to oznacza dla rzeczywistych śledztw

Praca ta pokazuje, że można zachować pełną moc nowoczesnego modelu głębokiego uczenia, dodając jednocześnie przyjazne dla człowieka wyjaśnienia, które respektują zasady uczciwości śledczej — bez retreningu, bez manipulowania oryginalnym modelem i bez polegania wyłącznie na niejasnych mapach cieplnych. Eksponując stabilne wewnętrzne ślady, agregując je przez przejrzysty system głosowania i wyrażając wynik za pomocą prostych reguł, xDFAI daje biegłym sposób na potwierdzenie lub zakwestionowanie przypisań aparatów wygenerowanych przez SI. Chociaż badanie koncentruje się na identyfikacji źródła aparatu, te same pomysły można rozszerzyć na inne zadania przypisywania w informatyce śledczej. Na dłuższą metę podejścia tego typu mogą pomóc zasypać przepaść między wysoce dokładnymi systemami SI a poziomem przejrzystości i niezawodności wymaganym w sądach i praktyce śledczej.

Cytowanie: Nayerifard, T., Amintoosi, H. & Ghaemi Bafghi, A. Source camera attribution using a rule-based explainable convolutional neural network. Sci Rep 16, 9137 (2026). https://doi.org/10.1038/s41598-026-40387-9

Słowa kluczowe: informatyka śledcza, wyjaśnialna SI, identyfikacja aparatu, konwolucyjne sieci neuronowe, informatyka obrazowa