Clear Sky Science · pl

Koloryzacja obrazów oparta na głębokim transferze uczenia z użyciem VGG19 i CLAHE

Przywracanie dawnych zdjęć do życia

Wielu z nas ma pudełka ze starymi czarno‑białymi zdjęciami rodzinnymi lub ogląda klasyczne filmy i vintage dokumenty. Wyobrażenie sobie, jak te sceny wyglądały w rzeczywistości — niebieskie niebo, zielone pola, ciepłe odcienie skóry — może sprawić, że przeszłość stanie się bliższa i bardziej namacalna. W artykule przedstawiono nową metodę komputerową, która automatycznie dodaje realistyczne kolory i przyjemny kontrast do obrazów w skali szarości, ułatwiając restaurację starych fotografii, odświeżanie czarno‑białych filmów, a nawet poprawę skanów medycznych, bez potrzeby ręcznego malowania każdego odcienia przez eksperta.

Od ręcznego nadawania barw do inteligentnych maszyn

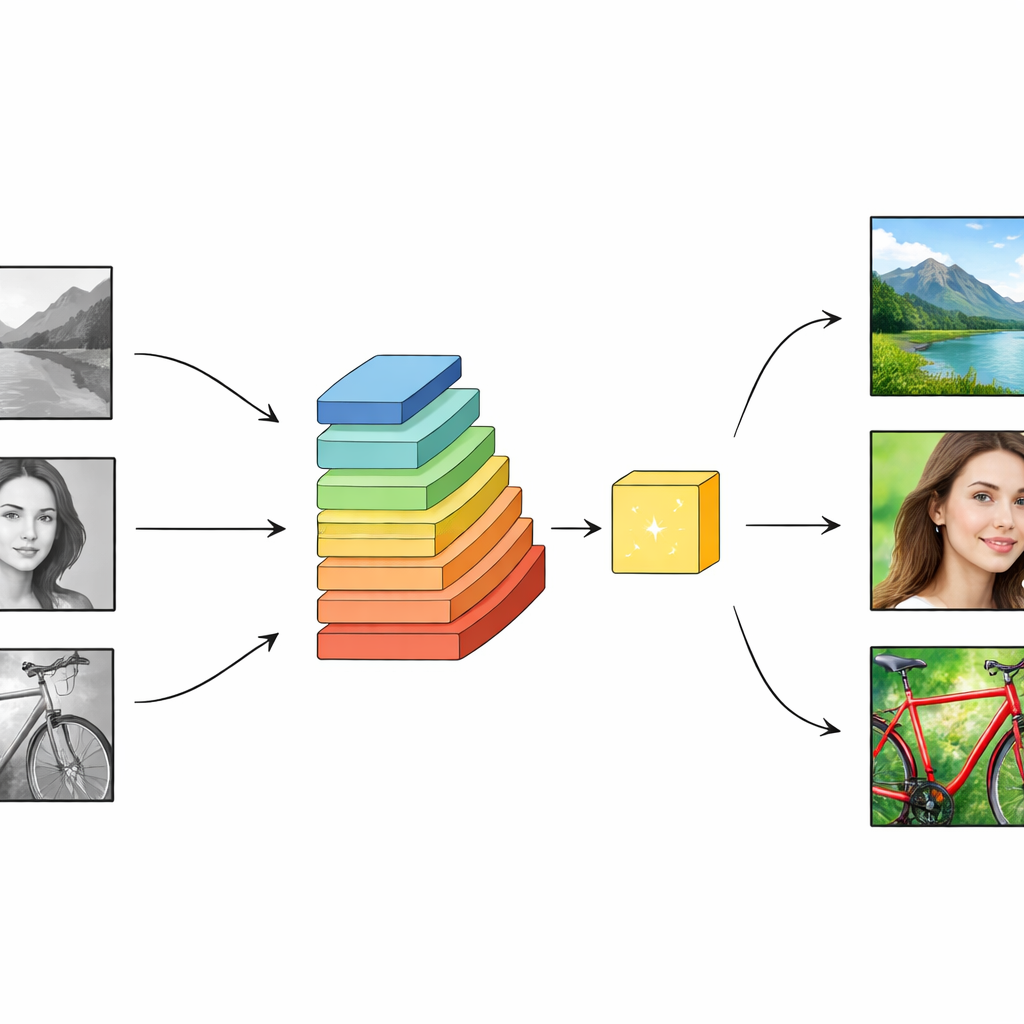

Koloryzacja obrazów jest trudniejsza, niż się wydaje, ponieważ pojedynczy odcień szarości może odpowiadać wielu możliwym kolorom: średni szary może być czerwonej cegły, zielonego listka lub niebieskiej koszuli. Wcześniejsze narzędzia w dużej mierze polegały na wskazówkach od ludzi. Artyści mogli nanosić szybkie „mazania” kolorami na fragmenty obrazu, a oprogramowanie rozprzestrzeniało te podpowiedzi na podobne regiony. Inne systemy pobierały kolory z referencyjnego zdjęcia o podobnej treści. Choć metody te bywały przekonujące, zawodzą, gdy wskazówek jest mało, zdjęcie referencyjne nie pasuje idealnie lub scena jest złożona. Wraz z rozwojem głębokiego uczenia pojawiły się programy uczące się bezpośrednio „zgadywać” kolory na podstawie dużych zbiorów przykładowych zdjęć, co zmniejszyło potrzebę pracy ręcznej, ale wymagało ogromnego czasu treningu i mocy obliczeniowej.

Nauczanie sieci, jak wygląda świat

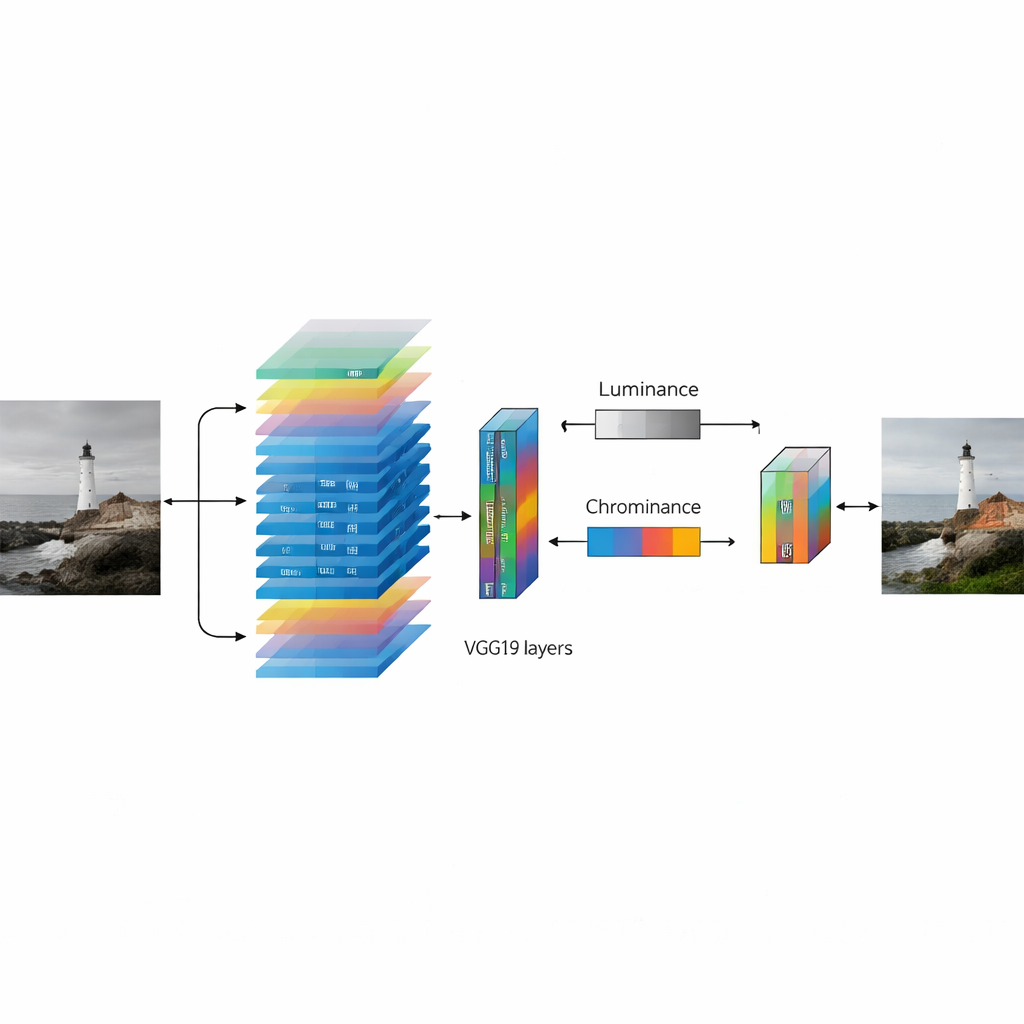

Autorzy budują na tych postępach strategię znaną jako transfer learning. Zamiast trenować nowy system od zera, ponownie wykorzystują silną sieci wizji o nazwie VGG19, która została już wytrenowana na milionach kolorowych obrazów. Sieć ta ma wiele warstw, które stopniowo przechodzą od prostych wzorców, takich jak krawędzie i tekstury, do całych obiektów i scen: twarzy, drzew, budynków, nieba. System koloryzacji podaje do VGG19 wersję obrazu w skali szarości i zbiera cechy z kilku warstw jednocześnie, tworząc bogą „stos” informacji dla każdego piksela. To pomaga modelowi rozumieć zarówno drobne detale — takie jak pasma włosów czy krawędzie liści — jak i szerszy kontekst, np. czy scena to plaża, ulica miejska czy las. Dzięki temu sieć jest lepiej przygotowana do wyboru wiarygodnych kolorów, a nie tylko matematycznie dopuszczalnych.

Przekształcanie światła i cienia w kolor i kontrast

Aby decyzje kolorystyczne były stabilniejsze, metoda reprezentuje obrazy w układzie barw rozdzielającym jasność od zawartości koloru. Wejście w skali szarości pełni rolę kanału jasności, podczas gdy zadaniem sieci jest przewidzieć dwa pozostałe kanały, które kodują subtelne przesunięcia między czerwienią a zielenią oraz między niebieskim a żółtym. Utrzymując jasność niezmienioną, system zachowuje oryginalne cieniowanie i strukturę obrazu. Po tym, jak sieć wygeneruje najlepsze przypuszczenie brakującej informacji o kolorze, stosowany jest końcowy etap poprawy. Autorzy używają tutaj techniki zwanej adaptacyjną equalizacją histogramu, która lokalnie rozciąga zakres między ciemnymi i jasnymi obszarami. To sprawia, że tekstury są bardziej czytelne, krawędzie ostrzejsze, a kolory wydają się bardziej żywe, bez prostego „przepalania” jasnych fragmentów czy utraty detali w cieniach.

Sprawdzanie metody w praktyce

Aby ocenić, jak dobrze ich podejście sprawdza się w praktyce, badacze trenowali i testowali je na kilku dobrze znanych zbiorach obrazów obejmujących obiekty, sceny, ludzi i codzienne środowiska. Porównali swoje wyniki z różnymi konkurencyjnymi metodami, w tym systemami opartymi na wskazówkach użytkownika, modelami generatywnymi próbującymi wymyślić realistyczne obrazy oraz nowszymi modelami opartymi na transformatorach. Korzystając ze standardowych miar jakości obrazu, ich metoda konsekwentnie generowała bardziej ostrą, wierniejszą kolorystykę i wyraźniejszą strukturę, ze szczególnie dobrą skutecznością na wymagającym zbiorze zdjęć scen. Porównania wizualne pokazują, że ich zkoloryzowane wyniki często wyglądają bliżej oryginalnych zdjęć kolorowych, z bogatszym, lecz kontrolowanym nasyceniem i lepiej zbalansowanym kontrastem. Wskazują też, gdzie metoda ma trudności: bardzo ciemne lub nadmiernie jasne obrazy albo sceny o nietypowych teksturach i rzadkich kolorach nadal mogą prowadzić do dziwnych odcieni lub nierównomiernego oświetlenia.

Co to oznacza dla codziennych obrazów

Mówiąc prosto, badanie pokazuje, że wyposażenie systemu koloryzacji w silne wcześniejsze „wykształcenie” o świecie wizualnym — a następnie staranna poprawa wyniku — może tworzyć obrazy, które dla ludzkiego oka wyglądają bardziej naturalnie. Opierając się na dużej, wstępnie wytrenowanej sieci i dodając inteligentny krok wzmacniający kontrast, autorzy dostarczają praktyczne narzędzie, które może tchnąć życie w historyczne fotografie, wzbogacić czarno‑białe filmy i ułatwić interpretację niektórych rodzajów obrazów medycznych. Choć nie jest to rozwiązanie idealne i może zawodzić przy skrajnych warunkach oświetleniowych lub bardzo niezwykłych scenach, podejście to przybliża automatyczną koloryzację do poziomu, na którym mogą z niej korzystać osoby niebędące ekspertami, czyniąc realistyczny kolor osiągalnym dla szerokiego zakresu codziennych zastosowań.

Cytowanie: Ghosh, N., Mandal, G. Deep transfer learning based image colorization using VGG19 and CLAHE. Sci Rep 16, 9528 (2026). https://doi.org/10.1038/s41598-026-40292-1

Słowa kluczowe: koloryzacja obrazów, głębokie uczenie, transfer learning, restauracja zdjęć, wzmocnienie kontrastu