Clear Sky Science · pl

Zintegrowane ramy proaktywnego przeciwdziałania deepfakom poprzez znakowanie wodne sterowane uwagą i weryfikację autentyczności opartą na blockchainie

Dlaczego sfałszowane filmy dotyczą nas wszystkich

Filmy, które wyglądają i brzmią jak prawdziwe, można dziś fałszować za pomocą gotowego oprogramowania, zacierając granicę między prawdą a fikcją w internecie. Tak zwane deepfaki są już wykorzystywane do oszustw, nękania i manipulacji politycznych. Zamiast próbować wykrywać fałszerstwa dopiero po ich rozprzestrzenieniu, to badanie stawia inne pytanie: co jeśli moglibyśmy dyskretnie chronić autentyczne nagrania w chwili ich tworzenia, tak aby każda późniejsza manipulacja stała się oczywista?

Od ścigania fałszywek do ochrony oryginałów

Większość aktualnych badań stara się łapać deepfaki po fakcie, trenując algorytmy do wykrywania drobnych artefaktów pozostawionych przez modele generatywne. Jednak w miarę poprawy tych modeli ta gra w kotka i myszkę staje się coraz trudniejsza do wygrania. Autorzy opowiadają się za podejściem proaktywnym: ochroną autentycznego materiału w chwili nagrania, tak aby widzowie i platformy mogli później zweryfikować, czy to, co widzą, jest nienaruszonym oryginałem. Ich ramy łączą trzy warstwy: inteligentny analizator wideo, który decyduje, gdzie ochrona ma największe znaczenie; niewidoczny znak cyfrowy wplatany w każdą klatkę; oraz zapis w blockchainie, który utrwala tożsamość całego pliku.

Nauczanie systemu, co naprawdę ma znaczenie w wideo

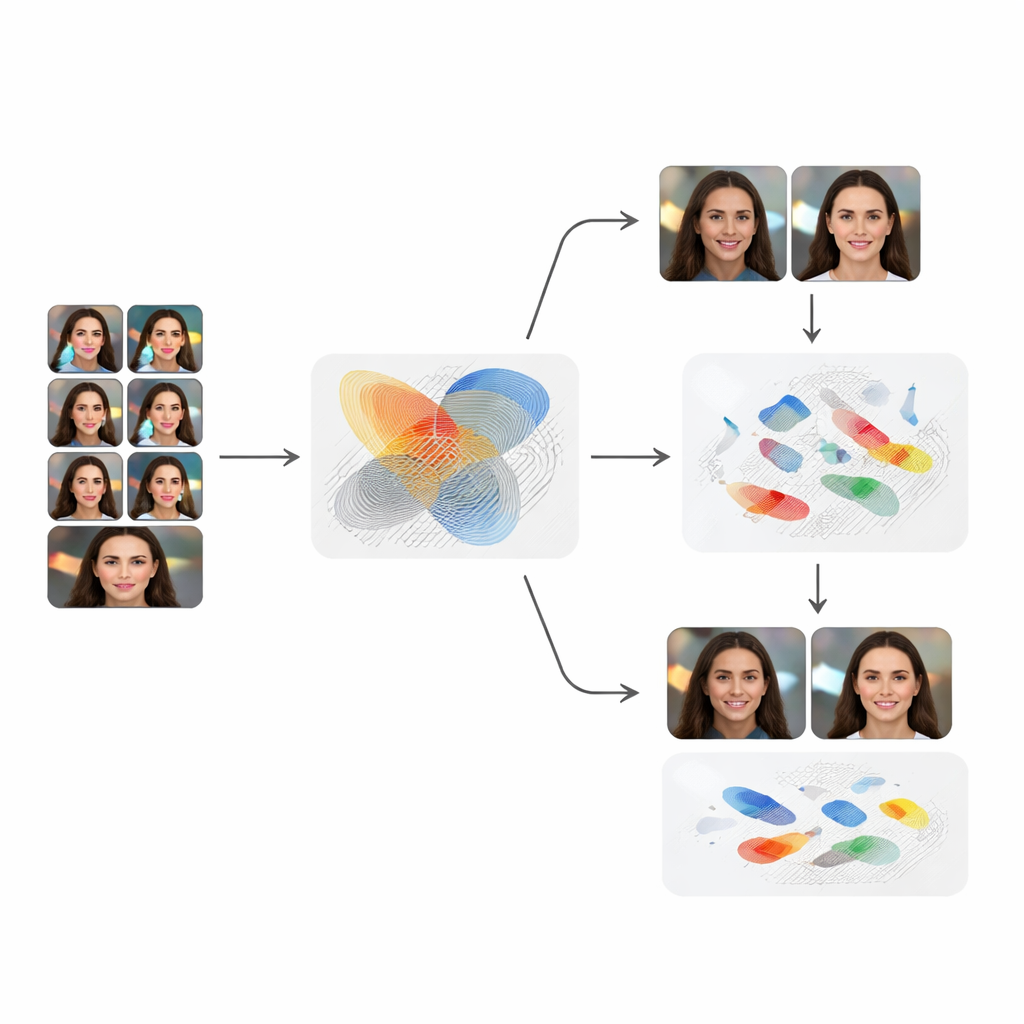

Pierwszą warstwą jest model uwagi, który uczy się, które części wideo zawierają najbardziej znaczący ruch i szczegóły w czasie. Zespół trenuje kompaktową, lecz wydajną sieć na tysiącach codziennych klipów ukazujących osoby wykonujące różne czynności. Część sieci bada każdą klatkę jak fotografię, podczas gdy inna analizuje, jak obiekty poruszają się w 16‑klatkowych fragmentach. Razem osiągają ponad 97% trafności w standardowym teście rozpoznawania akcji, co pokazuje, że system nauczył się bogatych wzorców zmian ludzi i scen w czasie. Wzorce te są następnie przekształcane w mapy uwagi, które podkreślają obszary, gdzie każda manipulacja najbardziej wpłynęłaby na narrację wideo.

Ukrywanie tajnego znaku tam, gdzie fałszerze zrobią największe szkody

Następnie w każdą klatkę osadzany jest niewidoczny znak cyfrowy — znak wodny — ale nie w prosty, jednolity sposób. Sieć generatywna tworzy subtelny, szumopodobny wzór, który jest silniej wtapiany w obszary wskazane przez model uwagi jako ważne, takie jak twarze czy poruszające się dłonie, a słabiej w innych miejscach, by zachować jakość obrazu. Widzowie nie zauważają różnicy, a oceny jakości potwierdzają, że znakowane klatki są niemal nieodróżnialne od oryginałów. Jednocześnie wzór jest na tyle silny i złożony, że towarzysząca sieć, wytrenowana jako rodzaj dekodera, może później odzyskać ukrytą sygnaturę z autentycznego materiału, klatka po klatce.

Testowanie odporności na deepfaki i codzienne zniekształcenia

Aby sprawdzić, czy ochrona sprawdza się w realnym świecie, autorzy przeprowadzają serię testów obciążeniowych. Najpierw znakują wodnie różnorodny zestaw krótkich materiałów stockowych, a następnie wprowadzają je do DeepFaceLab — jednego z powszechnie używanych narzędzi do zamiany twarzy — aby stworzyć przekonujące deepfaki. W każdym z 50 zmanipulowanych klipów ukryty znak albo zostaje zniszczony, albo poważnie zniekształcony, a system prawidłowo oznacza wideo jako zmienione. Metoda dobrze znosi także typowe operacje przetwarzania, takie jak silna rekompresja, zmiana rozmiaru czy rozmycie, które często występują przy udostępnianiu klipów online, chociaż bardzo silny losowy szum ostatecznie może przytłoczyć ukryty sygnał. Dokładne eksperymenty pokazują, że zarówno prowadzenie poprzez mapy uwagi, jak i wykorzystanie ruchu w czasie są kluczowe; usunięcie któregoś z tych elementów znacznie osłabia ochronę.

Utrwalenie zaufania poprzez trwały odcisk palca

Ostatnia warstwa wychodzi poza zawartość klatek i zabezpiecza sam plik wideo. Po znakowaniu cały plik jest przetwarzany funkcją kryptograficzną, która generuje krótki cyfrowy odcisk palca. Ten odcisk, wraz z podstawowymi informacjami o klipie, zostaje zapisany w księdze rozproszonej (blockchain), gdzie nie można go zmienić bez pozostawienia śladu. Później każdy może przesłać kopię wideo: system stara się odzyskać znak wodny i dodatkowo ponownie oblicza odcisk palca. Jeśli zarówno ukryty znak, jak i kryptograficzny odcisk palca zgadzają się z oryginalnymi zapisami, wideo można uznać za autentyczne z wysokim poziomem pewności; jeśli którykolwiek z nich nie pasuje, widzowie wiedzą, że materiał został zmieniony.

Co to oznacza dla filmów, które oglądasz

Mówiąc prosto, praca ta pokazuje, że można przejść od zgadywania, czy wideo jest fałszywe, do udowadniania, że wideo jest prawdziwe. Poprzez dyskretne wplatane inteligentnego, trudnego do podrobienia znaku w najbardziej znaczące części każdej klatki i wsparcie tego niezmienialnym wpisem w księdze rozproszonej, ramy wykrywają wszystkie testowane ataki typu face‑swap i wytrzymują wiele codziennych zniekształceń. Chociaż metoda nadal ma problemy w warunkach ekstremalnego szumu wizualnego i wymaga szerszych testów, wskazuje na przyszłość, w której kamery, platformy i redakcje będą dostarczać wideo z wbudowanym dowodem autentyczności — co znacznie utrudni deepfakom przechodzenie za prawdę.

Cytowanie: Hajjej, F., Hamid, M. & Alluhaidan, A.S. An integrated framework for proactive deepfake mitigation via attention-driven watermarking and blockchain-based authenticity verification. Sci Rep 16, 9545 (2026). https://doi.org/10.1038/s41598-026-40166-6

Słowa kluczowe: ochrona przed deepfakami, autentyczność wideo, cyfrowe znakowanie wodne, weryfikacja blockchain, bezpieczeństwo mediów