Clear Sky Science · pl

Wpływ generatywnej sztucznej inteligencji na media społecznościowe: badanie eksperymentalne

Dlaczego to ma znaczenie dla twojego życia online

Coraz większa część tego, co czytamy i piszemy w mediach społecznościowych, jest po cichu kształtowana przez sztuczną inteligencję. Badanie stawia pytanie dotyczące każdego, kto publikuje, komentuje lub przewija: gdy SI pomaga ludziom pisać, czy poprawia ona jakość rozmów, czy tylko je zagłusza? Odtwarzając przestrzeń dyskusyjną w stylu mediów społecznościowych z udziałem setek zwykłych użytkowników, badacze pokazują, że narzędzia AI mogą przyciągać więcej osób do rozmowy — ale mogą też sprawiać, że te rozmowy wydają się bardziej ogólne, mniej godne zaufania i mniej ludzkie.

Budowanie realistycznej rozmowy online

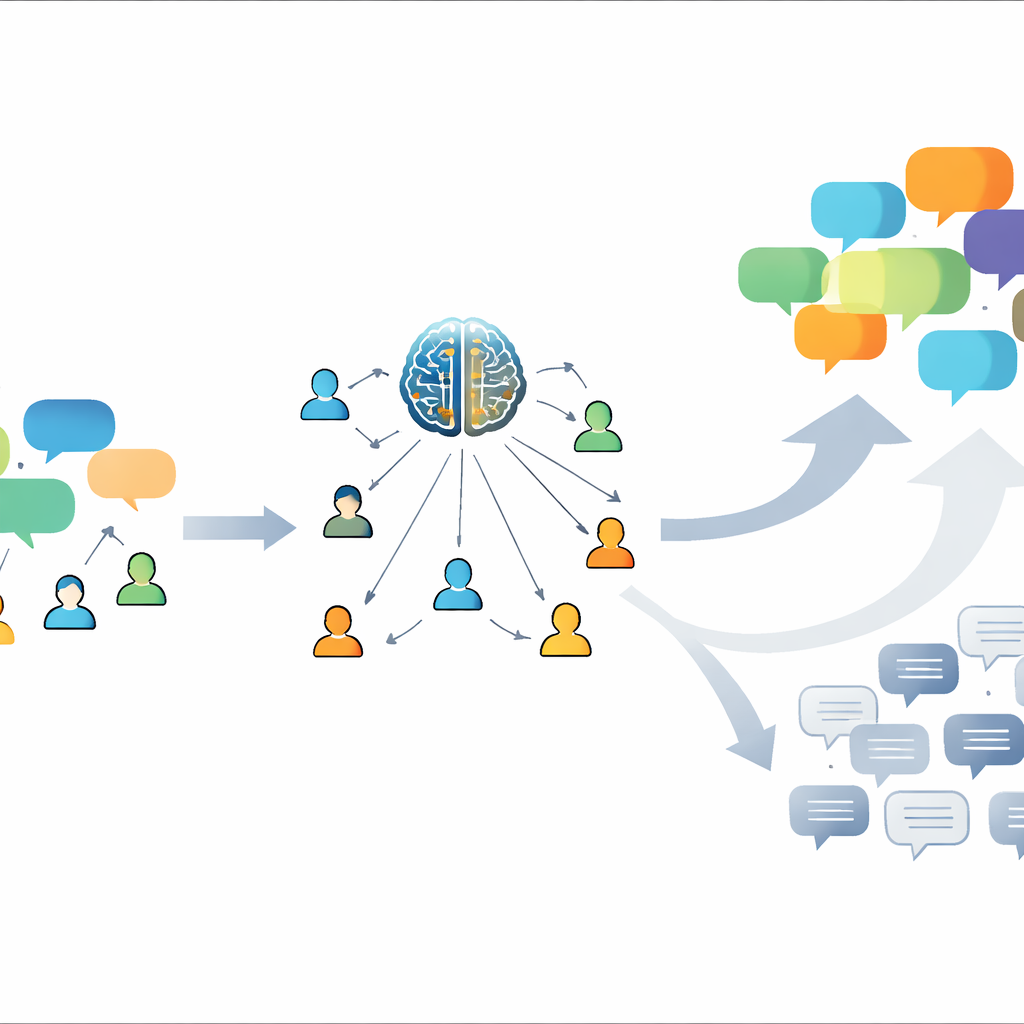

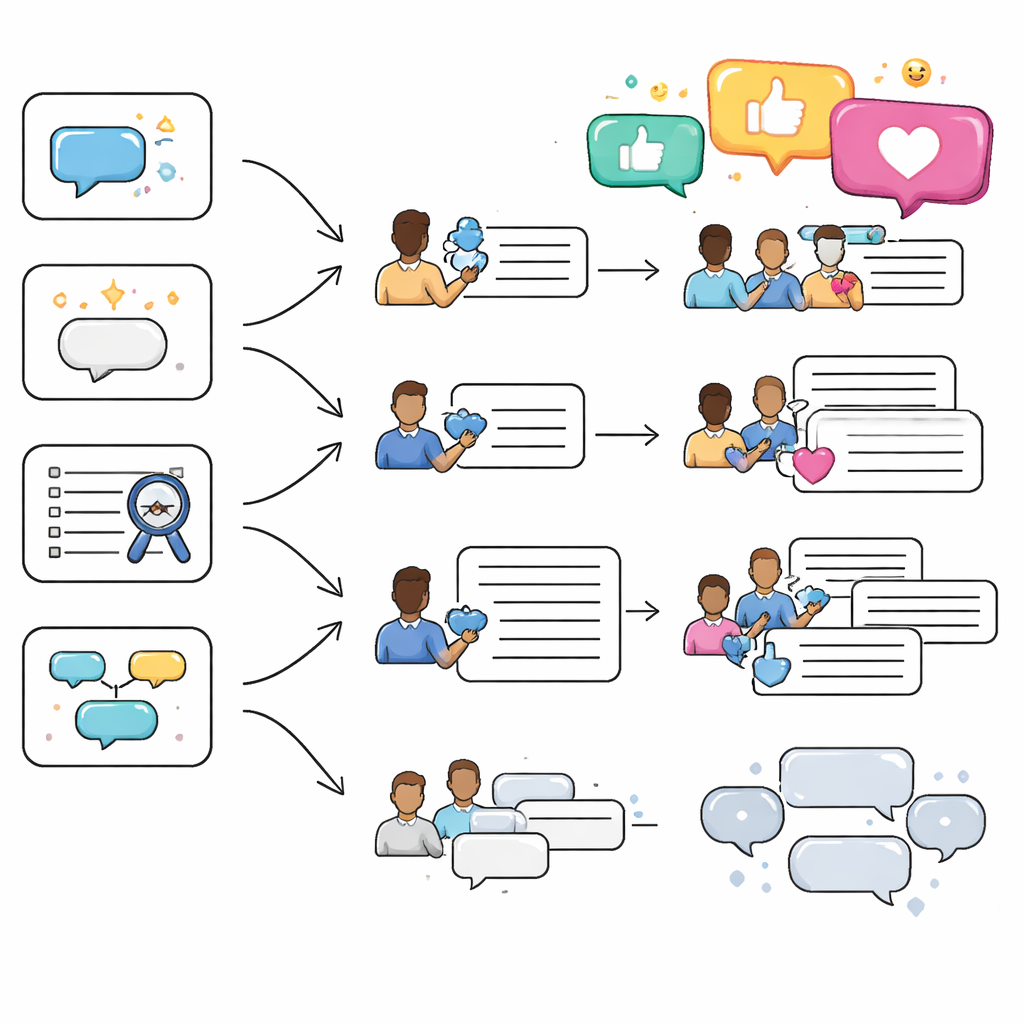

Aby zbadać te kwestie, zespół stworzył własną platformę dyskusyjną wzorowaną na popularnych forach. Sześćset osiemdziesiąt dorosłych z całych Stanów Zjednoczonych zostało podzielonych na małe grupy po pięć osób i poproszonych o debatę na trzy rodzaje tematów: lekki (koty kontra psy), związany z nauką (korzyści zdrowotne owsa) oraz polityczny (uniwersalny dochód podstawowy). Niektóre grupy nie korzystały w ogóle z technologii. Inne używały jednego z czterech różnych narzędzi SI: otwartego asystenta czatu, krótkich AI-generowanych starterów rozmowy, sugestii odpowiedzi lub informacji zwrotnej do szkiców napisanych przez uczestników. Takie ustawienie pozwoliło badaczom porównać, jak ludzie się zachowywali i jak oceniali dyskusję z pomocą SI i bez niej.

Więcej głosów i dłuższe wpisy, ale mieszane odczucia

Na pewnym poziomie narzędzia AI zrobiły dokładnie to, czego projektanci mogliby oczekiwać. Uczestnicy korzystający z pomocy SI pisali więcej i dłuższe komentarze niż ci z grup kontrolnych. Niektóre narzędzia zachęcały też do szerszego udziału, dzięki czemu dyskusja była mniej zdominowana przez jedną lub dwie osoby. Na przykład AI-generowane wstępne pytania pomagały cichszym użytkownikom włączyć się do rozmowy, a asystent czatu sprawiał, że ludzie czuli się chętniej do publikowania, dostarczając pomysłów, faktów czy sformułowań, gdy nie wiedzieli, co napisać.

Kiedy pomoc staje się pustą

Jednak z perspektywy czytelnika obraz się zmienił. W większości warunków z użyciem SI ludzie oceniali to, co widzieli, jako mniej informacyjne i niższej jakości niż w dyskusjach prowadzonych wyłącznie przez ludzi. Reagowali większą liczbą „nie lubię” i opisywali wiele komentarzy wpływanych przez SI jako „robotyczne” lub „ogólne”. Choć sugestie odpowiedzi bywały czasem doceniane, inne narzędzia sprawiały, że ton dyskusji wydawał się mniej autentyczny. Nawet ci, którzy sami nie korzystali z SI, mogli odczuć jej obecność po wejściu wątków, ponieważ przesuwała ona ogólny styl wypowiedzi w stronę dłuższych, lecz mniej znaczących odpowiedzi — rodzaj „semantycznych odpadów”, które zagracają przestrzeń bez dodawania istotnej treści.

Jak ludzie faktycznie korzystali z narzędzi

Szczegółowa analiza zachowań ujawniła, że uczestnicy nie traktowali wszystkich form pomocy SI jednakowo. Asystent czatu był szeroko używany, zwłaszcza do sprawdzania faktów w temacie naukowym i do rozwijania argumentów w temacie politycznym. Informacja zwrotna do szkiców była chętnie przyjmowana, gdy stawka wydawała się wyższa — na przykład przy dyskusjach o zdrowiu czy polityce — i często prowadziła do wzmocnienia struktury i argumentacji. Startery rozmów obniżały barierę wejścia, ale równie często były ignorowane, gdy nie odpowiadały intencji użytkownika. Sugestie odpowiedzi były używane umiarkowanie, a w napiętych tematach ludzie wyraźnie woleli sugestie zgadzające się z nimi niż te przeciwne, co sugeruje, że SI może delikatnie prowadzić dyskusje w kierunku bezpieczniejszym, mniej konfrontacyjnym.

Wnioski projektowe na rzecz bardziej ludzkiej przyszłości online

Z tych eksperymentów autorzy wyciągają wniosek, że droga naprzód nie polega na odrzuceniu SI w mediach społecznościowych, lecz na bardziej przemyślanym projektowaniu. Ludzie chętnie korzystali z SI jako opcjonalnego pomocnika, zwłaszcza do burzy mózgów, weryfikacji informacji i przełamywania „blokady pisarskiej”, ale chcieli narzędzi, które będą bardziej osobiste i lepiej dopasowane do tematu oraz ich własnego głosu. Badacze zalecają wyraźne oznaczanie, gdy tekst jest skopiowany bezpośrednio z SI, inteligentniejszą personalizację dostosowującą się do każdego użytkownika, zachowanie uwzględniające kontekst, które zmienia ton między rozmową swobodną, naukową i polityczną, oraz proste, znajome interfejsy. Bez takich zabezpieczeń ostrzegają, platformy społecznościowe ryzykują wypełnienie publicznej przestrzeni gładkim, lecz płytkim gadaniem, które podważa zaufanie. Przy ich zastosowaniu SI mogłaby natomiast obniżyć bariery uczestnictwa i wspierać bardziej inkluzywne, przemyślane rozmowy, które nadal brzmią i sprawiają wrażenie wypowiedzi prawdziwych ludzi.

Cytowanie: Møller, A.G., Romero, D.M., Jurgens, D. et al. The impact of generative AI on social media: an experimental study. Sci Rep 16, 9376 (2026). https://doi.org/10.1038/s41598-026-40110-8

Słowa kluczowe: media społecznościowe, generatywna SI, dyskusja online, autentyczność, interakcja człowiek-komputer