Clear Sky Science · pl

Kalibracja głębokich klasyfikatorów przez dynamiczne propagowanie pewności i adaptacyjną normalizację

Dlaczego warto ufać ocenom pewności AI

Nowoczesne systemy sztucznej inteligencji nie tylko mówią, co ich zdaniem znajduje się na zdjęciu lub w odczycie czujnika — podają też, jak bardzo są tego pewne. Ta samoocena jest kluczowa w sytuacjach o krytycznym znaczeniu dla bezpieczeństwa, takich jak obrazowanie medyczne, autonomiczna jazda czy monitoring przemysłowy, gdzie mylne poczucie pewności może być niebezpieczne. Tymczasem współczesne sieci neuronowe są znane z nadmiernej pewności w swoich błędach, a istniejące poprawki często zawodzą, gdy dane są niezrównoważone lub pochodzą z zmieniających się środowisk. W artykule wprowadzono nową metodę, nazwaną Dynamic Confidence Propagation with Alternating Normalization (DCP‑AN), zaprojektowaną tak, by uczciwiej, stabilniej i wydajniej oceniać pewność modeli AI w realistycznych, zmiennych warunkach.

Gdy inteligentne maszyny są zbyt pewne siebie

Większość popularnych modeli głębokiego uczenia jest trenowana do przewidywania poprawnej etykiety, a nie do oceniania, na ile godne zaufania są poszczególne przewidywania. W efekcie sieć może być w 99% „pewna”, że na obrazie jest kot, gdy w rzeczywistości jest to pies. Standardowe techniki kalibracji, takie jak skalowanie temperatury czy dzielenie przewidywań na koszyki pewności, próbują naprawić to po treningu poprzez globalne dostosowania. Metody te jednak traktują wszystkie kategorie i wszystkie przykłady jednakowo. W rzeczywistości dane rzadko są zrównoważone: kilka „głównych” klas ma wiele przykładów, podczas gdy rzadkie „ogonowe” klasy mogą występować zaledwie kilka razy. Sieci mają tendencję do nadmiernej pewności w przypadku powszechnych klas i niedostatecznej w przypadku rzadkich, lukę, której statyczne, uniwersalne korekty nie potrafią zamknąć — szczególnie gdy rozkład danych zmienia się między domenami, na przykład od szkiców artystycznych do zdjęć rzeczywistych.

Nowy sposób wymiany informacji między danymi a etykietami

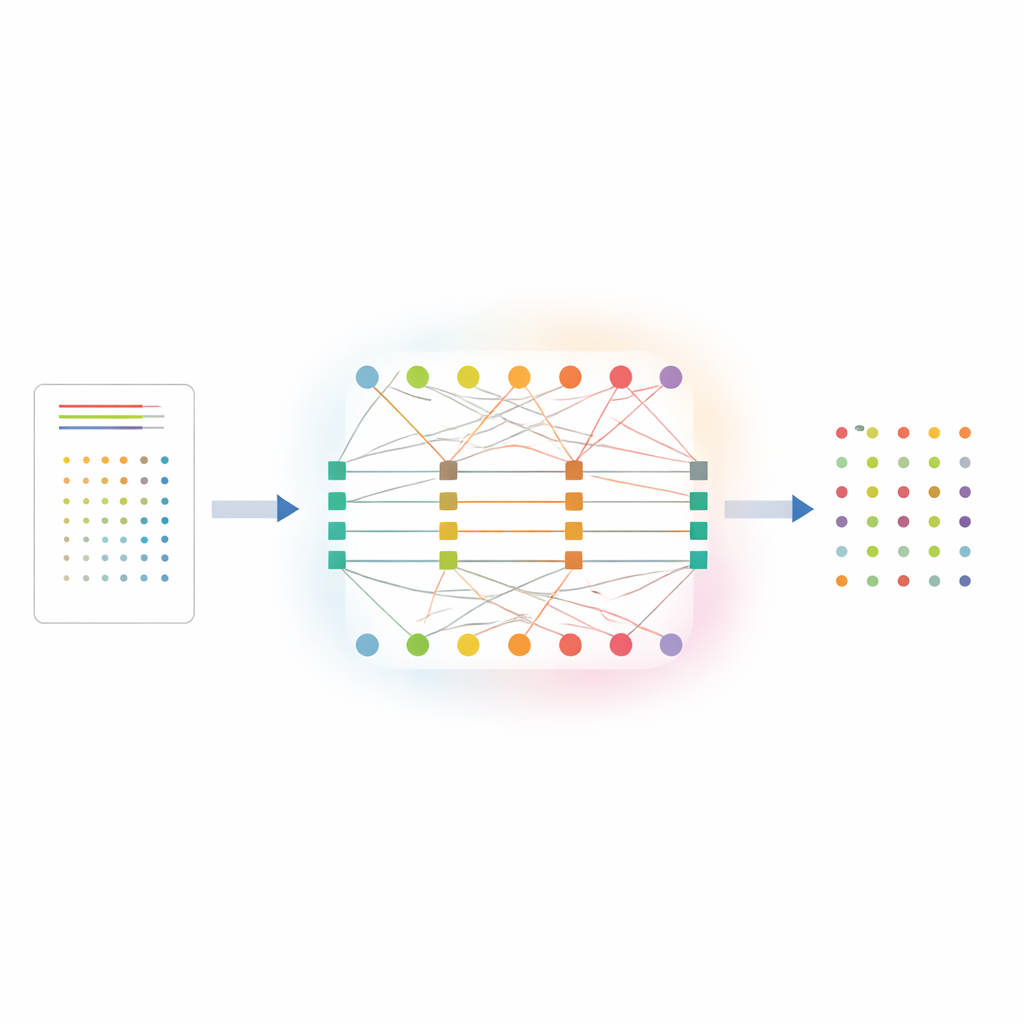

DCP‑AN rozwiązuje ten problem, jawnie modelując, jak pewność powinna przepływać między indywidualnymi próbkami a klasami, do których należą. Metoda przedstawia relację próbek i klas jako dwuwarstwową sieć: jedną warstwę węzłów dla próbek, drugą dla klas, połączonych wagowymi połączeniami kodującymi początkowe siły predykcji. Pewność jest następnie udoskonalana poprzez dwustopniowy proces. W pierwszym kroku informacja przepływa od próbek do klas, dostosowując, jak rozproszone są przewidywania dla każdej klasy, kierując się tym, jak niepewna dana klasa wydaje się w danym momencie. W drugim kroku informacja wraca od klas do próbek, korygując profil pewności każdej próbki w oparciu o zgodność z wcześniejszymi oszacowaniami. Powtarzając tę wymianę ograniczoną liczbę razy, system promuje lepszą „współpracę” między przykładami i etykietami, tak aby rzadkie klasy otrzymywały wyraźniejsze sygnały, zamiast być zagłuszanymi przez klasy częste.

Podkręcanie działania tam, gdzie jest potrzebne

Kluczową innowacją DCP‑AN jest adaptacyjne „pole temperatury”, które zmienia, jak mocno metoda przekształca pewność, w zależności od tego, jak niepewna sytuacja wygląda lokalnie i globalnie. Zamiast używać jednej wartości temperatury dla wszystkich przewidywań, metoda oblicza oddzielne siły korekty dla klas i dla próbek, bazując na miarach niepewności i rozbieżności w czasie. Dla klas głównych, które sieć już obsługuje pewnie, efektywna temperatura łagodnie się obniża, zapobiegając nadmiernemu wygładzaniu i zachowując ostre rozróżnienia. Dla klas ogonowych i niejednoznacznych próbek temperatura rośnie, co pozwala na silniejsze korekty, które podnoszą pewność, gdy jest to uzasadnione, i tłumią fałszywe skoki. To dynamiczne zachowanie wynika z zasadniczej reguły aktualizacji i reaguje szybko, gdy rośnie niepewność, pozostając stabilne, gdy model jest już dobrze dopasowany.

Rzetelna poprawa w różnych zadaniach i na różnych urządzeniach

Autorzy skrupulatnie oceniają DCP‑AN na kilku powszechnie używanych zbiorach obrazów. Na wersji ImageNet z długim ogonem, gdzie niektóre kategorie mają setki razy więcej obrazów niż inne, metoda zwiększa dokładność dla rzadkich klas ogonowych o około 10 punktów procentowych i zmniejsza standardowy miernik błędu kalibracji o ponad połowę w porównaniu z niekorygowaną bazą. W teście przekazywania między domenami, przenosząc model trenowany na dziełach sztuki do zdjęć rzeczywistych, DCP‑AN zarówno podnosi dokładność w nowej domenie, jak i zmniejsza statystyczną miarę luki między danymi źródłowymi a docelowymi. Co ważne, te zyski nie wiążą się z dużymi kosztami obliczeniowymi: uruchomienie na nowoczesnej karcie graficznej dodaje nieco ponad jedną milisekundę opóźnienia i mniej niż pół megabajta dodatkowej pamięci, co utrzymuje metodę praktyczną dla zastosowań w czasie rzeczywistym i na urządzeniach brzegowych.

Co to oznacza dla codziennej AI

Mówiąc prościej, praca ta pokazuje, że możemy uczynić systemy AI nie tylko mądrzejszymi, ale też bardziej samoświadomymi, kiedy mogą się mylić. Pozwalając, by informacje o pewności przepływały tam i z powrotem między przykładami a kategoriami, oraz dostosowując agresywność korekt w zależności od zmieniającej się niepewności, DCP‑AN dostarcza estymat prawdopodobieństwa lepiej odpowiadających rzeczywistości — nawet dla rzadkich zdarzeń i w zmieniających się środowiskach. Ponieważ metoda ma matematyczną gwarancję szybkiego zbiegania iteracyjnych aktualizacji i działa przy minimalnym narzucie, ten system można podłączyć do istniejących sieci neuronowych w dziedzinach takich jak opieka zdrowotna, robotyka czy monitoring bezpieczeństwa. Efekt to AI, która wciąż popełnia błędy, ale znacznie uczciwiej ocenia swoją pewność — kluczowy krok w stronę systemów, na których ludzie mogą bezpiecznie polegać.

Cytowanie: He, P., Fu, W., Wang, L. et al. Calibrating deep classifiers with dynamic confidence propagation and adaptive normalization. Sci Rep 16, 10959 (2026). https://doi.org/10.1038/s41598-026-39842-4

Słowa kluczowe: kalibracja pewności, głębokie sieci neuronowe, rozpoznawanie z rozkładem długiego ogona, estymacja niepewności, dopasowanie domen