Clear Sky Science · pl

ACFM: adaptacyjny algorytm ważonej fuzji kanałów poprawiający wykrywanie małych obiektów w ruchu dronów

Więcej widzieć z nieba

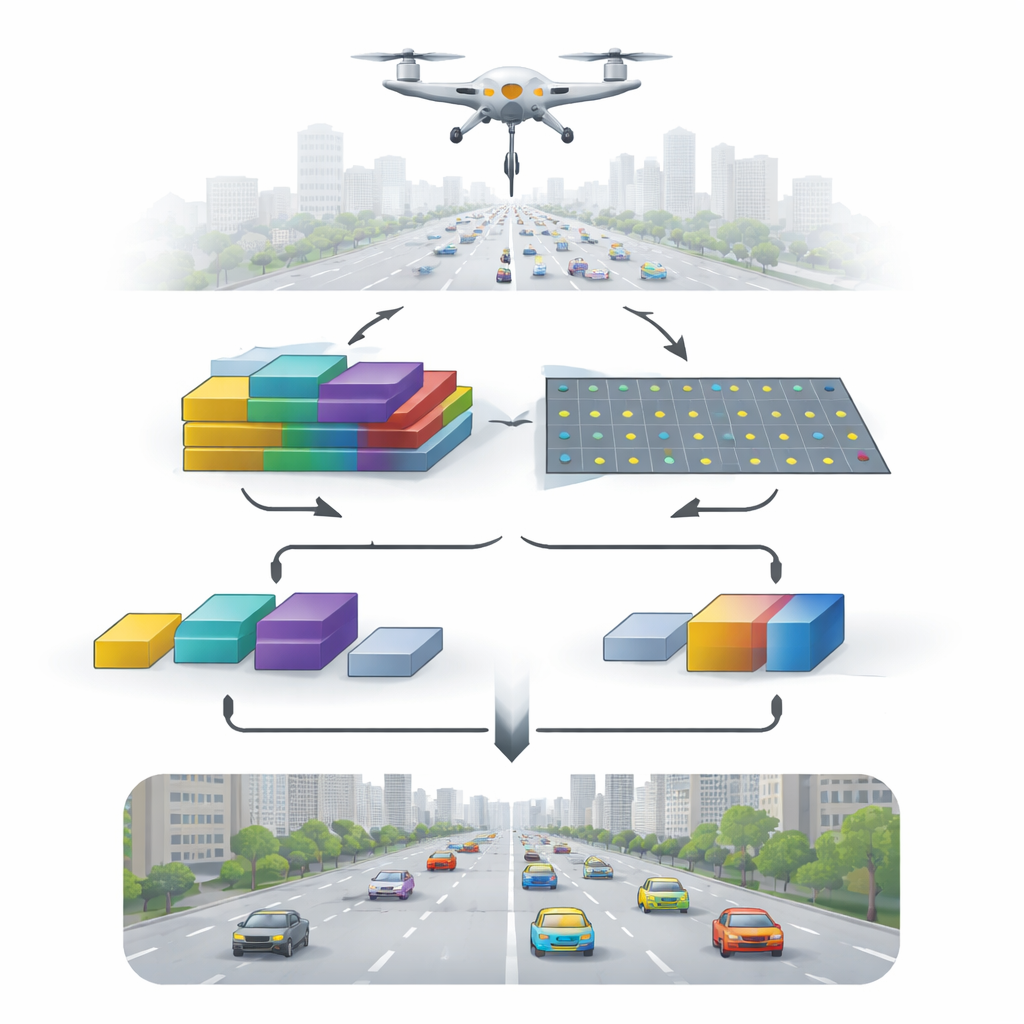

W miarę jak drony coraz częściej nadzorują ruch, bezpieczeństwo tłumów i strefy katastrof, napotykają prosty lecz uporczywy problem: z dużej wysokości obiekty, na których nam zależy — samochody, autobusy, a nawet ludzie — zajmują często tylko kilka pikseli. Takie maleńkie plamki łatwo umykają algorytmom, zwłaszcza na zatłoczonych ulicach pełnych cieni, znaków i rozmycia ruchu. W artykule przedstawiono nowy sposób, który pomaga komputerom „widzieć” te małe obiekty wyraźniej w nagraniach dronów, nie spowalniając znacząco detekcji.

Dlaczego maleńkie punkty mają znaczenie

Kamera drona rejestruje rozległe sceny z dużej wysokości, więc jedno ujęcie może zawierać autostrady, budynki, drzewa i dziesiątki pojazdów. Większość tych pojazdów jest bardzo mała i może się na siebie nakładać lub ukrywać. Tradycyjne detektory głębokiego uczenia świetnie radzą sobie z dużymi, wyraźnymi obiektami, ale mają tendencję do gubienia drobnych szczegółów w miarę przepływu informacji przez głębsze warstwy sieci. W efekcie małe pojazdy zlewają się z tłem, szczególnie w zatłoczonych skrzyżowaniach, przy słabym oświetleniu lub nieco rozmytym materiale. Istniejące metody wieloskalowe pomagają częściowo, łącząc informacje z różnych warstw sieci, ale zwykle opierają się na stałych, wstępnie ustalonych regułach i mają trudności z adaptacją, gdy scena staje się szczególnie złożona lub zagracona.

Inteligentniejsze łączenie wskazówek

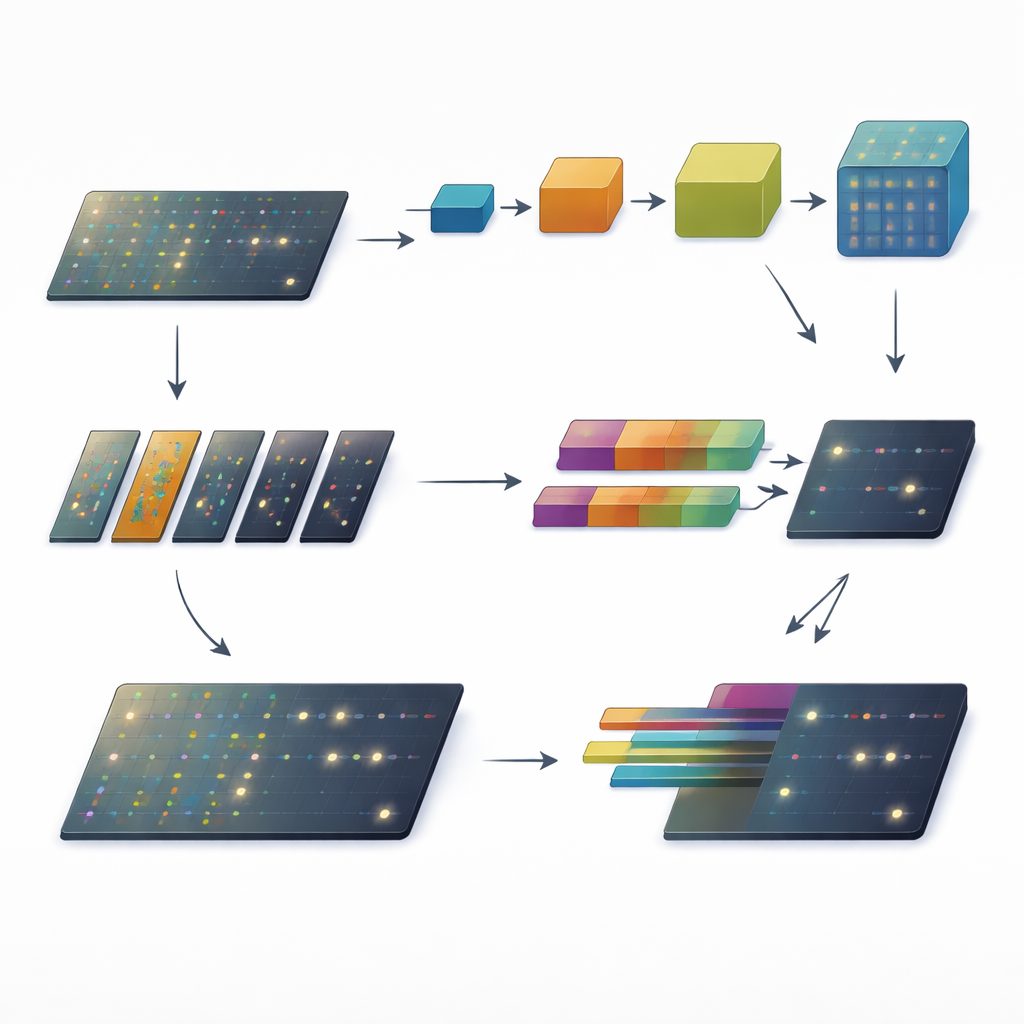

Autorzy proponują moduł adaptacyjnej ważonej fuzji kanałów, nazwany ACFM, zaprojektowany tak, by włączać się do istniejących detektorów obiektów i poprawiać wykrywanie małych celów w scenach ruchu dronów. Zamiast traktować wszystkie informacje wizualne jednakowo, ACFM uruchamia równolegle dwie wyspecjalizowane gałęzie, a następnie fuzjuje ich wyjścia w sposób zależny od sceny. Jedna gałąź dopracowuje sposób, w jaki cechy są przetwarzane między skalami, tak by drobne szczegóły przestrzenne nie zostały zatarte. Druga działa jak reflektor, wzmacniając naprawdę istotne sygnały małych obiektów i tłumiąc rozpraszające wzory tła. Kluczowe jest to, że fuzja między tymi gałęziami nie jest stała. ACFM dostosowuje, ile ufa każdej gałęzi w zależności od aktualnego obrazu, dzięki czemu system może reagować inaczej na pustą autostradę niż na gęste skrzyżowanie.

Zachowanie szczegółów między skalami

W pierwszej gałęzi, zwanej blokiem wieloskalowego dopracowania, sieć przesyła cechy przez parę ścieżek. Jedna ścieżka po prostu zachowuje oryginalne informacje, zapewniając, że drobne, wysokorozdzielcze szczegóły przetrwają. Druga ścieżka kompresuje, a następnie rozszerza reprezentację obrazu, zachęcając model do rozumienia szerszego kontekstu, w którym znajdują się małe pojazdy. Na końcu te ścieżki są scalane, tak by każdy wyjściowy piksel korzystał zarówno z ostrych lokalnych detali, jak i z wiedzy o otoczeniu. Ułatwia to detektorowi rysowanie dokładniejszych, bardziej spójnych ramek ograniczających wokół małych samochodów i autobusów różnych rozmiarów, nawet gdy tło jest złożone lub częściowo zasłonięte.

Ściszanie szumu tła

Druga gałąź koncentruje się na uwadze (attention). Dzieli kanały cech na grupy i dla każdej grupy uczy się rzadkiej „maski”, która wyróżnia tylko najbardziej obiecujące obszary. Regiony wyglądające jak tło — nawierzchnie dróg, dachy budynków, korony drzew — są przytłumione, podczas gdy drobne, lecz znaczące sygnały, takie jak odbicia i krawędzie pojazdów, są wzmacniane. Poprzez kontrolowane połączenie tych wyostrzeń z oryginalnymi cechami, ta grupowana, rzadka gałąź uwagi daje czystszy, bardziej dyskryminujący obraz sceny. Dzięki temu detektorowi trudniej pomylić wzory na asfalcie czy cienie budynków z rzeczywistymi pojazdami.

Pozwolić scenie wybrać proporcje

Ostatnim elementem ACFM jest mechanizm adaptacyjnego ważenia na poziomie kanałów, który decyduje, kanał po kanale, ile polegać na każdej z gałęzi. Najpierw podsumowuje, co dzieje się na całym obrazie, a następnie używa lekkiej operacji do wywnioskowania zestawu wag z zakresu od zera do jedynki. Jeśli scena jest prosta, a obiekty dobrze odsunięte od siebie, sieć może bardziej polegać na wieloskalowym dopracowaniu. Jeśli scena jest gęsta, zagracona lub zaszumiona, może przesunąć większy nacisk na gałąź uwagi, która tłumi rozproszenia tła. Ta dynamiczna równowaga zastępuje sztywne, ręcznie tworzone reguły fuzji automatyczną, opartą na danych strategią, pozwalając detektorowi elastycznie reagować na zmiany między kolejnymi klatkami.

Bardziej bystre oczy dla ruchu dronów

Po wpięciu do popularnego detektora nazwanego GFL i przetestowaniu na trzech publicznych zestawach danych ruchu dronów, ACFM konsekwentnie poprawił wyniki detekcji, szczególnie na wymagających zbiorach z wieloma małymi, nachodzącymi na siebie pojazdami. Zyski w dokładności przyszły przy niewielkim dodatkowym koszcie obliczeniowym, co oznacza, że ulepszony system nadal może działać blisko czasu rzeczywistego — krytyczne wymaganie dla praktycznego nadzoru ruchu. Dla osób niebędących specjalistami wniosek jest prosty: zachowując szczegóły, tłumiąc szum i adaptując sposób łączenia cech w zależności od sceny, ACFM pomaga dronom zachowywać się bardziej jak uważni obserwatorzy niż sztywne dopasowywacze wzorców, oferując bardziej niezawodną podstawę dla przyszłych zastosowań w inteligentnych miastach i monitoringu z powietrza.

Cytowanie: Liu, S., Zhu, H., Yuan, Z. et al. ACFM: adaptive channel weighted fusion algorithm for improving small object detection performance in UAV traffic. Sci Rep 16, 8366 (2026). https://doi.org/10.1038/s41598-026-39789-6

Słowa kluczowe: monitoring ruchu dronami, wykrywanie małych obiektów, wizja komputerowa, mechanizmy uwagi, fuzja cech wieloskalowych