Clear Sky Science · pl

Elastyczne ramy optymalizacji hiperparametrów z użyciem homotopii i modeli zastępczych

Dlaczego strojenie ustawień AI ma znaczenie

Współczesne systemy sztucznej inteligencji opierają się nie tylko na sprytnych algorytmach i ogromie danych, lecz także na zaskakująco wybrednej warstwie ustawień zwanych „hiperparametrami”. To one decydują, jak duży ma być model, jak szybko się uczy i jak radzi sobie z zaszumionymi danymi. Złe ustawienia mogą zamienić obiecujący system w niewypał. W artykule przedstawiono HomOpt — nową metodę strojenia tych pokręteł w sposób bardziej wydajny i niezawodny, szczególnie gdy przestrzeń poszukiwań jest ogromna i chaotyczna, co czyni ją atrakcyjną dla każdego, kto chce uzyskać lepsze wyniki AI przy mniejszej liczbie prób i błędów.

Nowy sposób kierowania poszukiwaniem

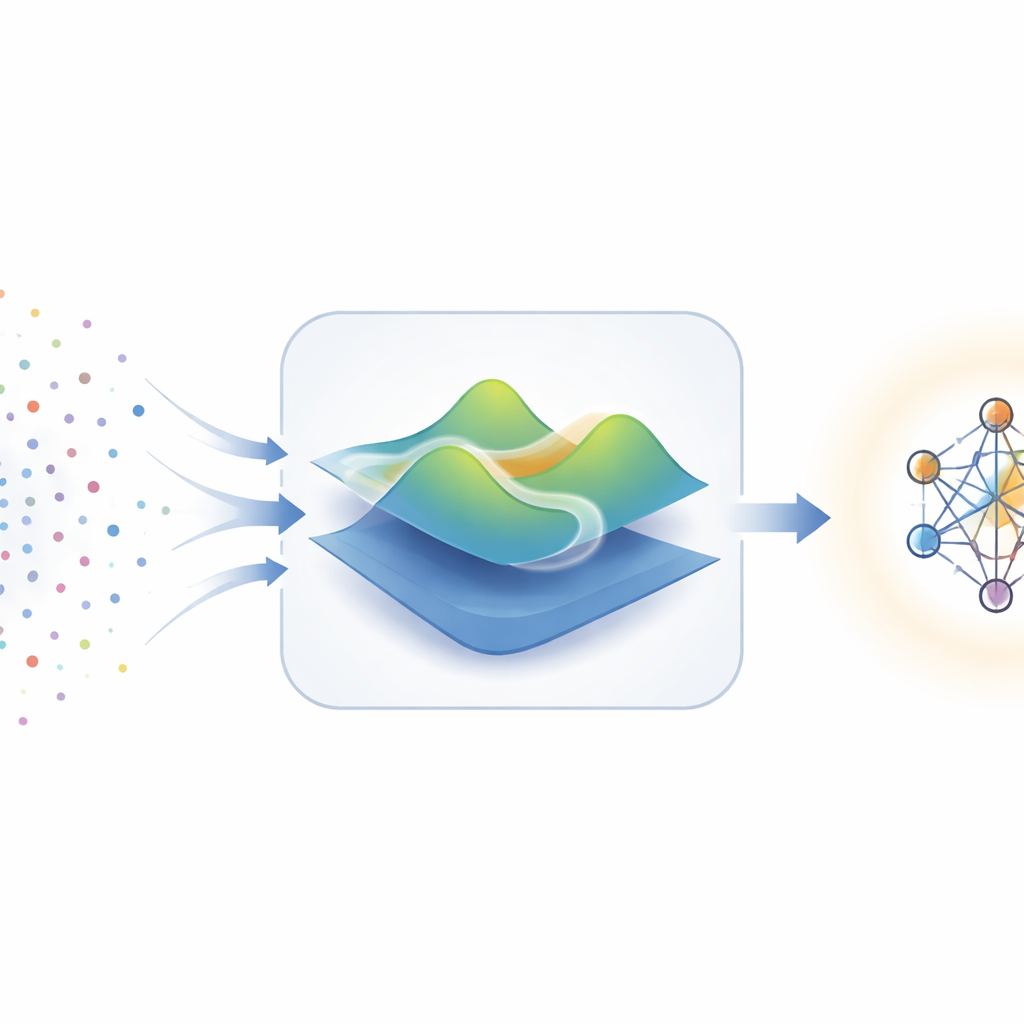

Tradycyjne podejścia do strojenia hiperparametrów, takie jak przeszukiwanie siatkowe czy losowe, przypominają eksperymentowanie z przepisami przez wrzucanie składników i liczenie na szczęście. Bardziej wyrafinowane metody, jak optymalizacja Bayesowska, próbują być mądrzejsze, budując przybliżony model wpływu ustawień na wydajność i wykorzystując go do wyboru kolejnej kombinacji do sprawdzenia. Jednak metody te zakładają, że „krajobraz” wydajności jest gładki i dobrze ustrukturyzowany, co w praktyce często nie występuje — realne problemy bywają pełne osobliwości, szumu i nagłych skoków. HomOpt stawia czoła temu wyzwaniu, wielokrotnie budując przybliżone zamienniki prawdziwego krajobrazu — zwane modelami zastępczymi — a następnie płynnie przekształcając jeden model w drugi w miarę napływu nowych danych, śledząc jednocześnie, jak najlepsze rozwiązanie przesuwa się podczas tej transformacji.

Płynne przekształcanie modeli zamiast zaczynania od nowa

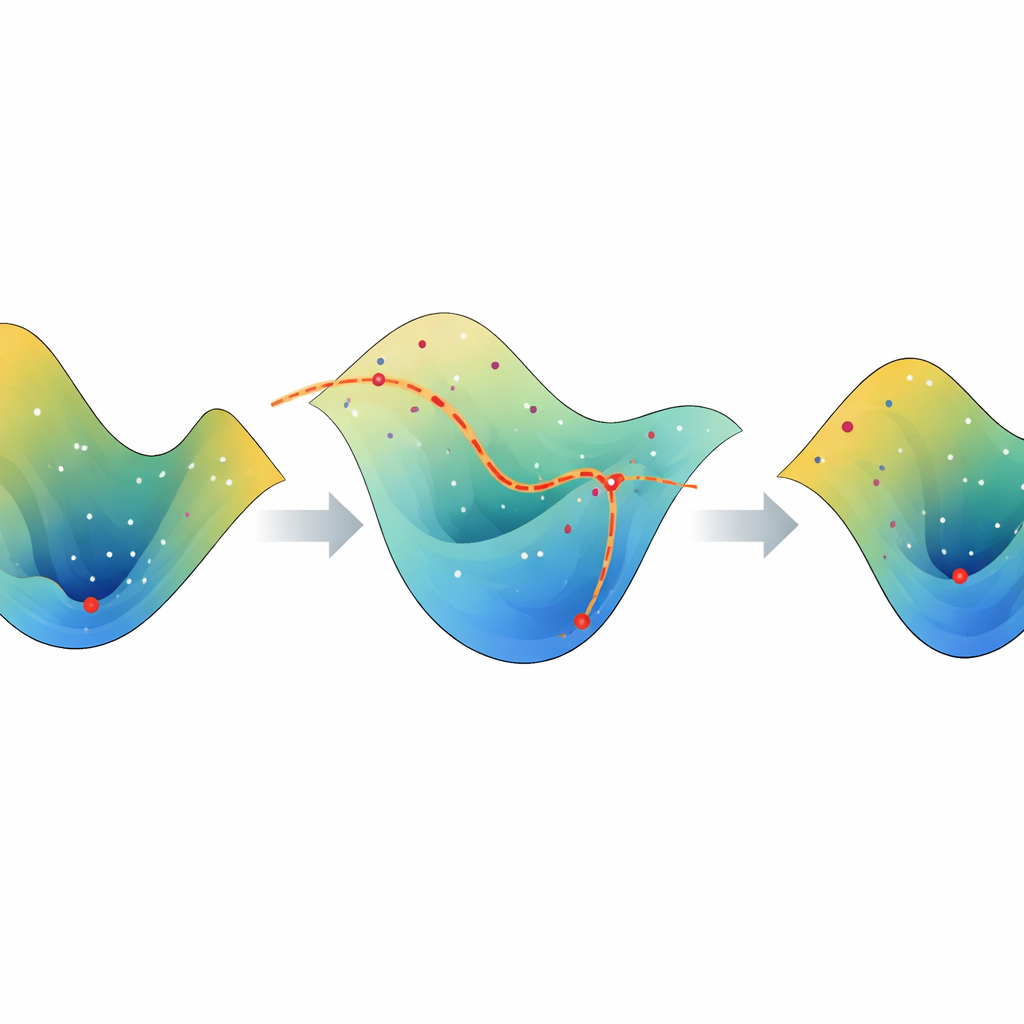

Kluczowa idea HomOpt wywodzi się z pojęcia matematycznego zwanego homotopią, które w prostych słowach oznacza stopniowe przemienianie jednego kształtu w inny bez rozrywania czy skoków. W tym podejściu każdy model zastępczy jest wygładzonym obrazem tego, jak różne ustawienia hiperparametrów wpływają na wydajność. W miarę gromadzenia nowych wyników eksperymentalnych HomOpt konstruuje zaktualizowany model zastępczy, a następnie definiuje ciągłą transformację między starą a nową wersją. Zamiast porzucać wcześniejsze prace i zaczynać poszukiwanie od początku, śledzi, jak najlepszy punkt na starej powierzchni przesuwa się po tej morfującej przestrzeni, aby osiąść w dobrym punkcie na nowej. Ta ukierunkowana zmiana sprawia, że poszukiwanie jest mniej losowe i bardziej celowe, zwiększając szanse znalezienia lepszych ustawień przy mniejszej liczbie kroków.

Elastyczne narzędzia dla różnych typów danych

Aby pokazać praktyczną użyteczność koncepcji, autorzy wpięli do HomOpt dwa różne rodzaje modeli zastępczych. Po pierwsze wykorzystali uogólnione modele addytywne (Generalized Additive Models), które są gładkie i stosunkowo łatwe do interpretacji, co jest przydatne, gdy zależności między ustawieniami a wydajnością zmieniają się łagodnie. Po drugie użyli CatBoost, potężnej metody zespołowej dobrze nadającej się do skomplikowanych, wysokowymiarowych problemów, jak rozpoznawanie obrazów. HomOpt nie więzi się do jednego modelu zastępczego; traktuje wybór modelu jako komponent typu plug-in, który można dopasować do trudności i struktury zadania. Ramy obsługują ustawienia ciągłe, dyskretne i kategoryczne oraz mogą działać w połączeniu z powszechnymi strategiami poszukiwania, takimi jak losowe przeszukiwanie, optymalizacja Bayesowska czy metody drzewiaste, pełniąc rolę warstwy udoskonalającej, a nie zastępującej je.

Weryfikacja metody

Badacze ocenili HomOpt na różnorodnym zestawie benchmarków. W klasycznych zadaniach uczenia maszynowego opartych na publicznych zbiorach tabelarycznych dostrajali modele takie jak maszyny wektorów nośnych, lasy losowe, regresję logistyczną, wielowarstwowe perceptrony i modele z gradientowym boostowaniem. Sprawdzili też wymagające zadania rozpoznawania otwartych zbiorów, gdzie system musi radzić sobie z wcześniej niewidzianymi kategoriami, używając wyspecjalizowanego klasyfikatora zwanego Extreme Value Machine. Wreszcie testowali HomOpt na tabelach do wyszukiwania architektur neuronowych dla znanych zbiorów obrazów, takich jak CIFAR-10 i kolekcje w stylu ImageNet, gdzie przestrzeń możliwych projektów jest szczególnie duża i wyboista. W wielu tych zastosowaniach HomOpt przyspieszał zbliżanie się do dobrych rozwiązań lub poprawiał końcową wydajność w porównaniu z samymi metodami bazowymi, często przy użyciu mniejszej liczby kosztownych ocen modeli.

Co to oznacza dla codziennej praktyki AI

Dla praktyków głównym przesłaniem jest to, że HomOpt oferuje uporządkowany sposób uczynienia strojenia hiperparametrów bardziej inteligentnym zamiast jedynie bardziej wyczerpującym. Poprzez ciągłe udoskonalanie przybliżonego obrazu krajobrazu wydajności i płynne podążanie za tym, jak jego najlepszy punkt przesuwa się w miarę poprawy obrazu, metoda zmniejsza marnotrawstwo w poszukiwaniach i lepiej wykorzystuje każdy przebieg modelu. Ponieważ współpracuje z szerokim zakresem miar strat, typów modeli i strategii poszukiwania, HomOpt może być traktowany jako uniwersalne rozszerzenie istniejących narzędzi optymalizacyjnych. Mówiąc prosto, obiecuje uzyskanie dokładniejszych i bardziej odpornych systemów AI przy tym samym budżecie obliczeniowym — i to w sposób skalowalny od małych problemów tabelarycznych po duże, złożone zadania wizji.

Cytowanie: Abraham, S.J., Maduranga, K.D.G., Kinnison, J. et al. A flexible framework for hyperparameter optimization using homotopy and surrogate models. Sci Rep 16, 9412 (2026). https://doi.org/10.1038/s41598-026-39713-y

Słowa kluczowe: optymalizacja hiperparametrów, modele zastępcze, metody homotopii, zautomatyzowane uczenie maszynowe, wyszukiwanie architektury sieci neuronowej