Clear Sky Science · pl

Zautomatyzowane wykrywanie fotoreceptorów typu czopka przy użyciu danych syntetycznych i głębokiego uczenia w obrazach z konfokalnego skaningowego oftalmoskopu z adaptacyjną optyką

Bardziej wyraźne spojrzenia na żywe oko

Możliwość zobaczenia komórek światłoczułych oka pojedynczo może całkowicie odmienić sposób, w jaki lekarze wykrywają i monitorują choroby prowadzące do utraty wzroku. Obecnie eksperci muszą jednak mozolnie oznaczać te komórki ręcznie na silnie powiększonych obrazach siatkówki — proces powolny, subiektywny i trudny do rozszerzenia na tysiące pacjentów. W tym badaniu pokazano, jak modele komputerowe trenowane na realistycznych „sztucznych” obrazach oka potrafią automatycznie odnajdywać te komórki, otwierając drogę do szybszych, bardziej niezawodnych badań okulistycznych i lepszej oceny nowych terapii.

Dlaczego drobne komórki mają znaczenie

Tylna część oka pokryta jest fotoreceptorami — wyspecjalizowanymi komórkami, które przekształcają światło w sygnały interpretowane przez mózg jako widzenie. Fotoreceptory typu czopka są szczególnie ważne dla ostrego widzenia centralnego i postrzegania barw, a ich utrata jest charakterystyczna dla wielu chorób siatkówki. Potężna technika obrazowania, zwana skaningowym oftalmoskopem z optyką adaptacyjną (AOSLO), potrafi uchwycić szczegółowe obrazy tych komórek u żywych osób. Zanim jednak lekarze i badacze będą mogli zmierzyć gęstość czopków lub śledzić zmiany w czasie, muszą najpierw zlokalizować każdy pojedynczy czopkek na obrazie. Ręczne oznaczanie wymaga wiele czasu i może różnić się między osobami, co ogranicza jego użyteczność w rutynowych klinikach i dużych badaniach klinicznych.

Od reguł ręcznie zaprojektowanych do uczenia się z danych

Wcześniejsze programy komputerowe próbowały zautomatyzować wykrywanie czopków, stosując stałe reguły: na przykład szukając jasnych punktów o określonym rozmiarze lub rozstawie. Metody oparte na regułach mogły działać dobrze na czystych obrazach zdrowych oczu, ale często miały trudności, gdy obrazy były zaszumione, nieco rozmyte lub pochodziły od pacjentów z chorobą. Głębokie uczenie oferuje inną strategię. Zamiast ręcznie projektować reguły, sieć neuronowa uczy się wzorców bezpośrednio z przykładów. Problem w tym, że modele te zwykle potrzebują ogromnych zbiorów obrazów starannie oznaczonych przez ekspertów — dokładnie takich danych, które w obrazowaniu AOSLO są rzadkie i kosztowne.

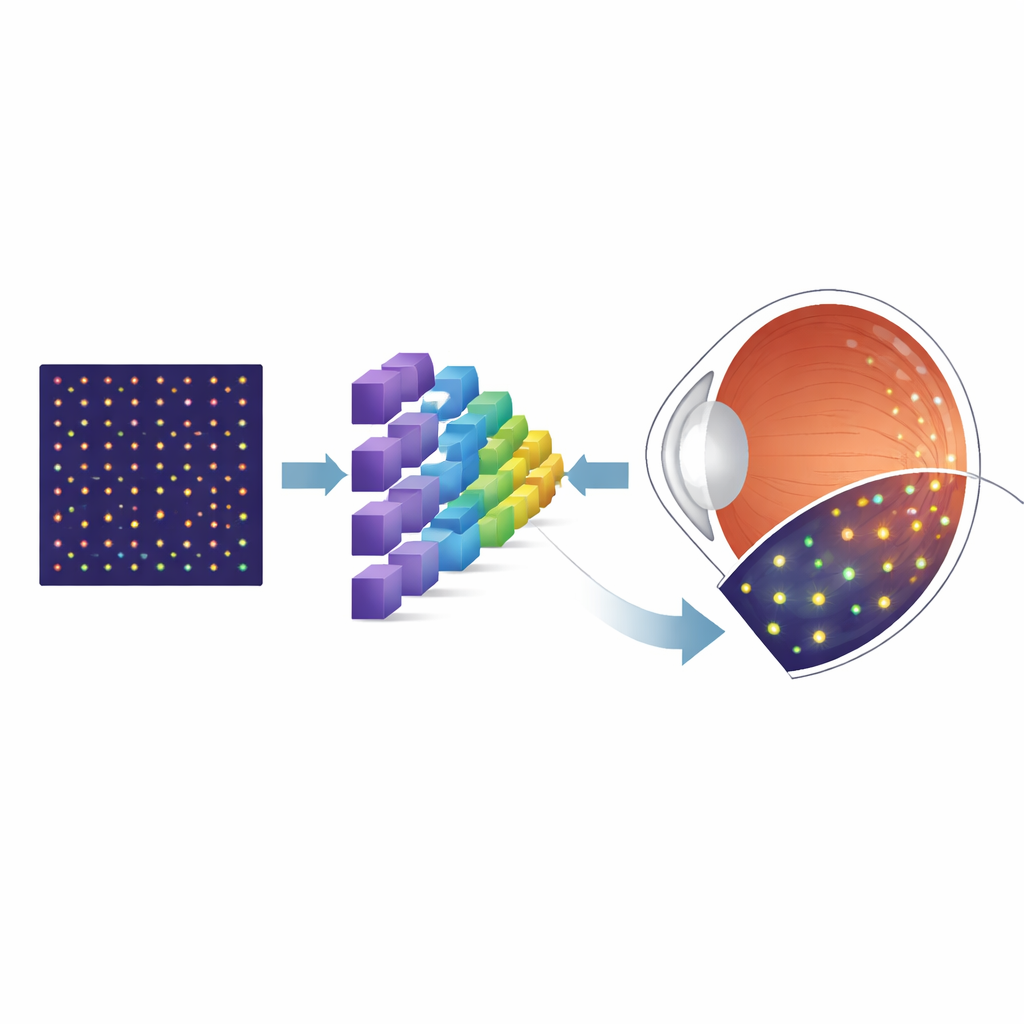

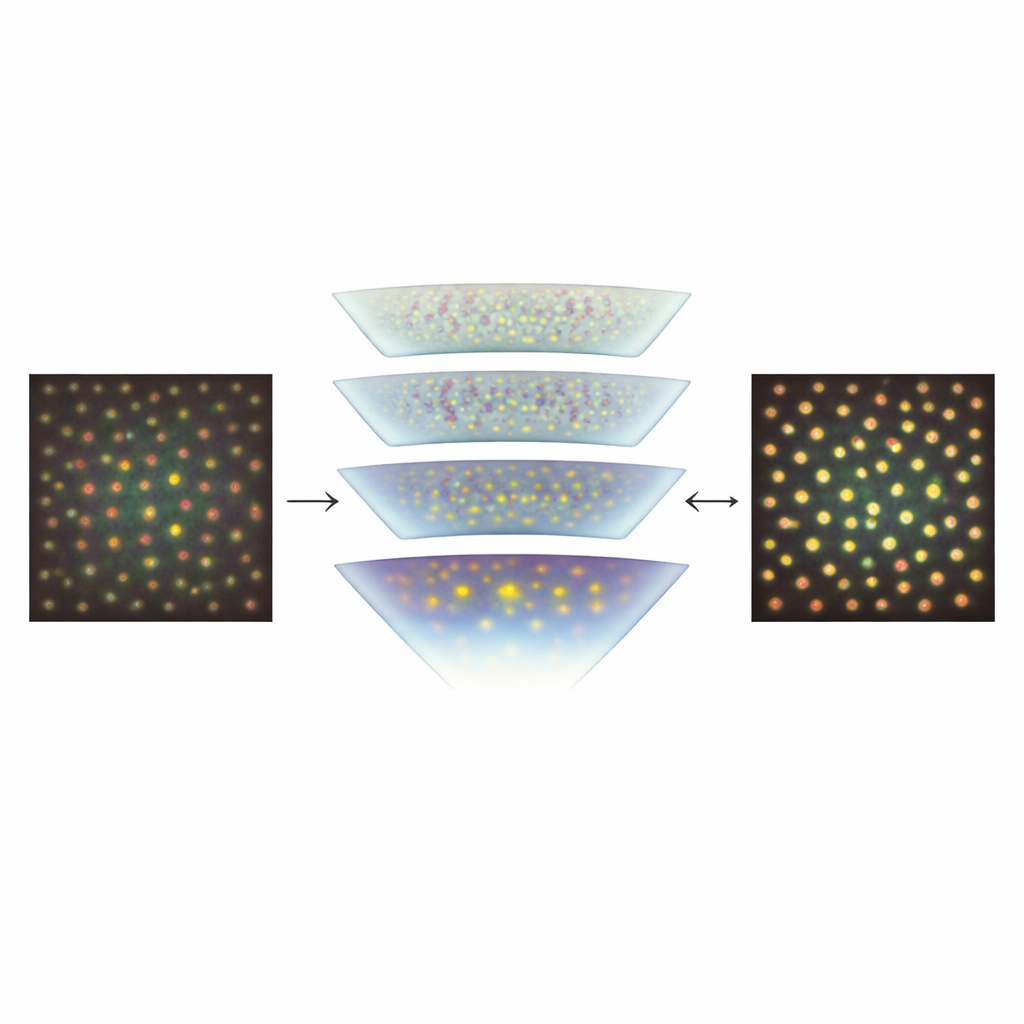

Budowanie wirtualnego pola treningowego

Aby obejść brak oznaczonych prawdziwych obrazów, badacze sięgnęli po narzędzie symulacyjne o nazwie ERICA, które może generować realistycznie wyglądające obrazy podobne do AOSLO przedstawiające mozaiki czopków wraz z doskonałą „prawdziwą” wiedzą o położeniu każdego czopka. Stworzyli duże zbiory tych syntetycznych obrazów obejmujące wiele pozycji w siatkówce, systematycznie zmieniając kluczowe niedoskonałości spotykane w prawdziwych zdjęciach, takie jak losowy szum i subtelne optyczne rozmycie. Następnie trenowali wyspecjalizowaną architekturę sieci neuronowej, znaną jako U-Net, aby przekształcała każdy obraz wejściowy w mapę prawdopodobieństwa pokazującą miejsca, gdzie czopki najprawdopodobniej się znajdują. Po początkowym treningu na danych syntetycznych zespół dopracował model przy użyciu znacznie mniejszej kolekcji rzeczywistych obrazów AOSLO z ogólnie dostępnego zbioru, a na końcu przetestował go na niezależnych obrazach z innego laboratorium, aby ocenić, jak dobrze uogólnia.

Jak komputer wypada w porównaniu z ekspertami

Zespół porównał swoją zautomatyzowaną metodę z mozolnym, ręcznym oznaczaniem oraz z dwoma wiodącymi algorytmami wykrywania czopków. Korzystając ze standardowej miary nakładania się przewidywanych i ręcznie oznaczonych pozycji czopków, nowy U-Net dorównywał lub niemal dorównywał wynikowi ekspertów oraz konkurencyjnych metod automatycznych na publicznym zbiorze danych. Co kluczowe, testowany na oddzielnym zestawie obrazów wykonanych w różnych odległościach od centrum widzenia i zarejestrowanych innym urządzeniem, model nadal osiągał bardzo dobre wyniki. Sugeruje to, że intensywne treningi na danych syntetycznych obejmujących szeroki zakres warunków wizualnych pomogły sieci nauczyć się cech przenoszących się na obrazy rzeczywiste, zamiast dopasowywać się nadmiernie do jednego konkretnego aparatu czy grupy pacjentów.

Co to może znaczyć dla przyszłej opieki okulistycznej

Dla niespecjalistów istotny przekaz jest taki, że program komputerowy trenowany w dużej mierze na „wirtualnych” obrazach oka potrafi dziś znaleźć prawdziwe komórki typu czopka w skanach siatkówki o wysokiej rozdzielczości z wiarygodnością zbliżoną do ekspertów. Przyspieszając wykrywanie czopków, czyniąc je bardziej obiektywnym i łatwiejszym do zastosowania na różnych skanerach i w różnych klinikach, podejście to może pomóc przekształcić szczegółowe obrazowanie siatkówki w rutynowe narzędzie do śledzenia chorób na poziomie pojedynczych komórek. W dłuższej perspektywie podobne metody oparte na danych syntetycznych można rozszerzyć na wykrywanie innych typów komórek i modelowanie utraty komórek związanej z chorobą, wspierając wcześniejsze rozpoznawanie, lepsze monitorowanie postępu i precyzyjniejszą ocenę nowych terapii mających na celu zachowanie wzroku.

Cytowanie: Shah, M., Young, L.K., Downes, S.M. et al. Automated cone photoreceptor detection using synthetic data and deep learning in confocal adaptive optics scanning laser ophthalmoscope images. Sci Rep 16, 8313 (2026). https://doi.org/10.1038/s41598-026-39570-9

Słowa kluczowe: obrazowanie siatkówki, fotoreceptory typu czopka, głębokie uczenie, dane syntetyczne, optyka adaptacyjna