Clear Sky Science · pl

Adaptatywne ramy do ponownego zrównoważenia danych dla predykcji ryzyka ruchu w czasie rzeczywistym

Dlaczego równoważenie danych o ruchu ma znaczenie dla bezpieczeństwa

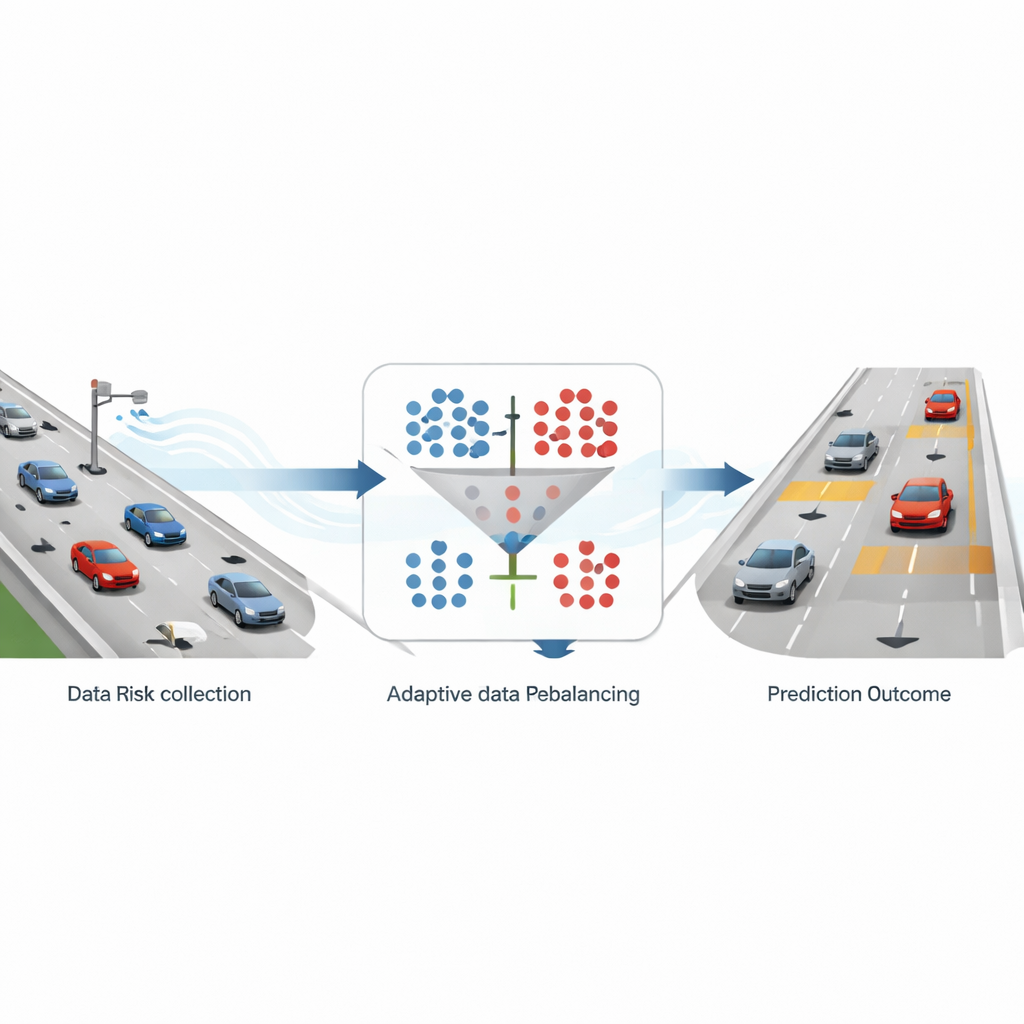

Wypadki na autostradzie są wydarzeniami rzadkimi w porównaniu z ogromną ilością zwykłej, bezproblemowej jazdy. To dobra wiadomość dla bezpieczeństwa, ale tworzy ukryty problem dla systemów komputerowych próbujących przewidzieć, kiedy i gdzie może dojść do wypadku w czasie rzeczywistym. Gdy dane są zdominowane przez sytuacje bezpieczne, algorytmy mogą stać się bardzo dobre w prognozowaniu „nie wydarzy się nic” i nadal wyglądać na dokładne na papierze — jednocześnie przegapiając rzeczywiście niebezpieczne momenty. Badanie to zajmuje się tym nierównym rozkładem bezpośrednio, proponując adaptacyjny sposób „zrównoważenia” danych o ruchu, aby systemy ostrzegawcze mogły lepiej rozpoznawać rzadkie, lecz istotne sytuacje ryzyka, nie stając się przy tym zbyt wolne do użycia w praktyce.

Jak rzeczywisty ruch zamienia się w sygnały ostrzegawcze

Naukowcy budują swoje ramy na szczegółowych danych trajektorii z autostrad pochodzących z dużego zestawu danych rejestrowanego za pomocą dronów nad niemieckimi autostradami. Pozycja i prędkość każdego pojazdu są śledzone wiele razy na sekundę na odcinkach sześciopasmowych. Z tego bogatego zapisu ruchu zespół oblicza szeroko stosowany wskaźnik bezpieczeństwa zwany czasem do kolizji (time-to-collision), który szacuje, ile czasu zajęłoby samochodowi tylnej jazdy zderzenie z przednim, gdyby oba kontynuowały ruch bez zmian. Gdy ten czas spada poniżej trzech sekund, sytuacja jest oznaczana jako „wysokie ryzyko”; w przeciwnym razie traktowana jest jako „brak ryzyka”. Po agregacji tych miar w 10-sekundowych przedziałach i skupieniu się na drogach sześciopasmowych otrzymują około dziewięciu próbek bezpiecznych na każdą ryzykowną, silnie skośny zbiór danych odzwierciedlający rzeczywiste warunki na autostradach.

Naprawianie nierównowagi bez utraty istotnych informacji

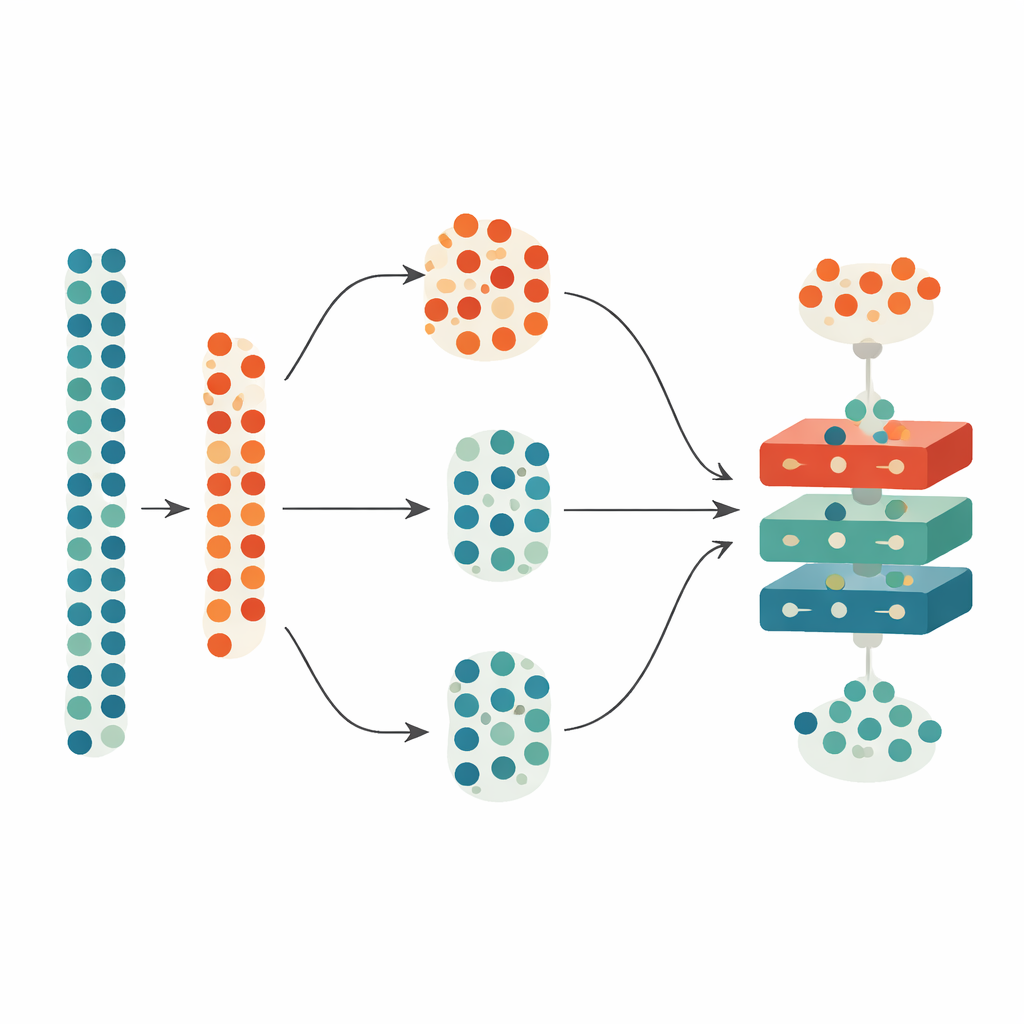

Aby poradzić sobie z tą nierównowagą, badanie porównuje dwie powszechne strategie. Pierwsza, zwana oversamplingiem, dodaje więcej przykładów rzadkich, ryzykownych sytuacji poprzez tworzenie syntetycznych próbek podobnych do prawdziwych przypadków wysokiego ryzyka. Druga, undersampling, zmniejsza liczbę wielu przypadków bezpiecznych przez losowe odrzucenie części z nich. Autorzy używają popularnej metody oversamplingu (SMOTE) oraz prostego losowego undersamplingu, stosując je przy kilku stałych proporcjach próbek bezpiecznych do ryzykownych — 1:1, 2:1, 3:1 i 4:1. Następnie zarówno oryginalne, jak i zmodyfikowane zbiory danych są podawane do czterech modeli predykcyjnych: dwóch tradycyjnych podejść uczenia maszynowego i dwóch modeli głębokiego uczenia specjalizujących się w przetwarzaniu szeregów czasowych. Testując wszystkie te kombinacje, badacze mogą zobaczyć, jak różne sposoby równoważenia danych zmieniają zdolność systemu do wykrywania ryzyka przy jednoczesnym rozpoznawaniu sytuacji bezpiecznych.

Puszczenie algorytmu, by znalazł optymalny punkt

Zamiast zakładać, że idealnie równa liczba próbek bezpiecznych i ryzykownych jest najlepsza, naukowcy pozwalają algorytmowi genetycznemu — metodzie poszukiwawczej inspirowanej ewolucją — wyszukać najskuteczniejsze proporcje. Ten optymalizator dostosowuje stosunek bezpiecznych do ryzykownych w realistycznym zakresie od 1:1 do 4:1, wielokrotnie generując kandydackie proporcje, oceniając je i udoskonalając przez setki iteracji. Kluczowe jest to, że nie bierze on pod uwagę tylko dokładności predykcji: uwzględnia także czas potrzebny na trenowanie modelu i dokonywanie predykcji, odzwierciedlając wymagania czasu rzeczywistego w centrach kontroli ruchu. Aby zapewnić uczciwe łączenie dokładności i czasu obliczeń, wszystkie miary są normalizowane przed połączeniem w jedną ocenę „fitness”, którą algorytm stara się zminimalizować.

Czego modele uczą się o ryzyku na drodze

Wśród licznych eksperymentów wyróżnia się jeden wzorzec. Równoważenie danych poprawia predykcję ryzyka w porównaniu z pozostawieniem pierwotnego niebalansu, a oversampling z syntetycznymi przykładami ryzyka zwykle sprawdza się lepiej niż usuwanie przykładów bezpiecznych. Proporcja 2:1 bezpiecznych do ryzykownych próbek daje najlepsze wyniki wśród ustalonych ustawień, przewyższając powszechnie stosowany wybór 1:1. Gdy algorytm genetyczny ma możliwość dopracowania tej proporcji, ustala nieco nierówne, ale optymalne wartości — około 2,3:1 dla oversamplingu i 2,7:1 dla undersamplingu. Wśród modeli predykcyjnych szczególny typ rekurencyjnej sieci neuronowej znany jako gated recurrent unit konsekwentnie dostarcza najsilniejszych rezultatów, zwłaszcza w połączeniu z oversamplingiem i optymalizacją. Modele ujawniają również, że średnie prędkości pojazdów upstream i downstream od punktu na autostradzie są bardziej informatywne dla ryzyka niż proste zliczenia pojazdów.

Sprawdzanie stabilności i przygotowanie do świata rzeczywistego

Ponieważ metody optymalizacji czasem mogą utknąć na mylących rozwiązaniach, autorzy analizują zachowanie swojego poszukiwania w czasie. Pokazują, że wartości fitness systematycznie maleją i ostatecznie się wypłaszczają, co sugeruje, że algorytm zbiega do stabilnych, wysokiej jakości proporcji, zamiast skakać bez celu. Następnie delikatnie podnoszą i obniżają wybrane proporcje o kilka procent, aby sprawdzić, czy wydajność się załamuje. W praktyce dokładność spada tylko nieznacznie przy małych zmianach, co wskazuje, że system jest odporny i nie jest nadmiernie dostrojony do jednej, kruchej konfiguracji. Jednak gdy część danych zarezerwowana do testowania staje się bardzo duża, modele stają się bardziej wrażliwe, podkreślając potrzebę wystarczająco bogatych danych treningowych.

Co to oznacza dla bezpieczniejszych, mądrzejszych autostrad

Mówiąc prościej, badanie pokazuje, że nauczanie komputerów rozpoznawania zagrożeń na drodze to nie tylko kwestia sprytnych modeli; chodzi też o dostarczanie tym modelom uczciwego obrazu rzadkich, lecz krytycznych zdarzeń. Poprzez staranne dostosowanie, ile przykładów bezpiecznych i ryzykownych jest używanych do treningu — oraz pozwalając adaptacyjnemu algorytmowi znaleźć najlepszy kompromis między dokładnością a szybkością — proponowane ramy czynią predykcję ryzyka na autostradach w czasie rzeczywistym bardziej niezawodną i praktyczną. Agencje drogowe mogłyby zaimplementować to podejście w systemach monitorujących dane z czujników ruchu i wydających wczesne ostrzeżenia o prawdopodobnych kolizjach tylnej części, pomagając w kierowaniu alertów dla kierowców, rozmieszczeniu patroli czy strategiach automatycznego hamowania. Choć praca została pokazana na niemieckich autostradach w dobrych warunkach pogodowych, podstawowa idea adaptacyjnego równoważenia danych oferuje uniwersalną receptę na poprawę predykcji bezpieczeństwa tam, gdzie zdarzenia niebezpieczne są rzadkie, ale zbyt ważne, by je przegapić.

Cytowanie: Chen, S., Cui, B. & Chang, A. An adaptive data rebalancing framework for real-time traffic risk prediction. Sci Rep 16, 8882 (2026). https://doi.org/10.1038/s41598-026-39539-8

Słowa kluczowe: bezpieczeństwo ruchu, predykcja ryzyka wypadków, nierównomierne dane, uczenie maszynowe, trajektorie autostrad