Clear Sky Science · pl

Ocena porównawcza modeli wideo opartych na dużych modelach językowych w jakości oceny filmów popularyzujących naukę o suchej oku

Dlaczego to ma znaczenie dla zwykłych widzów

Aplikacje z krótkimi filmami szybko stają się pierwszym źródłem porad zdrowotnych dla wielu osób, także w kwestii problemów oczu, takich jak zespół suchego oka, który dotyka setek milionów ludzi na świecie. Obok pomocnych materiałów łatwo jednak natrafić na treści niskiej jakości lub wprowadzające w błąd, które trudno kontrolować medycznie. Badanie sprawdza, czy nowe systemy sztucznej inteligencji potrafią „oglądać” filmy i automatycznie oceniać ich jakość, i pokazuje, dlaczego na razie takie narzędzia nie są gotowe zastąpić oceny ekspertów.

Suche oczy i rosnąca popularność filmów zdrowotnych

Suche oko to więcej niż drobna niedogodność; może powodować zamglenie widzenia, ból i zakłócać pracę oraz codzienne życie. W miarę jak schorzenie staje się częstsze, zwłaszcza wśród osób starszych i intensywnie korzystających z ekranów, wiele osób szuka w sieci wyjaśnień i porad samopomocy. Platformy takie jak TikTok zawierają niezliczone krótkie filmy o suchości oka, a ich otwarty charakter sprawia, że każdy może publikować treści bez względu na wykształcenie medyczne. Słabe lub przesadzone porady mogą opóźnić właściwe leczenie lub zachęcić do niebezpiecznych domowych metod, dlatego pilnie potrzebne są wiarygodne sposoby oceny jakości filmów na dużą skalę.

Jak badacze testowali recenzentów wideo opartych na AI

Zespół zgromadził 185 filmów w języku chińskim o suchości oka z TikToka, używając nowego, neutralnego konta i surowych zasad, by zachować tylko oryginalne, edukacyjne klipy. Dwóch okulistów oceniło każdy film za pomocą trzech ustalonych narzędzi często stosowanych w badaniach edukacji medycznej. Jedno narzędzie oceniało, jak łatwe do zrozumienia są filmy i jak jasno sugerują konkretne kroki, które widzowie mogą podjąć. Drugie nadawało ogólną ocenę jakości od złej do doskonałej. Trzecie rozbijało jakość na aspekty takie jak płynność prezentacji informacji, jej dokładność, sposób wykorzystania elementów dodatkowych (np. animacji) oraz zgodność treści z tytułem filmu.

Wystawienie na próbę modeli AI zrozumiałych dla wideo

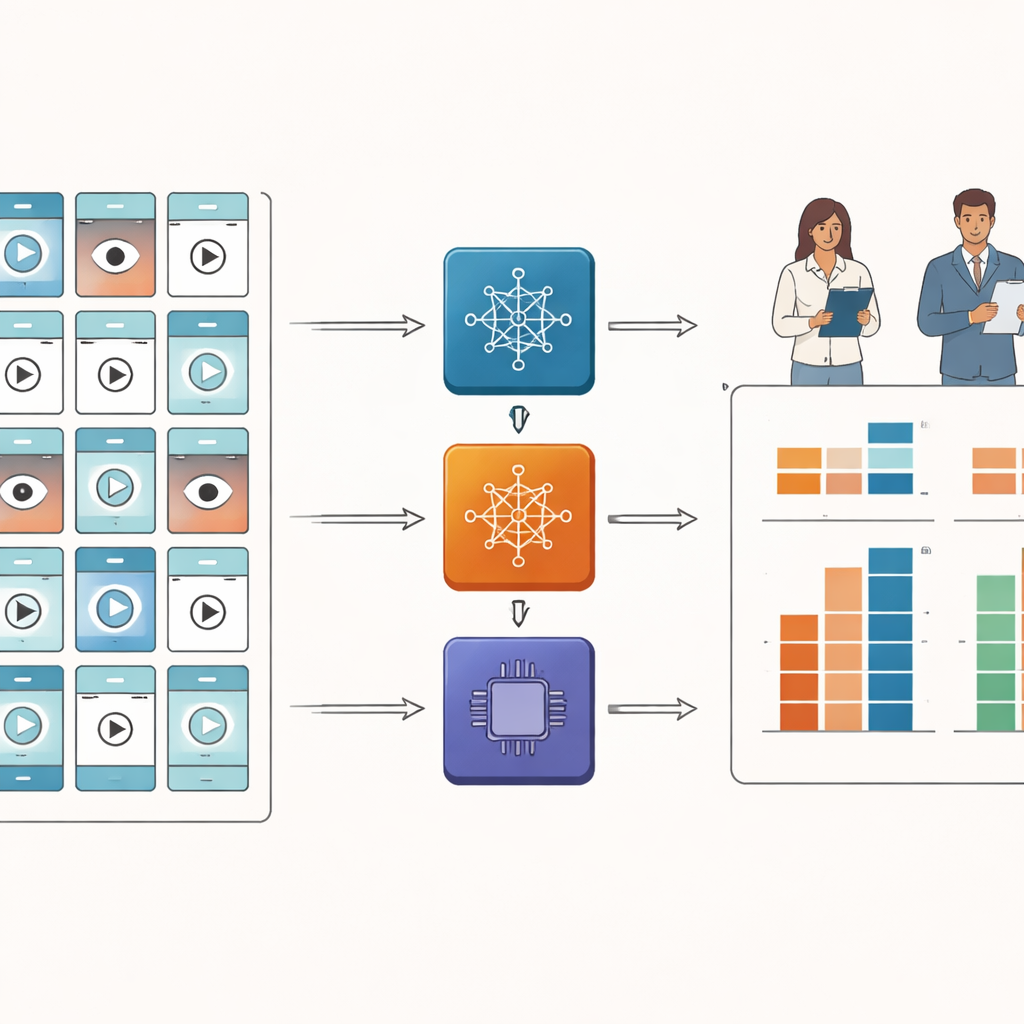

Następnie badacze wprowadzili te same filmy do trzech zaawansowanych „wideo dużych modeli językowych”, systemów AI zaprojektowanych do interpretacji informacji wizualnej klatka po klatce i odpowiadania na pytania o to, co widzą. Przygotowali szczegółowe instrukcje, aby każdy model jak najwierniej naśladował narzędzia oceniania używane przez lekarzy. Kluczowe pytanie brzmiało, czy AI i eksperci przyznadzą podobne oceny. Aby to zmierzyć, zespół zastosował standardową statystykę rzetelności, która pokazuje, jak blisko zgadzają się dwaj „sędziowie”, nie tylko w trendach, lecz także w konkretnych liczbach.

Co AI zrobiło dobrze — i co źle

Ludzie-oceniający w dużej mierze zgadzali się między sobą, co sugeruje, że ich oceny były stabilne i wiarygodne. W przeciwieństwie do tego trzy systemy AI wykazały słabą zgodność z ekspertami w większości obszarów. Żaden z modeli nie potrafił niezawodnie dopasować się do lekarzy w ocenie ogólnej jakości filmu ani w szczegółowych cechach, takich jak zgodność tytułu z treścią. Jeden model miał tendencję do wystawiania wyższych ocen niż eksperci, inny z kolei zazwyczaj oceniać je niżej, a tylko jeden czasami plasował się pośrodku. Jedyne względne pozytywne odstępstwo dotyczyło „wykonawczości” (actionability) — czyli tego, jak jasno filmy mówiły widzom, co mają zrobić — gdzie dwa modele osiągnęły umiarkowany poziom zgodności, ale nadal były dalekie od wymaganego poziomu dla decyzji w świecie rzeczywistym.

Dlaczego dzisiejsze AI okazuje się niewystarczające

Autorzy wskazują kilka powodów tej luki. Testowane systemy AI były trenowane głównie na scenach codziennych i ogólnych zadaniach wideo, a nie na starannie zorganizowanej edukacji zdrowotnej. Wiele naukowych filmów opiera się w dużej mierze na wypowiedziach ustnych, napisach, wykresach i metaforach, a nie na efektownych ruchomych obrazach — modele w tym badaniu analizowały wyłącznie klatki wideo i nie słuchały dźwięku ani nie czytały tytułów i innych informacji opisowych, z których korzystają ludzie przy ocenie trafności i dokładności. W rezultacie duże części znaczenia nie docierały do AI, zwłaszcza gdy kluczowe szczegóły były wypowiedziane, a nie pokazane. Język figuratywny powszechny w chińskiej edukacji zdrowotnej może również mylić systemy interpretujące wypowiedzi dosłownie.

Co to oznacza dla pacjentów i platform

Ta praca daje wczesną mapę drogową, a nie gotową sieć bezpieczeństwa. Pokazuje, że w zasadzie znane listy kontrolne jakości informacji zdrowotnej można przełożyć na instrukcje dla modeli AI „oglądających” filmy. Jednocześnie jasno pokazuje, że obecne systemy uniwersalne nie są jeszcze wystarczająco wiarygodne, by oceniać filmy medyczne lub zwalczać dezinformację bez nadzoru człowieka. Publikując swoje ramy oceny i opatrzony adnotacjami zbiór filmów, autorzy mają nadzieję pobudzić rozwój lepszych, bardziej wyspecjalizowanych modeli łączących obraz, dźwięk i kontekst dodatkowy oraz działających w różnych chorobach i językach. Na razie widzowie powinni traktować krótkie filmy zdrowotne jako punkt wyjścia, a nie poradę medyczną, a platformy nie powinny polegać wyłącznie na AI, by zapewnić wiarygodność informacji.

Cytowanie: Zhou, S., Huang, M., Wei, J. et al. Benchmark evaluation of video large language models in quality assessment of science popularization videos for dry eye. Sci Rep 16, 8756 (2026). https://doi.org/10.1038/s41598-026-39444-0

Słowa kluczowe: choroba suchego oka, filmy zdrowotne, sztuczna inteligencja, dezinformacja, TikTok