Clear Sky Science · pl

Analiza związku cech mówcy i cech multimodalnych uwzględniająca prywatność w rozmowach kwalifikacyjnych

Dlaczego twój głos w rozmowach kwalifikacyjnych rodzi nowe pytania

Coraz więcej firm sięga po zautomatyzowane rozmowy wideo, w których algorytmy analizują sposób mówienia i wnioskują cechy takie jak pewność siebie, rzetelność czy towarzyskość. Jednak głos niesie ze sobą znacznie więcej niż pierwsze wrażenie — może zdradzić tożsamość, stan zdrowia czy pochodzenie. W artykule badano, czy można ukryć to, kim jesteś w nagraniu, jednocześnie pozwalając komputerom ocenić, jak wypadasz jako kandydat. Innymi słowy: czy da się zachować korzyści rekrutacji wspomaganej AI, nie poświęcając przy tym naszej prywatności?

Od pierwszych wrażeń do zautomatyzowanych ocen

Psychologowie zajmujący się rekrutacją od dawna wiedzą, że szerokie wzorce osobowości — często opisywane jako Wielka Piątka: otwartość, sumienność, ekstrawersja, ugodowość i stabilność emocjonalna — mają znaczenie dla sukcesu zawodowego. Ostatnie postępy w sztucznej inteligencji pozwalają komputerom szacować te cechy na podstawie sposobu mówienia w rozmowach kwalifikacyjnych, uwzględniając nie tylko treść wypowiedzi, lecz także sposób jej artykulacji: wysokość tonu, głośność, rytm i ogólny styl mówienia. Systemy te obiecują szybsze i bardziej spójne przeglądanie kandydatów. Jednak stawiają też niepokojące pytanie: jeśli firma przechowa twój głos, czy te same dane później nie zostaną użyte do rozpoznania cię, profilowania lub wnioskowania wrażliwych informacji, na które nie wyraziłeś zgody?

Jak ukryć głos, nie tracąc jego charakteru

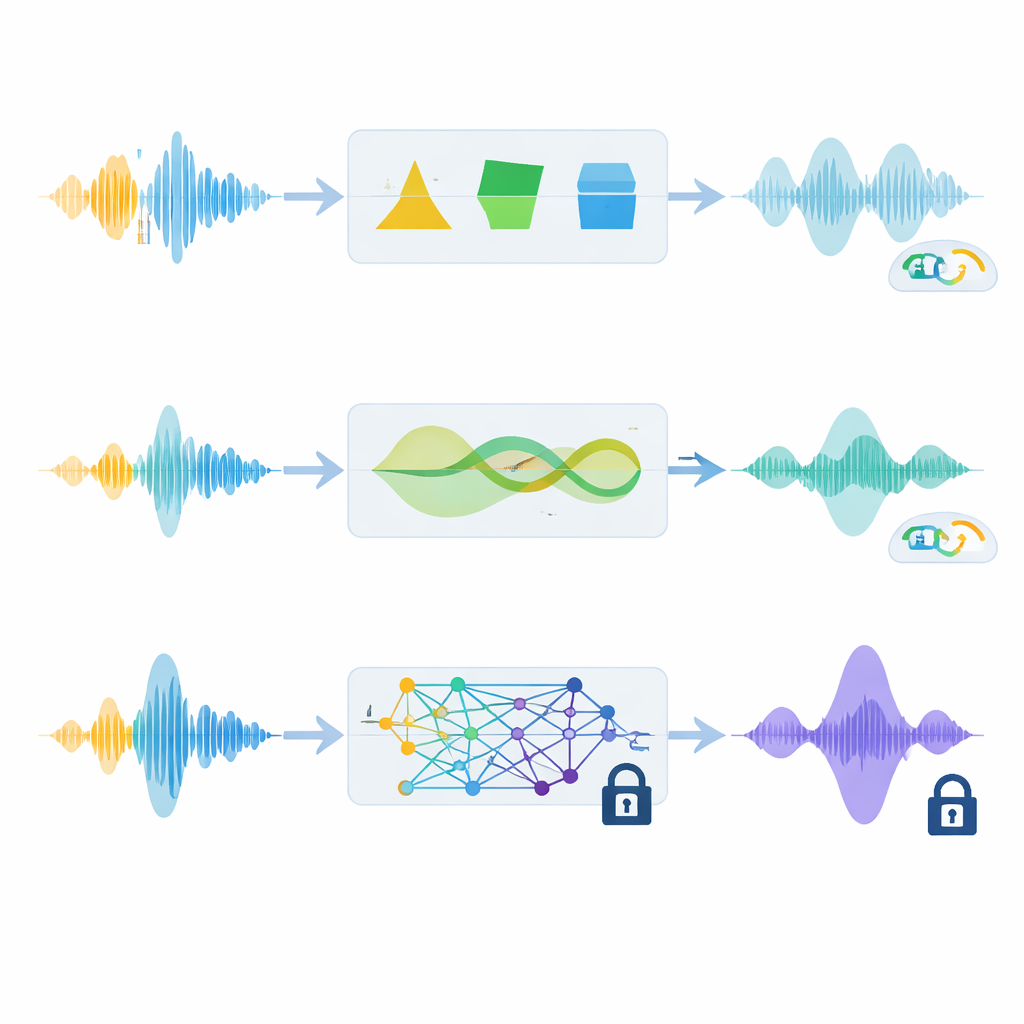

Aby zmierzyć się z tym dylematem, badacze zbadali techniki modyfikujące głos tak, by przestał brzmieć jak głos konkretnej osoby, przy jednoczesnym zachowaniu wskazówek potrzebnych do ocen osobowości i przydatności do pracy. Skupili się na trzech metodach anonimizacji. Dwie z nich stosują tradycyjne zabiegi audio, takie jak subtelne przekształcanie widma dźwięku czy rozciąganie i przesuwanie wysokości tonu w czasie. Trzecia opiera się na nowoczesnym neuronowym kodeku audio, który kompresuje głos do serii cyfrowych kodów, a następnie odbudowuje go jako nowy, wysokiej jakości, ale inaczej brzmiący głos. Kluczowe było dostosowanie wszystkich metod tak, by postrzegana płeć mówcy pozostała niezmieniona, a przetworzony głos był spójny w kolejnych odpowiedziach podczas długiej rozmowy online.

Testowanie prywatności i użyteczności

Wykorzystując prawie 1 900 rzeczywistych nagrań z rozmów kwalifikacyjnych online od osób z USA, autorzy postawili dwa główne pytania. Po pierwsze: jak trudno byłoby atakującemu powiązać zanonimizowane głosy z oryginalnymi mówcami przy użyciu zaawansowanego systemu rozpoznawania głosu? Po drugie: czy po anonimizacji algorytmy nadal potrafią przewidywać kluczowe oceny osobowości i rekomendacje rekrutacyjne z podobną dokładnością? Prywatność oceniano za pomocą wskaźnika błędu automatycznej weryfikacji mówcy — wyższy błąd oznacza lepszą ochronę — a użyteczność przez dokładność rozpoznawania mowy, postrzeganą jakość dźwięku oraz zdolność modeli uczenia maszynowego do wnioskowania cech i decyzji rekrutacyjnych na podstawie cech akustycznych i językowych.

Jak naprawdę wygląda kompromis

Wyniki pokazują zniuansowaną równowagę między bezpieczeństwem a wydajnością. Najprostsza metoda, która delikatnie przekształca pasma częstotliwości, zapewniała jedynie umiarkowaną prywatność i mogła niemal zawieść, gdy system atakującego był dostrojony do zanonimizowanych głosów. Bardziej zaawansowana technika oparta na sygnale, zmieniająca timing i wysokość tonu, poradziła sobie znacznie lepiej: istotnie obniżyła szanse powodzenia re-identyfikacji, jednocześnie zachowując rytm i ekspresję mowy. W efekcie prognozy rekrutacyjne i osobowościowe pozostały bliskie tym uzyskanym z oryginalnych nagrań. Metoda z użyciem neuronowego kodeka audio dała najsilniejszą ochronę, utrudniając powiązanie zanonimizowanych głosów z rzeczywistymi mówcami i często redukując szumy tła. Jednak w hałaśliwych, rzeczywistych nagraniach rozmów kwalifikacyjnych ten sposób zaburzał subtelne cechy prozodyczne, które wpływają na postrzeganie cech, prowadząc do zauważalnego spadku dokładności estymacji cech i wyższych błędów w automatycznej transkrypcji.

Znaczenie dla sprawiedliwej i prywatnej rekrutacji

Badanie pokazuje, że nie ma jednego uniwersalnego rozwiązania: silniejsza prywatność często wiąże się z kosztem możliwości odczytu osobowości i rekomendowania kandydatów przez AI. W typowych warunkach rekrutacyjnych, gdzie priorytetem są estymaty cech i sprawiedliwe decyzje, dopracowane podejścia przetwarzania sygnału — w szczególności testowana tutaj metoda oparta na fazie — mogą oferować najlepszy kompromis, chroniąc tożsamość, a jednocześnie zachowując „charakter” głosu. W sytuacjach o wyższych wymaganiach prywatności, takich jak szerokie udostępnianie danych mowy czy ochrona przed silnymi atakującymi, nowoczesne kodeki neuronowe mogą zapewnić większą ochronę, lecz projektanci muszą pogodzić się z pewną utratą dokładności w ocenie osobowości i przydatności. Ostatecznie praca argumentuje, że ochrona głosów kandydatów powinna być traktowana jako wymóg etyczny, a nie dodatek, i że przyszłe narzędzia muszą precyzyjnie celować w elementy mowy, które należy ukryć, oraz te, które warto zachować.

Cytowanie: Mawalim, C.O., Leong, C.W. & Okada, S. Privacy-aware speaker trait and multimodal features relationship analysis in job interviews. Sci Rep 16, 8181 (2026). https://doi.org/10.1038/s41598-026-39322-9

Słowa kluczowe: anonimizacja głosu, rekrutacja AI, cechy mówcy, prywatność w danych mowy, rozmowy kwalifikacyjne