Clear Sky Science · pl

Rozpoznawanie emocji z naciskiem na wideo dla przenośnych urządzeń EEG

Dlaczego twoje filmy mogą wiedzieć, co czujesz

Wyobraź sobie oglądanie zwiastuna filmowego, podczas gdy lekka opaska cicho nasłuchuje twojego mózgu i próbuje odgadnąć, czy czujesz się szczęśliwy, zrelaksowany, smutny czy przestraszony. Badanie to sprawdza, jak uczynić ten scenariusz realistycznym, używając małego, przenośnego urządzenia do zapisu fal mózgowych (EEG) zamiast ciężkiego sprzętu laboratoryjnego. Praca ma znaczenie dla każdego zainteresowanego „inteligentniejszym” odbiorem mediów: od reklamodawców, którzy chcą zrozumieć reakcje widowni, po platformy streamingowe, które mogłyby rekomendować programy na podstawie rzeczywistych odczuć widzów, a nie tylko kliknięć.

Odczytywanie uczuć z fal mózgowych

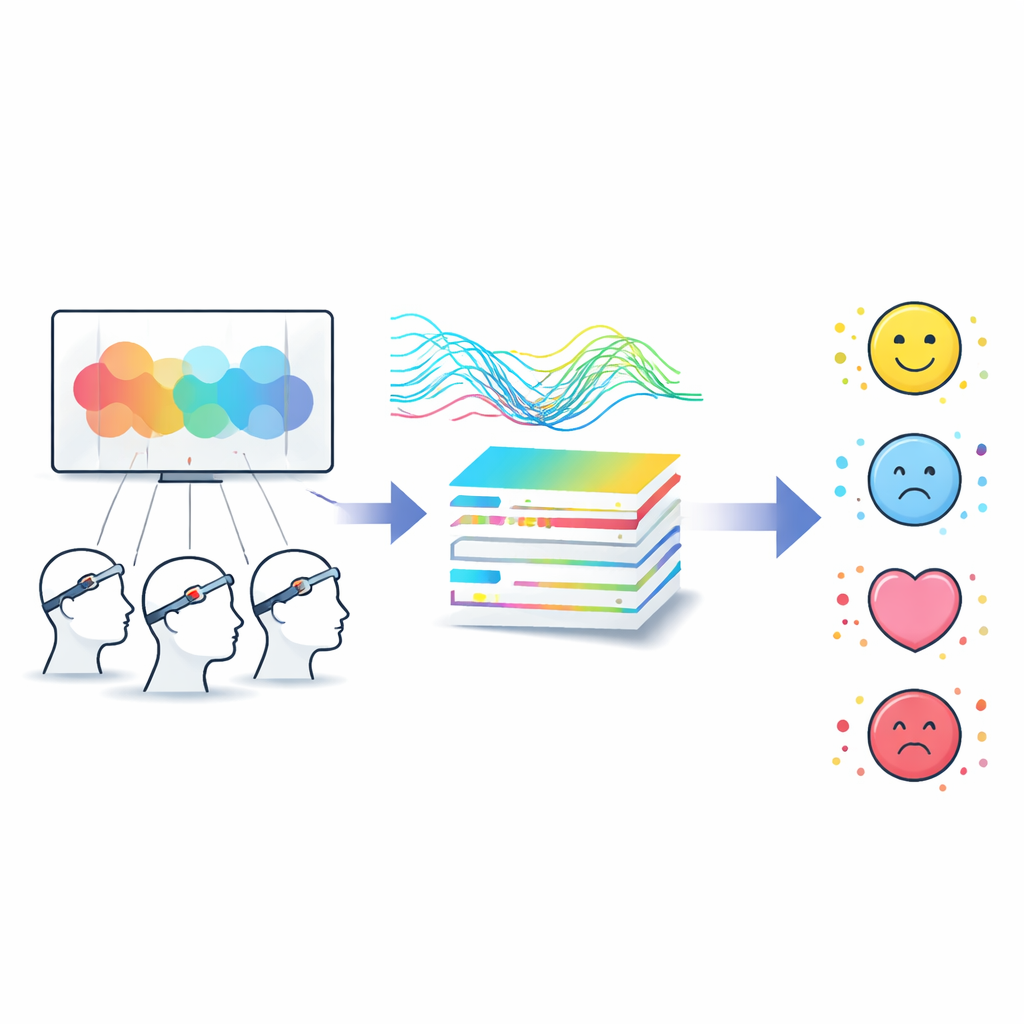

Nasz mózg generuje słabe sygnały elektryczne, które można zarejestrować na skórze głowy za pomocą elektroencefalografii, czyli EEG. Sygnały te subtelnie zmieniają się, gdy doświadczamy różnych emocji. Popularny zbiór danych o nazwie DEAP nagrał EEG uczestników podczas oglądania teledysków muzycznych i poprosił ich potem o ocenę, jak przyjemne, intensywne, kontrolowane i lubiane są poszczególne wideo. Większość wcześniejszych prac dążyła do maksymalizacji dokładności, korzystając z wielu elektrod i wydajnych komputerów, lecz w idealnych warunkach laboratoryjnych, które nie odzwierciedlają życia codziennego. Niniejszy artykuł stawia bardziej praktyczne pytanie: czy przy użyciu taniego, przenośnego urządzenia i mniejszej liczby elektrod nadal da się uchwycić dominującą emocję, jaką dane wideo wywołuje u wielu osób?

Odnajdywanie wspólnej emocjonalnej narracji

Jedną z przeszkód jest fakt, że ludzie nie opisują swoich uczuć jednakowo. Dwóch widzów może obejrzeć ten sam fragment — jeden uzna go za „emocjonujący”, drugi za „tak sobie”. Badacze rozwiązują to, tworząc etapowy system kalibracji etykiet, który szuka wzorców wśród widzów zamiast polegać na ocenie pojedynczej osoby. Najpierw wszystkie oceny są skalowane do wspólnej skali i skompresowane do kilku kluczowych wymiarów. Następnie niesuperwizowane grupowanie (clustering) łączy podobne reakcje emocjonalne, dążąc do podziału wideo na cztery szerokie narożniki przestrzeni emocji: szczęśliwe (przyjemne i intensywne), zrelaksowane (przyjemne i spokojne), przestraszone (nieprzyjemne i intensywne) oraz smutne (nieprzyjemne i spokojne). Ostatni etap dopracowania delikatnie koryguje niepewne przypadki na podstawie dodatkowych informacji z ocen, dając dominującą etykietę emocji dla każdego wideo, która lepiej odzwierciedla ogólne wrażenie grupy.

Więcej z mniejszej liczby sensorów

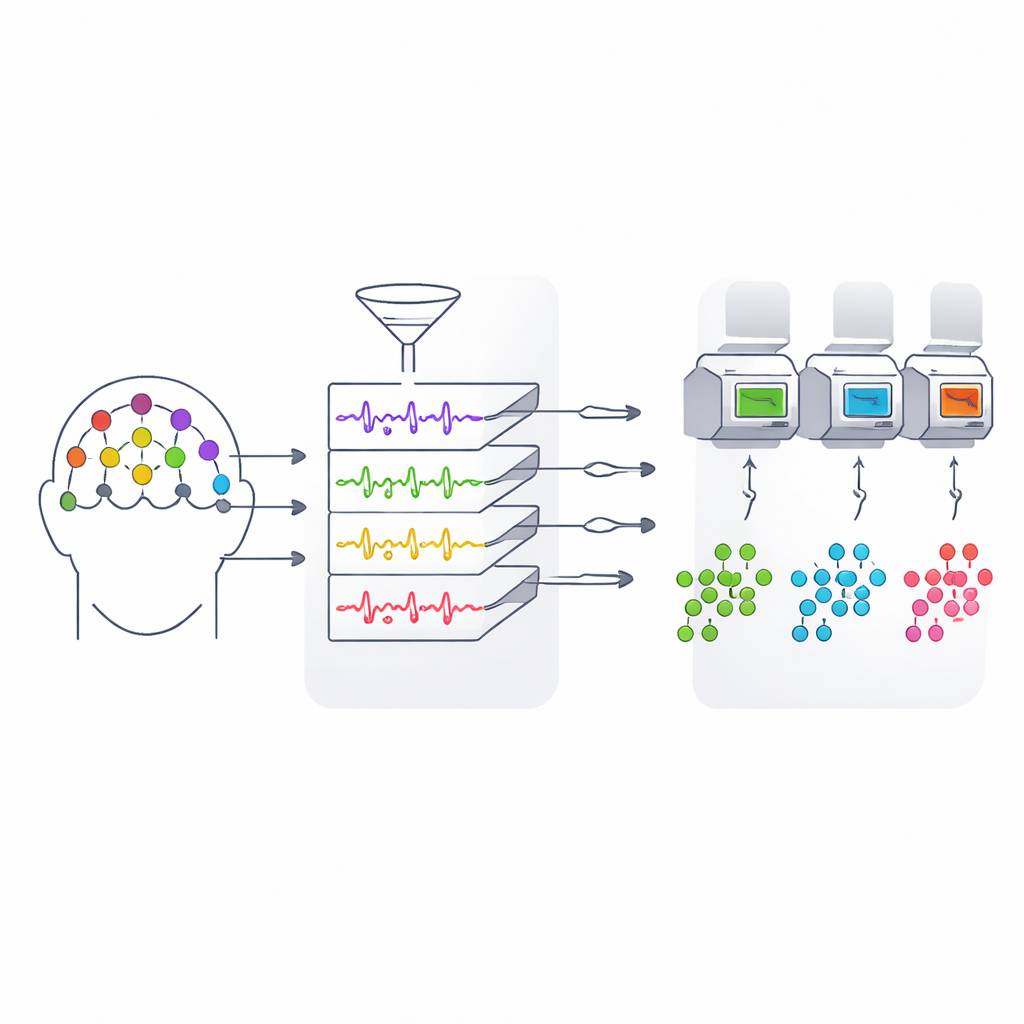

Kolejne wyzwanie to sprzęt: pełne czepki EEG z 32 lub więcej elektrodami są nieporęczne i kosztowne. Zespół opracowuje sposób redukcji do zaledwie 11 starannie wybranych miejsc nad czołem, środkową częścią, bokami i tyłem głowy — obszarów powiązanych z kontrolą emocji, pobudzeniem, słyszeniem, wzrokiem i uwagą. Następnie przeprowadzają szczegółową analizę, jak energia sygnału rozkłada się w klasycznych pasmach rytmów mózgowych (od wolnych do szybkich) w różnych stanach emocjonalnych. Porównując te wzorce, pokazują, że pewne kombinacje częstotliwości i lokalizacji na skórze głowy niosą szczególnie silne wskazówki o tym, czy widz jest np. wysoko pobudzony czy głęboko zrelaksowany. Podejście oparte na stosunkach energii w wielu pasmach pozwala zachować najbardziej informacyjne sygnały, odrzucając dużą część redundancji.

Pozwolenie danym, by wskazały, co się liczy

Nawet przy mniejszej liczbie elektrod każda sekunda zapisu zawiera potok liczb. Aby nie przeciążyć modeli, autorzy łączą kilka typów cech — takich jak miary energii oparte na falkach, siła współzmienności między różnymi regionami mózgu oraz zmiany mocy w poszczególnych częstotliwościach w czasie — w bogaty, lecz strukturalny opis każdego oglądania. Krok selekcji prowadzony według istotności (saliency) porządkuje te cechy według ich przydatności do rozróżniania emocji, zachowując jedynie skompaktowany podzbiór. Na podstawie tej odchudzonej reprezentacji trenują trzy standardowe modele uczenia maszynowego, aby rozpoznawać, która z czterech dominujących emocji najlepiej pasuje do danego wideo. W wymagających testach, gdzie system musi uogólnić wyniki na zupełnie nowe osoby, najlepszy model osiąga około 45% dokładności — solidny wynik przy czteroklasowym wyborze, na hałaśliwych danych EEG i tylko 11 kanałach.

Co to oznacza dla technologii codziennego użytku

Dla osób niebędących specjalistami kluczową wiadomością jest to, że możemy zacząć oceniać, jak grupy ludzi reagują emocjonalnie na wideo, używając małych, przenośnych urządzeń EEG zamiast pełnych stanowisk laboratoryjnych. Poprzez oczyszczenie etykiet emocjonalnych, skupienie się na najbardziej informacyjnych częściach sygnału EEG i wybranie zaledwie kilku dobrze rozmieszczonych sensorów, autorzy pokazują, że możliwe jest wykrycie dominującego tonu emocjonalnego wideo — szczęśliwy, zrelaksowany, przestraszony lub smutny — wśród widzów. System nie jest idealny, ale wskazuje drogę do praktycznych narzędzi do śledzenia nastrojów odbiorców, testowania treści i rekomendacji uwzględniających emocje, opierających się na obiektywnych reakcjach mózgu zamiast tylko ankiet czy kliknięć.

Cytowanie: Wen, X., Xu, W., Tian, L. et al. Video-dominant emotion recognition for portable EEG-based devices. Sci Rep 16, 7899 (2026). https://doi.org/10.1038/s41598-026-39315-8

Słowa kluczowe: rozpoznawanie emocji z EEG, interfejs mózg–komputer, analiza afektów wideo, nauki o mózgu w urządzeniach noszonych, informatyka afektywna