Clear Sky Science · pl

Analiza porównawcza wbudowanych modeli chatbotów i ChatGPT-4 w odpowiadaniu na pytania o leczenie ortodontyczne

Dlaczego inteligentniejsze chatboty mają znaczenie przy aparatach

Każdy, kto nosił aparat, wie, że pytania nie czekają na godziny przyjęć: czy ból minie? Czy mogę to zjeść? Czy powinienem martwić się o szczękę? W tym badaniu sprawdzono, czy chatbot ortodontyczny zaprojektowany specjalnie do odpowiadania na takie codzienne pytania potrafi udzielać jaśniejszych i bardziej wiarygodnych odpowiedzi niż ogólny system sztucznej inteligencji, ChatGPT‑4. Praca pokazuje, jak starannie dostosowane narzędzia AI mogą wspierać zarówno pacjentów, jak i klinicystów we współczesnej opiece stomatologicznej.

Chatbot stworzony specjalnie do pytań o aparat

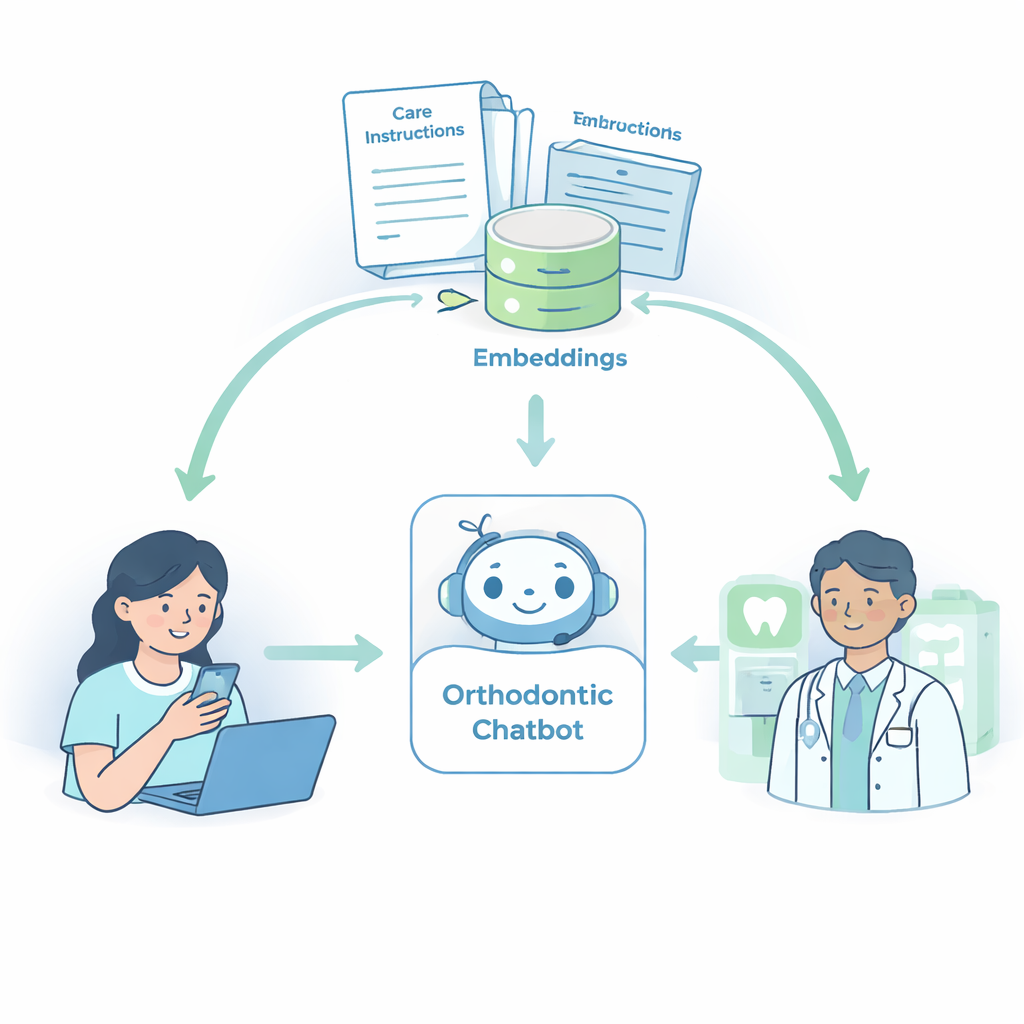

Naukowcy opracowali wbudowanego chatbota skoncentrowanego wyłącznie na leczeniu ortodontycznym. Zamiast trenować nową sztuczną inteligencję od podstaw, połączyli zaawansowany model językowy ze starannie wybraną biblioteką materiałów dla pacjentów i istotnych fragmentów podręczników. Biblioteka zawierała ulotki Brytyjskiego Towarzystwa Ortodontycznego na tematy takie jak higiena jamy ustnej, dieta, pielęgnacja aparatów, gumki i retainery, a także krótkie wyjaśnienia ze standardowych podręczników ortodoncji. Korzystając z techniki zwanej generacją wspierana wyszukiwaniem (retrieval‑augmented generation), system wyszukiwał w tej bibliotece odpowiednie fragmenty przy każdym zadanym pytaniu i wykorzystywał je do formułowania odpowiedzi, dążąc do odzwierciedlenia tego, co pacjent usłyszałby podczas zwykłej rozmowy przy fotelu.

Jak badanie porównało oba systemy

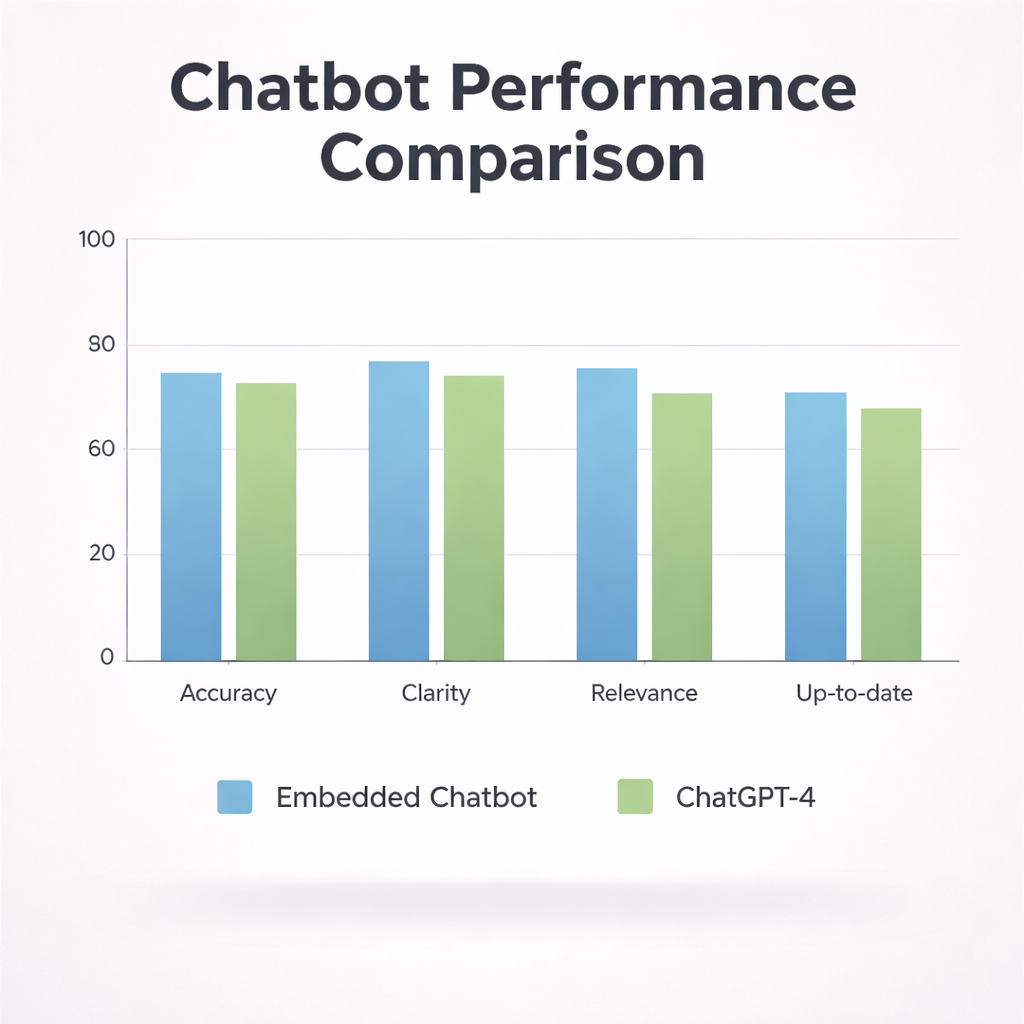

Aby ocenić, jak dobrze działa ten wyspecjalizowany chatbot, zespół porównał go z ChatGPT‑4, używanym w standardowy sposób przez interfejs ChatGPT Plus. Zebrali 30 rzeczywistych pytań, które pacjenci często zadają przed, w trakcie i po leczeniu aparatem — na przykład czy aparat powoduje ból, jak wpływa na mówienie lub śpiew, jak często są potrzebne kontrole oraz czy aparat może pomóc w problemach ze stawem skroniowo‑żuchwowym. Oba systemy otrzymały te same polecenia, by odpowiadać jako ekspert ortodontyczny, używając jasnego, przystępnego języka. Sześciu doświadczonych konsultantów ortodontycznych oceniło następnie każdą zanonimizowaną odpowiedź pod kątem czterech aspektów: dokładności, jasności, istotności względem pytania oraz aktualności informacji, używając pięciopunktowej skali.

Pomiary jakości, nie tylko opinie

Zamiast polegać na ogólnych wrażeniach, badacze zastosowali ustrukturyzowaną metodę punktacji zwaną Wskaźnikiem Trafności Treści (Content Validity Index). Dla każdego pytania i każdego aspektu jakości zliczali, ile osób ekspertów oceniło odpowiedź jako „zgadzam się” lub „zdecydowanie się zgadzam” i przeliczali to na wynik w przedziale od zera do jednego. Wysokie wyniki oznaczały, że większość ekspertów uznała odpowiedź za dokładną, jasną, istotną lub aktualną. Obliczono także średnie dla wszystkich pytań, aby zobaczyć, jak wypadł każdy system ogólnie. Zastosowano testy statystyczne, by sprawdzić, czy ewentualne różnice między dwoma chatbotami były wystarczająco duże, by uznać je za istotne, a nie wynikające z przypadku.

Co ortodonci myśleli o odpowiedziach

Wbudowany chatbot przeważnie wypadał lepiej. Około trzy czwarte jego odpowiedzi osiągnęło akceptowalny próg jakości, w porównaniu z nieco ponad połową odpowiedzi ChatGPT‑4. Średnio wyspecjalizowany chatbot uzyskał wyższe oceny w zakresie dokładności, jasności i istotności, a także wydawał się nieznacznie bardziej zgodny z aktualnymi wytycznymi. Na przykład w wyjaśnianiu bólu w trakcie leczenia aparatem czy wpływu aparatu na mowę jego odpowiedzi były proste, konkretne i ściśle odpowiadały standardowym poradom dla pacjentów. Dla porównania odpowiedzi ChatGPT‑4, choć często sensowne, miały tendencję do bycia bardziej ogólnymi i czasem bardziej technicznymi, co mogło obniżać ich przejrzystość z punktu widzenia ekspertów. Jednakże po przeprowadzeniu formalnych testów statystycznych różnice między systemami nie były na tyle duże, by uznać je za istotne statystycznie.

Ograniczenia i wnioski dla przyszłego zastosowania AI w klinice

Badanie ujawniło także, że nawet eksperci nie zawsze zgadzają się co do tego, co stanowi „najlepszą” odpowiedź. Ogólna zgodność między ortodontami była słabsza niż oczekiwano, zwłaszcza w odniesieniu do subiektywnych aspektów takich jak jasność i istotność. Badacze wskazali kilka innych ograniczeń: zbadano tylko dwa zestawy AI, nie zaangażowano bezpośrednio pacjentów i oparli wyspecjalizowanego chatbota na konkretnym zbiorze materiałów pisanych. Mimo to ich praca dołącza do rosnących dowodów, że systemy AI potrafią rozsądnie odpowiadać na wiele powszechnych pytań stomatologicznych, a dodanie skoncentrowanych, aktualnych materiałów referencyjnych może poprawić ich wydajność.

Co to oznacza dla osób noszących aparat

Dla pacjentów wniosek jest budujący, ale ostrożny. Dobrze zaprojektowany chatbot skoncentrowany na ortodoncji może dostarczać jasne, godne zaufania odpowiedzi na wiele codziennych pytań i może zmniejszać niepokój między wizytami. Jednocześnie badanie pokazuje, że takie narzędzie nie zastępuje jeszcze potrzeby profesjonalnej oceny czy porady twarzą w twarz. Prawdziwa obietnica leży w łączeniu tych dostosowanych asystentów AI z opieką ekspertów, tak by osoby noszące aparat mogły otrzymywać terminowe, zrozumiałe informacje, przy jednoczesnym poleganiu na ortodoncie przy decyzjach ostatecznych.

Cytowanie: Khalil, R., Amin, L., Sukhia, R.H. et al. A comparative analysis of embedded chatbot models and ChatGPT-4 for answering orthodontic treatment queries. Sci Rep 16, 7776 (2026). https://doi.org/10.1038/s41598-026-39263-3

Słowa kluczowe: chatbot ortodontyczny, AI stomatologiczna, pytania o aparat, edukacja pacjenta, porównanie z ChatGPT