Clear Sky Science · pl

Ocena asystentów nauki zasilanych AI w kształceniu inżynierskim wyższym z implikacjami dla zaangażowania studentów, etyki i polityki

Dlaczego to ma znaczenie dla dzisiejszych studentów

Studenci uczelni sięgają po chatboty i inne narzędzia sztucznej inteligencji, aby uzyskać pomoc w zadaniach domowych, kodowaniu i trudnych zagadnieniach wykładów. Czy jednak te narzędzia rzeczywiście wspierają proces uczenia się, i co dzieje się z problemami takimi jak ściąganie, sprawiedliwość oraz zaufanie, gdy oprogramowanie staje się partnerem do nauki? Niniejszy artykuł opisuje eksperyment w warunkach rzeczywistych na kursach inżynierii lądowej i środowiskowej, który przetestował „Edukacyjny Hub AI” i zapytał studentów, co działało, co ich niepokoiło oraz jak wyobrażają sobie rolę AI w przyszłości szkolnictwa wyższego.

Jeden cyfrowy kolega do nauki, wiele wbudowanych narzędzi

Edukacyjny Hub AI to asystent dydaktyczny przypisany do konkretnego kursu, dostępny w uczelnianej platformie e-learningowej. Zamiast wysyłać pytania do ogólnego chatbota wytrenowanego na całym internecie, studenci komunikują się z asystentem ściśle powiązanym z ich wykładami, zadaniami i sylabusem. W tle system analizuje zatwierdzone przez prowadzącego pliki kursowe w formacie PDF, dzieli je na przeszukiwalne fragmenty i przesyła tylko te fragmenty do zaawansowanego modelu językowego, by odpowiadał na pytania studentów. Hub oferuje sześć głównych narzędzi: krótkie notatki generowane przez AI, chatbota do pytań i odpowiedzi, fiszki, automatycznie oceniane quizy, „piaskownicę” do pomocy w kodowaniu oraz szybkie odpowiedzi dotyczące logistyki sylabusa. Został zaprojektowany, by działać jak przyjazny, zawsze dostępny asystent nauczania, a nie jako mechanizm skrótu.

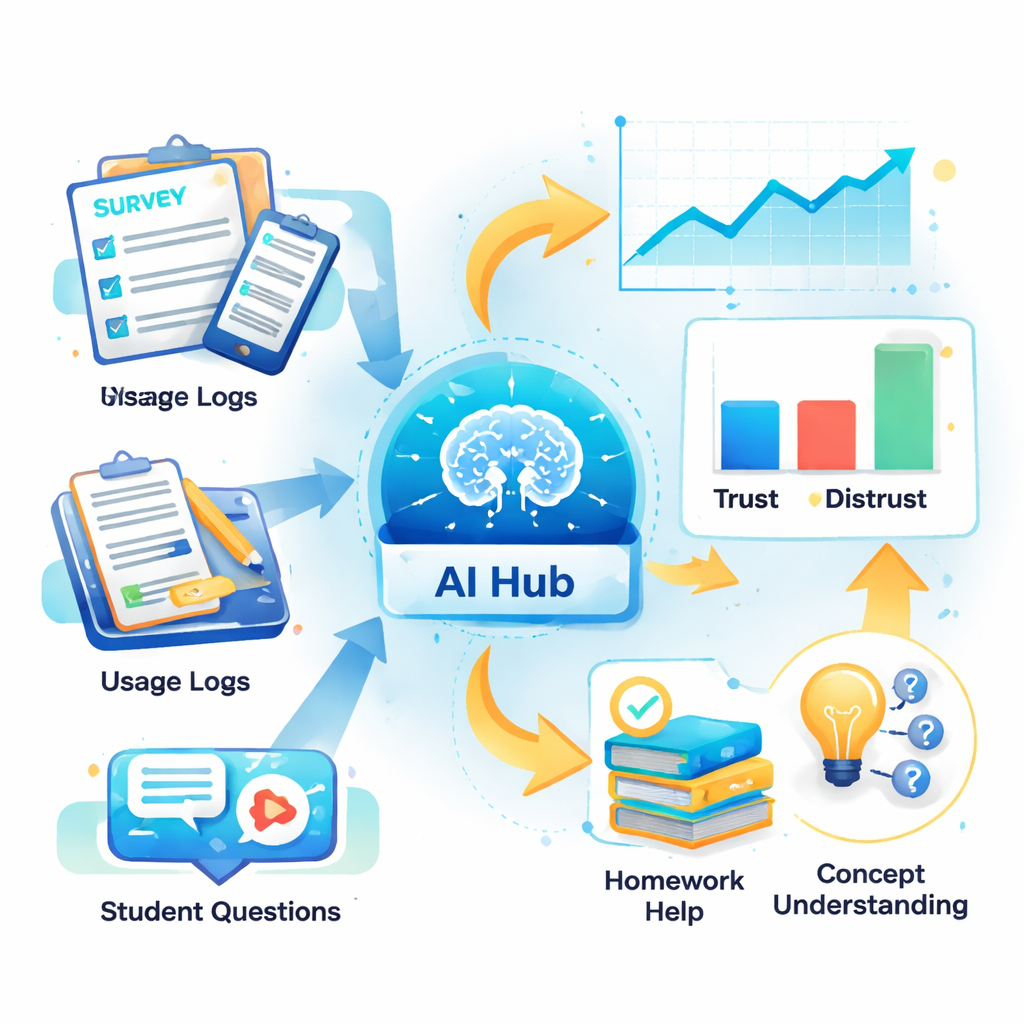

Jak przeprowadzono badanie

Aby sprawdzić, jak studenci faktycznie korzystali z tego asystenta, badacze osadzili go na dwóch kursach dla studentów studiów inżynierskich na dużym publicznym uniwersytecie badawczym. Spośród 77 zapisanych studentów 65 zgłosiło chęć udziału. Wypełniali ankiety na początku i na końcu semestru dotyczące ich doświadczeń z AI, zaufania do takich narzędzi oraz obaw etycznych i dotyczących uczciwości akademickiej. Jednocześnie system dyskretnie rejestrował każdą interakcję: których funkcji używano, jak często studenci wracali i jakie pytania zadawali. Zespół zakodował także setki zapytań studentów w tematy takie jak „pomoc w oprogramowaniu”, „pytania teoretyczne” czy „wyjaśnienie zadań”, aby zrozumieć, jakiej pomocy naprawdę poszukiwali studenci.

Co studenci polubili — i czemu nie do końca ufali

Najpopularniejszą funkcją bez wątpienia był chatbot, który odpowiadał za ponad 90 procent wszystkich interakcji. Studenci intensywnie korzystali z niego, by wyjść z impasu przy zadaniach związanych z oprogramowaniem, takich jak ArcGIS czy MATLAB, oraz by wyjaśniać kluczowe koncepcje i wzory inżynierskie. Wielu zgłaszało, że asystent ułatwiał zrozumienie materiału kursowego i wykonywanie zadań domowych, a niektórzy czuli się bardziej komfortowo zadając pytania AI niż wykładowcom czy asystentom. Jednak większość studentów nadal uważała pomoc ludzką za równie dobrą lub lepszą pod względem jakości. Obawy dotyczące błędnych lub wprowadzających w błąd odpowiedzi generowanych przez AI — czasem określanych jako „halucynacje” — sprawiały, że wielu użytkowników traktowało asystenta jako wygodne narzędzie do wstępnej analizy, a nie ostateczny autorytet.

Strefy etycznej niepewności i zamieszanie wokół polityki

Nawet jeśli studenci doceniali narzędzie, nie byli pewni zasad jego używania. Wielu nie miało jasności, co dokładnie stanowi przewinienie akademickie w pracy z AI i obawiało się fałszywych oskarżeń o ściąganie. Prawie połowa uważała, że AI nie podważa automatycznie uczciwości akademickiej, ale podobny odsetek czuł niepokój przed stosowaniem go przy ocenianych pracach. Co ważne, studenci nie chcieli, by AI zostało zabronione; zamiast tego opowiadali się za „umiarkowanie restrykcyjnymi” zasadami kursu z jasnymi wytycznymi. Większość zgadzała się, że korzystanie z AI jako pomocy naukowej może być etyczne i wyrażała chęć posiadania podobnych narzędzi na innych kursach, pod warunkiem że oczekiwania będą jasno sformułowane i powiązane z odpowiedzialnymi praktykami, takimi jak weryfikacja źródeł i cytowanie wsparcia.

Od danych do lepszego nauczania i uczenia się

Logi użytkowania i odpowiedzi z ankiet kreśliły spójny obraz: studenci najintensywniej korzystali z Huba AI, gdy mu ufali, czuli się przy nim komfortowo i uznawali go za naprawdę pomocnego przy zadaniach kursowych, takich jak powtórka koncepcji czy prace domowe. Mniejsze zaufanie do AI szło w parze z niższym użyciem, podczas gdy komfort i postrzegana użyteczność korelowały z częstszym zaangażowaniem. Jednak studenci nie przypisywali narzędziu samodzielnego wpływu na poprawę ocen, a wielu nadal korzystało z ogólnych chatbotów do zagadnień z kodowania lub matematyki wykraczających poza materiały kursowe. Wzorce te sugerują, że asystenci AI sprawdzają się najlepiej jako ukierunkowana warstwa wsparcia wewnątrz kursu — nie jako zamiennik wykładowców ani uniwersalne rozwiązanie dla wszystkich problemów.

Co to oznacza dla klasy przyszłości

Dla laika wniosek jest taki, że pomocnicy do nauki opierający się na AI mogą uczynić przedmioty techniczne bardziej przystępnymi i dać studentom niskonapięciowy sposób zadawania pytań o dowolnej porze, ale sami w sobie nie rozwiązują magicznie problemów z uczeniem się. W tym badaniu studenci inżynierii traktowali Edukacyjny Hub AI jako przydatnego towarzysza, który potrafił odblokować problemy i wyjaśnić trudne zagadnienia, jednocześnie nadal polegając na nauczycielach i tradycyjnych metodach nauki. Ich największe obawy dotyczyły nie technologii jako takiej, lecz niejasnych zasad i strachu przed oskarżeniami o oszustwo. Autorzy argumentują, że jeśli uczelnie chcą, by AI rzeczywiście poprawiało edukację, muszą łączyć inteligentne, uwzględniające kurs narzędzia z przejrzystymi politykami i aktywnym wsparciem wykładowców, ucząc studentów nie tylko od AI, ale także jak korzystać z niej odpowiedzialnie.

Cytowanie: Sajja, R., Sermet, Y., Fodale, B. et al. Evaluating AI-powered learning assistants in engineering higher education with implications for student engagement, ethics, and policy. Sci Rep 16, 7565 (2026). https://doi.org/10.1038/s41598-026-39237-5

Słowa kluczowe: Sztuczna inteligencja w edukacji, studenci inżynierii, asystent nauki, uczciwość akademicka, zaangażowanie studentów