Clear Sky Science · pl

Wielomodalne duże modele językowe stawiają wyzwanie konkursowi obrazkowemu NEJM

Dlaczego to ma znaczenie dla pacjentów i lekarzy

Postawienie właściwej diagnozy we właściwym czasie może rozdzielić szybką terapię od lat cierpienia. Mimo to lekarze, nawet wysoko wyszkoleni, wciąż przegapiają lub opóźniają rozpoznania, szczególnie w przypadku rzadkich lub nietypowych chorób. To badanie stawia prowokujące pytanie: gdy obrazy medyczne i dane kliniczne zostaną wprowadzone do najnowocześniejszych dziś systemów sztucznej inteligencji, czy potrafią one rozpoznać złożone przypadki lepiej niż duża liczba prawdziwych lekarzy — a jeśli tak, co to oznacza dla przyszłej opieki medycznej?

Ogromna układanka z przypadków z praktyki

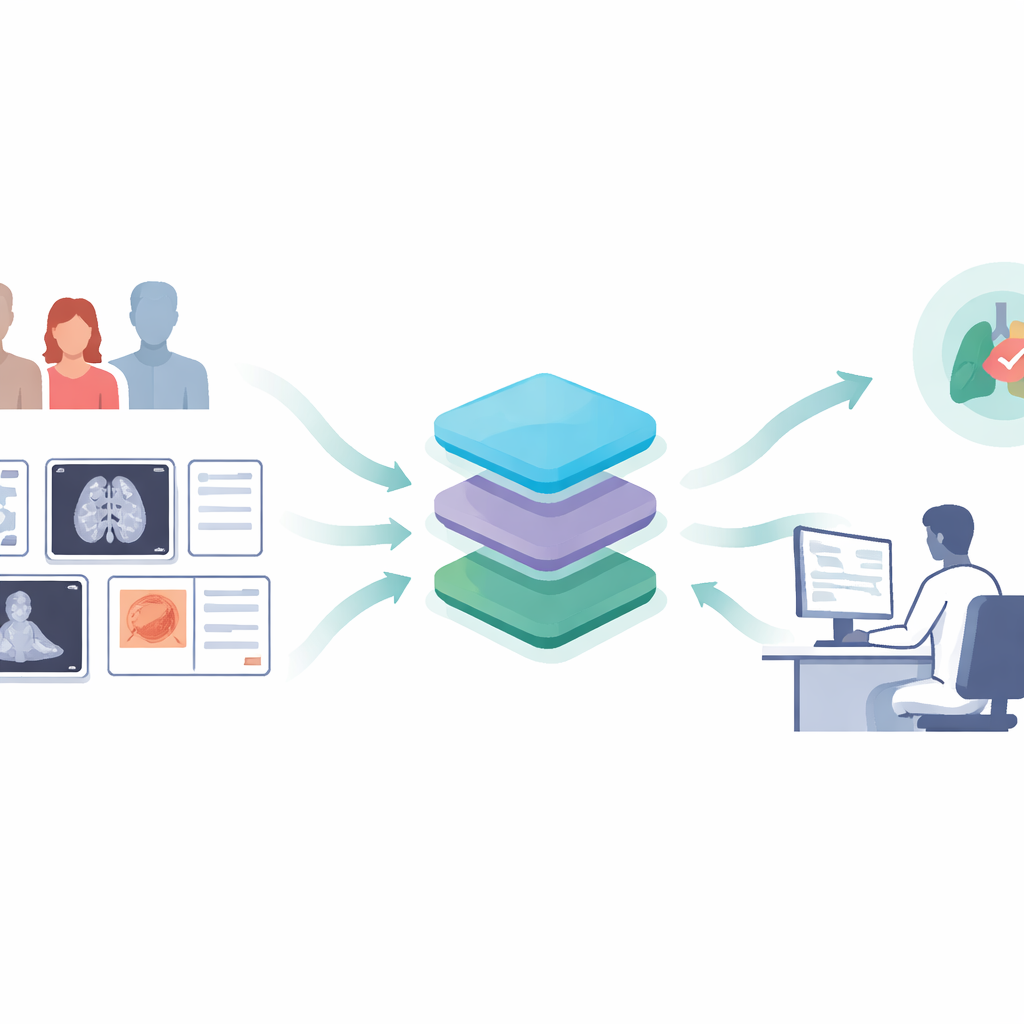

Naukowcy sięgnęli do wieloletniej rubryki New England Journal of Medicine zwanej „Image Challenge”. Każde zadanie przedstawia rzeczywisty obraz pacjenta — na przykład zdjęcie skóry, radiogram, MRI czy preparat mikroskopowy — wraz z krótką historią kliniczną i pięcioma możliwymi rozpoznaniami. Od 2009 roku zgromadzono ponad 16 milionów odpowiedzi od więcej niż 60 000 lekarzy na zadanie, tworząc wyjątkowy globalny zapis wyników lekarzy na tych samych trudnych pytaniach. Z tego archiwum zespół wybrał 272 przypadki obejmujące wszystkie grupy wiekowe, obie płcie i szeroki wachlarz schorzeń — od infekcji i chorób autoimmunologicznych po nowotwory, choroby genetyczne i urazy.

Postawienie AI i lekarzy na tej samej arenie

Badanie przetestowało trzy wiodące wielomodalne duże modele językowe — systemy, które potrafią analizować obrazy i tekst jednocześnie: GPT‑4o, Claude 3.7 oraz Doubao. W każdym przypadku modele najpierw widziały jedynie obraz i musiały wybrać jedną z pięciu opcji, uzasadniając wybór. Następnie otrzymywały obraz wraz z opisem klinicznym i odpowiadały ponownie. Aby zachować sprawiedliwość testu, modele używano w standardowych ustawieniach, bez wyszukiwania w sieci i dodatkowych funkcji wnioskowania, a każdy przypadek uruchamiano w nowej sesji, by uniknąć zanieczyszczenia wcześniejszymi odpowiedziami. Dwie lekarki/lekarki oceniały odpowiedzi AI względem oficjalnych rozwiązań New England Journal, koncentrując się na tym, czy końcowy wybór zgadzał się z prawdziwą diagnozą, tak jak w porównaniu z grupą ludzką.

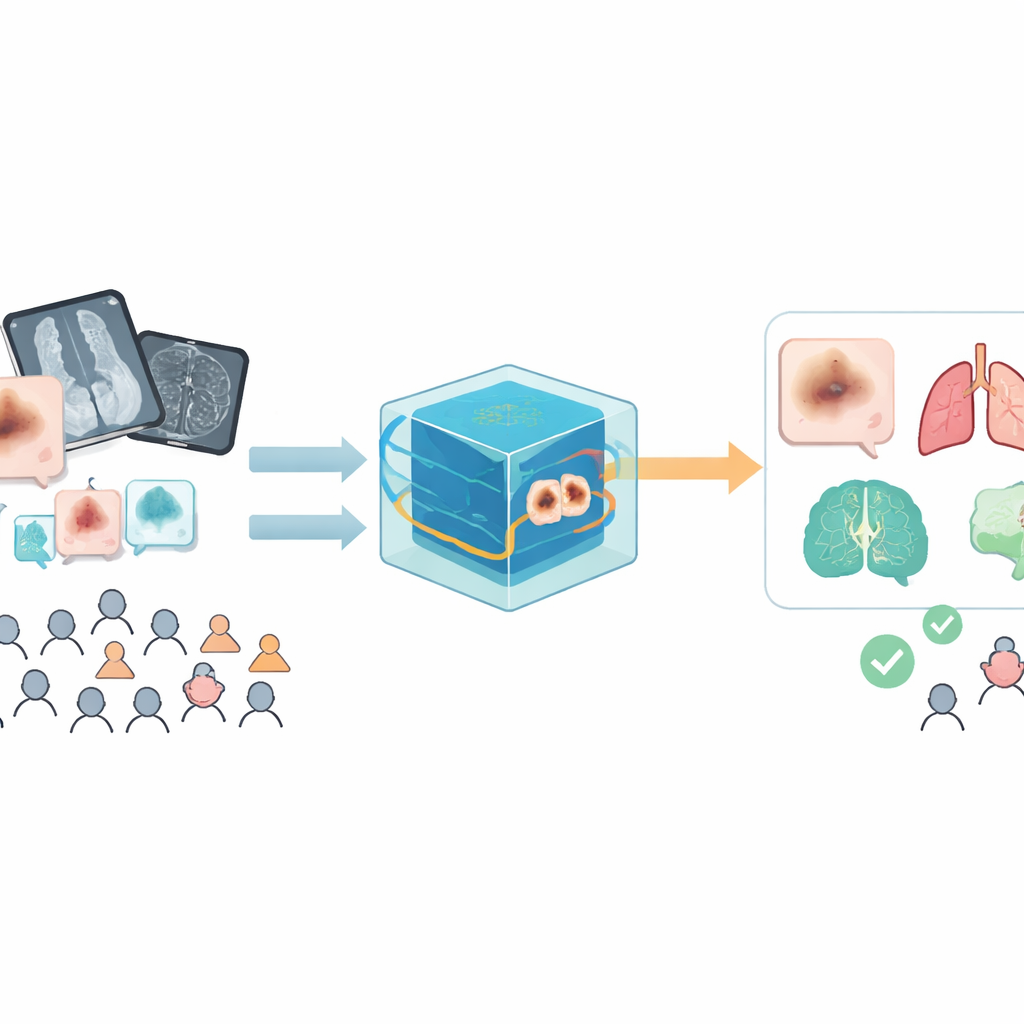

Poziom ponadludzki w różnych chorobach i formatach obrazów

Gdy modele otrzymały zarówno obrazy, jak i tekst, wszystkie trzy systemy wyraźnie przewyższyły globalną pulę lekarzy. Claude 3.7 i GPT‑4o osiągnęły każde około 89–90% trafności, w porównaniu do 46,7% dla większościowego głosu ludzkich respondentów — różnica ponad 40 punktów procentowych. Nawet w najtrudniejszych przypadkach, gdzie mniej niż 40% lekarzy miało rację, Claude 3.7 poprawnie rozpoznał 86,5% diagnoz. Przewaga utrzymywała się w większości typów chorób i formatów obrazów: modele były szczególnie mocne w schorzeniach związanych z lekami i chorobach genetycznych, a radziły sobie nie tylko ze zdjęciami i zdjęciami rentgenowskimi, lecz także z obrazami endoskopowymi, patologicznymi i mieszanymi zestawami obrazów. Wyniki były równie dobre dla mężczyzn i kobiet, a w niektórych najbardziej wrażliwych grupach, takich jak niemowlęta poniżej roku życia, modele były dramatycznie dokładniejsze niż lekarze.

Inne sposoby myślenia, nie tylko szybsze

Być może najdziwniejsze było to, jak często modele osiągały sukces tam, gdzie lekarze zawodzili. W niemal połowie przypadków Claude 3.7 był poprawny, podczas gdy większość lekarzy się myliła, a odwrotna sytuacja — lekarze poprawni, model błędny — zdarzała się rzadko. Ogólnie dla Claude 3.7 było około piętnastu przypadków „przewagi modelu” na każdy jeden przypadek „przewagi lekarza”. Mimo to zgodność między ludźmi a AI co do wyboru odpowiedzi była niska, co świadczy, że systemy nie po prostu powielają ludzkie wzorce, lecz dochodzą do prawidłowych diagnoz innymi drogami. Dodanie tekstu klinicznego zwykle bardzo pomagało, zwiększając trafność AI o 28–42 punkty procentowe w porównaniu z samymi obrazami. Nadal jednak w niewielkiej części przypadków dodatkowe szczegóły spowodowały, że modele z poprawnej odpowiedzi opartej na obrazie przeszły na błędną, co wskazuje na nowe rodzaje uprzedzeń i trybów awarii, które będą wymagać uważnego badania.

Co to może oznaczać dla przyszłej opieki

Autorzy wnioskują, że wielomodalne duże modele językowe osiągnęły na tym wymagającym quizie diagnostycznym poziom „ponadludzki”: są bardziej dokładne niż przeciętna grupa lekarzy i utrzymują przewagę nawet wtedy, gdy przypadki zaskakują większość lekarzy. Jednocześnie ich niska zgodność z wyborami ludzkimi sugeruje, że myślą w sposób komplementarny, a nie jako cyfrowe kopie klinicystów. Użyte mądrze, systemy te mogłyby służyć jako potężni „drudzy czytacze”, oferując niezależne opinie w trudnych lub rzadkich przypadkach i pomagając wychwycić problemy, które mogli przeoczyć ludzie. Nie są gotowe, by zastąpić osąd kliniczny, ale mogą wkrótce stać się wartościowymi partnerami przy łóżku pacjenta i w gabinecie obrazowania, cicho sprawdzając naszą pracę i rozszerzając siatkę bezpieczeństwa dla pacjentów.

Cytowanie: Sheng, C., Shen, S., Wang, L. et al. Multimodal large language models challenge NEJM image challenge. Sci Rep 16, 8132 (2026). https://doi.org/10.1038/s41598-026-39201-3

Słowa kluczowe: diagnoza medyczna, sztuczna inteligencja, obrazowanie medyczne, choroby rzadkie, wsparcie decyzji klinicznych