Clear Sky Science · pl

Metoda tworzenia map satelitarnych obiektów geograficznych na podstawie danych wektorowych przy użyciu uczenia głębokiego

Dlaczego zmiana tego, co pokazują mapy, ma znaczenie

Mapy internetowe często sprawiają wrażenie okien na rzeczywisty świat, ale to, co widzisz z lotu ptaka, jest starannie zaprojektowane. Mapy oparte na obrazach satelitarnych cenione są, ponieważ wyglądają jak prawdziwe miejsca, jednak czasami trzeba ukryć obiekty wrażliwe, oczyścić zatłoczone sceny lub upewnić się, że różne rodzaje map są ze sobą zgodne. W artykule przedstawiono nowy sposób automatycznej „edycji” obrazów satelitarnych za pomocą sztucznej inteligencji, dzięki któremu budynki i drogi można usuwać, dodawać, przesuwać lub zmieniać ich kształt, a jednocześnie obraz pozostaje naturalny i przekonujący.

Od prostych rysunków do realistycznych widoków

Nowoczesne systemy mapowe zwykle przechowują dwa rodzaje danych geograficznych. Pierwszy to sam obraz satelitarny — gęsta mozaika pikseli. Drugi to mapa wektorowa, czystszy rysunek złożony z linii i kształtów oznaczających drogi, budynki, rzeki i inne elementy. Edycja mapy wektorowej jest stosunkowo prosta, ale ręczna zmiana odpowiadającego jej obrazu satelitarnego jest powolna i pracochłonna, ponieważ piksele budynków mieszają się z cieniami, drzewami i pobliskimi budowlami. Kluczowy pomysł autorów polega na nauczeniu modelu uczenia głębokiego tłumaczenia tych wektorowych rysunków na realistyczne obrazy satelitarne. Gdy model pozna to powiązanie, każda zmiana w mapie wektorowej może być automatycznie przekształcona w odpowiadającą zmianę w widoku satelitarnym.

Nauczanie AI wyobrażania sobie miast

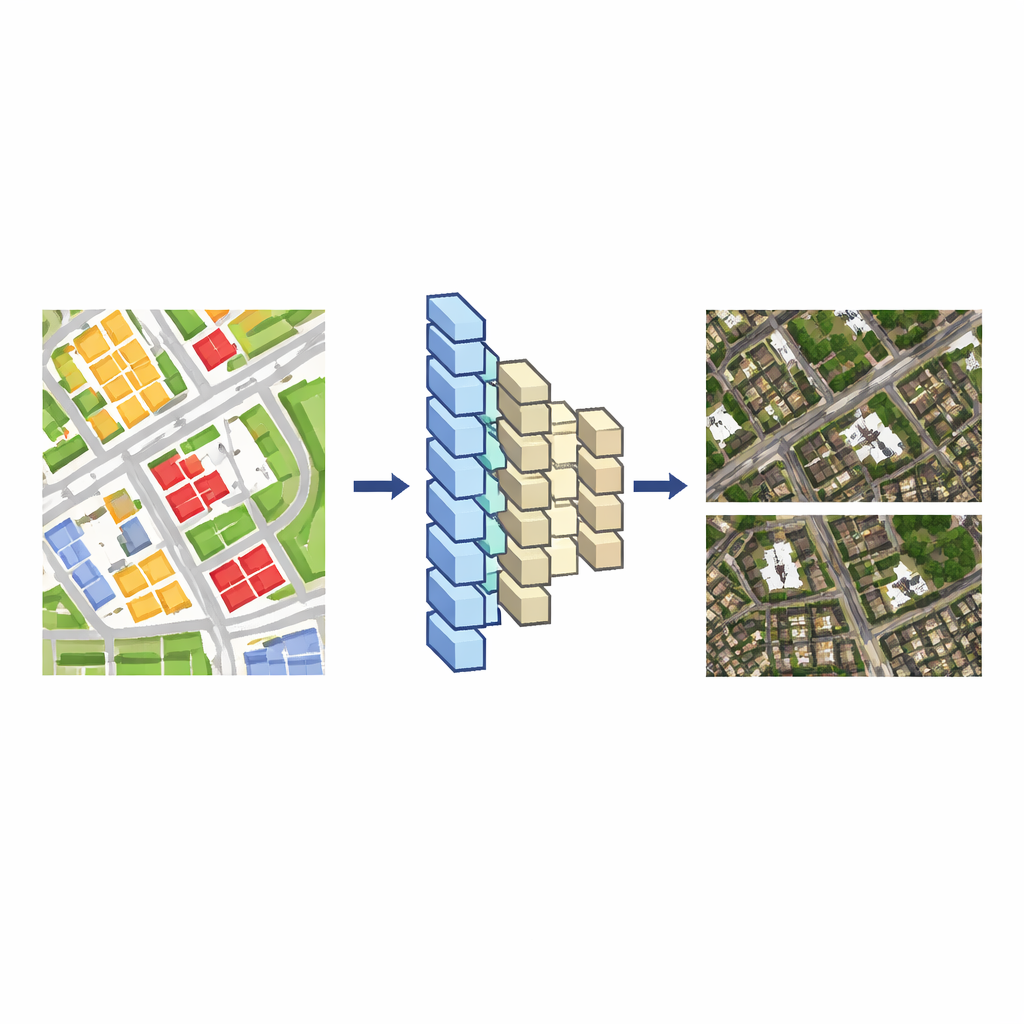

Aby zbudować ten translator, naukowcy zaczynają od obszarów, gdzie mapa wektorowa i obraz satelitarny obejmują ten sam region w podobnej skali. Dzielą oba na wiele małych płytek, łącząc każdą płytkę wektorową z odpowiadającą jej płytką obrazu, i używają tych par jako danych treningowych. Sieć neuronowa z enkoderem i dekoderem — podobna do narzędzi używanych do tłumaczeń obraz–na–obraz — uczy się, jak układ kolorowych pól i linii w płytce wektorowej odnosi się do dachów, ulic i roślinności na płytce satelitarnej. Porównują dwa popularne projekty sieci, UNet++ i Pix2Pix, i stwierdzają, że Pix2Pix generuje obrazy przypominające satelitarne, które bliżej odpowiadają rzeczywistości i trenuje się stabilniej, dlatego staje się ich modelem bazowym.

Skupianie modelu na miejscach do zmiany

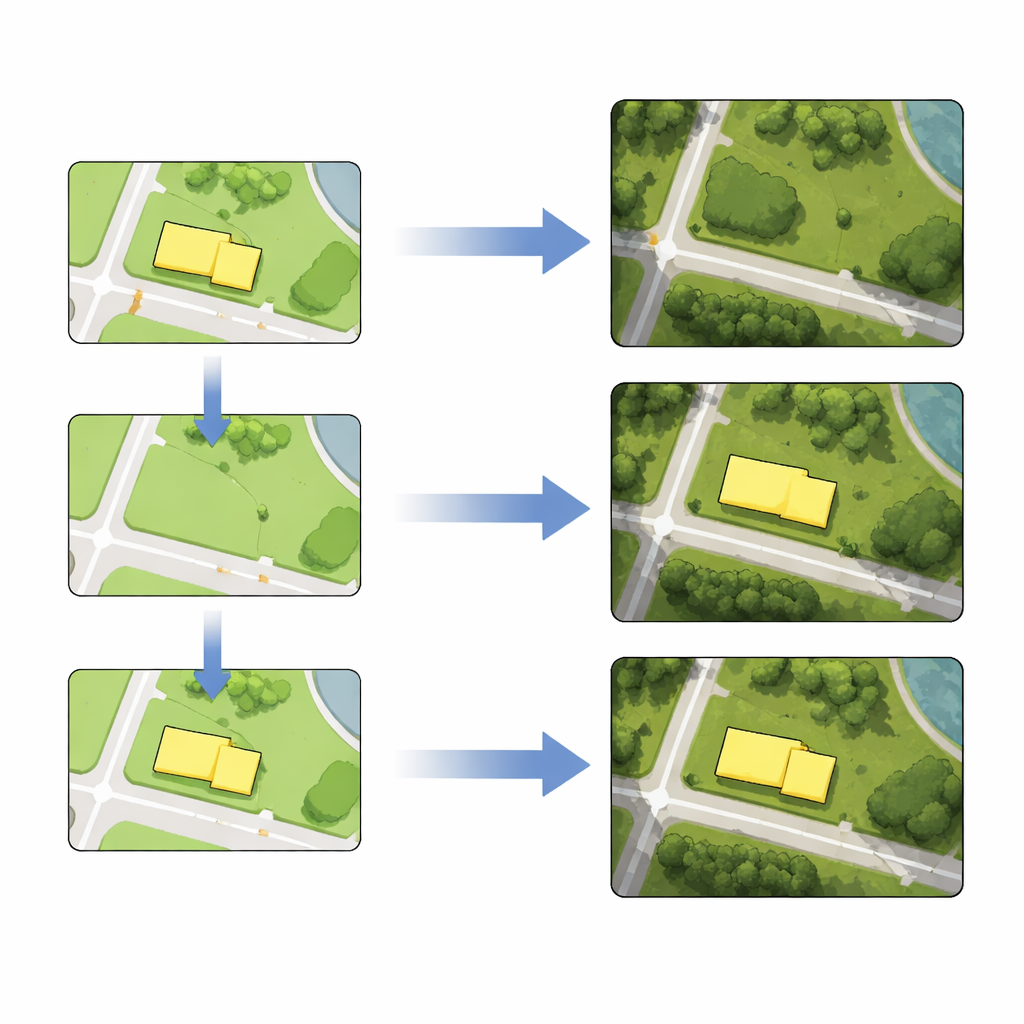

Samodzielne uczenie się z całego miasta nie wystarcza, gdy chce się precyzyjnie poprawiać konkretne obiekty. Aby wyostrzyć umiejętności modelu wokół docelowych obszarów, autorzy stosują transfer learning. Wyodrębniają dodatkowe płytki treningowe obejmujące budynki lub drogi, które planują edytować, i przeprowadzają krótką dodatkową fazę treningu używając wyłącznie tych lokalnych przykładów. Ten krok dopasowania znacząco poprawia, jak dobrze model odtwarza te sąsiedztwa, sprawiając, że późniejsze edycje wyglądają ostrzej i bardziej precyzyjnie.

Edycja budynków i dróg jak warstwy mapy

Z dostrojonym modelem kompilowanie map satelitarnych staje się przepisem w trzech krokach. Po pierwsze, kartograf edytuje mapę wektorową: usuwa budynek, rysuje nową drogę, zmienia kształt bloku albo przesuwa obiekt w nowe miejsce. Po drugie, edytowane płytki z mapy wektorowej są podawane do wytrenowanej sieci, która generuje nowe płytki satelitarne odzwierciedlające zamierzoną zmianę, zachowując jednocześnie otaczające detale i tekstury. Po trzecie, wygenerowane płytki zastępują oryginalne płytki obrazu. Na prawdziwych danych z Berlina autorzy demonstrują wszystkie cztery operacje — usuwanie, wstawianie, zniekształcanie i przemieszczenie — zarówno dla zarysu budynków, jak i linii dróg, pojedynczo lub seryjnie. Pomiary pokazują, że pozycje edytowanych obiektów na wygenerowanych obrazach różnią się od ich odpowiedników wektorowych jedynie o kilka pikseli, co jest dokładnością akceptowalną w wielu zadaniach kartograficznych.

Co to oznacza dla przyszłości map

Mówiąc prosto, badanie pokazuje, że gdy AI nauczy się, jak mapy wektorowe i obrazy satelitarne się pokrywają, możesz edytować prosty rysunek i pozwolić modelowi przemalować wiarygodny widok z lotu ptaka, aby do niego pasował. Otwiera to drogę do map satelitarnych, które można dostosowywać: ukrywania obiektów wrażliwych, wyjaśniania złożonych scen czy łączenia przestrzeni rzeczywistych i wyobrażonych, takich jak światy gry czy środowiska wirtualne. Jednocześnie podkreśla to siłę — i ryzyko — „deepfake’owej” geografii, gdzie realistycznie wyglądające obrazy z powietrza mogą już nie być prostymi fotografiami świata takim, jaki jest.

Cytowanie: Du, J., Zeng, D., Cai, K. et al. A method for compiling satellite image map geographic objects based on vector map data via deep learning. Sci Rep 16, 9295 (2026). https://doi.org/10.1038/s41598-026-39096-0

Słowa kluczowe: obrazy satelitarne, uczenie głębokie, edycja map, teledetekcja, kartografia deepfake