Clear Sky Science · pl

Optymalizacja energii w sieciach zasilanych bezprzewodowo wspomagana DQN

Zasilanie maleńkich urządzeń przez powietrze

Od inteligentnych latarni ulicznych po ukryte w lasach czujniki przeciwpożarowe — niezliczone drobne urządzenia tworzą dziś Internet Rzeczy. Zapewnienie im energii to poważny problem: baterie się wyczerpują, a prowadzenie kabli zasilających wszędzie jest niepraktyczne. W artykule zbadano sposób nadawania energii bezprzewodowo do takich urządzeń oraz wykorzystania sztucznej inteligencji do jej mądrego rozdzielania, tak aby krytyczne czujniki działały dłużej, a cała sieć funkcjonowała bardziej płynnie.

Dlaczego bezprzewodowe zasilanie wymaga inteligentniejszej kontroli

Sieci komunikacyjne zasilane bezprzewodowo emitują fale radiowe, które urządzenia mogą przekształcać w energię elektryczną, jednocześnie używając ich do przesyłania danych. W większości wcześniejszych badań konwersję energii traktowano jak liniowy proces: silniejszy sygnał dawał proporcjonalnie więcej mocy. W rzeczywistości obwody pozyskujące energię zaczynają się „zapłaszczać” przy silnym sygnale i część mocy jest tracona. Równocześnie środowisko jest chaotyczne: nasłonecznienie dla paneli słonecznych może szybko się zmieniać, budynki tłumią sygnały, a nagłe zdarzenia, np. pożary, mogą powodować pilne potrzeby przesyłu danych na niektórych węzłach. Statyczne reguły ignorujące te zmiany mogą pozostawiać niektóre czujniki bez energii i prowadzić do marnotrawstwa w innych, skracając łączny czas pracy sieci.

Mózg uczący się dla sieci energetycznej

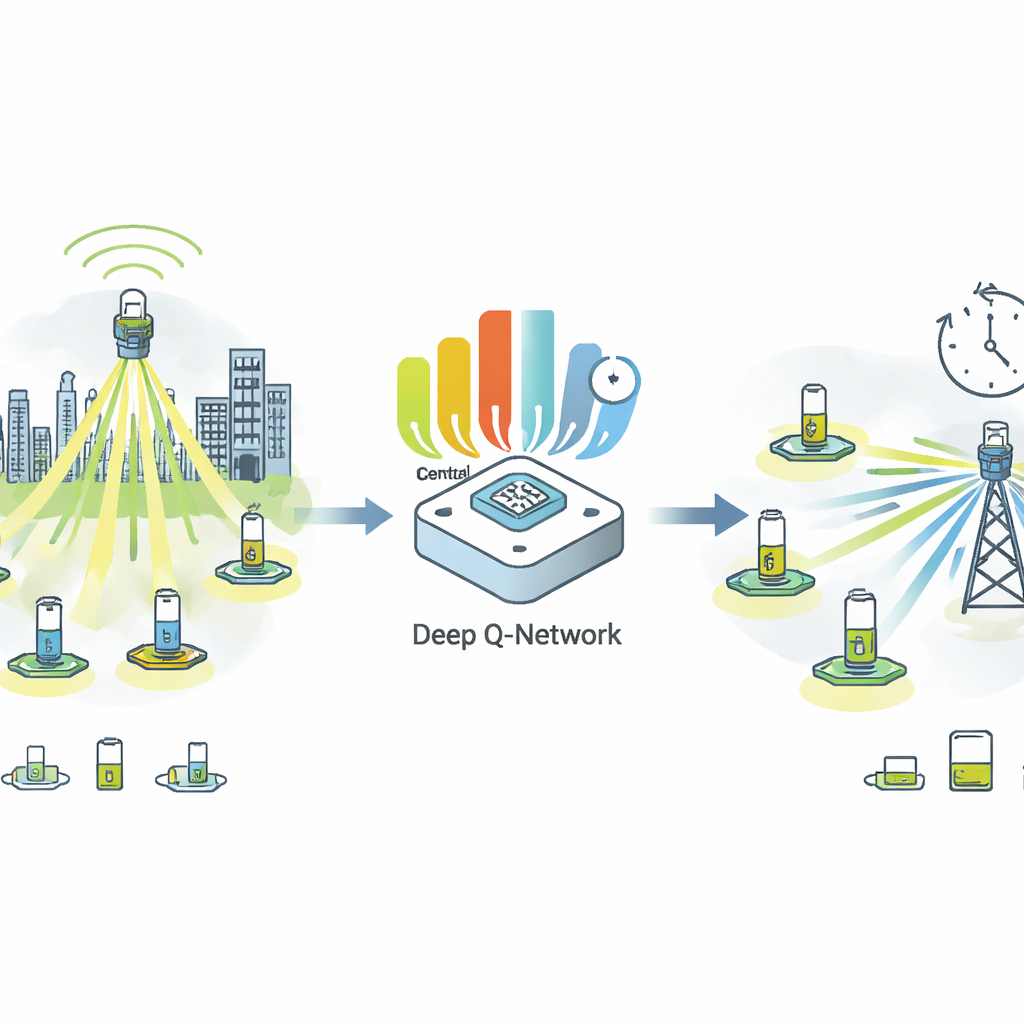

Aby temu zaradzić, autorzy opracowali kontroler oparty na uczeniu, wykorzystujący technikę zwaną Deep Q-Networks, formę uczenia przez wzmacnianie. Zamiast polegać na ustalonych formułach matematycznych, kontroler traktuje sieć jako grę rozgrywaną w czasie. W każdej rundzie obserwuje pozostałą energię w poszczególnych węzłach, jakość łączy radiowych oraz pilność zadań — na przykład monitorowanie pożarów versus rutynowe pomiary temperatury. Na podstawie tych obserwacji decyduje, ile mocy przesłać do każdego węzła. Po każdej decyzji otrzymuje informację zwrotną, która łączy kilka celów: przesyłanie jak największej ilości użytecznych danych, sprawiedliwy podział energii tak, by żadne urządzenie nie było systematycznie pomijane, oraz unikanie marnotrawstwa wspólnego źródła zasilania. W kolejnych rundach kontroler uczy się, które wzorce dzielenia energii prowadzą do najlepszej długoterminowej wydajności.

Widzieć wprzód i równoważyć sprzeczne cele

Jednym z kluczowych elementów frameworku jest przewidywanie. System wykorzystuje metodę statystyczną nazwaną regresją procesu Gaussa do prognozowania, ile energii węzły prawdopodobnie pozyskają w najbliższej przyszłości, na przykład gdy zmieniają się warunki nasłonecznienia. Używa też elastycznego modelu zaniku i odbić sygnału radiowego w realistycznych, miejskich środowiskach. Te składniki zasilają proces decyzyjny aktualizowany co kilka sekund, co pozwala kontrolerowi szybko reagować na zmiany warunków sieci. Sygnał nagrody kierujący uczeniem łączy trzy proste idee: efektywność (ile bitów informacji dostarczane jest na jednostkę energii), sprawiedliwość (jak równomiernie energia jest rozdzielana między węzły) oraz priorytet (zapewnienie, że zadania o wysokiej pilności otrzymują to, czego potrzebują). Poprzez dostrojenie względnego znaczenia tych trzech składników operatorzy sieci mogą wybierać między maksymalnym czasem działania, ścisłą sprawiedliwością lub maksymalną przepustowością danych.

Co pokazują symulacje

Ponieważ eksperymenty w świecie rzeczywistym są wciąż w toku, autorzy ocenili swoją metodę w szczegółowych symulacjach komputerowych sieci z 30 bezprzewodowo zasilanymi urządzeniami, badając też scenariusze aż do 100 węzłów. W porównaniu z prostym stałym podziałem energii i bardziej tradycyjną metodą uczenia, nowy kontroler utrzymuje sieć przy życiu znacznie dłużej — około połowę więcej rund zanim węzły się wyłączą. Utrzymuje też znacznie mniejsze rozrzuty poziomów energii między urządzeniami, co oznacza znacznie mniej „martwych punktów”, gdzie węzły zawodzą wcześniej. Wyuczona strategia adaptuje się kilkukrotnie szybciej do nagłych zmian, takich jak spadek jakości sygnału czy wzrost pilności zadań, i utrzymuje wyższą przepustowość danych w szerokim zakresie warunków radiowych. Co ważne, autorzy uwzględnili praktyczne detale, pokazując, że skompaktowana wersja modelu uczącego może działać na tanich mikrokontrolerach używanych w wielu urządzeniach IoT, z czasami podejmowania decyzji rzędu dziesiątek milisekund.

Od symulacji do rzeczywistych sieci czujników

Badanie konkluduje, że połączenie zasilania bezprzewodowego z kontrolerem opartym na uczeniu może znacząco wydłużyć żywotność i niezawodność sieci czujników, szczególnie gdy warunki są nieprzewidywalne, a zadania różnią się pilnością. Uznając, że obwody pozyskujące energię saturują się, że środowisko radiowe się zmienia i że niektóre czujniki są w danym momencie ważniejsze od innych, proponowane podejście uczy się lepiej żonglować sprzecznymi potrzebami niż reguły statyczne. Autorzy jasno zaznaczają, że ich wyniki pochodzą na razie z symulacji i że dokładne korzyści trzeba potwierdzić na rzeczywistym sprzęcie. Mimo to ich praca wskazuje na przyszłość, w której rozległe sieci małych urządzeń mogą działać przez długi czas przy minimalnej interwencji człowieka, inteligentnie czerpiąc energię z powietrza i utrzymując przepływ istotnych danych.

Cytowanie: Chen, H., Wang, X., Yuan, L. et al. DQN-empowered energy optimization for wireless powered communication networks. Sci Rep 16, 7987 (2026). https://doi.org/10.1038/s41598-026-38904-x

Słowa kluczowe: bezprzewodowa energia, Internet rzeczy, pozyskiwanie energii, uczenie przez wzmacnianie, sieci czujników