Clear Sky Science · pl

Badanie interakcji nauczyciel–uczeń za pomocą multimodalnych modeli językowych: badanie empiryczne

Dlaczego obserwowanie klas za pomocą AI ma znaczenie

Każdy, kto siedział w sali lekcyjnej, wie, że sposób, w jaki nauczyciele i uczniowie wchodzą ze sobą w interakcje, może przesądzać o nudzie lub prawdziwym uczeniu się. Tymczasem badanie tych chwilowych wymian jest zaskakująco trudne: obserwatorzy męczą się, oceny ludzkie różnią się między sobą, a dane wideo szybko stają się przytłaczające. Artykuł ten pokazuje, w jaki sposób nowy rodzaj sztucznej inteligencji — multimodalne duże modele językowe, które potrafią „patrzeć” na obrazy i „czytać” tekst — może pomóc badaczom i szkołom szybciej i obiektywniej uporządkować złożone życie klasy.

Przekształcanie prawdziwych lekcji w dane badawcze

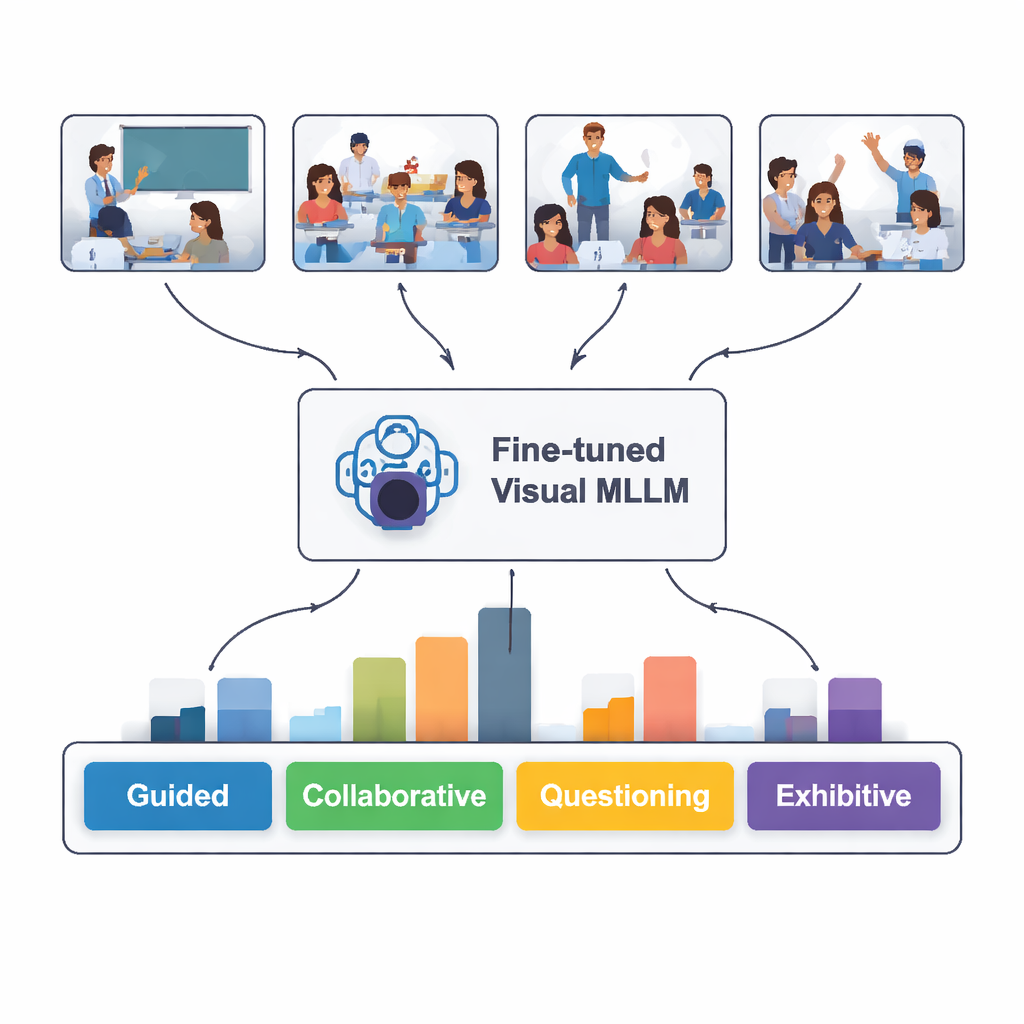

Badacze zaczęli od zwykłych nagrań z lekcji z chińskich szkół podstawowych i ponadpodstawowych, udostępnionych publicznie na krajowej platformie edukacyjnej. Z 30 lekcji wyekstrahowali prawie 2 400 klatek, które uchwyciły kluczowe momenty nauczania i uczenia się. Każde zdjęcie zostało oznaczone według pięciu łatwych do zrozumienia wzorców interakcji: kierowana (nauczyciel wyjaśnia), współpraca (uczniowie pracują razem), pytanie (zadawanie pytań i odpowiadanie), samodzielna (uczniowie pracują sami) oraz prezentacyjna (uczeń przedstawia przed klasą). Eksperci z dziedziny technologii edukacyjnych pomogli dopracować te kategorie, tak aby odpowiadały temu, na co zwracają uwagę doświadczeni obserwatorzy w rzeczywistych klasach.

Nauczanie AI rozpoznawania dynamiki w klasie

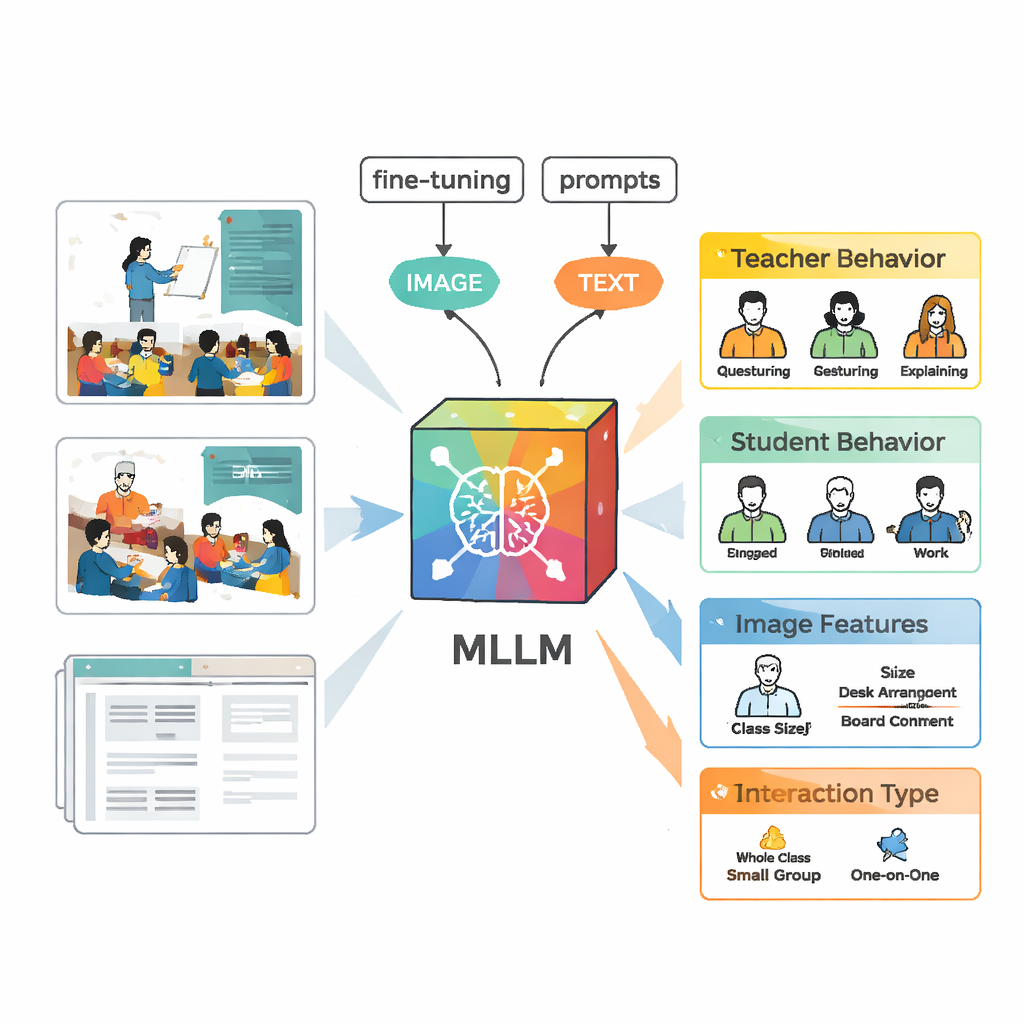

Aby analizować te sceny, zespół użył multimodalnego dużego modelu językowego o nazwie VisualGLM‑6B, który przyjmuje zarówno obrazy, jak i tekst jako dane wejściowe. Ponieważ oryginalny model był trenowany szeroko, a nie konkretnie na materiałach klasowych, badacze „dostroili” go, używając oznaczonych obrazów. Zastosowali technikę zwaną LoRA, która modyfikuje tylko niewielką liczbę wewnętrznych parametrów modelu, co sprawia, że trening jest bardziej wydajny, a jednocześnie skuteczny. Zaprojektowali też staranne promptowanie — ustrukturyzowane instrukcje mówiące modelowi, aby opisywał zachowanie nauczyciela, zachowanie uczniów, cechy wizualne i typ interakcji w spójnym formacie, dzięki czemu wyniki łatwiej porównywać z ocenami ekspertów.

Budowanie lepszych etykiet z udziałem ludzi i maszyn

Utworzenie wysokiej jakości zbioru treningowego wymagało więcej niż tylko pokazania modelowi wideo. Najpierw VisualGLM wygenerował podstawowe opisy każdego obrazu. Następnie ludzcy anotatorzy poprawiali błędy i uzupełniali brakujący kontekst, na przykład kto mówił lub czy uczniowie słuchali, czy dyskutowali. Potem te dopracowane opisy wprowadzono do ChatGPT, który przy pomocy dostosowanych promptów wygenerował ustrukturyzowane analizy zgodne z pięcioma kategoriami interakcji. Eksperci ponownie przejrzeli i edytowali analizy stworzone przez AI. Końcowym efektem był bogaty zbiór danych, w którym każdy obraz zawierał szczegółowy, wiarygodny opis działań nauczycieli i uczniów.

Jak dobrze AI „czytało” klasę?

Testowany na 100 nowych obrazach klas, których wcześniej nie widział, dostrojony model poprawnie rozpoznawał typ interakcji w 82 procentach przypadków. Najlepiej radził sobie z rozpoznawaniem sytuacji kierowanych, samodzielnych i prezentacyjnych — gdy nauczyciel wyraźnie wyjaśnia, uczniowie pracują cicho sami lub uczeń występuje przed klasą. Trudniej było mu z pracą w grupach i sytuacjami pytającymi, gdzie mowa ciała i ustawienie miejsc mogą być niejednoznaczne nawet dla ludzi. Głębsze, oparte na tekście porównanie wykazało, że pisemne opisy modelu często zbliżały się do analiz ekspertów, chociaż od czasu do czasu „halucynował” szczegóły nieobecne na obrazach lub błędnie odczytywał subtelny gest.

Co to oznacza dla przyszłych klas

Dla czytelnika niezwiązanego z tematem kluczowy wniosek jest taki, że systemy AI stają się zdolne do obserwowania klas i streszczania, jak przebiega nauczanie i uczenie się, z poziomem struktury i konsekwencji, którego trudno oczekiwać od ludzi analizujących tysiące scen. Choć nie są doskonałe — szczególnie w przypadku subtelnych form dyskusji i zadawania pytań — podejście to pokazuje, że multimodalne duże modele językowe mogą już wspierać badania edukacyjne, a docelowo także narzędzia feedbacku dla klas. W miarę jak modele te zaczną uwzględniać dźwięk, gesty oraz większe i bardziej zróżnicowane zbiory danych, mogą pomóc nauczycielom dostrzec wzorce w ich praktyce, które wcześniej były ukryte, oferując nową perspektywę na to, jak codzienne interakcje kształtują uczenie się uczniów.

Cytowanie: Chen, G., Han, G., Niu, J. et al. Exploring teacher-student interaction through multimodal large language models: an empirical investigation. Sci Rep 16, 7602 (2026). https://doi.org/10.1038/s41598-026-38626-0

Słowa kluczowe: interakcja nauczyciel–uczeń, analiza zajęć, multimodalna sztuczna inteligencja, technologie edukacyjne, duże modele językowe