Clear Sky Science · pl

Predykcja obciążenia oparta na mechanizmie attention i dynamiczne przydzielanie zasobów dla heterogenicznych środowisk obliczeniowych

Dlaczego inteligentniejsze komputery mają znaczenie dla wszystkich

Za każdym filmem, który oglądasz strumieniowo, mapą, którą otwierasz, czy asystentem AI, z którym rozmawiasz, stoją ogromne magazyny komputerów pracujące w milczeniu przez całą dobę. W miarę jak sztuczna inteligencja staje się coraz potężniejsza, centra danych są eksploatowane do granic możliwości: muszą jednocześnie obsługiwać wiele rodzajów zadań na różnych typach maszyn, przy jednoczesnym kontrolowaniu kosztów, szybkości i zużycia energii. W artykule zaproponowano nowy sposób przewidywania potrzeb tych komputerów w krótkiej perspektywie oraz mechanizm przesuwania zadań między różnymi typami sprzętu, tak aby usługi pozostały szybkie i niezawodne, a marnotrawstwo energii zostało zredukowane.

Wiele zadań, wiele maszyn

Współczesne centra danych nie polegają już na jednym rodzaju serwera. Łączą tradycyjne procesory z potężnymi procesorami graficznymi, dedykowanymi kartami AI i układami programowalnymi. Różne zadania związane z AI — takie jak trenowanie dużych modeli językowych, obsługa rekomendacji w czasie rzeczywistym czy analiza obrazów — różnie pasują do tego sprzętu. Obecnie operatorzy często przydzielają zasoby według stałych reguł lub prostych prognoz opartych na wczorajszych danych. Gdy popyt gwałtownie rośnie, może to prowadzić do opóźnień lub naruszeń umów; gdy spada, drogi sprzęt może stać bezczynnie, zużywając energię przy niewielkiej pracy.

Nauka patrzenia tam, gdzie to ma znaczenie

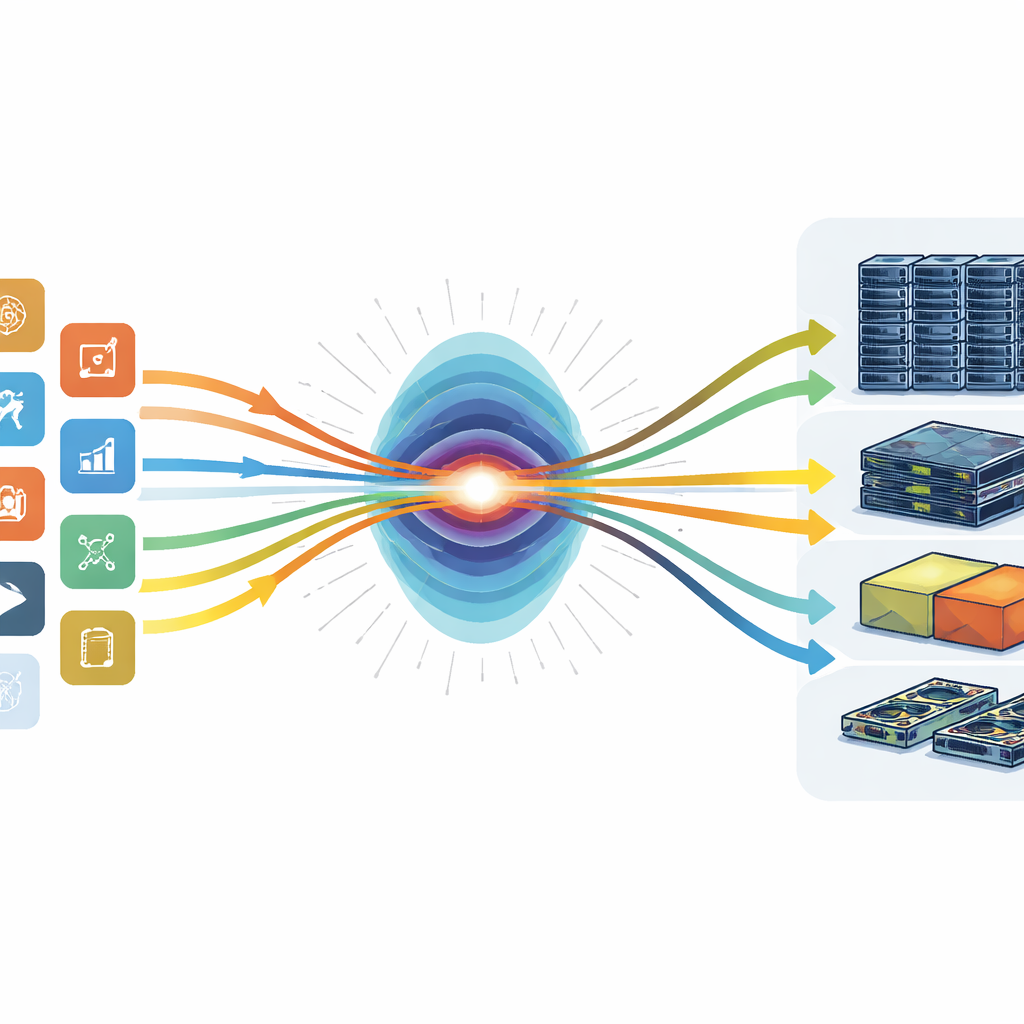

Autorzy zapożyczają pojęcie z nowoczesnych modeli AI zwane „attention” i stosują je w zarządzaniu centrami danych. Zamiast traktować wszystkie dane historyczne jednakowo, ich system uczy się, które momenty w czasie i które rodzaje zadań są najbardziej pomocne przy przewidywaniu tego, co wydarzy się dalej. Jedna część modelu koncentruje się na tym, jak każde obciążenie — na przykład zadanie treningowe czy usługa online — zmienia się w czasie. Inna część patrzy „na boki” wśród różnych obciążeń działających równocześnie, aby odkryć ukryte powiązania, na przykład wzorzec, w którym zakończenie partii zadań treningowych często prowadzi do fali powiązanych zapytań online. Nakładając te dwa spojrzenia, system może dokładniej prognozować przyszłe zapotrzebowanie na procesory, pamięć i akceleratory niż wcześniejsze metody.

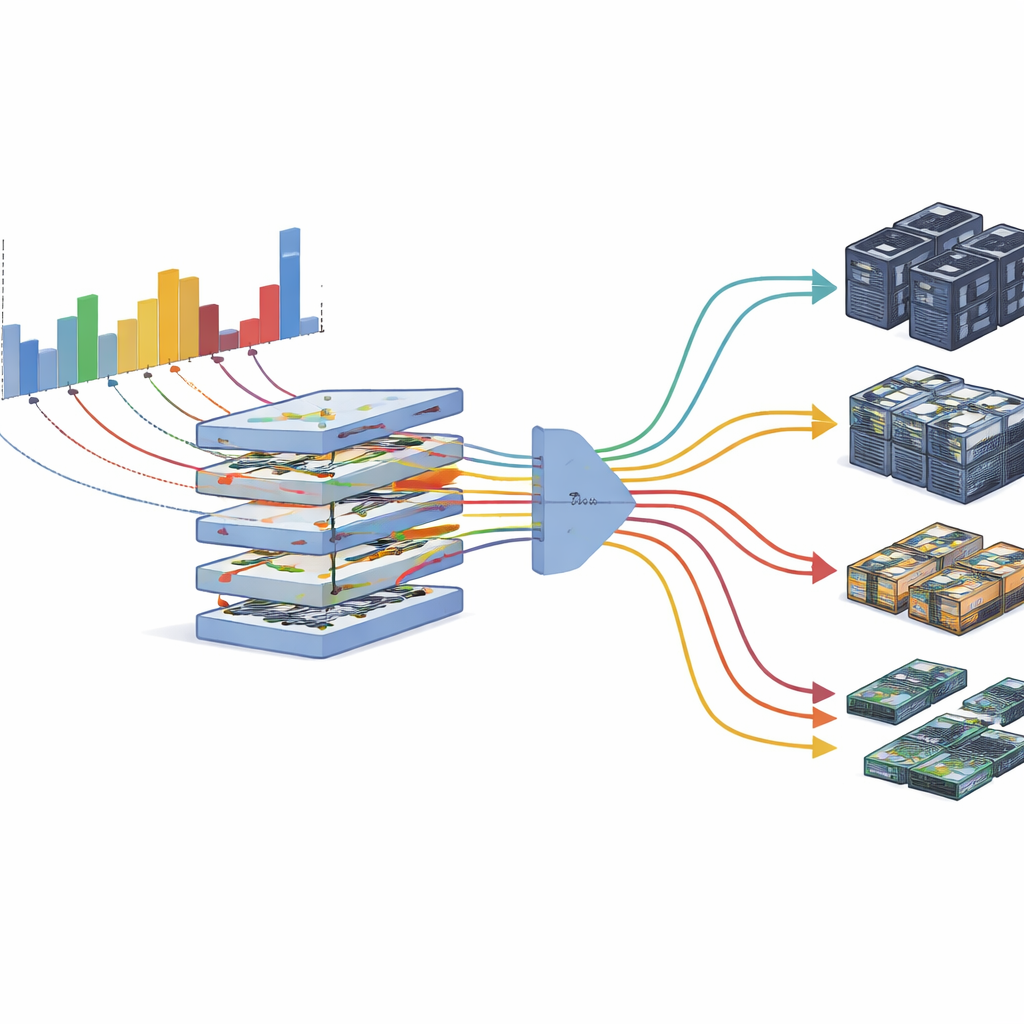

Przekształcanie prognoz w lepsze decyzje

Samo przewidywanie nie wystarcza; centrum danych musi na nie reagować. Druga część ram przekształca te prognozy w konkretne decyzje dotyczące miejsca uruchomienia każdego zadania. Autorzy traktują to jako balansowanie między trzema celami: szybkim wykonywaniem zadań, minimalnym zużyciem energii i utrzymaniem maszyn w pracy zamiast bezczynności. Ich harmonogram traktuje centrum danych jako sieć różnych urządzeń i wykorzystuje procedurę optymalizacyjną do wyboru rozmieszczeń, które godzą te cele zgodnie z preferencjami operatora. Ponieważ prognozy nigdy nie są idealne, system także szacuje swoją niepewność i pozostawia marginesy bezpieczeństwa w razie potrzeby, a następnie monitoruje rzeczywistość w czasie rzeczywistym, dostosowując działanie przez wstrzymywanie zadań o niskim priorytecie lub przenoszenie zadań, gdy wykorzystanie odbiega od oczekiwań.

Testy systemu

Aby sprawdzić, jak podejście działa w praktyce, badacze zbudowali klaster testowy z realistycznym zestawem procesorów, GPU i specjalistycznego sprzętu AI oraz zasilili go szczegółowymi zapisami aktywności z rzeczywistych centrów danych w Google, Alibaba i laboratorium akademickim. Porównali swoją metodę z popularnymi narzędziami prognostycznymi i strategiami harmonogramowania, w tym z technikami stosowanymi w systemach produkcyjnych oraz sterownikami opartymi na uczeniu przez wzmacnianie. Predyktor oparty na mechanizmie attention konsekwentnie dawał dokładniejsze prognozy, szczególnie przy gwałtownych skokach, które często występują w obciążeniach AI. W połączeniu z dynamicznym alokatorem system podniósł ogólne wykorzystanie sprzętu do około czterech piątych pojemności, skrócił średni czas realizacji zadań o około jedną czwartą i obniżył zużycie energii o około 15 procent, przy jednoczesnym utrzymaniu bardzo niskiego poziomu naruszeń usług.

Co to oznacza dla zwykłych użytkowników

Dla osób niezajmujących się specjalistycznie tematem, najważniejszy wniosek jest taki, że inteligentniejsza koordynacja wewnątrz centrów danych może uczynić usługi AI szybszymi, tańszymi i bardziej ekologicznymi bez konieczności budowy nowych układów czy budynków. Ucząc się, gdzie „skoncentrować uwagę” w natłoku danych o wykorzystaniu, te ramy pomagają istniejącemu sprzętowi wykonywać więcej użytecznej pracy i rzadziej pozostawać bezczynne. Oznacza to, że firmy mogą dostarczać bardziej responsywne aplikacje i potężniejsze narzędzia AI przy jednoczesnym ograniczaniu rachunków za prąd i śladu węglowego. W miarę rozprzestrzeniania się i dojrzewania podobnych systemów predykcji i alokacji, niewidoczna maszyna internetu może stać się nie tylko bardziej zdolna, lecz także bardziej zrównoważona.

Cytowanie: Shao, S., Ding, X., Zhao, B. et al. Attention-based workload prediction and dynamic resource allocation for heterogeneous computing environments. Sci Rep 16, 8571 (2026). https://doi.org/10.1038/s41598-026-38622-4

Słowa kluczowe: harmonogramowanie w centrach danych, predykcja obciążeń AI, heterogeniczne przetwarzanie, energooszczędne przetwarzanie, przydział zasobów