Clear Sky Science · pl

Mocniejsze audyty prywatności DP-SGD w modelu zagrożenia z ukrytym stanem

Dlaczego to ma znaczenie dla codziennej technologii

Współczesne aplikacje nieustannie uczą się na naszych danych — od zdjęć i wiadomości po dokumentację medyczną. Jednym z wiodących sposobów, by zabezpieczyć to uczenie, jest prywatność różnicowa, która dodaje starannie dobrany szum, tak aby dane pojedynczej osoby nie wyróżniały się. Ale skąd mamy pewność, że te zabezpieczenia działają w praktyce, zwłaszcza dla współczesnych głębokich sieci neuronowych? Artykuł bada to pytanie i pokazuje, kiedy ukrycie „filmu z treningu” modelu rzeczywiście pomaga zachować prywatność — a kiedy nie.

Jak ma działać prywatne uczenie

Differentially private stochastic gradient descent (DP-SGD) to podstawowy algorytm w prywatnym uczeniu maszynowym. Trenuje modele krok po kroku na małych partiach danych, obcina gradienty w każdym kroku (kierunek poprawy) i dodaje losowy szum przed aktualizacją modelu. Teoria dostarcza górnych ograniczeń tego, jak bardzo dane pojedynczej osoby mogą wpłynąć na model końcowy, podsumowywanych przez miarę prywatności często nazywaną epsilona. Równolegle „audyty prywatności” starają się zaatakować wytrenowany model i zobaczyć, ile informacji da się w praktyce wydobyć. Jeśli teoria i audyt się zgadzają, można ufać rozliczaniu prywatności; jeśli nie, coś istotnego pozostaje poza kontrolą.

Co się zmienia, gdy ujawniany jest tylko model końcowy

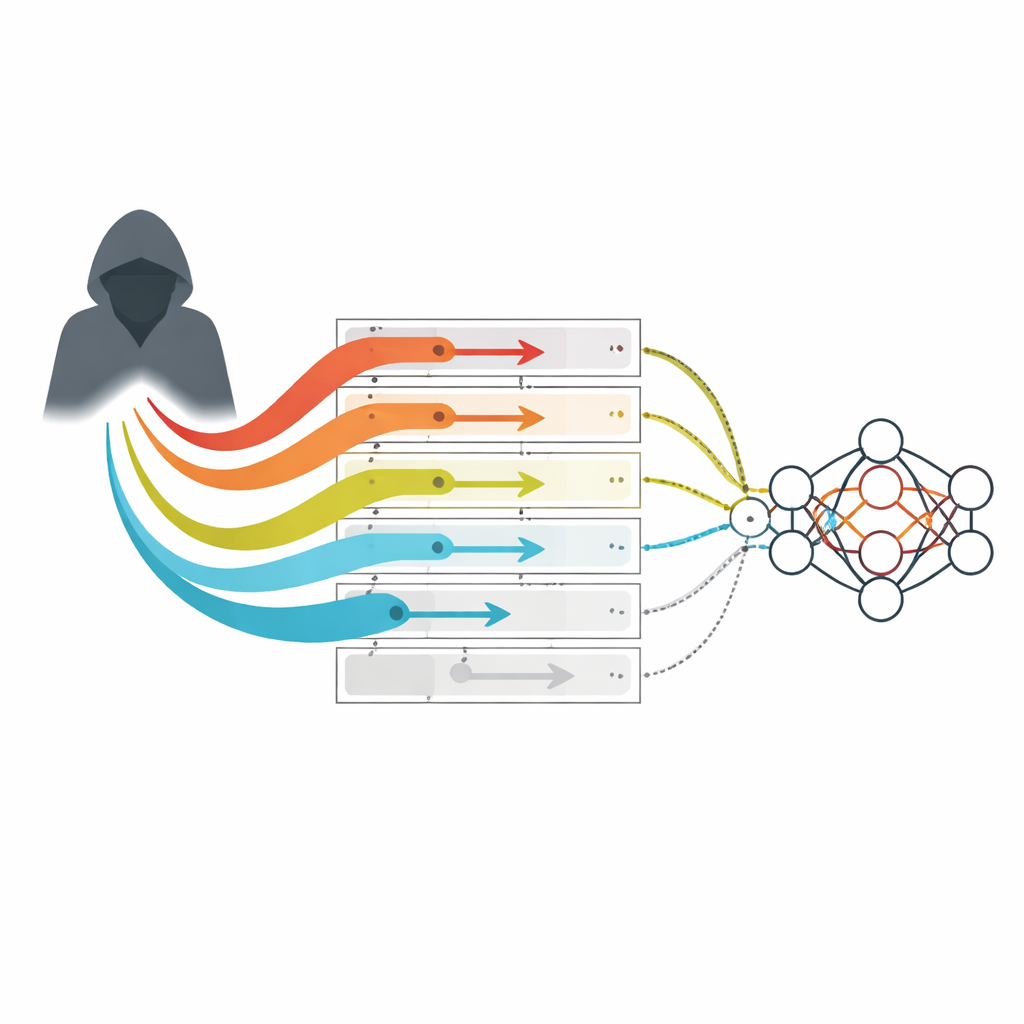

Większość wcześniejszych audytów zakładała potężnego przeciwnika, który widzi każde pośrednie checkpointy modelu w trakcie treningu. W rzeczywistości wiele organizacji udostępnia tylko model końcowy, a nie pełną historię treningu. To bardziej realistyczne ustawienie nazywa się modelem zagrożenia z ukrytym stanem. Niedawne prace teoretyczne sugerowały, że przynajmniej dla prostych problemów wypukłych ukrycie modeli pośrednich może z czasem wzmacniać prywatność: dane użyte wcześnie w treningu są „zmywane” przez późniejsze, zaszumione aktualizacje. Jednak współczesne uczenie głębokie opiera się na silnie nie-wypukłych modelach, gdzie powierzchnia straty jest szorstka i złożona. Nie było jasne, czy to samo wzmocnienie zachodzi tam naprawdę — czy też istniejące ataki po prostu były zbyt słabe, by ujawnić pełną utratę prywatności.

Nowy sposób, w jaki przeciwnicy wpływają na model

Autor wprowadza nową rodzinę przeciwników „tworzących gradienty” dostosowanych do modelu z ukrytym stanem. Zamiast próbować zaprojektować specjalny punkt danych i potem obserwować, jak zmienia się jego strata podczas treningu (jak w tradycyjnych atakach opartych na stratach), ci przeciwnicy bezpośrednio narzucają sekwencję gradientów, które zostałyby zastosowane, gdyby obecny był punkt danych w najgorszym przypadku. Wybierają gradienty, które zawsze osiągają próg obcięcia i ustawiają się w zgodzie z rzadko używanymi kierunkami parametrów, co ułatwia wykrycie ich wpływu nawet bez dostępu do modeli pośrednich. Badane są dwie proste warianty: jeden losowo wybiera kierunek parametru, a drugi symuluje proces treningu, aby znaleźć najmniej aktualizowany kierunek, po czym wstrzykuje silne, powtarzane gradienty wzdłuż tego kierunku.

Co eksperymenty ujawniają o rzeczywistym ryzyku prywatności

Wykorzystując to podejście, artykuł audytuje DP-SGD na zestawach obrazów i danych tabelarycznych z powszechnymi architekturami, takimi jak sieci konwolucyjne i resztkowe, a także mały model w pełni połączony. Gdy skonstruowany gradient jest stosowany w każdym kroku treningu, nowi przeciwnicy osiągają rygorystyczne teoretyczne granice prywatności — mimo że widzą tylko model końcowy. Oznacza to, że w tym ekstremalnym przypadku ukrycie checkpointów pośrednich nie daje żadnej dodatkowej prywatności. Gdy skonstruowany gradient wstrzykiwany jest rzadziej, obraz się zmienia: dla dużych partii danych w porównaniu z poziomem szumu audyty pozostają bliskie teorii (co sugeruje niewielkie wzmocnienie), ale dla mniejszych partii i wyższego poziomu szumu pojawia się luka wskazująca na rzeczywiste, choć umiarkowane, wzmocnienie prywatności w ustawieniach nie-wypukłych.

Zajrzeć w granicę najgorszego przypadku

Aby zrozumieć absolutne granice prywatności w modelu z ukrytym stanem, artykuł bada również bardziej ekstremalnego teoretycznego przeciwnika, który nie tylko tworzy gradienty, ale także projektuje całą krajobraz straty, aby utrzymać wpływ specjalnego punktu danych przez kolejne iteracje. W tym kontrolowanym ustawieniu wyniki wyraźnie rozdzielają dwa reżimy: przy dużych rozmiarach partii rozliczanie prywatności oparte na standardowej teorii jest praktycznie ciasne, ale przy małych partiach i znaczącym szumie wczesna informacja o punkcie danych jest częściowo zapominana z czasem. Co istotne, to wzmocnienie jest słabsze niż to znane dla prostych problemów wypukłych i nigdy całkowicie nie eliminuje ryzyka prywatności.

Co to oznacza dla użytkowników i praktyków

Dla osób niebędących ekspertami wnioskiem jest to, że samo ukrycie historii treningu modelu głębokiego nie gwarantuje magicznie znacznie silniejszej prywatności. Gdy dane danej osoby są używane bardzo często podczas treningu, jej ryzyko jest zbliżone do tego, co przewiduje dziś konserwatywna teoria. Pewna dodatkowa ochrona pojawia się w korzystniejszych reżimach — małe partie z istotnym szumem — ale jest umiarkowana i nie redukuje ryzyka do zera. Te ustalenia zarówno potwierdzają części istniejącego rozliczania prywatności, jak i uwypuklają jego ograniczenia, dając jaśniejszy, bardziej realistyczny obraz tego, ile ochrony może zapewnić DP-SGD, gdy udostępniany jest tylko model końcowy.

Cytowanie: Bhuekar, A. Tighter privacy auditing of differentially private stochastic gradient descent in the hidden state threat model. Sci Rep 16, 8365 (2026). https://doi.org/10.1038/s41598-026-38537-0

Słowa kluczowe: prywatność różnicowa, DP-SGD, audyty prywatności, bezpieczeństwo uczenia maszynowego, model ukrytego stanu