Clear Sky Science · pl

Wielopoziomowy DeepLab V3+ z EfficientNetB0 do segmentacji narządów przewodu pokarmowego na skanach MRI

Dokładniejsze celowanie w guzy

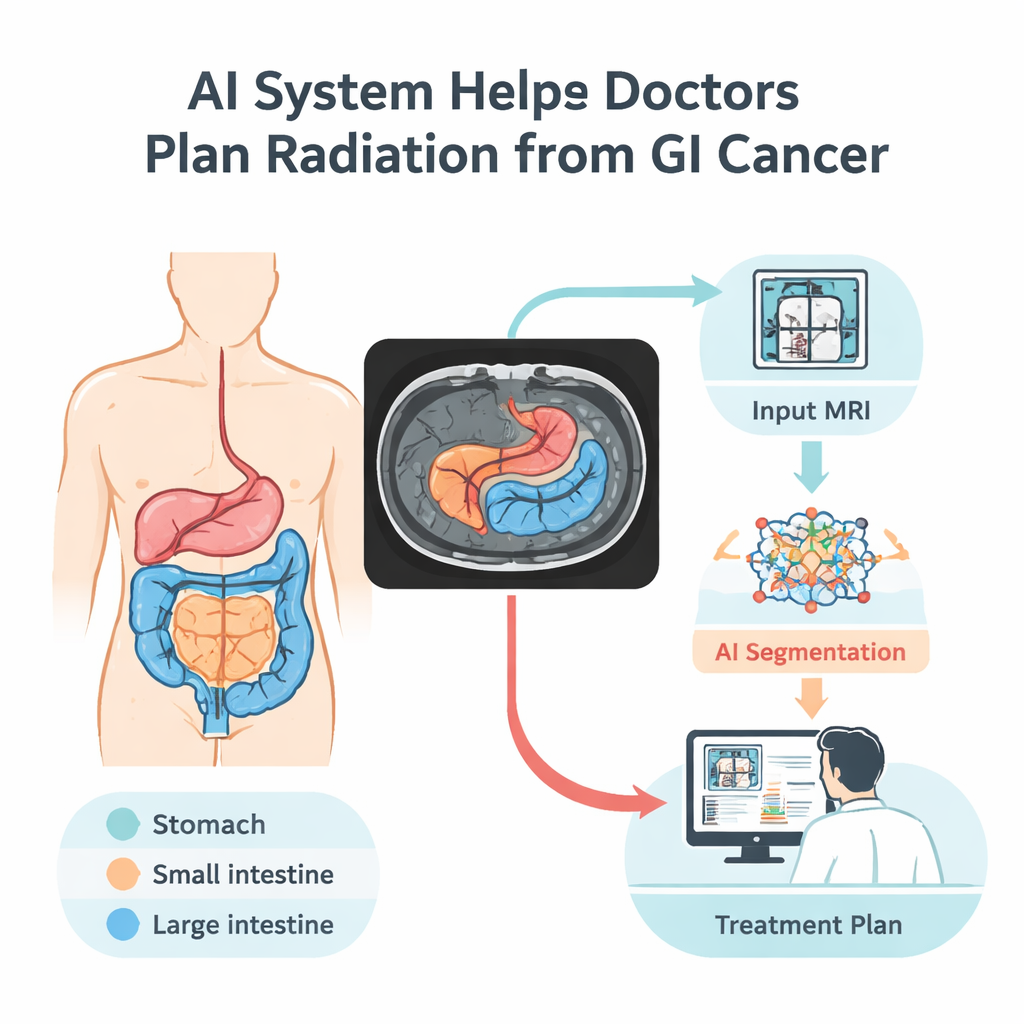

Gdy lekarze leczą nowotwory układu pokarmowego radioterapią, muszą wyważyć dwie potrzeby: silnie zaatakować guz, jednocześnie oszczędzając pobliskie zdrowe narządy, takie jak żołądek i jelita. Obecnie ręczne obrysowywanie tych narządów na każdej klatce rezonansu magnetycznego (MRI) może zająć do godziny na pacjenta dziennie. W badaniu przedstawiono system widzenia komputerowego, który automatycznie śledzi te narządy na obrazach MRI, obiecując szybsze i bardziej precyzyjne planowanie leczenia oraz mniej skutków ubocznych dla pacjentów.

Dlaczego mapowanie jelit ma znaczenie

Nowotwory przewodu pokarmowego są powszechne i często śmiertelne, ze wskaźnikiem przeżycia ogólnego około 30 procent. Radioterapia jest jednym z głównych sposobów leczenia, ale przewód pokarmowy jest ciasno ułożony w jamie brzusznej, a zdrowe narządy mogą się nieco przesuwać z dnia na dzień. Aby uniknąć uszkodzenia żołądka, jelita cienkiego i grubego, specjaliści muszą dokładnie widzieć ich położenie przed każdą sesją. Ręczne obrysowywanie jest wolne i podatne na różnice między ekspertami. Zautomatyzowany, wiarygodny sposób wyznaczania tych granic mógłby skrócić wizyty, umożliwić lekarzom leczenie większej liczby pacjentów i poprawić bezpieczeństwo oraz dokładność dawek promieniowania.

Nauka komputerów „czytania” skanów MRI

Naukowcy zbudowali model sztucznej inteligencji, który uczy się rozpoznawać trzy kluczowe narządy przewodu pokarmowego na skanach MRI: żołądek, jelito cienkie i jelito grube. Trening prowadzono na zbiorze danych UW–Madison GI Tract, jedynym publicznym zbiorze z dokładnymi obrysami narządów na obrazach jamy brzusznej. Zestaw zawiera 38 496 obrazów od 85 pacjentów oraz starannie przygotowane etykiety wskazujące, gdzie dany narząd występuje — lub gdzie go nie ma. Aby w pełni wykorzystać stosunkowo niewielką próbę, zespół podzielił dane według pacjentów (tak, by model nigdy nie widział tej samej osoby w trakcie treningu i testów) i rozszerzył zbiór przez odbicia, rotacje, rozjaśnianie i delikatne zniekształcenia obrazów. Tak kontrolowane zmiany pomagają systemowi radzić sobie z rzeczywistymi wariacjami w położeniu pacjenta, jasności obrazu i subtelnych różnicach kształtu.

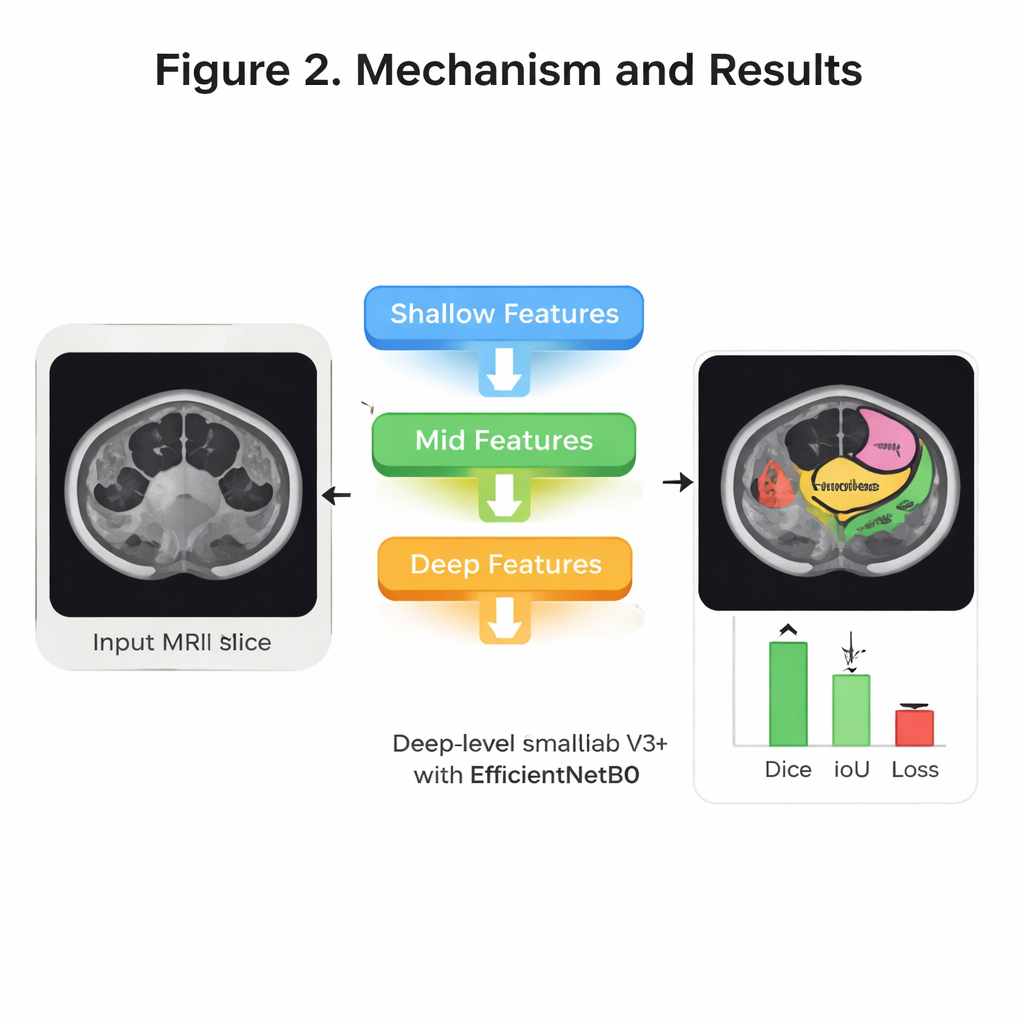

Jak nowy model AI dostrzega wzorce

W modelu połączono kilka koncepcji z nowoczesnego rozpoznawania obrazów, by wyostrzyć jego „wzrok” anatomiczny. Najpierw kompaktowa sieć EfficientNet B0 skanuje każdy obraz i buduje warstwy cech wizualnych — od prostych krawędzi po złożone kształty narządów — przy niewielkim zapotrzebowaniu obliczeniowym. Następnie struktura DeepLab V3+ analizuje obraz na wielu skalach, niczym przy przybliżaniu i oddalaniu, by zrozumieć zarówno drobne detale, jak i ogólny kontekst. Ponadto autorzy dodali mechanizm „uwagi” na kilku poziomach szczegółowości. W prostych słowach, uwaga pomaga systemowi zdecydować, które fragmenty obrazu i które wewnętrzne sygnały zasługują na większe znaczenie, tak aby skupić się na subtelnych, ale istotnych wskazówkach odróżniających na przykład żołądek od pętli jelita cienkiego. Na końcu etap dekodera składa te wskazówki z powrotem w czystą, pełnowymiarową maskę pokazującą trzy narządy.

Testowanie dokładności i wydajności

Zespół systematycznie dopracowywał sposób trenowania systemu — testując różne metody optymalizacji, liczbę cykli treningowych oraz sposoby podziału danych do walidacji. Najlepsza konfiguracja używała optymalizatora RMSprop, czterokrotnej walidacji krzyżowej i 30 rund treningu. Na wydzielonych pacjentach testowych model poprawnie sklasyfikował ponad 99 procent pikseli łącznie i wykazywał bardzo silne pokrywanie z obrysami narysowanymi przez ekspertów. Powszechnie stosowana miara nakładania, współczynnik Dice, osiągnęła średnio około 94 procent dla trzech narządów, natomiast pokrewna miara Intersection over Union wyniosła około 92 procent. Podobnie istotne w zastosowaniach szpitalnych jest to, że system jest stosunkowo lekki: ma około 8,3 miliona uczących się parametrów i potrafi przetworzyć typową klatkę MRI o rozmiarze 224×224 w około 31 milisekund, co wystarcza na niemal rzeczywiste wsparcie podczas codziennego planowania leczenia.

Co to może znaczyć dla pacjentów

Mówiąc prosto, badanie pokazuje, że starannie zaprojektowana sztuczna inteligencja potrafi wiarygodnie obrysować żołądek i jelita na obrazach MRI, dorównując ekspertom, działając znacznie szybciej i konsekwentniej. Taka funkcja może pomóc radioterapeutom precyzyjniej kierować wiązki wokół wrażliwych tkanek, zmniejszając niepożądane uszkodzenia i skutki uboczne podczas leczenia. Choć obecny model trenowano na skanach z jednego ośrodka i przeważnie na prawidłowej anatomii, stanowi on solidną podstawę dla przyszłych systemów obejmujących zmienioną chorobowo anatomię i dane z wielu szpitali. Po dalszych testach i udoskonaleniach narzędzia takie mogą stać się rutynowymi asystentami w sali planowania radioterapii, dyskretnie zapewniając, że ratujące życie promieniowanie trafia dokładnie tam, gdzie jest najbardziej potrzebne.

Cytowanie: Sharma, N., Gupta, S., Al-Yarimi, F.A.M. et al. Multi-level attention DeepLab V3+ with EfficientNetB0 for GI tract organ segmentation in MRI scans. Sci Rep 16, 7546 (2026). https://doi.org/10.1038/s41598-026-38247-7

Słowa kluczowe: rak przewodu pokarmowego, segmentacja MRI, planowanie radioterapii, uczenie głębokie w medycynie, analiza obrazów medycznych