Clear Sky Science · pl

Hybrydowe ramy głębokiego uczenia wykorzystujące modele konwolucyjne i transformery do odpornej klasyfikacji chorób roślin

Dlaczego wykrywanie chorych roślin ma znaczenie

Choroby roślin każdego roku cicho niszczą znaczną część światowej żywności, zmniejszając plony, obniżając dochody rolników i zagrażając bezpieczeństwu żywnościowemu. Wczesne wykrycie tych chorób jest trudne: pola są rozległe, ekspertów brak, a wiele objawów jest subtelnych. W artykule badano, czy nowy typ sztucznej inteligencji potrafi rozpoznawać dziesiątki chorób liści na podstawie prostych zdjęć, otwierając drogę do narzędzi w smartfonach lub kamerach polowych, które pomogą rolnikom działać zanim problemy się rozprzestrzenią.

Od ludzkich przypuszczeń do cyfrowego wzroku

Tradycyjna diagnostyka opiera się na wizualnej ocenie liści przez ludzi i czasem na wysyłaniu próbek do laboratorium. Ten proces jest powolny, subiektywny i często niedostępny w regionach wiejskich. W ciągu ostatniej dekady badacze trenowali programy komputerowe do analizowania obrazów liści. Starsze systemy wymagały ręcznego projektowania cech wizualnych przez inżynierów albo stosowały sieci głębokiego uczenia zwane konwolucyjnymi sieciami neuronowymi, które doskonale wychwytują faktury, kolory i krawędzie. Te metody poprawiły dokładność, ale nadal miały problemy, gdy objawy chorób były słabe, rozproszone po całym liściu lub podobne w różnych schorzeniach. Nowe badanie pyta, czy połączenie dwóch współczesnych podejść AI może dać bardziej niezawodne wyniki w takich trudnych przypadkach.

Łączenie dwóch sposobów widzenia

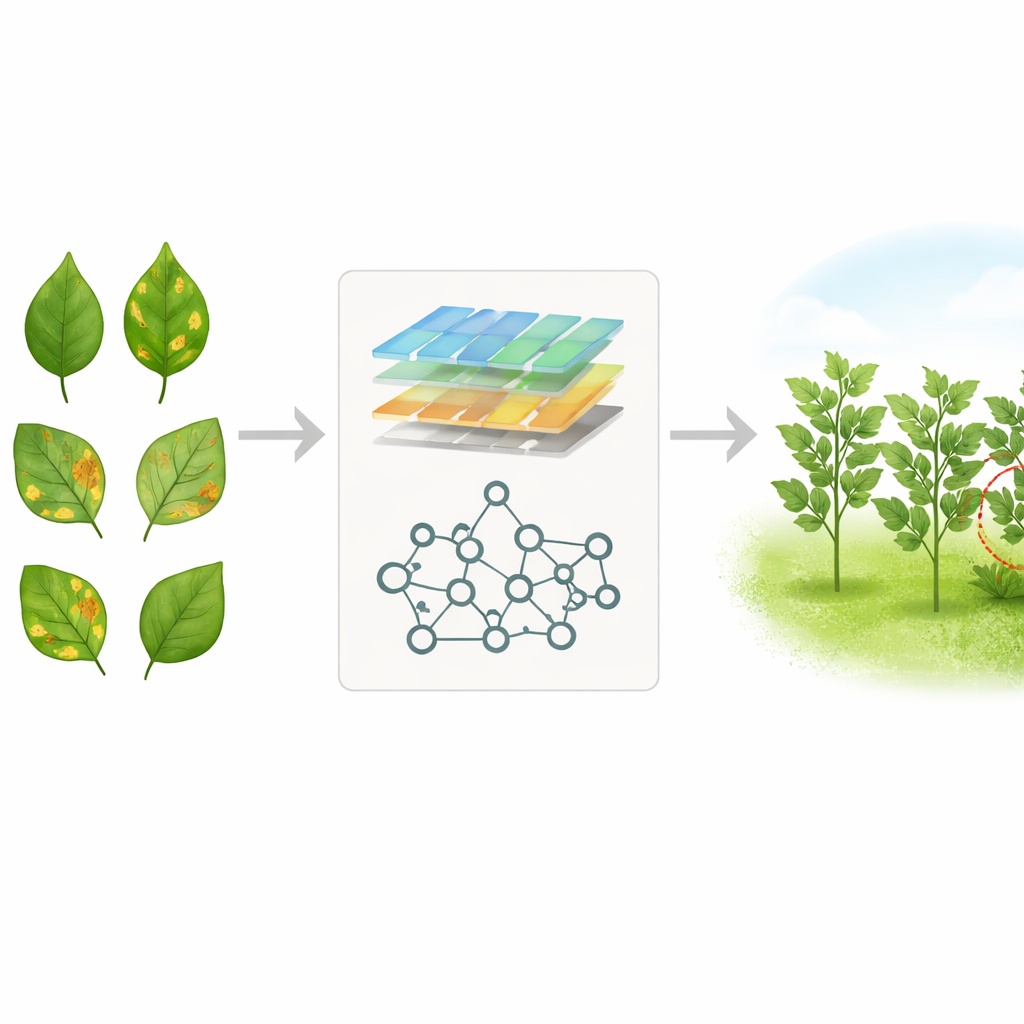

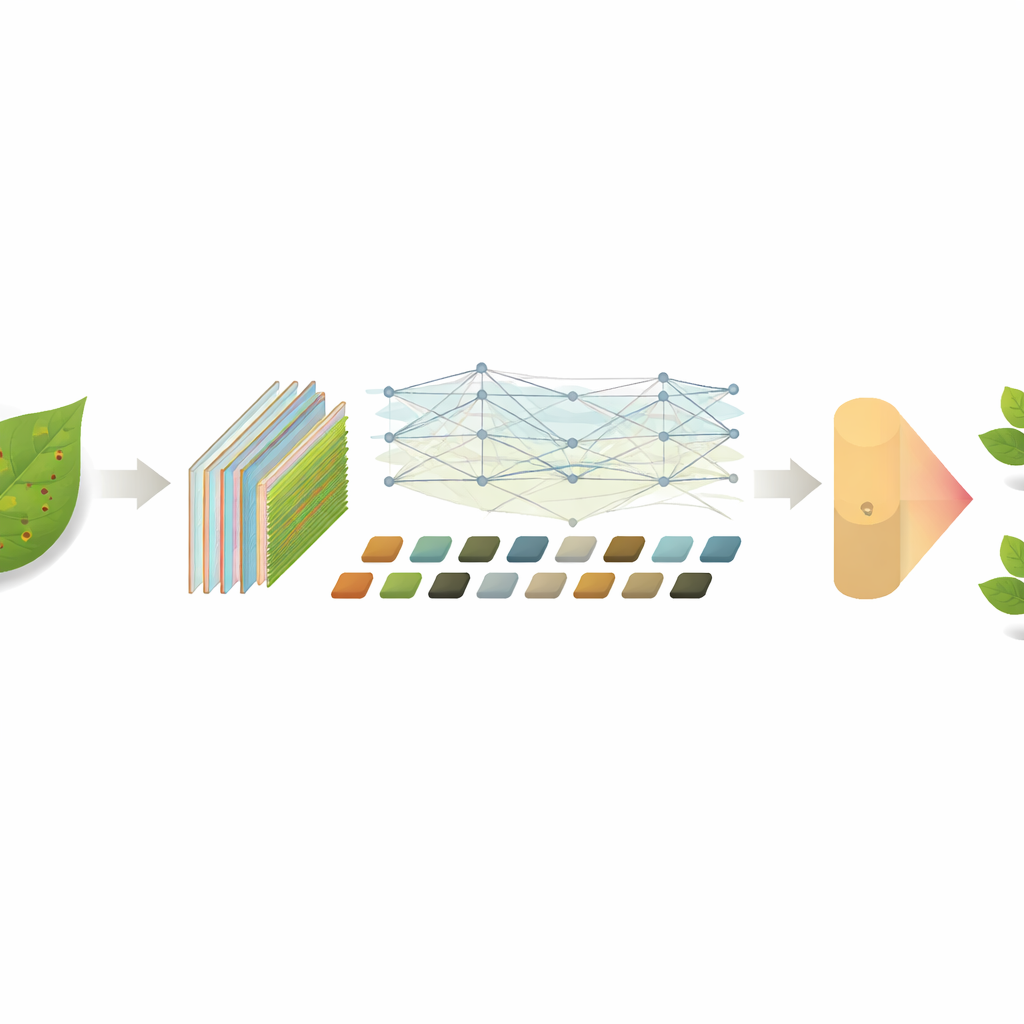

Autorzy zbudowali hybrydowy system łączący sieć konwolucyjną z nowszym modelem obrazu znanym jako vision transformer. Pierwsza część, EfficientNet-B7, działa jak lupa, skanując zdjęcia liści w poszukiwaniu drobnych detali, takich jak maleńkie plamki, nerwy czy przebarwienia. Jej wyjście jest następnie przekształcane i przekazywane do transformera (ViT-B16), zaprojektowanego do zauważania relacji między różnymi obszarami obrazu na dużych dystansach. Poprzez zamianę szczegółowych cech w serię małych „łat” i pozwolenie transformerowi na ocenę, jak każde z nich oddziałuje ze wszystkimi pozostałymi, system potrafi zrozumieć zarówno lokalne zmiany, jak i ogólny wzór na powierzchni liścia. To połączenie ma na celu naśladowanie sposobu, w jaki doświadczony agronom przygląda się uważnie uszkodzeniu, uwzględniając jednocześnie jego położenie i otoczenie.

Nauczanie systemu na tysiącach liści

Do treningu i testów modelu badacze użyli dużej publicznej kolekcji 21 534 zdjęć przedstawiających 38 różnych stanów, w tym wiele chorób oraz zdrowe liście z upraw takich jak jabłoń, pomidor, winorośl i kukurydza. Standaryzowali zdjęcia do wspólnego rozmiaru i stosowali cyfrowe sztuczki — rotacje, odbicia i przybliżenia — aby zasymulować chaotyczne warunki polowe. Model najpierw uczy się ogólnych wzorców wizualnych z istniejących zbiorów obrazów, a następnie jest dopracowywany na tej roślinnej kolekcji. W trakcie treningu zespół śledzi nie tylko ogólną dokładność, lecz także jak często system poprawnie identyfikuje każdą chorobę i jak dobrze unika fałszywych alarmów, zapewniając stabilność wyników zarówno dla klas częstych, jak i rzadszych.

Jak dobrze działa podejście hybrydowe

W ocenie na niewidzianych wcześniej obrazach hybrydowy model poprawnie klasyfikuje zdrowie i choroby roślin w 98,13 procent przypadków, utrzymując wysokie wyniki w surowych miarach precyzji, recall i równowagi między nimi. Radzi sobie zarówno ze zdrowymi liśćmi, jak i z trudnymi chorobami, choć bardzo wczesne objawy wciąż są bardziej problematyczne. Autorzy porównali swój system z szeregiem popularnych alternatyw, w tym samodzielnymi sieciami konwolucyjnymi, czystymi modelami transformerowymi, lekkimi sieciami mobilnymi, szybkimi detektorami takimi jak YOLO oraz klasycznymi narzędziami, np. maszynami wektorów nośnych i lasami losowymi. W tych bezpośrednich porównaniach hybryda konsekwentnie wychodzi na prowadzenie, minimalnie przewyższając nawet silnych konkurentów opartych wyłącznie na EfficientNet lub na zespołach wielu sieci.

Co to oznacza dla gospodarstw i żywności

W praktyce badanie pokazuje, że połączenie dwóch komplementarnych „spojrzeń” na obraz — ostrych lokalnych detali i szerokiego kontekstu — może znacząco poprawić automatyczne wykrywanie chorób roślin. Choć obecny system wciąż wymaga dość wyraźnych zdjęć i działa najlepiej na maszynach z procesorami graficznymi, te same pomysły projektowe można zaadaptować do lżejszych wersji dla smartfonów, dronów czy tanich urządzeń polowych. W miarę jak narzędzia te będą dojrzewać, mogą dawać rolnikom szybkie wskazówki w terenie, co atakuje ich uprawy i gdzie, wspierając wcześniejsze leczenie, ograniczenie stosowania chemii i stabilniejsze zbiory. Dla przeciętnego czytelnika kluczowy przekaz jest taki, że mądrzejsze kamery i algorytmy stają się potężnymi sprzymierzeńcami w ochronie światowych zapasów żywności.

Cytowanie: Jawed, M.M., Tufail, F.A., Ahmed, M.Z. et al. A hybrid deep learning framework using convolutional and transformer models for robust plant disease classification. Sci Rep 16, 9704 (2026). https://doi.org/10.1038/s41598-026-38209-z

Słowa kluczowe: wykrywanie chorób roślin, głębokie uczenie, vision transformer, precyzyjne rolnictwo, klasyfikacja obrazów